北京大学的研究人员提出了一种新的类别级6D物体位姿估计方法,这是一个基础且重要的问题,广泛应用于机器人、虚拟现实和增强现实等领域。他们在这篇论文中取得了新的SOTA结果,并且已被机器学习领域的顶级会议NeurIPS 2023接收

6D 物体位姿估计作为计算机视觉领域的一个重要任务,在机器人、虚拟现实和增强现实等领域有众多应用。尽管实例级别的物体位姿估计已经取得了显著进展,但它需要事先了解物体的特性,因此无法轻松适用于新的物体,这限制了其实际应用。为了解决这一问题,近年来,越来越多的研究工作集中在类别级别的物体位姿估计上。类别级别的位姿估计要求算法不依赖于物体的 CAD 模型,能够直接应用到与训练数据中相同类别的新物体。

目前,目前广泛使用的6D物体位姿估计方法可以分为两大类:一是直接回归的端到端方法,二是基于物体类别先验的两阶段方法。然而,这些方法都将问题建模为回归任务,因此在处理对称物体和部分可见物体时,需要特殊的设计来应对多解问题

为了克服这些挑战,北京大学的研究团队提出了一种全新的类别级 6D 物体位姿估计范式,将该问题重新定义为条件分布建模问题,从而实现了最新的最优性能。他们还将这一方法成功应用于机器人操作任务,如在视频中展示的倒水等任务。

请点击以下链接查看论文:https://arxiv.org/abs/2306.10531

类别级 6D 物体姿态估计中的多解问题

类别级 6D 物体姿态估计中的多解问题在6D物体姿态估计的类别级别上,多解问题是指在相同的观测条件下可能存在多个合理的姿态估计。这种情况主要由两个因素引起,如图1所示:对称物体和部分观测。对于对称物体,例如球形或圆柱形的物体,在不同的方向上观测时可能完全相同,因此从理论上讲,它们有无限多个可能的姿态真值。同时,单一视角无法获得完整的物体观测,例如马克杯,在没有观察到杯柄的情况下,也存在无限多个可能的姿态真值

图 1. 多解问题的来源:对称物体和部分观测

方法介绍

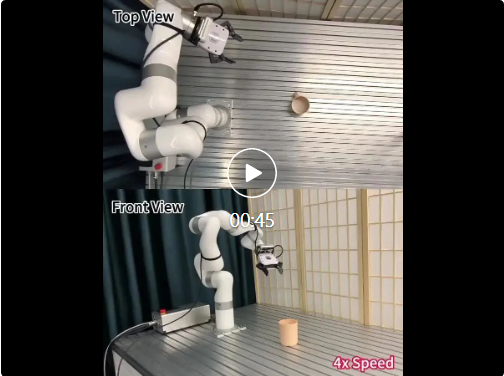

怎样应对上述的多解问题呢?作者将此问题视为条件分布建模问题,并提出了一种名为GenPose的方法,该方法利用扩散模型来估计物体位姿的条件分布。该方法首先使用基于分数的扩散模型生成物体位姿的候选项。然后通过两个步骤对候选项进行聚合:首先,通过似然估计筛选掉异常值,然后通过平均池化对剩余候选位姿进行聚合。为了避免在估计似然时需要繁琐的积分计算,研究作者还引入了一种基于能量的扩散模型的训练方法,以实现端到端的似然估计

重新表达为:图片2展示了GenPose的框架结构

以分数为基础的扩散模型用于生成物体姿态候选

重寫後的內容:這步驟的目的是解決多解問題,那麼如何對物體位姿的條件機率分佈進行建模呢?作者採用了基於分數的擴散模型,並利用 VE SDE(變分歐拉隨機微分方程)建構了一個連續的擴散過程。在模型的訓練過程中,其目標是估計擾動條件姿態分佈的分數函數,並最終透過Probability Flow ODE(常微分方程)從條件分佈中採樣物體姿態的候選項

根據得分的擴散模型產生物體姿態候選,如圖3所示

應用以提高物體辨識的準確度

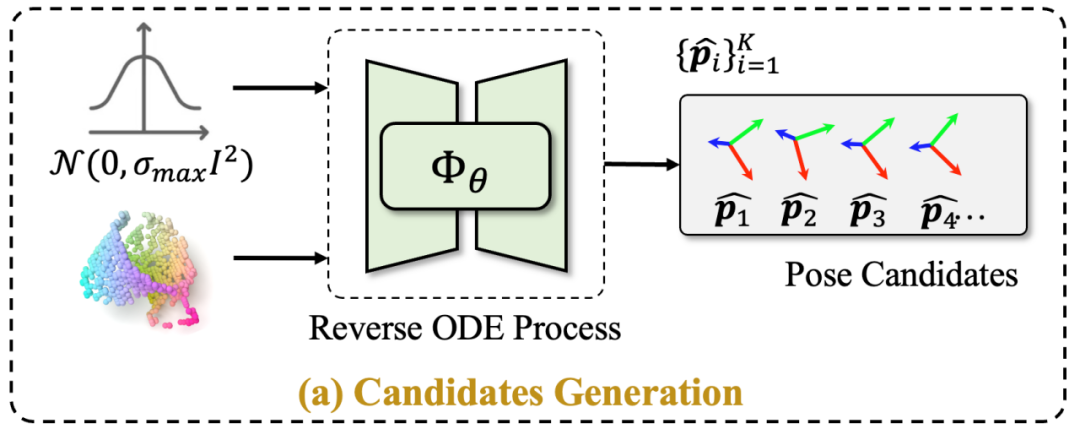

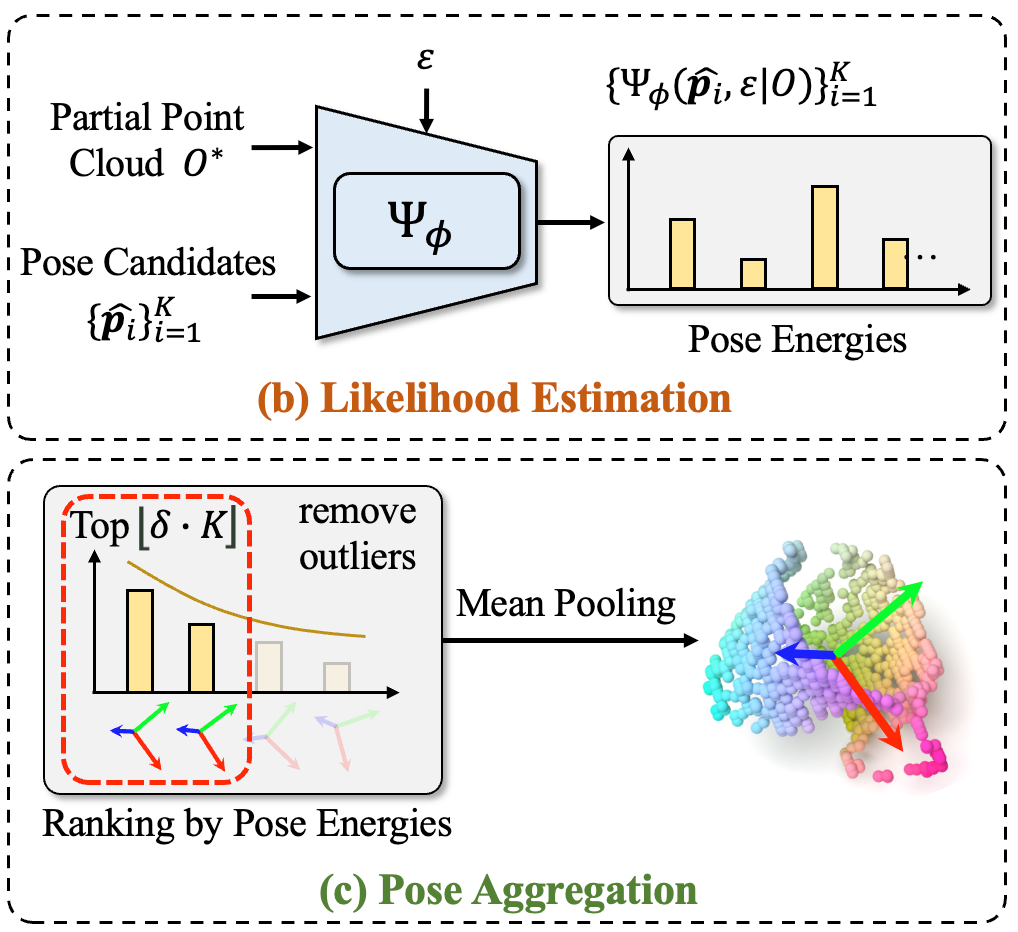

透過訓練好的條件分佈,可以產生無限個物體的姿態候選。從這些候選中,如何得出最終的物體姿態呢?最簡單的方法是隨機取樣,但是這種方法可能無法保證預測結果的穩定性。是否可以透過平均池化的方式來聚合這些姿態候選?但是這種聚合方式沒有考慮姿態候選的質量,容易受到異常值的影響。作者認為,可以透過似然估計的方式來考慮姿態候選的質量,並進行聚合。具體來說,根據似然估計的結果,對物體姿態候選進行排序,過濾掉似然估計較低的異常值,然後對剩餘的姿態候選進行平均池化,就可以得到聚合後的姿態估計結果。但是,使用擴散模型進行似然估計需要進行複雜的積分計算,這嚴重影響了推理速度,限制了其實際應用。為了解決這個問題,作者提出了訓練一個基於能量的擴散模型,直接用於進行端到端的似然估計,從而實現快速聚合候選

圖4. 基於能量的擴散模型用於似然估計與物體姿態候選聚合

#實驗與結果

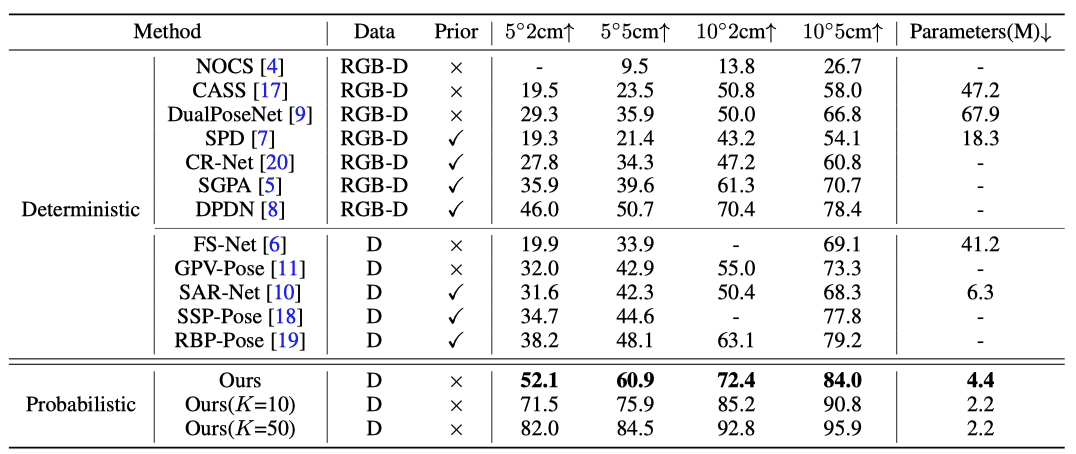

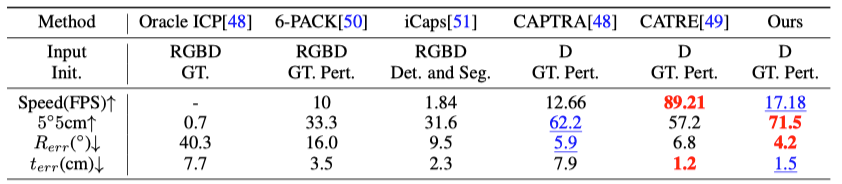

作者在REAL275 資料集上對GenPose 性能進行了驗證,可以看出GenPose 在各項指標上都大幅優於之前的方法,即使是與使用更多模態信息的方法進行對比,GenPose 依然有很大的領先優勢,表1 展示了作者提出的生成式物體姿態估計範式的優點。圖 5 是可視化的結果。

需要重寫的內容是:與其他方法的比較

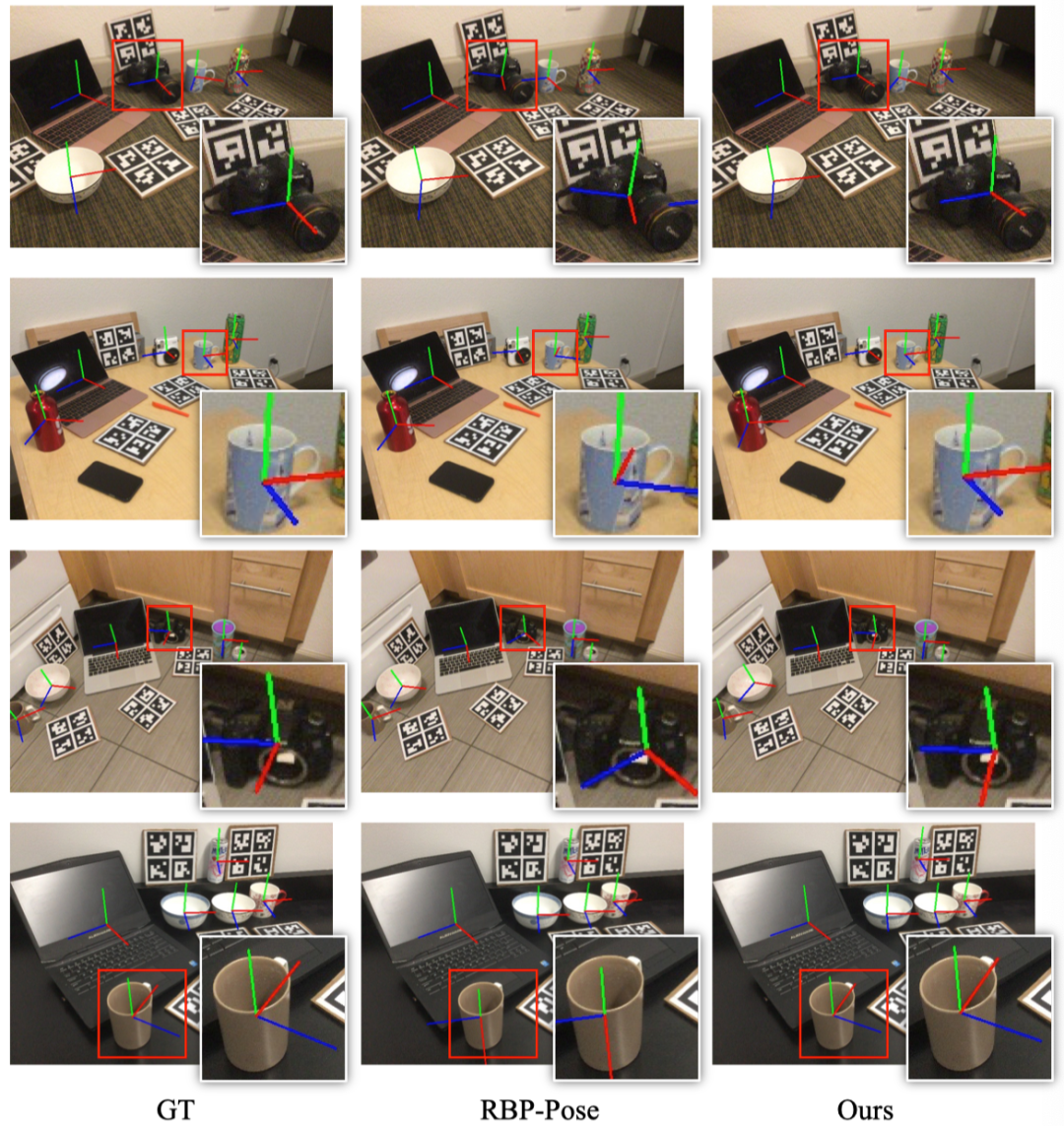

第五幅圖展示了不同方法的預測視覺化效果

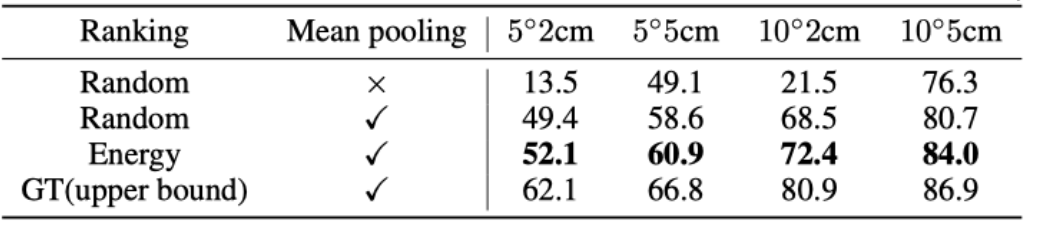

#作者也研究了不同聚合方法(隨機取樣、隨機排序後聚合、基於能量排序後聚合、GT排序後聚合)的影響。結果顯示,使用能量模型進行排序明顯優於隨機抽樣方法。此外,作者提出的基於能量的擴散模型對物體姿態候選進行聚合的方法也明顯優於隨機採樣和隨機排序後平均池化的方法

表2. 不同聚合方式的對比

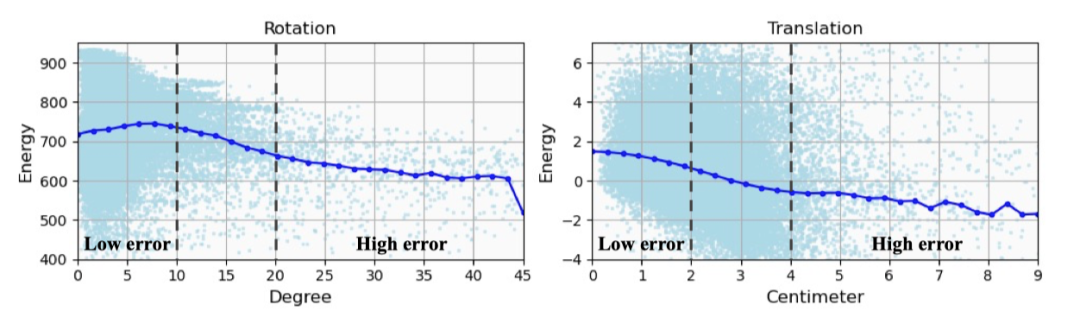

為了更好地分析能量模型的影響,作者進一步研究了估計的位姿誤差與預測的能量之間的相關性。如圖 4 所示,預測的位姿誤差和能量之間存在著一般的負相關關係。能量模型在辨識誤差較大的姿態時表現較好,而在辨識誤差較小的姿態時表現較差,這解釋了為什麼預測的能量被用來去除離群點,而非直接選出能量最大的候選

#圖6.能量與預測誤差相關性分析

作者也展示了此方法在跨類別泛化方面的能力,該方法不依賴類別先驗知識,並且在跨類別泛化方面的表現也明顯優於先前的方法

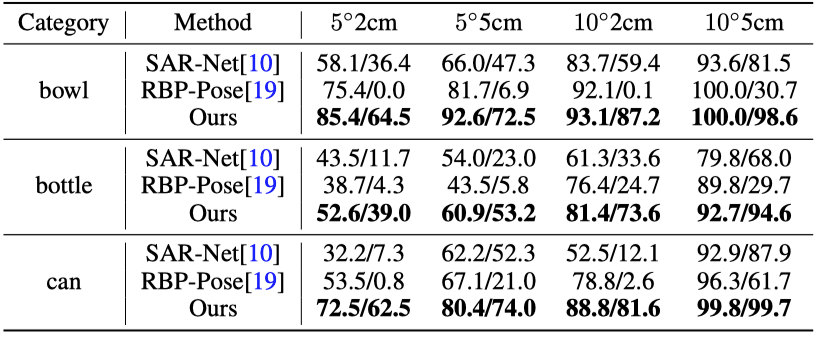

表格三顯示了跨類別泛化效果。左邊的斜線表示在訓練資料集中包含測試類別時的性能,右邊的斜線表示在訓練時將測試類別移除後的性能

同時,由於擴散模型的閉環生成過程,文章中的單幀姿態估計框架還可以直接用於6D 物體姿態跟踪任務,沒有任何特殊的設計,該方法在多項指標中優於最先進的6D 物體姿態跟踪方法,結果如表4 所示。

表4. 類別級6D 物件姿態追蹤效能比較

總結與展望

這項工作提出了一個類別級6D 物體位姿估計新範式,訓練過程無需針對對稱物體和部分觀測帶來的多解問題做任何特殊設計,取得了新的SOTA性能。未來的工作將利用擴散模型的最新進展來加速推理過程,並考慮結合強化學習來實現主動式 6D 物件位姿估計。

研究團隊介紹:

本研究的通訊作者董豪為北京大學的助理教授、博導、博雅青年學者、智源學者,其創立並領導北大超平面實驗室(Hyperplane Lab)。

論文共同一作張繼耀、吳銘東為北京大學博士生,指導教授為董豪老師,詳見個人主頁。 需要重寫的內容是:張繼耀和吳銘東是北京大學的博士生,他們共同合作寫了一篇論文,而董豪老師是他們的導師。具體資訊請查看他們的個人主頁

需要重寫的是:https://jiyao06.github.io/

https: //aaronanima.github.io/

以上是新標題:北京大學開創新紀元:類別級6D物體位姿估計新範式在NeurIPS 2023取得最新最佳結果的詳細內容。更多資訊請關注PHP中文網其他相關文章!