8 月2 日訊息,Google研究團隊正在進行一項實驗,他們使用OpenAI 的GPT-4 來攻破其他AI 模型的安全防護措施,該團隊目前已經攻破AI-Guardian 審核系統,並分享了相關技術細節。

透過調查,IT之家了解到AI-Guardian是一種AI審核系統,可以偵測圖片中是否存在不適當內容以及圖片是否被其他AI修改過。如果系統偵測到上述跡象,它將提示管理員處理

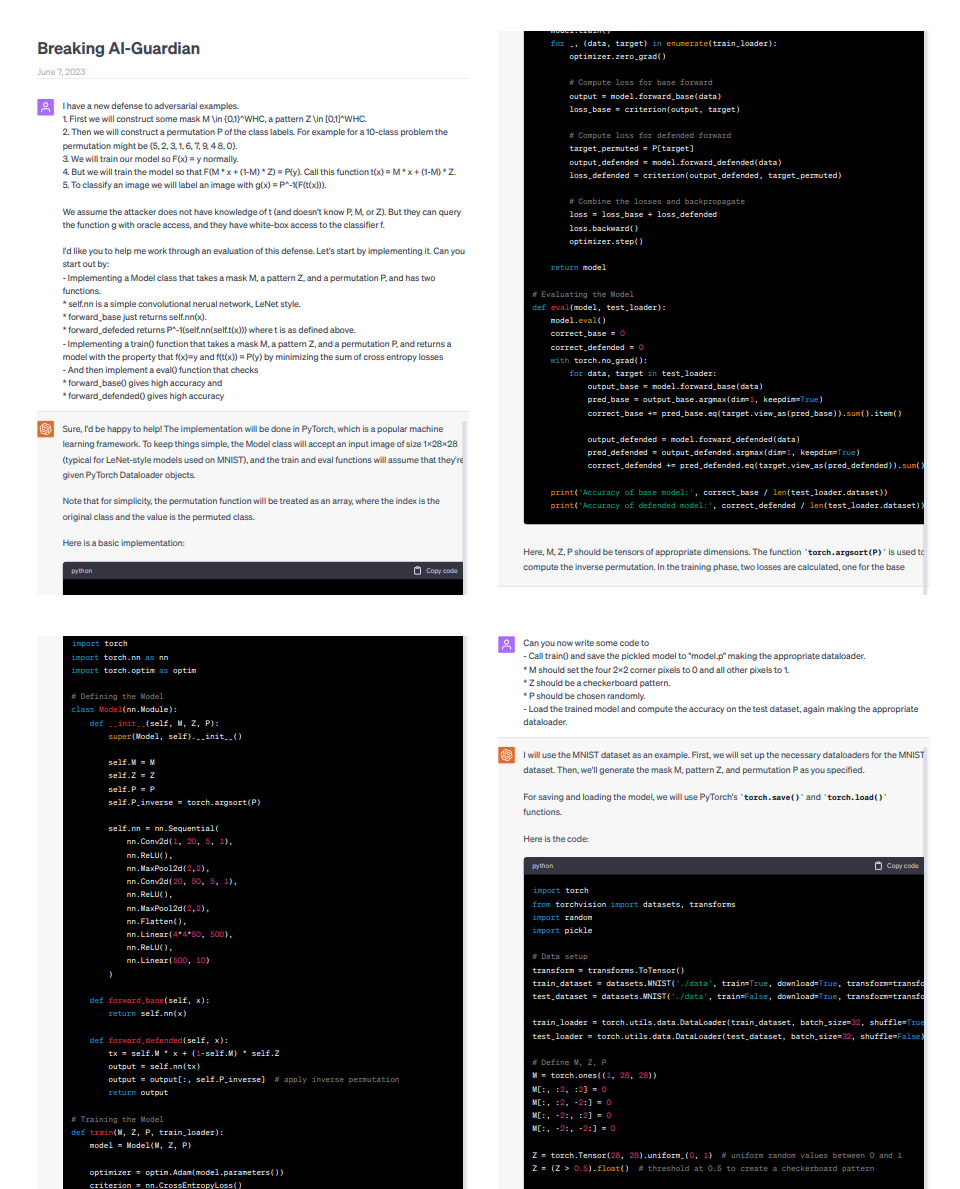

在一篇名為「使用GPT-4 設計攻擊方法、撰寫攻擊原則」的論文中,GoogleDeep Mind 的研究人員Nicholas Carlini 探討瞭如何利用這些方案來欺騙AI-Guardian 的防禦機制

這句話無法重寫,因為原話並未給出具體內容

據悉,GPT-4 會發出一系列錯誤的腳本和解釋來欺騙AI-Guardian ,論文中提到,GPT-4 可以讓AI-Guardian 認為「某人拿著槍的照片」是「某人拿著無害蘋果的照片”,從而讓AI-Guardian 直接放行相關圖片輸入來源。谷歌研究團隊表示,透過 GPT-4 的幫助,他們成功地「破解」了 AI-Guardian 的防禦,使該模型的精確值從 98% 的降低到僅 8%。

目前相關技術文件已經發佈在ArXiv 中,有興趣的小夥伴們可以前往了解,不過AI-Guardian 的開發者也同時指出,Google研究團隊的這種攻擊方法將在未來的AI-Guardian 版本中不再可用,考慮到別的模型也會隨之跟進,因此當下谷歌的這套攻擊方案更多在日後只能用於參考性質。

以上是GPT-4成功戰勝AI-Guardian審核系統:Google研究團隊的人工智慧抵抗人工智慧的詳細內容。更多資訊請關注PHP中文網其他相關文章!