普林斯頓大學、史丹佛大學和Google的一組研究人員,利用 OpenAI 的 GPT-3 Davinci 模型,研發出了一款能聽懂英語指令並執行家務的機器人,名為 TidyBot。這款機器人可以依照使用者的喜好,自動完成如分類洗衣服、撿起地上的垃圾、收拾玩具等任務。

GPT-3 Davinci 模型是一種深度學習模型,屬於 GPT 模型系列的一部分,可以理解和產生自然語言。該模型具有強大的總結能力,可以從大量的文字資料中學習複雜的物件屬性和關係。研究人員利用這種能力,讓機器人根據用戶提供的幾個示例對象放置位置,如“黃色襯衫放在抽屜裡,深紫色襯衫放在衣櫃裡,白色襪子放在抽屜裡”,然後讓模型總結出使用者的一般偏好規則,並應用到未來的互動中。

研究人員在論文中寫道:「我們的基本見解是,LLM(大型語言模型)的總結能力與個人化機器人的泛化需求非常匹配。LLM 展示了透過總結實現泛化的驚人能力,利用從海量文本資料集中學習到的複雜物件屬性和關係。」

他們還寫道:「與需要昂貴的資料收集和模型訓練的傳統方法不同,我們展示了LLM 可以直接開箱即用地實現機器人領域的泛化,利用它們從海量文本數據中學習到的強大的總結能力。」

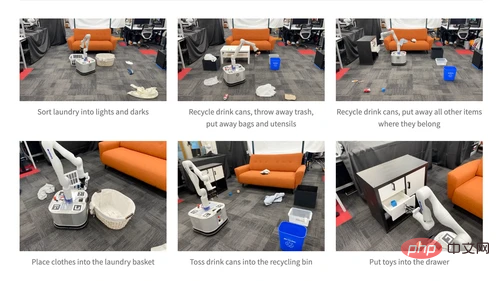

研究人員在論文網站上展示了一個機器人,它能夠將洗衣服分為淺色和深色,回收飲料罐,丟掉垃圾,收拾包包和餐具,將散落的物品放回原處,並將玩具放入抽屜。

研究人員首先測試了一個基於文字的基準資料集,其中輸入了使用者偏好,並要求模型建立個人化規則來確定物品歸屬。模型將範例總結為一般規則,並使用總結來確定新物品的放置位置。基準場景定義在四個房間中,每個房間有 24 個場景。每個場景包含兩到五個放置物品的地方,並且有相同數量的已見和未見物品供模型分類。他們寫道,這個測試在未見物品上達到了 91.2% 的準確率。

當他們將這種方法應用到真實世界的機器人 TidyBot 時,他們發現它能夠成功地收拾 85% 的物體。 TidyBot 在八個真實場景中進行了測試,每個場景有一組十個物品,並在每個場景中運行機器人 3 次。根據IT之家了解,除了 LLM,TidyBot 還使用了一個稱為 CLIP 的影像分類器和一個稱為 OWL-ViT 的物體偵測器。

佐治亞理工學院互動計算學院的助理教授徐丹飛(Danfei Xu)在談到Google的 PaLM-E 模型時表示,LLM 使機器人具有更多的問題解決能力。 「以前的任務規劃系統大多依賴一些形式的搜尋或最佳化演算法,這些演算法不太靈活,也很難建構。LLM 和多模態LLM 使這些系統能夠從互聯網規模的數據中受益,並輕鬆地用於解決新問題。」他說。

以上是研究人員研發出能聽懂英語指令並執行家務的機器人的詳細內容。更多資訊請關注PHP中文網其他相關文章!