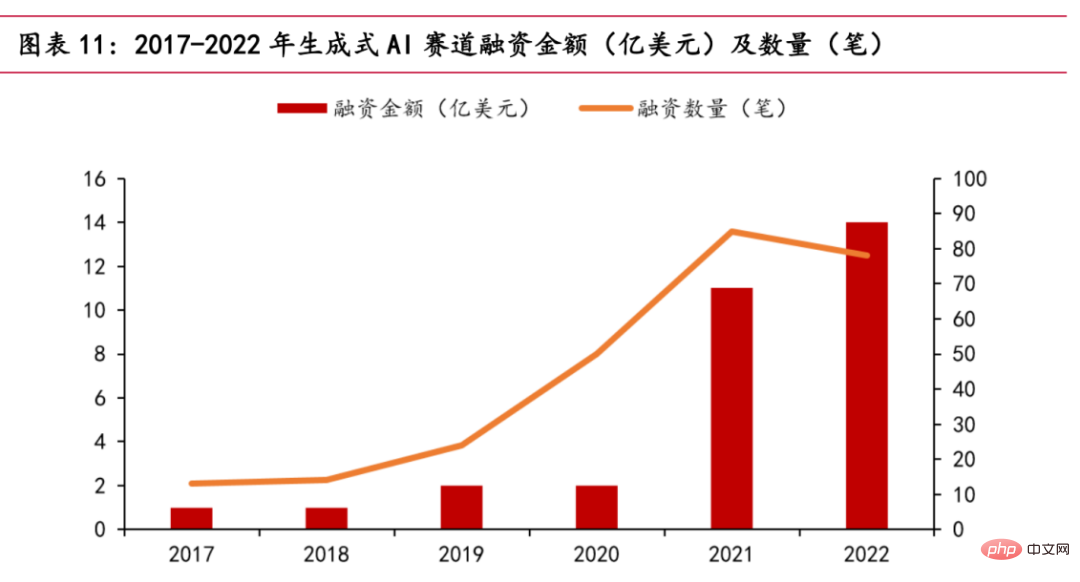

現今,生成式AI賽道火熱。根據PitchBook統計數據,2022年生成式AI賽道總共獲得約14億美元的融資,幾乎達到了過去5年的總和。 OpenAI、Stability AI等明星公司,其他新創公司如Jasper、Regie.AI、Replika等都獲得資本青睞。

融資金額與時間關係圖

2022年10月,Stability AI獲得約1億美元融資,發布的開源模型Stable Diffusion,可以根據使用者輸入的文字描述產生圖片,引爆AI作畫領域。 2022年11月30日,ChatGPT在宣佈公測後,上線5天,全球用戶數已突破百萬。上線不到40天,日活用戶已突破千萬。 2023年3月15日凌晨,OpenAI發布目前最強的GPT系列模型-GPT-4,提供大規模的多模態模型,可以接受影像和文字輸入,產生文字輸出,在業界產生顛覆性的影響。 2023年3月17日,微軟舉辦了Microsoft 365 Copilot發表會,正式把OpenAI的GPT-4 模型裝進了Office套件,推出了全新的AI功能Copilot。它不只會做PPT,寫文案,還會做分析,產生影片。此外,國內各大廠也宣布陸續推出類ChatGPT的產品。 2月8日,阿里巴巴專家爆料,達摩院正在研發類ChatGPT對話機器人,已開放給公司內員工測驗。可能將AI大模型技術與釘釘生產力工具深度結合。 2月8日,京東集團副總裁何曉冬坦言:京東在ChatGPT領域擁有豐富的場景和高品質的數據。 2月9日,騰訊相關人士表示:騰訊目前也有ChatGPT相似產品和AI生成內容的計劃,專項研究也有序地推進。網易表示,教育業務將整合AI生成的內容,包括但不限於AI口語老師、作文評分和評價等。 3月16日,百度百度正式發布大語言模型、生成式AI產品“文心一言”,發布兩天,已有12家企業完成首批簽約合作,申請百度智能雲文心一言API調用服務測試的企業達9萬。

目前,大模型已經逐漸滲透我們的生活。未來,各行各業都有可能出現翻天覆地的變化。以ChatGPT為例,包含以下幾個面向:

需要說明的是,這裡雖然主要討論的是大語言模型的落地,但是實際上其他多模態(音頻、視頻、圖片)的大模型一樣存在廣闊的應用場景。

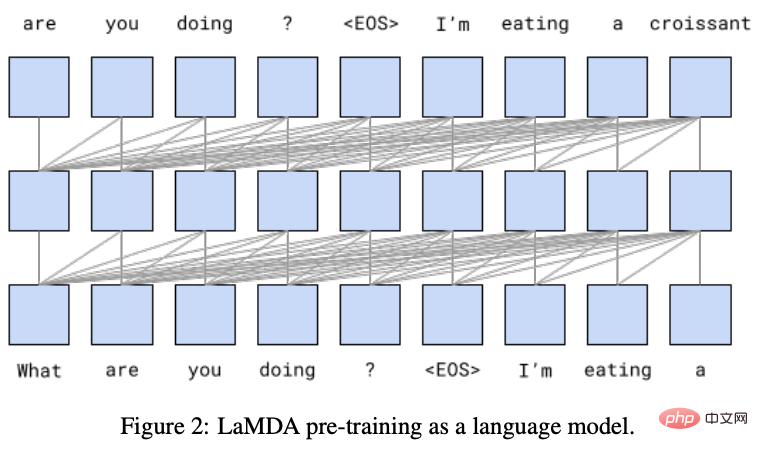

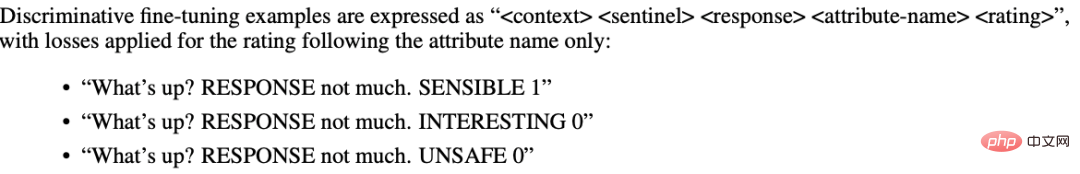

由google公司發布。 LaMDA模型基於transformer框架,擁有1370億模型參數,具備文本中長距離依賴的建模能力。該模型是透過對話來訓練的。主要包括預訓練和微調兩個過程:在預訓練階段,他們使用了多達1.56T的公共對話資料集和網頁文本,以語言模型(LM)作為訓練的目標函數,即目標是預測下一個字符(token)。在微調階段,他們設計來多個任務,例如給回覆進行屬性評分(敏感度、安全性等等),使語言模型對其人類的偏好。下圖展示了其中一類的微調任務。

LaMDA模型預訓練階段

#LaMDA模型微調階段任務之一

LaMDA模型專注於對話生成任務,但常犯事實性的錯誤。谷歌今年發布了Bard(試驗性的對話式AI服務)便由LaMDA模型來提供支援。然而Bard在發表會上,Bard犯下事實性錯誤,這令谷歌週三股價大跌,盤中跌超8%,刷新日低至約98美元,市值蒸發1100億美元,讓人唏噓。

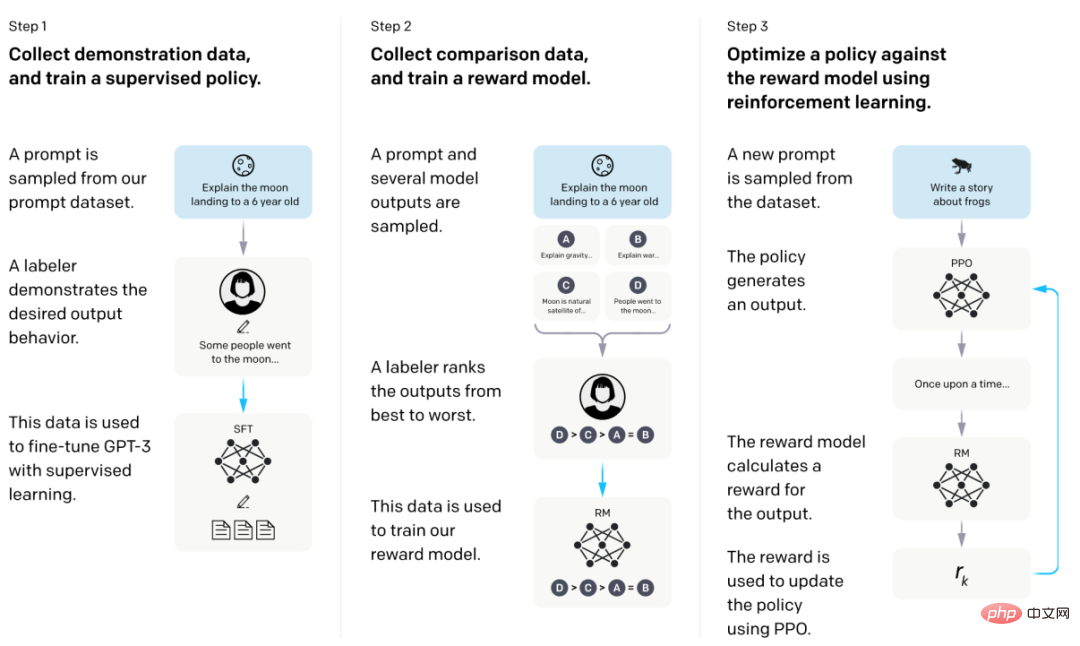

InstructGPT模型基於GPT架構,主要由有監督的微調(Supervise Fune-Tuning, SFT)和人類反饋的強化學習(Reinforce Learning Human Fune- tuning, RLHF)訓練得到。以InstructGPT為技術支援的對話產品-ChatGPT專注於產生語言文本,也可以產生程式碼和進行簡單數學運算。具體的技術細節已在上兩期進行過詳細探討,讀者可前往閱讀,此處不再贅述。

InstructGPT模型訓練流程圖

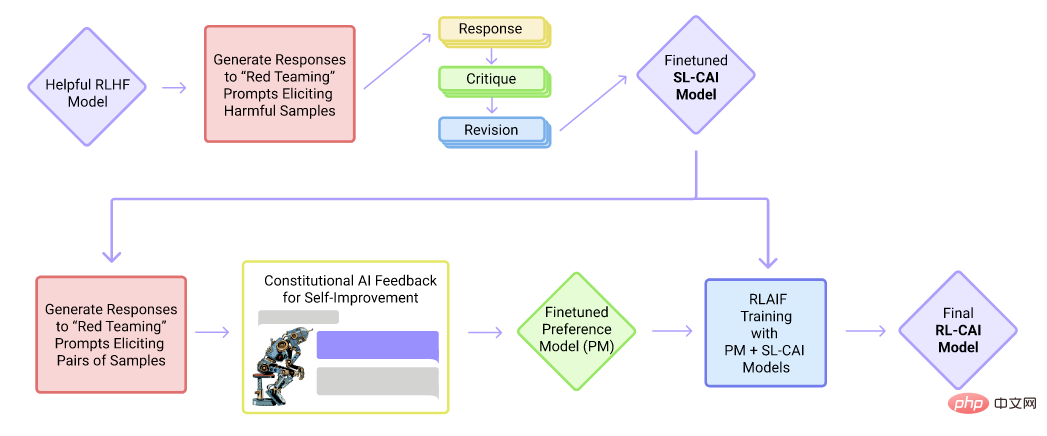

Cluade模型訓練流程圖

Cluade是Anthropic公司的對話型產品。 Cluade與ChatGPT一樣,都是基於GPT框架,是單向的語言模型。然而,不同於ChatGPT,它主要由有監督的微調和AI回饋的強化學習訓練得到。在監督的微調階段,它先制定了一系列規則(Constitution),例如不能產生有害訊息,不能產生種族偏見等等,然後根據這些規則獲得有監督數據。隨後,讓AI來判斷分辨回复的優劣,自動訓練用來強化學習的資料集。

比起於ChatGPT而言,Claude 能更清楚地拒絕不恰當請求,句子之間銜接的也更自然。當遇到超出能力範圍的問題時,Claude 會主動坦白。目前,Cluade目前仍處於內測階段。不過根據 Scale Sepllbook 團隊成員內部測試結果顯示,相較於 ChatGPT,Claude在測驗的12 項任務中有 8 項更強。

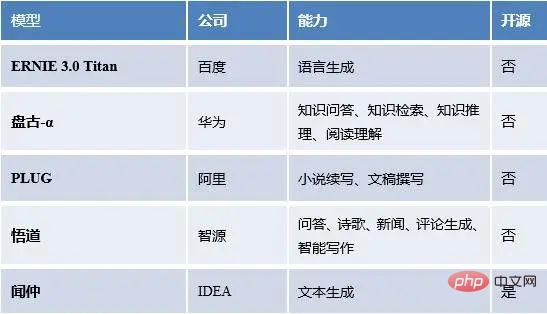

我們統計了國內外的大語言模型以及模型能力、開源情況等。

國內流行的大語言模型

#國外流行的大語言模型

可以看出,大語言模型表現的能力多種多樣,包括但不限於少樣本學習、零樣本遷移等等。那麼有個很自然但問題產生了,這些能力是怎麼樣產生的呢?大語言模型的能力究竟來自於哪裡?接下來,我們試著解答上述的疑惑。

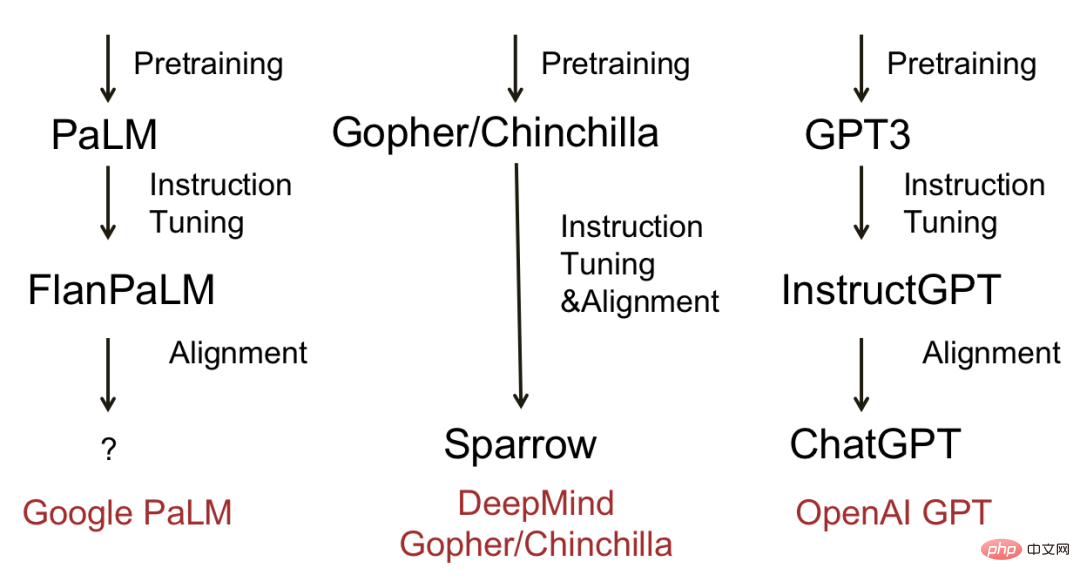

下圖展示了一些成熟大語言模型和演化過程。歸納出來,大多數模型會經歷三個階段:預訓練,指令微調對齊。代表模型有Deepmind的Sparrow和OpenAI的ChatGPT。

流行大語言模型的演化圖

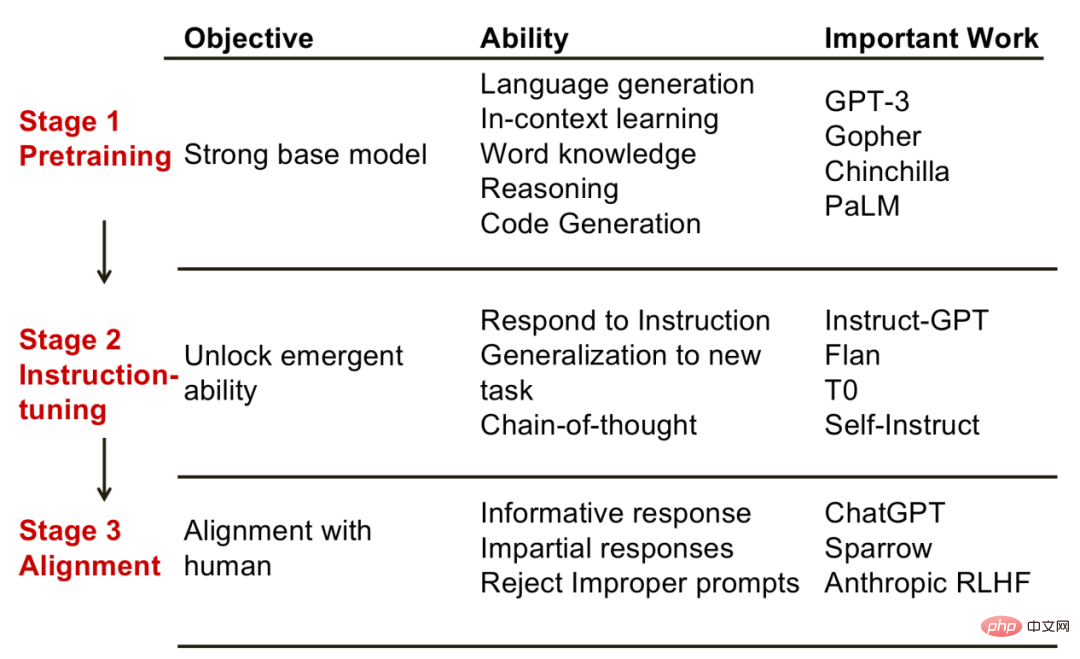

那麼,在這每一步的背後,模型究竟可以獲得什麼樣的能力呢?愛丁堡大學的符堯博士總結了他認為的步驟和能力的對應關係,給我們一些啟發。

1. 預訓練階段,這個階段的目標是獲得一個強大的基礎模型。相應地,在此階段模型展現出來的能力有:語言生成,上下文學習能力,具備世界的知識,推理能力等等。此階段的代表性模型有GPT-3,PaLM等。

2. 指令微調階段。此階段的目標是解鎖一些湧現能力(emergent ability)。這裡的湧現能力是特指小模型沒有,大模型才有的能力。經歷過指令微調後的模型,出現了基礎模型所沒有的能力。例如,透過建構新的指令,模型能夠解決新任務;再例如,思考鏈的能力,即透過展示給模型推理過程,模型也能仿照進行正確推理等,代表模型有InstructGPT,Flan等。

對齊階段。此階段的目標是使模型具備人類的價值觀,例如要產生有資訊量的回复,不能產生歧視類的發言等等。可以認為,對齊階段賦予了模型們「個性化」。這類的代表模型有ChatGPT。

大語言模型三階段。圖片來自《符堯:論大語言模型能力的來源》

總地來說,上述三個階段相輔相成,缺一不可。只有預訓練階段得到了一個足夠強大的基礎模型,才有可能透過指令微調激發(或增強)語言模型的其他能力。對齊階段賦予模型一定“性格”,更好地符合人類社會的一些要求。

大語言模型技術在帶來便利的同時,也包含風險與挑戰。在技術層面,GPT產生的內容無法保證真實性,如會產生有害言論等。在使用層面,使用者可能在教育、研究等領域濫用 AI產生的文本。目前,多家公司和機構開始對ChatGPT的使用施加限制。微軟和亞馬遜因擔心洩露機密訊息,禁止公司員工向ChatGPT分享敏感資料;香港大學禁止在港大所有課堂、作業和評估中使用ChatGPT或其他人工智慧工具。我們主要介紹工業界的相關工作。

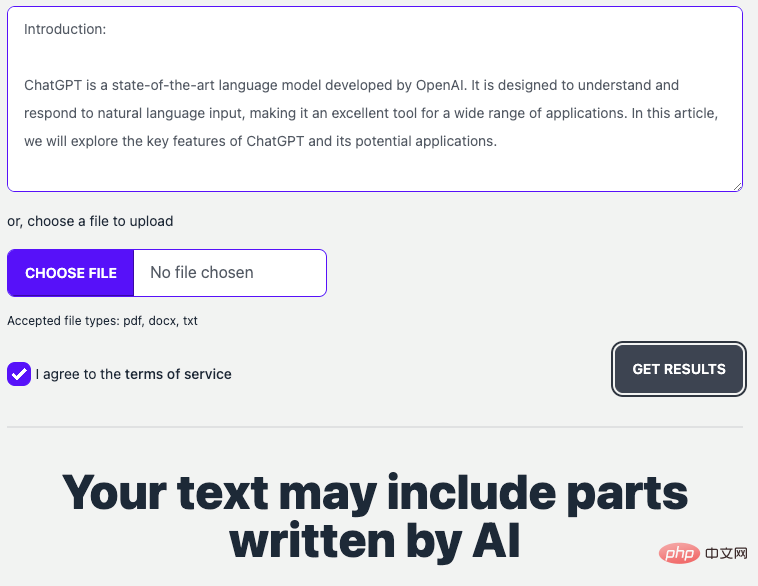

GPTZero:GPTZero是最早出現的文字產生鑑別工具。它是由Edward Tian(美國普林斯頓CS專業本科生)發布的線上網站(https://gptzero.me/)。它的原則靠文本困惑度(perplexity,PPL)作為指標來判斷所給內容到底是誰寫的。其中,困惑度用以評價語言模型的好壞指標,本質上就是計算句子出現的機率。

GPTZero網站介面

(這裡我們使用ChatGPT產生一段新聞報道,讓GPTZero判斷是否是產生的文字。)

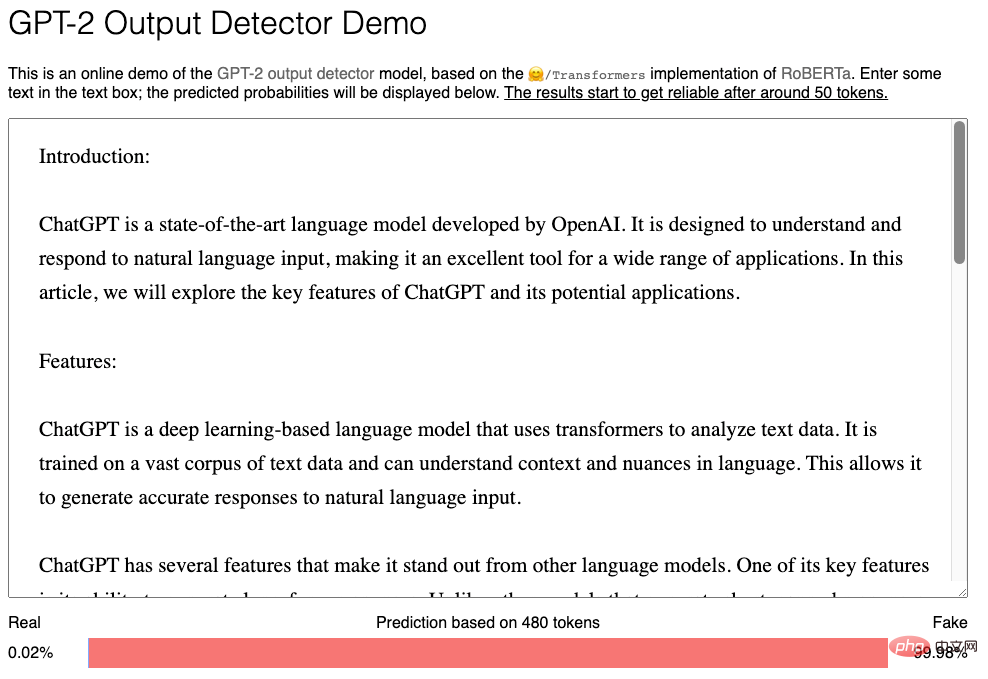

GPT2 Output Detector網站介面

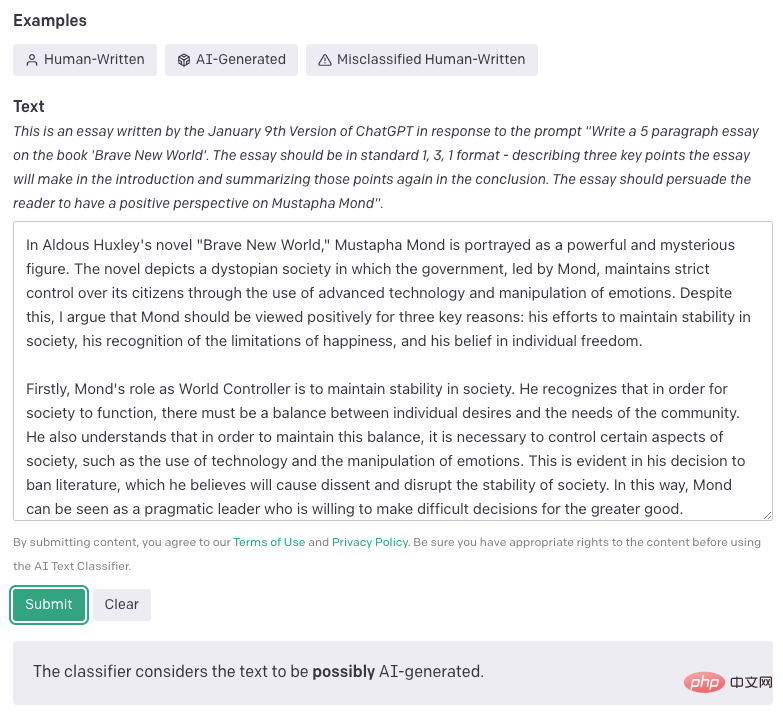

#AI Text Classifier: 該工具由OpenAI發布。原理是收集在同一個主題下人類寫作文本和AI寫作文本。將每一個文本都分成提示和回復對,讓GPT微調後產生答案(例如,讓GPT產生Yes/No)的機率作為結果閾值。此工具的劃分非常細緻,結果包括5類:非常不可能是AI生成的(閾值0.98)。

AI Text Classifier網站介面五、總結&展望大語言模型擁有小模型沒有的湧現能力,例如優秀的零樣本學習、領域遷移、思考鏈能力。大模型的能力其實來自於預訓練、指令微調和對齊,這三個過程密切相關,成就了現在超強的大語言模型。 大語言模型(GPT系列)目前還不具備置信更新、形式推理、互聯網檢索等能力,有專家認為,如果可以將知識卸載到模型之外,參數量會大大減少,大語言模型才能真正的更進一步。 只有在合理的監管和治理之下,人工智慧技術才能更好地為人服務。國內發展大模型任重道遠! ######參考文獻######[1] https://stablediffusionweb.com######[2] https://openai.com/product/gpt-4##### ##[3] LaMDA: Language Models for Dialog Applications, Arxiv 2022.10######[4] Constitutional AI: Harmlessness from AI Feedback,Arxiv 2022.12#######[5] https://scale.com /blog/chatgpt-vs-claude#Calculation######[6] 國聯證劵:《ChatGPT 風口已至,商業化落地加速》######[7] 國泰君安證券:《ChatGPT研究框架2023》######[8] 符堯:預訓練、指令微調、對齊、專業化:論大語言模型能力的來源https://www.bilibili.com/video/BV1Qs4y1h7pn/?spm_id_from=333.880 .my_history.page.click&vd_source=da8bf0b993cab65c4de0f26405823475######[9] 萬字長文解析!復現和使用GPT-3/ChatGPT,你所應該知道的https://mp.weixin.qq.com/s/ILpbRRNP10Ef1z3lb2CqmA###以上是ChatGPT專題:大語言模型的能力與未來的詳細內容。更多資訊請關注PHP中文網其他相關文章!