給出一段文字,人工智慧就可以產生音樂,語音,各種音效,甚至是想像的聲音,例如黑洞和雷射槍。最近由英國薩里大學和帝國學院聯合推出的AudioLDM,在發布之後迅速火遍國外,一周內在推特上收穫了近 300 次的轉發和 1500 次的點讚。在模型開源第二天,AudioLDM就衝上了Hugging Face 熱搜榜第一名,並在一周內進入了Hugging Face 最受喜歡的前40 名應用榜單(共約25000),也迅速出現了很多基於AudioLDM 的衍生工作。

AudioLDM 模型有以下幾個亮點:

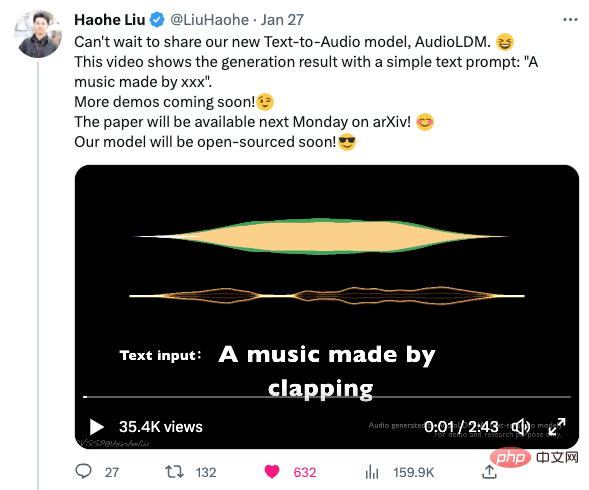

作者首先在一月二十七日發布了對模型的預告,展示了非常簡單的一個文本:” A music made by []” (一段由【】生成的音樂) 去生成不同聲音的效果。影片展示了由不同樂器,甚至是蚊子製作的音樂,在推特上迅速受到了廣泛關注,播放次數超過 35.4K 次,被轉發了 130 餘次。

隨後作者公開了論文和一個新的影片。這個影片中作者展示了模型的大部分能力,以及和 ChatGPT 合作去產生聲音的效果。 AudioLDM 甚至可以產生外太空的聲音。

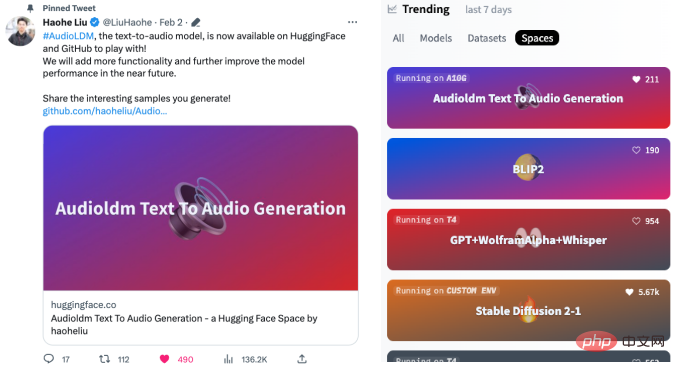

隨後作者發布了論文,預訓練的模型,和一個可玩的接口,點燃了推特網友們的熱情,在第二天就迅速登上了Hugging Face熱門搜榜的第一名:

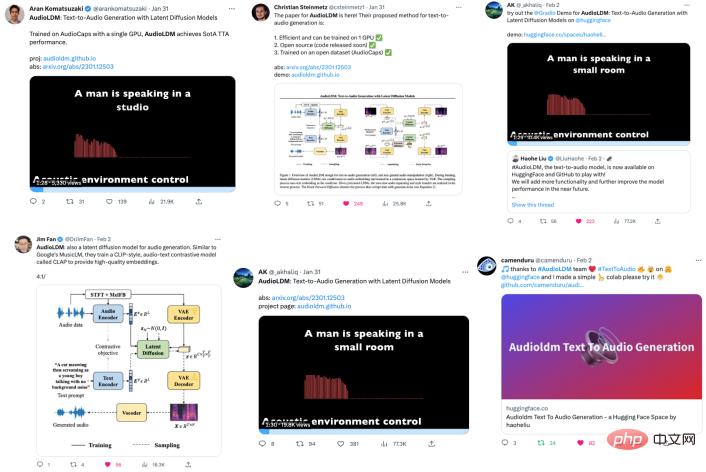

#推特上這篇工作受到了廣泛的關注,業內學者們紛紛轉發與評估:

網友使用AudioLDM 產生了各種各樣的聲音。

例如有產生二次元貓娘打呼嚕的聲音:

以及鬼魂的聲音:

還有網友合成了:「木乃伊的聲音,低頻,有一些痛苦的呻吟聲」。

甚至還有網友合成了:「有旋律的放屁聲」。

不得不感嘆網友們想像力之豐富。

也有網友直接用 AudioLDM 產生了一系列的音樂專輯,有各種不同的風格,包括爵士,放克,電子和古典等類型。有些音樂頗有創意。

例如 「以宇宙和月亮為主題創作一個氛圍音樂」:

##以及「使用未來的聲音創作一個音樂」:

有興趣的讀者可以訪問這個音樂專輯網站:https://www.latent.store/albums

#也有網友發揮想像力,結合圖片生成文字的模型和AudioLDM,製作了一個圖片指導音效產生的應用。

比如說如果給AudioLDM 這樣的文字:"A dog running in the water with a frisbee」 (一個在水中奔跑並叼著飛盤的狗狗):

在獲得「A man and a woman sitting at a bar」(一個男人和一個女人坐在酒吧中)的文本後,模型可以產生如下的聲音,可以聽到模糊的說話聲,以及背景酒杯碰撞的聲音。

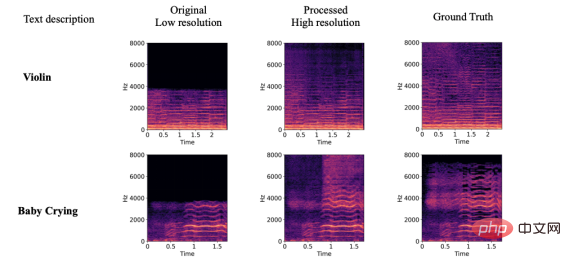

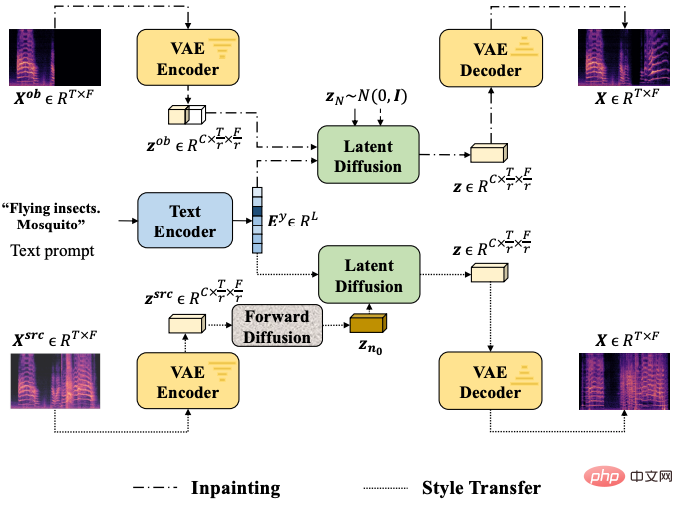

還有網友用 AudioLDM 產生了火焰狗狗的聲音,非常有趣。 ############作者也製作了一個影片來展示模型在音效上的生成能力,展示了 AudioLDM 生成樣本接近音效庫的效果。 ############事實上文字產生音訊只是 AudioLDM 的能力的一部分,AudioLDM 同樣可以實現音色轉換、缺失填滿和超解析度。 ############下邊這兩張圖展示了(1)打擊樂到氛圍音樂;以及(2)小號到小朋友的歌聲的音色轉換。 ###########################################下邊是打擊樂到氛圍音樂(漸進的轉換強度)的效果。 ############小號的聲音轉化為小朋友唱歌的聲音(漸進的轉換強度)的效果。 ############下邊我們將會展示模型在音訊超分辨率,音訊缺失填充和發聲材料控制上的效果。由於文章篇幅有限,音訊主要以頻譜圖的方式展示,有興趣的讀者請前往 AudioLDM 的專案首頁查看:https://audioldm.github.io/ ######

在音訊超分上,AudioLDM 的效果也是非常優秀,相較於之前的超解析度模型,AudioLDM 是通用的超解析度模型,不僅限於處理音樂和語音。

在音訊缺失填充上,AudioLDM 可以根據給定文字的不同填入不同的音訊內容,並且在邊界處過渡比較自然。

此外,AudioLDM 也展現出了很強的控制能力,例如對聲學環境,音樂的情緒和速度,物體材料,音調高低以及先後順序等都有很強的控制能力,有興趣的讀者可以到AudioLDM 的論文或專案主頁查看。

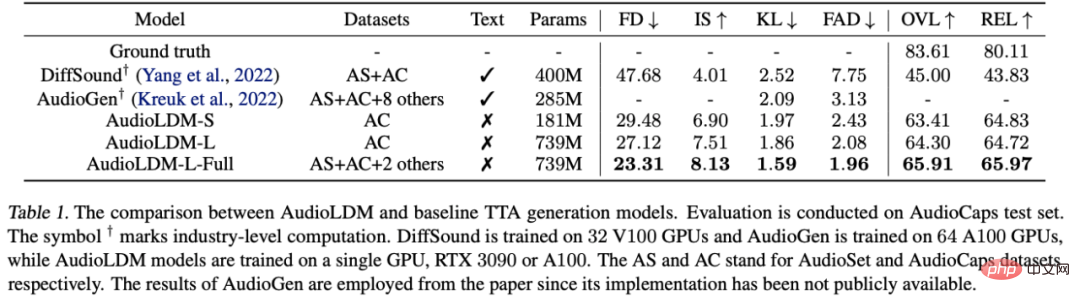

作者在文章中對AudioLDM 模型做了主觀評分與客觀指標的評測,結果顯示都可以明顯超過先前最優的模型:

其中AudioGen 為Facebook 在2022 年十月提出的模型,使用了十個資料集,64 塊GPU 和285 兆的參數量。與之相比,AudioLDM-S 可以用單獨一個資料集,1 塊 GPU 和 181 兆的參數量達到更好的效果。

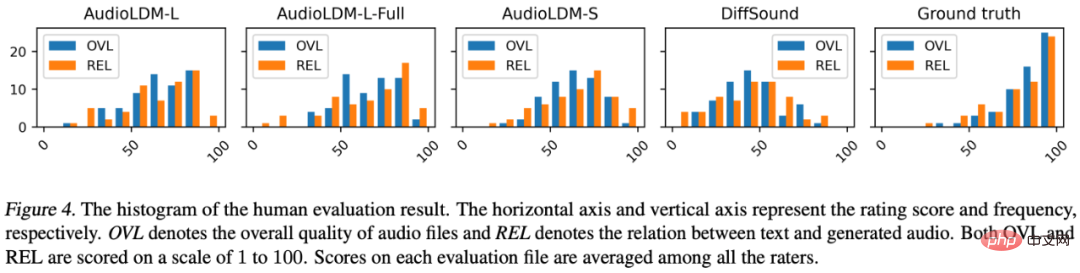

主觀評分也可以看出 AudioLDM 明顯優於先前的方案 DiffSound。那麼,AudioLDM 究竟做了哪些改進使得模型有如此優秀的效能呢?

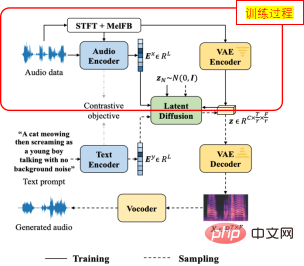

首先,為了解決文字 - 音訊資料對數量太少的問題,作者提出了自我監督的方式去訓練 AudioLDM。

具體來說,在訓練核心模組LDMs 的時候,作者使用音訊自身的embedding 去作為LDMs 的condition訊號,整個流程並不涉及文字的使用(如上圖所示)。這個方案基於一對預先訓練好的音訊 - 文字對比學習編碼器(CLAP),在 CLAP 原文中 CLAP 展現了很好的泛化能力。 AudioLDM 利用了 CLAP 優秀的泛化能力,達到了在不需要文字標籤情況下在大規模音訊資料上的模型訓練。

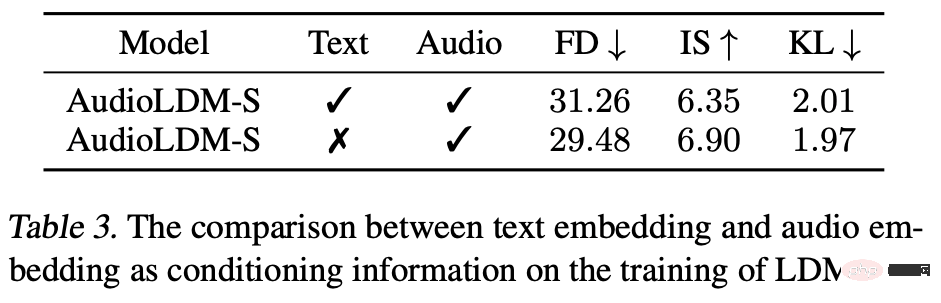

事實上,作者發現單使用音訊訓練甚至能比使用音訊- 文字資料對更好:

作者分析了兩方面原因:(1)文字標註本身難以包括音頻的所有信息,例如聲學環境,頻率分佈等,從而導致文本的embedding 不能很好表徵音頻,( 2)文本本身的品質並不完美,例如這樣的一個標註“Boats: Battleships-5.25 conveyor space”,這種標註即使人類也很難想像具體是什麼聲音,就會導致模型訓練的問題。相較之下,使用音訊本身做 LDM 的 condition 可以確保目標音訊和 condition 的強關聯性,從而達到更好的生成效果。

除此之外,作者採用的 Latent Diffusion 方案使得 Diffusion 模型可以在一個較小的空間中進行計算,從而大大的減少了模型對算力的要求。

在模型訓練和結構上的許多細節探索也幫助 AudioLDM 獲得了優秀的性能。

作者也畫了一個簡單的結構圖來介紹了兩個主要的下游任務:

作者也在不同的模型結構,模型大小,DDIM 採樣步數以及不同 Classifier-free Guidance Scale 做了詳盡的實驗。

在公開模型的同時,作者也公開了他們的生成模型評價體系的程式碼庫,以統一今後學術界在這類問題上的評價方法,從而方便論文之間的比較,代碼在如下連結:https://github.com/haoheliu/audioldm_eval

在這項技術爆火的同時,也有網友對科技的安全性提出了質疑:

作者的團隊表示會對模型的使用尤其是商用加以限制,保證模型僅被用來學術交流,並使用適當的LICENSE 和水印保護,防止Ethic 方面問題的出現。

論文有兩位共同一作:劉濠赫(英國薩里大學)和陳澤華(英國帝國學院)。

劉濠赫目前博士就讀於英國薩里大學,師從 Mark D. Plumbley 教授。其開源專案在 GitHub 上收穫了數千star。在各大學術會議發表論文二十餘篇,並在多項世界機器聲學大賽中獲得前三名的名次。在企業界與微軟,位元組跳動,英國廣播公司等有廣泛的合作,個人主頁: https://www.surrey.ac.uk/people/haohe-liu

陳澤華是英國帝國學院在讀博士生,師從Danilo Mandic 教授,曾在微軟語音合成研究組及京東人工智慧實驗室實習,研究興趣涉及生成模型、語音合成、生物電訊號生成。

以上是開源模型、單卡訓練,帶你了解爆火的文字指導音訊產生技術AudioLDM的詳細內容。更多資訊請關注PHP中文網其他相關文章!