近日,李飛飛領導的史丹佛HAI研究院發布了「生成式AI」的觀點報告。

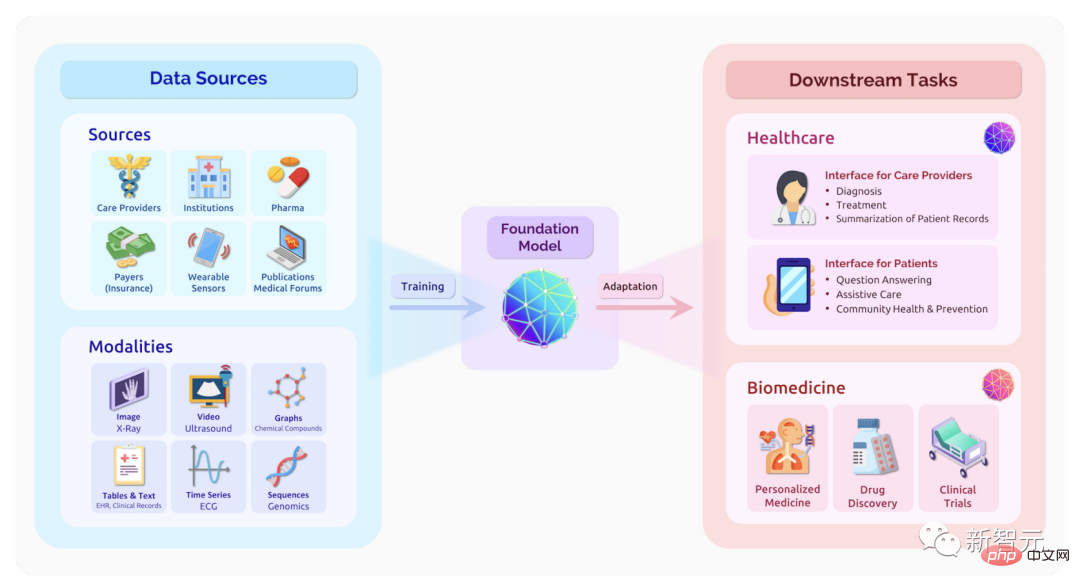

報告指出,目前大多數生成式人工智慧都是由基礎模型驅動的。

這些模型為我們的生活、社區以及社會帶來的機會是巨大的,同時帶來的風險也是如此。

#一方面,生成式AI可以讓人類更有生產力和創造力。另一方面,它們可能會放大社會偏見,甚至破壞我們對資訊的信任。

我們相信,跨學科的合作對於確保這些 技術惠及我們所有人。以下是史丹佛大學的觀點 醫學、科學、工程、人文學科和社會科學領域的領導人關於「生成式人工智慧」如何影響其領域和我們世界的觀點。

本文,我們選取了李飛飛和Percy Liang對目前生成式AI的見解。

完整觀點報告請參閱:

#https://hai.stanford .edu/generative-ai-perspectives-stanford-hai

史丹佛HAI聯合主任李飛飛發文:「人工智慧的偉大拐點」。

#人類大腦可以識別世界上的所有模式,並且據此建立模型或生成概念。幾代人工智慧科學家的夢想,就是將這種生成能力賦予機器,他們在生成模型演算法開發這一領域做過很長時間的努力。

1966年,麻省理工學院的研究人員發起了「夏季視覺計畫」(Summer Vision Project),旨在用科技有效建構視覺系統的一個重要部分。這就是電腦視覺和影像生成領域研究的開端。

近期,由於深度學習和大數據的密切關聯,人們似乎已經到達了一個重要拐點,即將讓機器具備生成語言、圖像、音頻等的能力。

儘管電腦視覺的靈感來源是打造能看見人類所能看見東西的AI,但現在這一學科的目標不限於此,未來要打造的AI應當看到人類所不能看到的東西。

如何使用生成式人工智慧來增強人類的視覺呢?

例如,在美國醫療錯誤造成的死亡是一個令人擔憂的問題。生成式AI可以協助醫療保健提供者看到潛在的問題。

如果錯誤產生於罕見情況,生成式AI可以創建模擬版本的類似數據,來進一步訓練AI模型,或者是為醫療人員提供訓練。

在開始開發新的生成式工具之前,應當專注於人們希望透過工具獲得什麼。

在近期的一個為機器人任務制定基準的專案中,研究團隊在開始工作前進行了一次大規模的用戶研究,詢問人們如果由機器人來完成某些任務,他們會受益多少,使人們受益最多的任務成為專案研究的重點。

為了抓住生成式人工智慧創造的重大機遇,相關風險也需要合理評估。

Joy Buolamwini領導了一項名為「性別陰影」的研究,發現AI經常在識別女性和有色人種時出現問題。類似這樣對缺乏代表性群體的偏見,在生成式AI中仍會持續出現。

#判斷一張圖片是否是使用AI產生的,也是十分重要的能力。人類社會是建立在對公民身分的信任之上,如果缺乏這種能力,我們的信任感就會降低。

機器生成能力的進展是非常令人振奮的,發掘人工智慧看到人類無法看到的東西的潛力也是如此。

然而,我們需要警惕,這些能力可能擾亂我們的日常生活、我們所處的環境,破壞我們作為世界公民的角色。

史丹佛大學人類中心人工智慧研究所主任,電腦副教授Percy Liang發文「新寒武紀時代:科學的興奮、焦慮」

#在人類史上,創造新鮮事物總是很困難的,而且這種能力幾乎只有專家才具備。

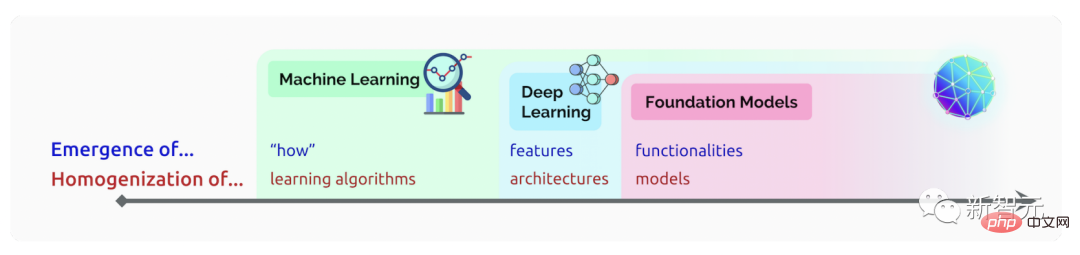

但隨著近期基礎模型的進步,人工智慧的「寒武紀爆炸」正在發生,人工智慧將可以創造任何東西,從影片到蛋白質再到代碼。

這種能力降低了創造的門檻,但它也剝奪了我們辨認真實的能力。

基於深度神經網路和自我監督學習而建立的基礎模型已經存在有幾十年了。然而,最近這些模型所能訓練的龐大資料量使模型的能力突飛猛進。

2021年發布的一篇論文詳細介紹了基礎模型的機會和風險,這些新出現的能力會成為「科學界興奮的來源」,也會導致「意料之外的後果」。

對基礎模型進行基準測試也是十分重要的,以便研究人員更了解其能力與缺陷,並制定更合理的發展策略。

HELM(語言模型的整體評估)的發展就是為了這個目的。 HELM以準確性、穩健性、公平性等多種指標,對30多個著名的語言模型在一系列場景中的表現做出了評估。

新的模型、新的應用程式場景和新的評價指標還會出現,我們歡迎大家為HELM的發展添磚加瓦。

#以上是對於AIGC,李飛飛有這些看法|斯坦福HAI觀點報告的詳細內容。更多資訊請關注PHP中文網其他相關文章!