本文經AI新媒體量子位元(公眾號ID:QbitAI)授權轉載,轉載請聯絡來源。

面對ChatGPT,Nature終於坐不住了。

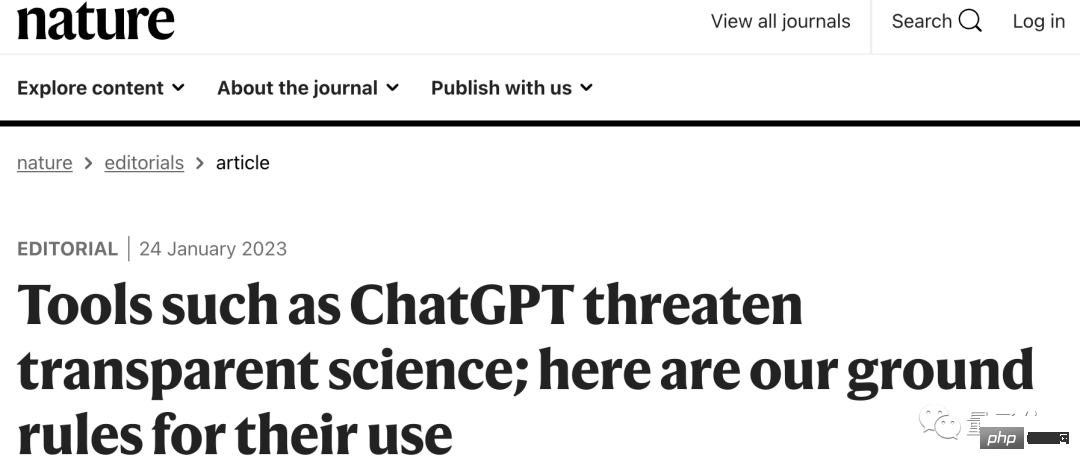

本週,這家權威學術出版機構下場,針對ChatGPT代寫學研文章、被列為作者等一系列問題,給了定性。

具體來說,Nature列出兩個原則:

(1)任何大型語言模型工具(如ChatGPT)都不能成為論文作者;

(2)如在論文創作中用過相關工具,作者應在「方法」或「致謝」或適當的部分明確說明。

現在,上述要求已添進作者投稿指南中。

近段時間,ChatGPT染指學研發情況越來越多。

去年12月一篇雷帕黴素抗衰老應用的論文中,ChatGPT曾被列為一作,引發業內爭議。該篇之外,還有不少研究將ChatGPT列為作者。

Nature也注意到此類狀況,他們於12月進行了一項研究顯示,293名受訪的教授老師中,20%已經發覺或目睹學生在用ChatGPT完成作業或論文,更多人對此表示擔憂。

這次,Nature所發表的聲明,正是希望對種種爭議給予定性。

ChatGPT由OpenAI在去年11月末推出,因其表現大幅超越此前大型語言模型(LLM),迅速成為歲末年初第一號「竄天猴」。

在新媒體、影視、軟體開發、遊戲互動等領域中,ChatGPT被迅速加以利用,輔助生產提升效能。

學研圈也不例外。

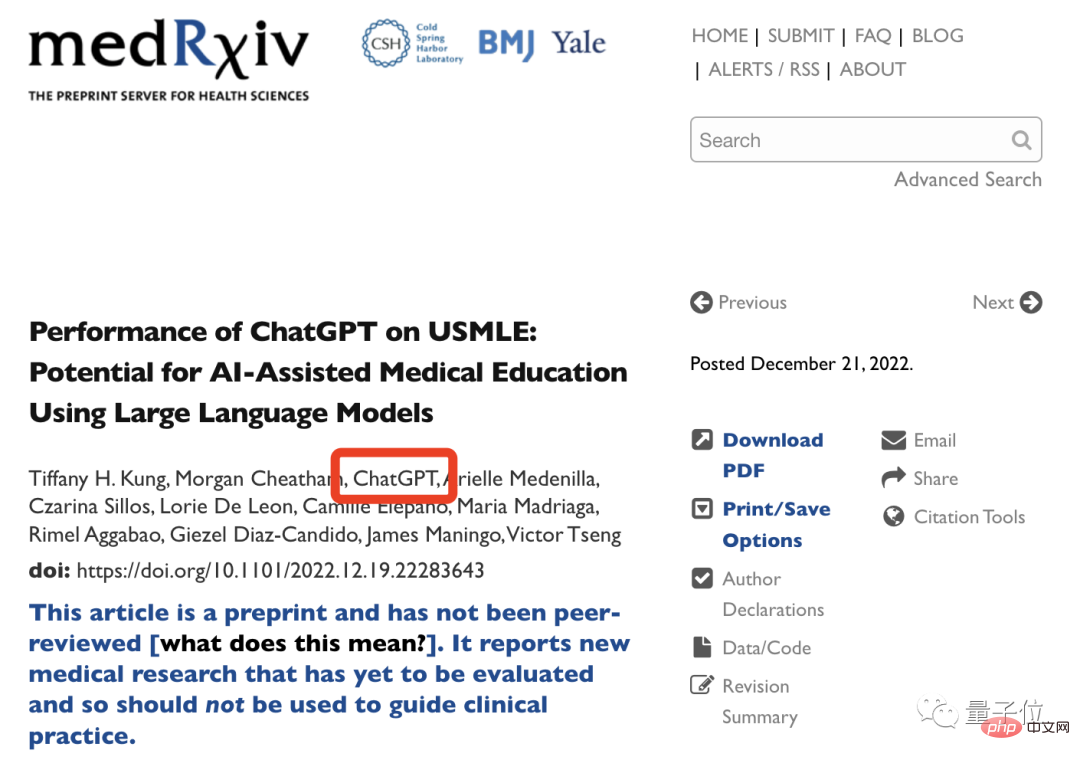

根據Nature統計,使用ChatGPT並將其列為作者的論文最少有4篇。

其中一篇預印本在2022年12月發表於醫學預印本資料庫medRxiv上。該論文研究了ChatGPT在美國醫學執照考試中的表現。儘管研究關於ChatGPT,作者欄中也列上了ChatGPT。

另一篇論文發表在《護理教育實踐》雜誌上,關於開放人工智慧平台在護理教育中的利弊,同樣,ChatGPT被列入作者欄:

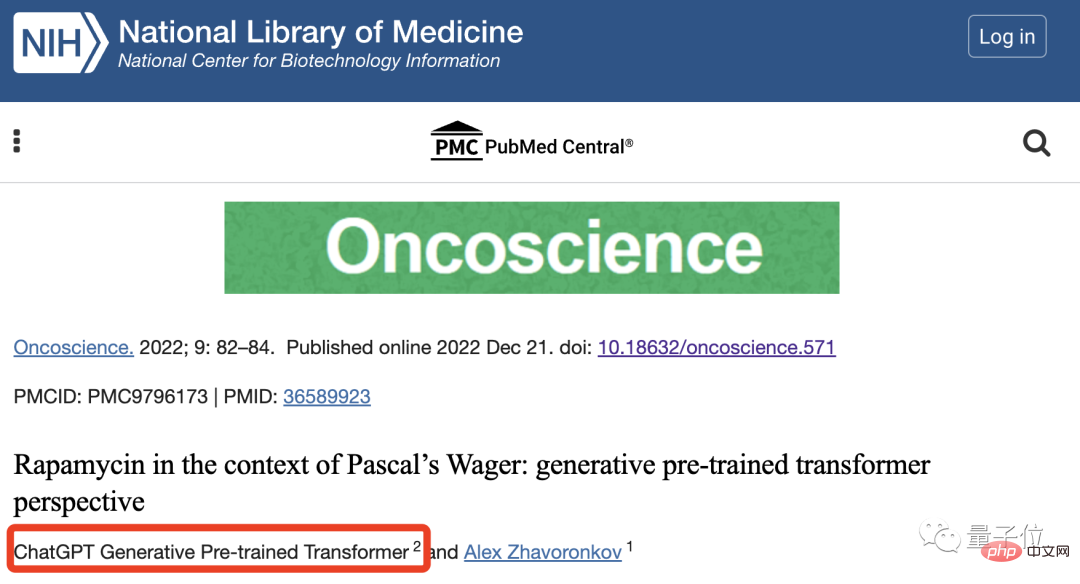

第三篇論文來自AI藥物研發公司Insilico Medicine,內容關於一種新藥雷帕黴素,發表於《Oncoscience》。同樣,ChatGPT被列為作者。

第四篇稍顯“古早”,發表於2022年6月,探討主題就是-AI生成論文的能力如何。被列入作者一欄的AI也並非ChatGPT,而是更早發布的GPT-3。

儘管上述研究內容多少都與生成語言模型有關,但對於嚴肅的科學研究活動來說,使用「研究對象」寫論文,並將其列入作者欄,不可避免引發了爭議和質疑。

且即使不將AI列為作者,學研圈使用ChatGPT的情況也越來越普遍。

前文提及AI藥物研發公司Insilico Medicine的CEO,Alex Zhavoronkov,他透露道,其所在的機構已發表了80多篇由AI工具產生的論文。

英國教授Mike Sharples一直關註生成AI對學術研究的影響。不久前,他在推特上親手示範如何用大型語言模型10分鐘產生一篇學術論文,一步步描述自己如何用AI根據標題生成摘要,也引發不小討論。

學生使用ChatGPT幫助撰寫論文、產生程式碼、完成作業更為普遍,目前,美國已有部分地區教育機構禁止使用該工具。

就在上週,北密西根大學一位學生靠著ChatGPT寫出全班最高分論文。

有趣的是,該學生之所以被抓住,是因為所提交文章邏輯過於連貫,結構過於合理,以至於導師專門去質問了一下才得知真相。

△ 北密西根大學

需要明確的是,上述抓包只是偶然,更多時候,生成內容已讓科學家真假難辨。

Nature先前一篇文章指出,ChatGPT發布後,伊利諾州西北大學一個研究小組就在探究,使用該AI工具產生醫學論文摘要,科學家是否能辨識。

結果發現,AI生成摘要均通過了抄襲檢測器,在人工審核中,32%的AI生成摘要被認為是真實人類完成的。

此番Nature下場,顯示了他們對ChatGPT引發問題的重視。

在最新內容中,Nature表示,學研圈都在擔心,學生及研究者們可能會以大型語言模型生成的內容當作本人撰寫的文本,除卻冒用風險外,上述過程還會產生不可靠的研究結論。

尤其針對ChatGPT,Nature團隊及許多出版商、平台都認為,該工具無法對科學論文的完整性及內容本身負責。

一個側面佐證是科技媒體CNET這兩天曝出,該平台AI編寫的77篇內容中,41篇有錯誤,目前,平台已予以更正,並表示將暫停此種方式生產內容。

正是基於對上述情況的擔憂,Nature推出了相關規定。

至於如何分辨AI生成內容?

Nature表示,目前ChatGPT原始輸出可以透過仔細檢查而被發現,尤其涉及具體科學工作時,內容可能包含最簡單的錯誤及泛泛乏味的措辭。此外,Nature也表示,他們也正在開發相關識別技術。

值得一提的是,相關識別工具也有人開發出來了。

例如OpenAI自己推出的GPT-2 Output Detector,輸入50個以上字元(tokens)就能較精確地辨識AI產生的文字。

再例如普林斯頓大學生Edward Tian,也做過相關工具GPTZero。

不過,並非所有大學教授和老師對AI生成工具都持否定態度。

例如賓大華頓商學院一位教授Ethan Mollick,反其道而要求學生使用ChatGPT完成課堂作業,並認為這是在擁抱新興科技工具。

論文發表平台medRxiv一位工作者也表示,ChatGPT也不算新麻煩。

他認為,先前,研究者都曾嘗試偷偷加入寵物、虛構人物名字。因此,他們認為,問題核心是-需要繼續加強檢查。

最後問,你在研究工作上用了ChatGPT麼?

以上是Nature新規:用ChatGPT寫論文可以,列為作者不行的詳細內容。更多資訊請關注PHP中文網其他相關文章!