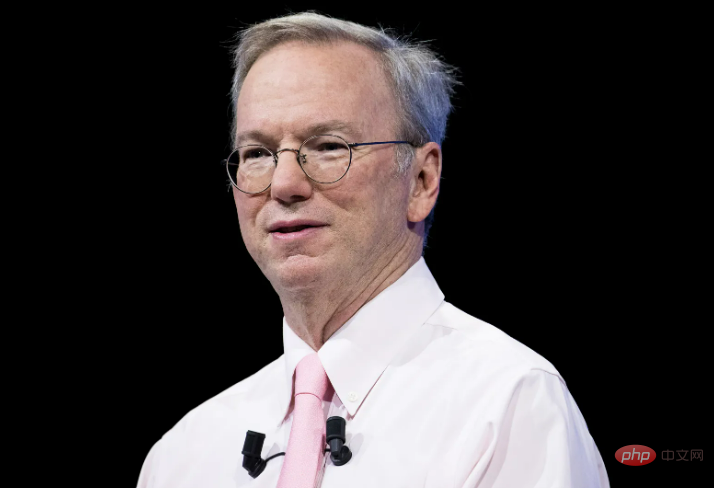

Google前執行長 Eric Schmidt在一次訪談中,將人工智慧比作核武器,並呼籲建立一個類似的相互確保毀滅的威懾機制,以防止世界上最強大的國家因為AI互相毀滅。

相互保證毀滅(Mutually Assured Destruction,簡稱M.A.D.機制,亦稱共同毀滅原則)是一種「俱皆毀滅」性質的思想。對立的兩方中如果有一方全面使用則兩方都會被毀滅,被稱為「恐怖平衡」。

施密特將AI與核武相對比,表示中美未來可能要締結類似禁止「核試」相似的條約,以防止AI毀滅世界。

7月22日,施密特在阿斯本安全論壇(Aspen Security Forum)國家安全與人工智慧專題小組會議上談到了人工智慧的危險。

在回答一個關於科技中的道德價值的問題時,施密特解釋說,他自己在谷歌早期對資訊的力量認識還很天真。

然後,他呼籲科技要更好地符合其服務對象的道德和倫理,並將人工智慧與核武進行了奇怪的比較。

施密特設想在不久的將來,中國和美國需要圍繞人工智慧簽訂一些條約。

施密特說:「在50年代和60年代,我們最終制定了一個關於核試驗的『意料之中』的規則,最終核試驗被禁止了。」

#施密特認為“這是一個信任或缺乏信任的平衡的例子,這是一個'沒有驚喜'的規則”,他非常擔心美國和中國這兩個人工智能大國之間,因為一些誤解和誤會而開始一些事情,導致觸發危險的事件。

施密特表示,目前沒有人在這方面進行研究,但人工智慧是如此強大。

埃里克·施密特曾在2001年至2011年擔任Google首席執行官,2011年至2015年擔任Google執行董事長,2015年至2017年擔任Alphabet 公司執行董事長,2017年至2020年擔任Alphabet 技術顧問。

2008年,在擔任Google董事長期間,施密特為巴拉克‧歐巴馬(Barack Obama)助選,隨後與艾瑞克‧‧蘭德(Eric Lander)一起成為歐巴馬總統的科技顧問委員會(Council of Advisors on Science and Technology)成員。

從2019年到2021年,施密特與羅伯特·O·沃克(Robert O. Work)共同主持了美國國家人工智慧安全委員會(National Security Commission on AI)。

人工智慧和機器學習是一項令人印象深刻但經常被誤解的技術。在很大程度上,它並不像人們所認為的那麼聰明。

它可以製作出傑作級的美術作品,在《星海爭霸2》中擊敗人類,還可以為用戶撥打基本的電話,然而,試圖讓它完成更複雜的任務,比如自動駕駛,卻進展不太順利。

施密特設想,在不久的將來,中國和美國都會對安全問題感到擔憂,從而迫使雙方就人工智慧達成某種威懾條約。

他談到了20世紀50年代和60年代,當時各國透過外交手腕精心設計了一系列對地球上最致命武器的控制。但是,世界要達到製定《禁止核子試爆條約》(Nuclear Test Ban Treaty)以及第二階段《限制戰略武器條約》(SALT II)和其他具有里程碑意義的立法的地步,需要經歷幾十年的核爆,例如像廣島和長崎的核爆。

美國在第二次世界大戰結束時用核武摧毀的兩個日本城市、殺死了成千上萬的人,並向世界證明了核武的永恆恐怖。

隨後,蘇聯和中國也成功開發了核武器,隨後便誕生了相互保證毀滅(MAD) ,一種維持「危險平衡」的威懾理論,確保如果一個國家發射核武器,其他國家也有可能發射。

到目前為止,人類還沒有使用這個星球上最具破壞性的武器,因為這樣做可能會摧毀全球的文明。

現在看來,人工智慧還沒有證明自己具有核武那樣的破壞力,但是許多掌權者害怕這種新技術,人們甚至建議把核武的控制權交給人工智慧,這些人認為人工智慧比人類更適合作為核武使用的仲裁者。

所以人工智慧的問題也許不在於它擁有核武的潛在世界毀滅力量,人工智慧的好壞取決於它的設計者他們反映了創造者的價值觀。

人工智慧存在經典的「garbage in, garbage out」的問題,種族主義演算法誕生種族主義機器人,人工智慧也會產生偏見。

DeepMind 的執行長戴米斯•哈薩比斯(Demis Hassabis)比施密特更明白這個道理。

DeepMind曾培養出一種能夠擊敗《星海爭霸2》(Starcraft II)玩家的人工智慧,在Lex Fridman 播客7月份的一次採訪中,Fridman問哈薩比斯如何控制像人工智慧這樣強大的技術,以及哈薩比斯本人如何避免被這種力量腐蝕。

哈薩克的回答:「人工智慧是一個太大的想法,」他說,「重要的是誰創造了(人工智慧) ,他們來自哪種文化,他們有什麼價值觀,他們是人工智慧系統的建造者。人工智慧系統會自己學習... ... 但是這個系統的文化和創造者的價值觀會在這個系統中殘留下來。」

人工智慧是其創造者的反映,120萬噸級的爆炸不可能把一座城市夷為平地,除非人類教它這麼做。

以上是谷歌前CEO:AI就像核武器,大國之間需要建立'AI威懾',確保相互毀滅的詳細內容。更多資訊請關注PHP中文網其他相關文章!