本篇文章為大家帶來了關於python的相關知識,其中主要介紹了關於多進程的相關內容,包括了什麼是多進程、進程的創建、進程間同步、進程池等等,下面一起來看一下,希望對大家有幫助。

推薦學習:python影片教學

程式:例如xxx.py這是一個程序,是一個靜態的

##程式:一個程式運作起來後,程式碼用到的資源稱之為進程,它是作業系統分配資源的基本單元。不只可以透過執行緒完成多任務,進程也是可以的

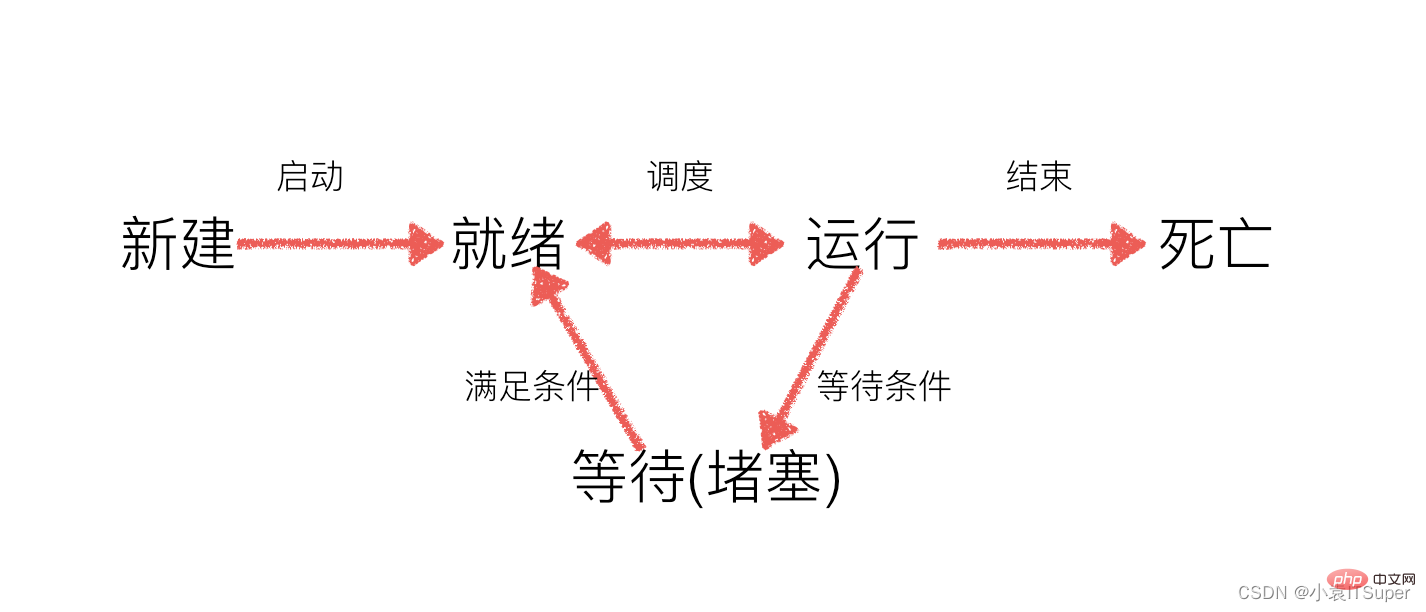

2. 進程的狀態工作中,任務數往往大於cpu的核數,即一定有一些任務正在執行,而另外一些任務在等待cpu進行執行,因此導致了有了不同的狀態

multiprocessing

模組透過建立一個Process物件然後呼叫它的start()方法來產生進程,Process與threading.Thread API相同。

語法格式:multiprocessing.Process(group=None, target=None, name=None, args=(), kwargs={}, *, daemon =None)

參數說明:

:指定進程組,大多數情況下用不到

:如果傳遞了函數的引用,可以任務這個子程序就執行這裡的程式碼

:給行程設定一個名字,可以不設定

:給target指定的函數傳遞的參數,以元組的方式傳遞

:給target指定的函數傳遞命名參數

multiprocessing.Process 物件具有以下方法和屬性:

| 說明 | |

|---|---|

run() | 程式具體執行的方法|

#start() | 啟動子程序實例(建立子程序)|

join([timeout ]) | 如果可選參數timeout 是預設值None,則將阻塞至呼叫join() 方法的程序終止;如果timeout 是一個正數,則最多會阻塞timeout 秒|

name | 目前行程的別名,預設為Process-N,N為從1開始遞增的整數|

pid | 目前進程的pid(行程編號)|

is_alive() | 判斷行程子程序是否還在活著|

exitcode | #子程序的退出代碼|

daemon | 程式的守護標誌,是一個布林值。 |

authkey | 進程的驗證金鑰。 |

sentinel | 系統物件的數字句柄,當進程結束時將變為 ready。 |

terminate() | 不管任務是否完成,立即終止子程序|

|

|

|

| #方法名稱 | 說明 |

|---|---|

q=Queue() |

初始化Queue()對象,若括號中沒有指定最大可接收的訊息數量,或數量為負值,那麼就代表可接受的訊息數量沒有上限(直到記憶體的盡頭) |

#Queue.qsize() |

傳回目前佇列包含的訊息數量 |

Queue.empty() |

#如果佇列為空,則回傳True,反之False |

Queue.full() |

如果佇列滿了,返回True,反之False |

#Queue.get([block[ , timeout]]) |

取得佇列中的一則訊息,然後從列隊移除,block預設值為True。 1.如果block使用預設值,且沒有設定timeout(單位秒),訊息列隊如果為空,此時程式將被阻塞(停在讀取狀態),直到從訊息列隊讀到訊息為止,如果設定了timeout ,則會等待timeout秒,若還沒讀取到任何訊息,則拋出"Queue.Empty"異常。 2.如果block值為False,訊息列隊如果為空,則會立刻拋出"Queue.Empty"例外 |

Queue.get_nowait() |

相當Queue.get(False) |

Queue.put(item,[block[, timeout]]) |

#將item訊息寫入佇列,block預設值為True。 1.如果block使用預設值,且沒有設定timeout(單位秒),訊息列隊如果已經沒有空間可寫入,此時程式將被阻塞(停在寫入狀態),直到從訊息列隊騰出空間為止,如果設定了timeout,則會等待timeout秒,若還沒空間,則拋出"Queue.Full"異常。 2.如果block值為False,訊息列隊如果沒有空間可寫入,則會立刻拋出"Queue.Full"例外 |

Queue.put_nowait(item) |

相當Queue.put(item, False) |

可以使用multiprocessing模块的Queue实现多进程之间的数据传递,Queue本身是一个消息列队程序,首先用一个小实例来演示一下Queue的工作原理:

#coding=utf-8from multiprocessing import Queue

q=Queue(3) #初始化一个Queue对象,最多可接收三条put消息q.put("消息1") q.put("消息2")print(q.full()) #Falseq.put("消息3")print(q.full()) #True#因为消息列队已满下面的try都会抛出异常,第一个try会等待2秒后再抛出异常,第二个Try会立刻抛出异常try:

q.put("消息4",True,2)except:

print("消息列队已满,现有消息数量:%s"%q.qsize())try:

q.put_nowait("消息4")except:

print("消息列队已满,现有消息数量:%s"%q.qsize())#推荐的方式,先判断消息列队是否已满,再写入if not q.full():

q.put_nowait("消息4")#读取消息时,先判断消息列队是否为空,再读取if not q.empty():

for i in range(q.qsize()):

print(q.get_nowait())运行结果:

FalseTrue消息列队已满,现有消息数量:3消息列队已满,现有消息数量:3消息1消息2消息3

我们以Queue为例,在父进程中创建两个子进程,一个往Queue里写数据,一个从Queue里读数据:

from multiprocessing import Process, Queueimport os, time, random# 写数据进程执行的代码:def write(q):

for value in ['A', 'B', 'C']:

print('Put %s to queue...' % value)

q.put(value)

time.sleep(random.random())# 读数据进程执行的代码:def read(q):

while True:

if not q.empty():

value = q.get(True)

print('Get %s from queue.' % value)

time.sleep(random.random())

else:

breakif __name__=='__main__':

# 父进程创建Queue,并传给各个子进程:

q = Queue()

pw = Process(target=write, args=(q,))

pr = Process(target=read, args=(q,))

# 启动子进程pw,写入:

pw.start()

# 等待pw结束:

pw.join()

# 启动子进程pr,读取:

pr.start()

pr.join()

# pr进程里是死循环,无法等待其结束,只能强行终止:

print('')

print('所有数据都写入并且读完')运行结果:

锁是为了确保数据一致性。比如读写锁,每个进程给一个变量增加 1,但是如果在一个进程读取但还没有写入的时候,另外的进程也同时读取了,并写入该值,则最后写入的值是错误的,这时候就需要加锁来保持数据一致性。

通过使用Lock来控制一段代码在同一时间只能被一个进程执行。Lock对象的两个方法,acquire()用来获取锁,release()用来释放锁。当一个进程调用acquire()时,如果锁的状态为unlocked,那么会立即修改为locked并返回,这时该进程即获得了锁。如果锁的状态为locked,那么调用acquire()的进程则阻塞。

1. Lock的语法说明:

lock = multiprocessing.Lock(): 创建一个锁

lock.acquire() :获取锁

lock.release() :释放锁

with lock:自动获取、释放锁 类似于 with open() as f:

2. 程序不加锁时:

import multiprocessingimport timedef add(num, value):

print('add{0}:num={1}'.format(value, num))

for i in range(0, 2):

num += value print('add{0}:num={1}'.format(value, num))

time.sleep(1)if __name__ == '__main__':

lock = multiprocessing.Lock()

num = 0

p1 = multiprocessing.Process(target=add, args=(num, 1))

p2 = multiprocessing.Process(target=add, args=(num, 2))

p1.start()

p2.start()运行结果:运得没有顺序,两个进程交替运行

add1:num=0add1:num=1add2:num=0add2:num=2add1:num=2add2:num=4

3. 程序加锁时:

import multiprocessingimport timedef add(num, value, lock):

try:

lock.acquire()

print('add{0}:num={1}'.format(value, num))

for i in range(0, 2):

num += value print('add{0}:num={1}'.format(value, num))

time.sleep(1)

except Exception as err:

raise err finally:

lock.release()if __name__ == '__main__':

lock = multiprocessing.Lock()

num = 0

p1 = multiprocessing.Process(target=add, args=(num, 1, lock))

p2 = multiprocessing.Process(target=add, args=(num, 2, lock))

p1.start()

p2.start()运行结果:只有当其中一个进程执行完成后,其它的进程才会去执行,且谁先抢到锁谁先执行

add1:num=0add1:num=1add1:num=2add2:num=0add2:num=2add2:num=4

当需要创建的子进程数量不多时,可以直接利用

multiprocessing中的Process动态成生多个进程,但如果是上百甚至上千个目标,手动的去创建进程的工作量巨大,此时就可以用到multiprocessing模块提供的Pool方法。

语法格式:multiprocessing.pool.Pool([processes[, initializer[, initargs[, maxtasksperchild[, context]]]]])

参数说明:

processes:工作进程数目,如果 processes 为 None,则使用 os.cpu_count() 返回的值。

initializer:如果 initializer 不为 None,则每个工作进程将会在启动时调用 initializer(*initargs)。

maxtasksperchild:一个工作进程在它退出或被一个新的工作进程代替之前能完成的任务数量,为了释放未使用的资源。

context:用于指定启动的工作进程的上下文。

两种方式向进程池提交任务:

apply(func[, args[, kwds]]):阻塞方式。

apply_async(func[, args[, kwds]]):非阻塞方式。使用非阻塞方式调用func(并行执行,堵塞方式必须等待上一个进程退出才能执行下一个进程),args为传递给func的参数列表,kwds为传递给func的关键字参数列表

multiprocessing.Pool常用函数:

| 方法名 | 说明 |

|---|---|

close() |

关闭Pool,使其不再接受新的任务 |

terminate() |

不管任务是否完成,立即终止 |

join() |

主进程阻塞,等待子进程的退出, 必须在close或terminate之后使用 |

初始化Pool时,可以指定一个最大进程数,当有新的请求提交到Pool中时,如果池还没有满,那么就会创建一个新的进程用来执行该请求;但如果池中的进程数已经达到指定的最大值,那么该请求就会等待,直到池中有进程结束,才会用之前的进程来执行新的任务,请看下面的实例:

# -*- coding:utf-8 -*-from multiprocessing import Poolimport os, time, randomdef worker(msg):

t_start = time.time()

print("%s开始执行,进程号为%d" % (msg,os.getpid()))

# random.random()随机生成0~1之间的浮点数

time.sleep(random.random()*2)

t_stop = time.time()

print(msg,"执行完毕,耗时%0.2f" % (t_stop-t_start))po = Pool(3) # 定义一个进程池,最大进程数3for i in range(0,10):

# Pool().apply_async(要调用的目标,(传递给目标的参数元祖,))

# 每次循环将会用空闲出来的子进程去调用目标

po.apply_async(worker,(i,))print("----start----")po.close()

# 关闭进程池,关闭后po不再接收新的请求po.join()

# 等待po中所有子进程执行完成,必须放在close语句之后print("-----end-----")运行结果:

----start---- 0开始执行,进程号为21466 1开始执行,进程号为21468 2开始执行,进程号为21467 0 执行完毕,耗时1.01 3开始执行,进程号为21466 2 执行完毕,耗时1.24 4开始执行,进程号为21467 3 执行完毕,耗时0.56 5开始执行,进程号为21466 1 执行完毕,耗时1.68 6开始执行,进程号为21468 4 执行完毕,耗时0.67 7开始执行,进程号为21467 5 执行完毕,耗时0.83 8开始执行,进程号为21466 6 执行完毕,耗时0.75 9开始执行,进程号为21468 7 执行完毕,耗时1.03 8 执行完毕,耗时1.05 9 执行完毕,耗时1.69 -----end-----

如果要使用Pool创建进程,就需要使用multiprocessing.Manager()中的Queue()

而不是multiprocessing.Queue(),否则会得到一条如下的错误信息:RuntimeError: Queue objects should only be shared between processes through inheritance.

下面的实例演示了进程池中的进程如何通信:

# -*- coding:utf-8 -*-# 修改import中的Queue为Managerfrom multiprocessing import Manager,Poolimport os,time,randomdef reader(q):

print("reader启动(%s),父进程为(%s)" % (os.getpid(), os.getppid()))

for i in range(q.qsize()):

print("reader从Queue获取到消息:%s" % q.get(True))def writer(q):

print("writer启动(%s),父进程为(%s)" % (os.getpid(), os.getppid()))

for i in "itcast":

q.put(i)if __name__=="__main__":

print("(%s) start" % os.getpid())

q = Manager().Queue() # 使用Manager中的Queue

po = Pool()

po.apply_async(writer, (q,))

time.sleep(1) # 先让上面的任务向Queue存入数据,然后再让下面的任务开始从中取数据

po.apply_async(reader, (q,))

po.close()

po.join()

print("(%s) End" % os.getpid())运行结果:

(11095) start writer启动(11097),父进程为(11095)reader启动(11098),父进程为(11095)reader从Queue获取到消息:i reader从Queue获取到消息:t reader从Queue获取到消息:c reader从Queue获取到消息:a reader从Queue获取到消息:s reader从Queue获取到消息:t(11095) End

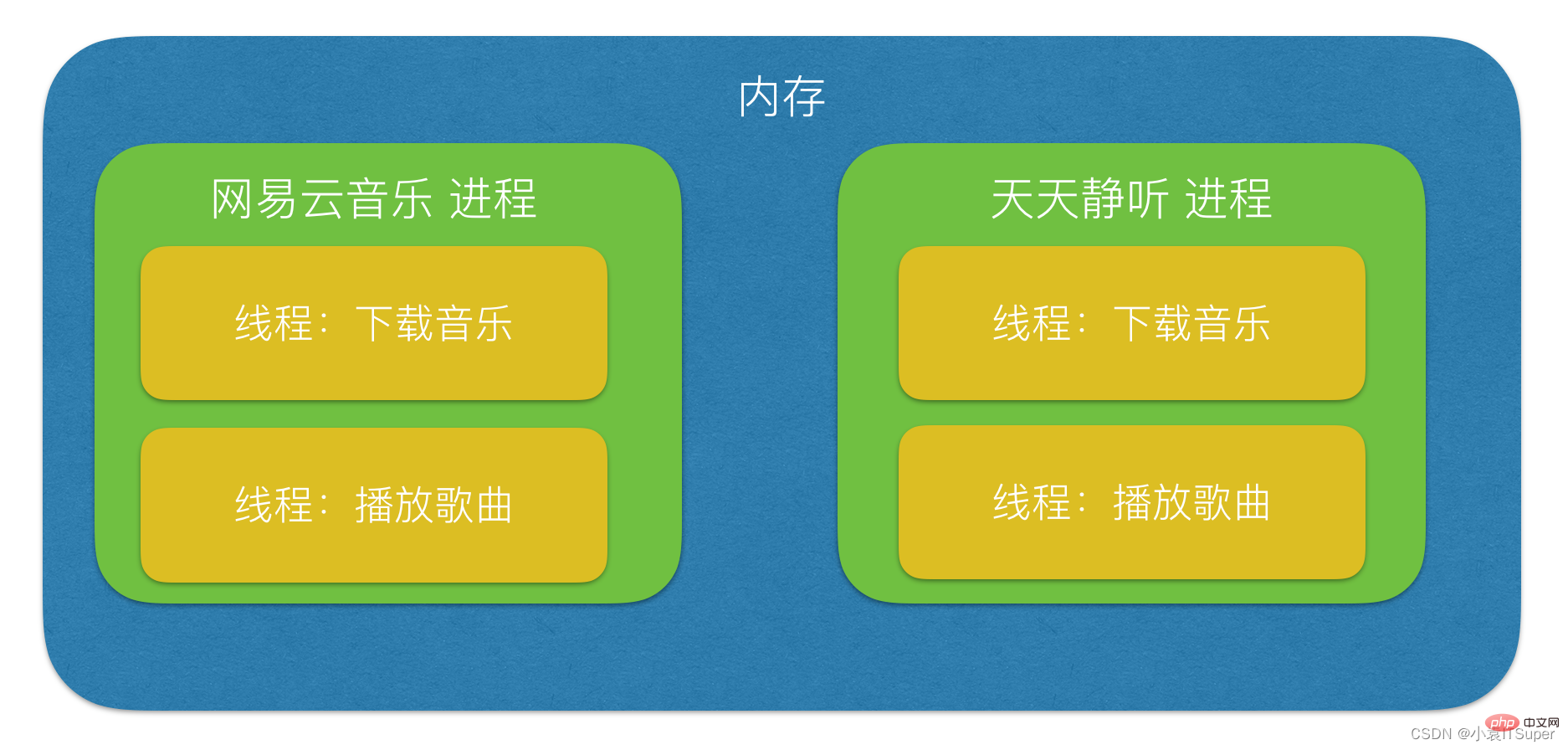

进程:能够完成多任务,比如 在一台电脑上能够同时运行多个QQ

线程:能够完成多任务,比如 一个QQ中的多个聊天窗口

定义的不同

进程是系统进行资源分配和调度的一个独立单位.

线程是进程的一个实体,是CPU调度和分派的基本单位,它是比进程更小的能独立运行的基本单位.线程自己基本上不拥有系统资源,只拥有一点在运行中必不可少的资源(如程序计数器,一组寄存器和栈),但是它可与同属一个进程的其他的线程共享进程所拥有的全部资源.

推荐学习:python视频教程

以上是Python多進程知識點總結的詳細內容。更多資訊請關注PHP中文網其他相關文章!