中國人工智能正在取得很大的進步,具有挑戰性的領先模型,例如GPT-4,Claude和Grok,具有具有成本效益的開源替代方案,例如DeepSeek-V3和Qwen 2.5。 這些模型由於其效率,可及性和強大的性能而出色。 許多人在允許的商業許可下運營,擴大對開發商和企業的吸引力。

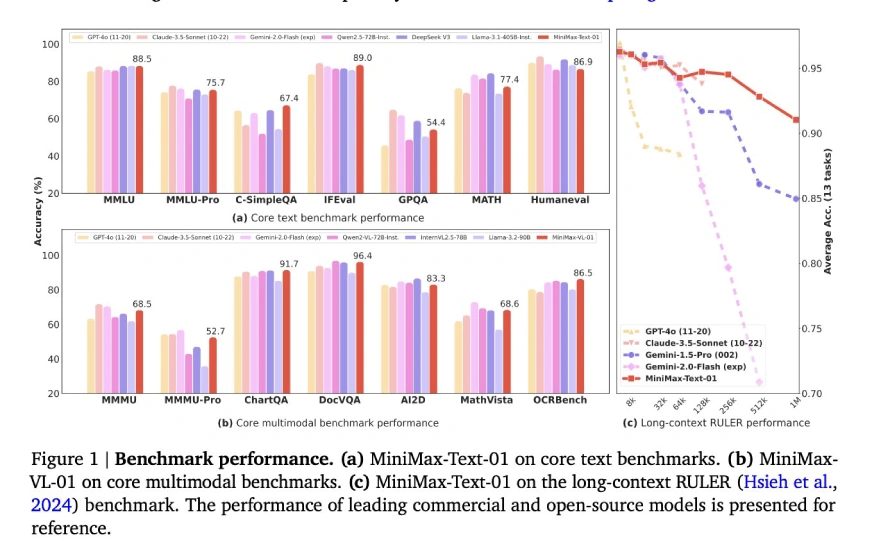

該組的最新成員Minimax-Text-01以其前所未有的400萬令牌上下文長度設置了一個新標準,該標準的長度超過了典型的128K-256K令牌限制。這種擴展的上下文能力,結合了效率的混合注意體系結構和開源,商業允許的許可,促進了創新而無需高昂的成本。

>

>讓我們深入研究minimax-text-01的功能:

>

目錄的>

>混合體系結構

Experts(MOE)策略的混合物

訓練和縮放策略

- >訓練後優化

- 關鍵創新

- 核心學術基準

- 一般任務基準

- 推理任務基準

- 數學和編碼任務基準

-

- >開始使用minimax-text-01

- 重要鏈接

結論

-

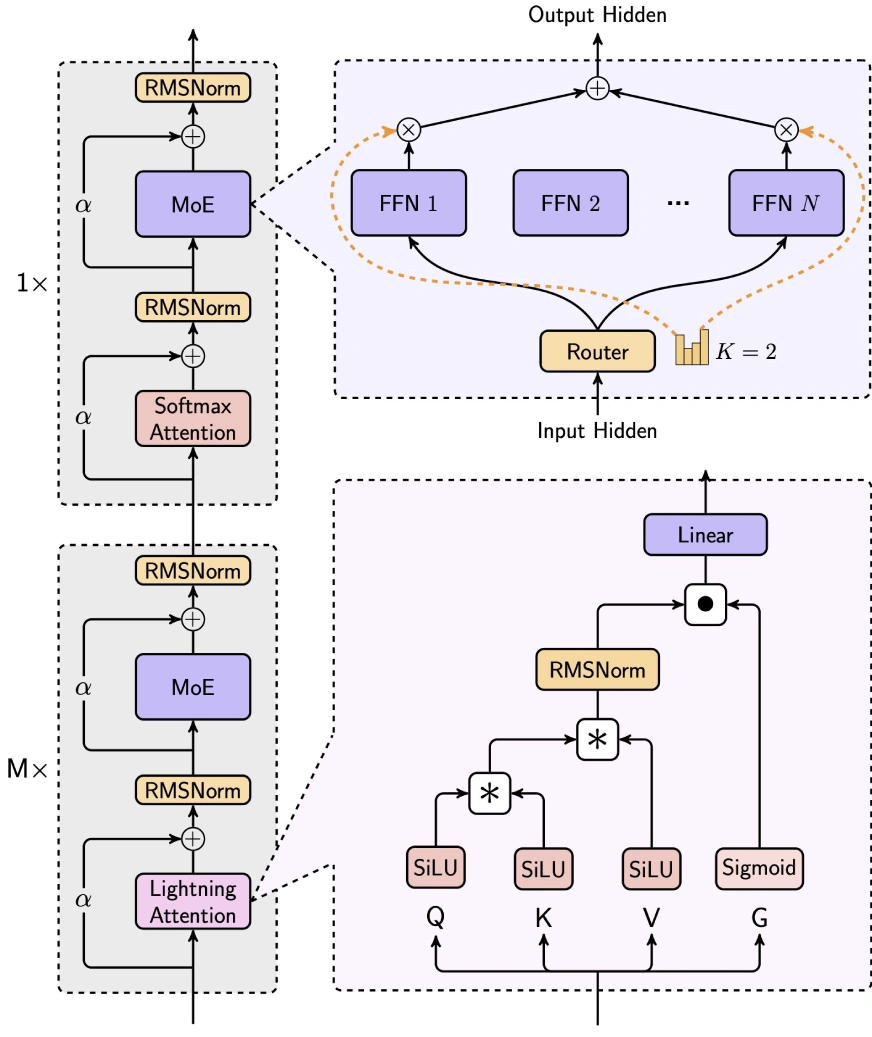

>混合體系結構-

> minimax-text-01通過整合閃電的注意力,軟效果的注意力和雜物(MOE)來巧妙地平衡效率和性能。 - >

7/8線性注意力(Lightning Coative-2):>這種線性注意機制大大降低了從O(N²D)到O(D²N)的計算複雜性,非常適合長篇文化處理。 它使用SILU激活進行輸入轉換,注意計算的矩陣操作以及rmsnorm和Sigmoid用於歸一化和縮放。

1/8 softmax的注意:傳統的注意機制,將繩索(旋轉位置嵌入)納入一半的注意力頭尺寸,從而無需犧牲表現就可以推斷長度。

1/8 softmax的注意:傳統的注意機制,將繩索(旋轉位置嵌入)納入一半的注意力頭尺寸,從而無需犧牲表現就可以推斷長度。

Experts(MOE)策略的混合物

- > minimax-text-01的獨特MOE架構將其與諸如DeepSeek-V3:之類的模型區分開

-

與DeepSeek的無滴方法不同,-

使用輔助損失來維持跨專家的平衡令牌分配。

-

>全局路由器:優化令牌分配,以在專家組之間進行工作負載分配。

- top-k路由:>選擇每個令牌的top-2專家(與DeepSeek的Top-8 1共享專家相比)。

專家配置:- 使用32位專家(與DeepSeek的256 1共享),專家隱藏的維度為9216(vs. DeepSeek的2048)。 每層的總激活參數與DeepSeek(18,432)相同。

訓練和縮放策略

培訓基礎設施:使用了大約2000 h100 gpus,採用了高級並行性技術,例如專家張量並行性(ETP)和線性注意序列序列並行性和平行性(LASP)。 針對8位量化進行了優化,以在8x80GB H100節點上有效推斷。

-

培訓數據:使用WSD樣學習率計劃進行了大約12萬億代幣培訓。 該數據包括高質量和低質量來源的混合物,以及全局重複數據刪除和4倍重複的高質量數據。

-

>長篇下說訓練:一種三個基礎的方法:階段1(128K上下文),第2階段(512k上下文)和第3階段(1M上下文),使用線性插值來管理上下文長度縮放期間的分佈變化。

> - >

>訓練後優化

迭代微調:使用脫機DPO和在線grpo進行對齊的監督微調(SFT)和強化學習(RL)的周期。 >

-

長篇小說微調:

一個分階段的方法:短篇小寫SFT→長篇小寫SFT→短篇小寫→短上下文rl→長上下文RL,對於上下文的長篇小說性能至關重要。

-

關鍵創新

deepnorm:

> 一種後構體結構增強了剩餘連接縮放和訓練穩定性。 -

批次尺寸熱身:

逐漸將批次尺寸從16m增加到128m令牌,以進行最佳訓練動力學。 -

有效的並行性:

利用環的注意來最大程度地減少長序列和填充優化的內存開銷,以減少浪費的計算。

-

核心學術基準

(此處包括用於一般任務,推理任務和數學和編碼任務的基準結果的表,此處包括原始輸入表。)

(其他評估參數鏈接保留)

>開始使用minimax-text-01

(用於使用擁抱臉部變壓器的minimax-text-01的代碼示例保持不變。)

重要鏈接

聊天機器人

> minimax-Text-01表現出令人印象深刻的功能,在長期和通用任務中實現了最先進的表現。儘管存在改進領域,但其開源性質,成本效益和創新的建築使其成為AI領域的重要參與者。 它特別適用於記憶密集型和復雜的推理應用,儘管編碼任務的進一步完善可能是有益的。

以上是4M令牌? Minimax-Text-01優於DeepSeek V3的詳細內容。更多資訊請關注PHP中文網其他相關文章!

1/8 softmax的注意:

1/8 softmax的注意: