AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com

本研究评估了先进多模态基础模型在 10 个数据集上的多样本上下文学习,揭示了持续的性能提升。批量查询显著降低了每个示例的延迟和推理成本而不牺牲性能。这些发现表明:利用大量演示示例可以快速适应新任务和新领域,而无需传统的微调。

- 论文地址:https://arxiv.org/abs/2405.09798

- 代码地址:https://github.com/stanfordmlgroup/ManyICL

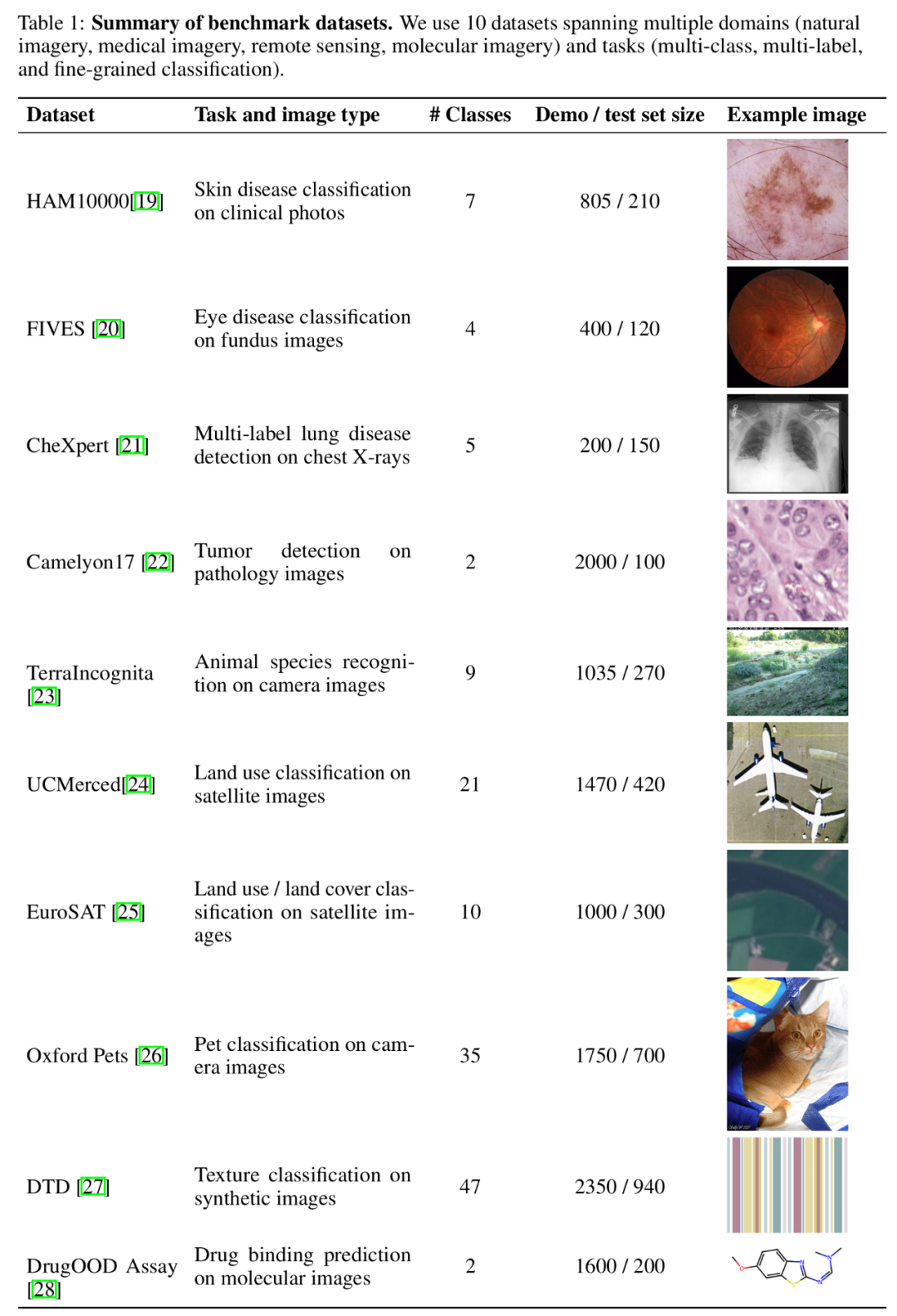

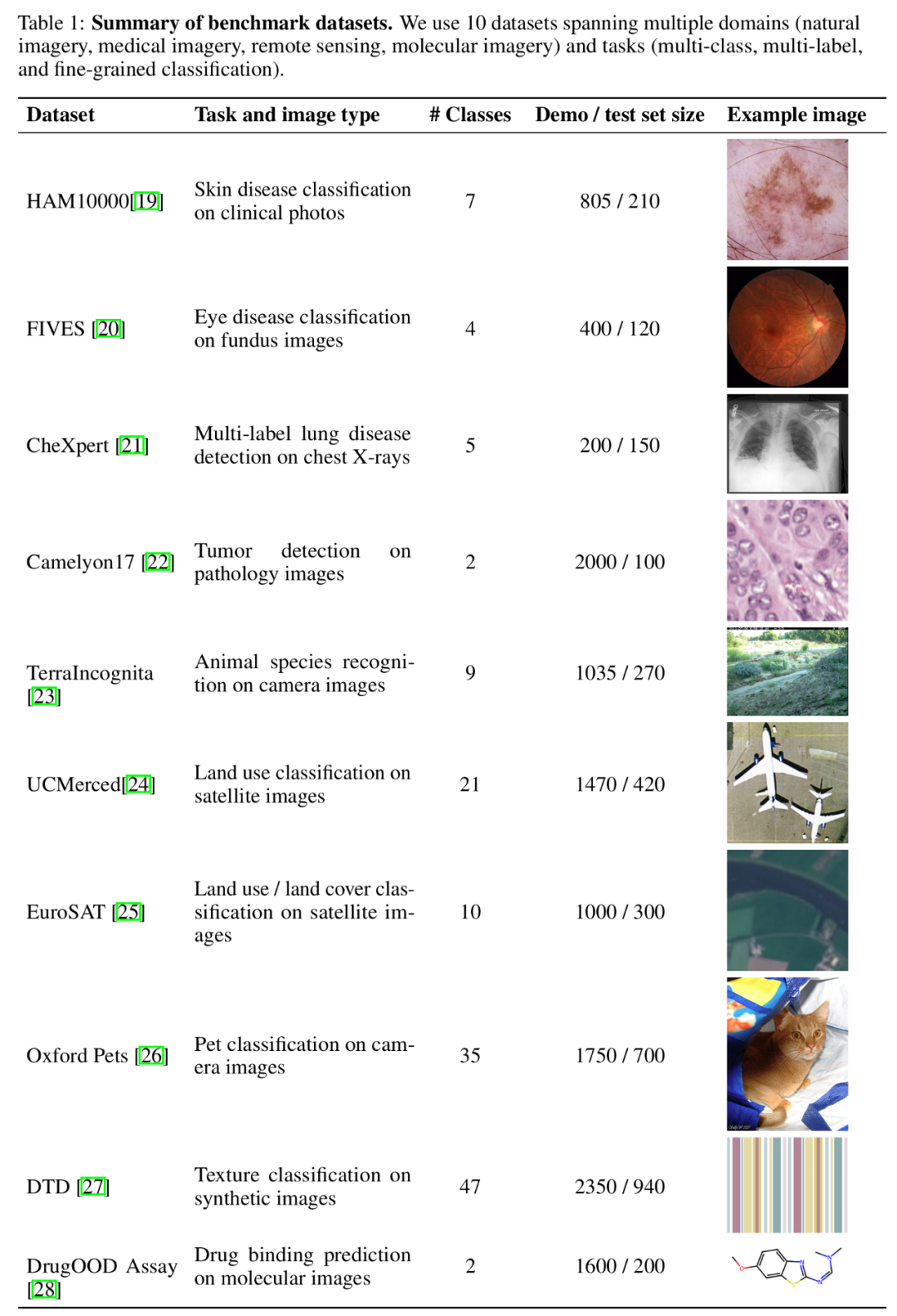

在近期的多模态基础模型(Multimodal Foundation Model)研究中,上下文学习(In-Context Learning, ICL)已被证明是提高模型性能的有效方法之一。然而,受限于基础模型的上下文长度,尤其是对于需要大量视觉 token 来表示图片的多模态基础模型,已有的相关研究只局限于在上下文中提供少量样本。令人激动的是,最新的技术进步大大增加了模型的上下文长度,这为探索使用更多示例进行上下文学习提供了可能性。基于此,斯坦福吴恩达团队的最新研究——ManyICL,主要评估了目前最先进的多模态基础模型在从少样本 (少于 100) 到多样本(最高至 2000)上下文学习中的表现。通过对多个领域和任务的数据集进行测试,团队验证了多样本上下文学习在提高模型性能方面的显著效果,并探讨了批量查询对性能和成本及延迟的影响。 Many-shot ICL与零样本、少样本ICL的比较。本研究选择了三种先进的多模态基础模型:GPT-4o、GPT4 (V)-Turbo 和 Gemini 1.5 Pro。出于 GPT-4o 优越的表现,研究团队在正文中着重讨论 GPT-4o 和 Gemini 1.5 Pro, GPT4 (V)-Turbo 的相关内容请于附录中查看。数据集方面,研究团队在 10 个跨越不同领域(包括自然影像、医学影像、遥感影像和分子影像等)和任务(包括多分类、多标签分类和细粒度分类)的数据集上进行了广泛的实验。

基准数据集汇总。

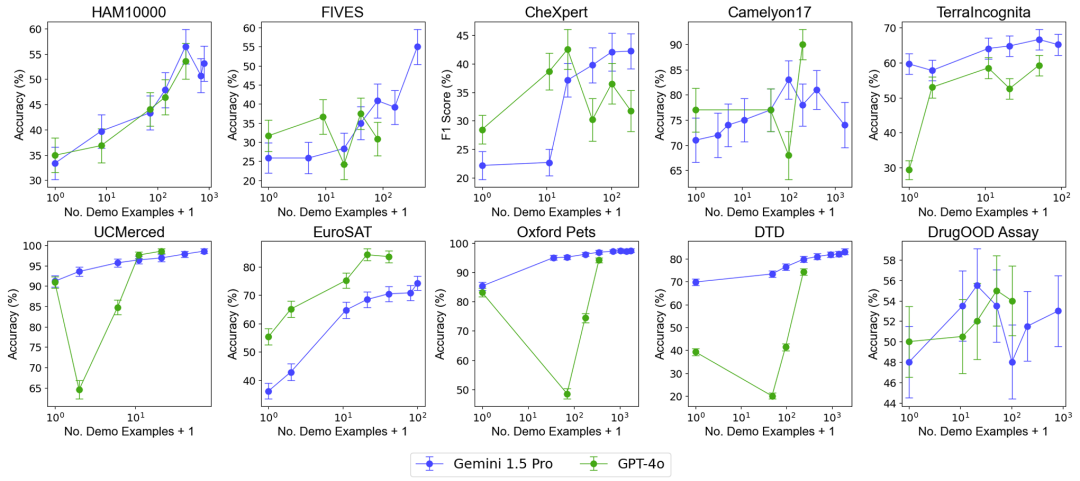

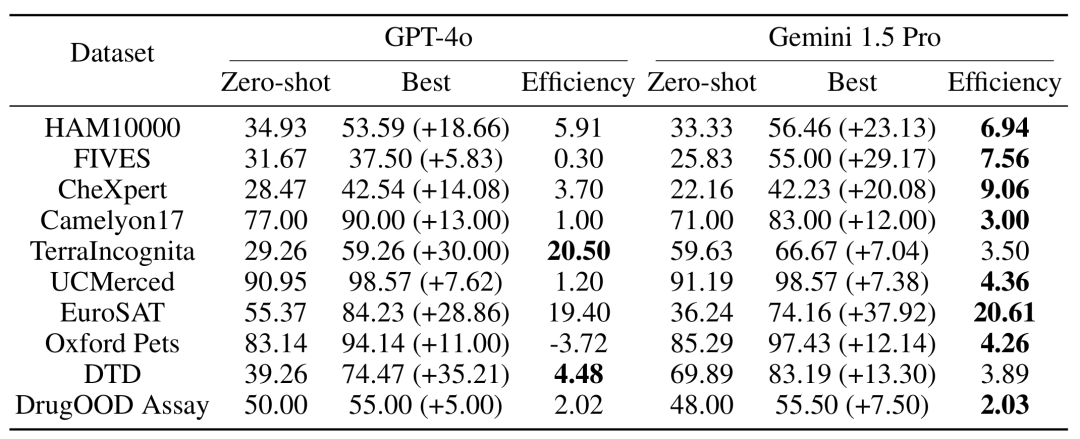

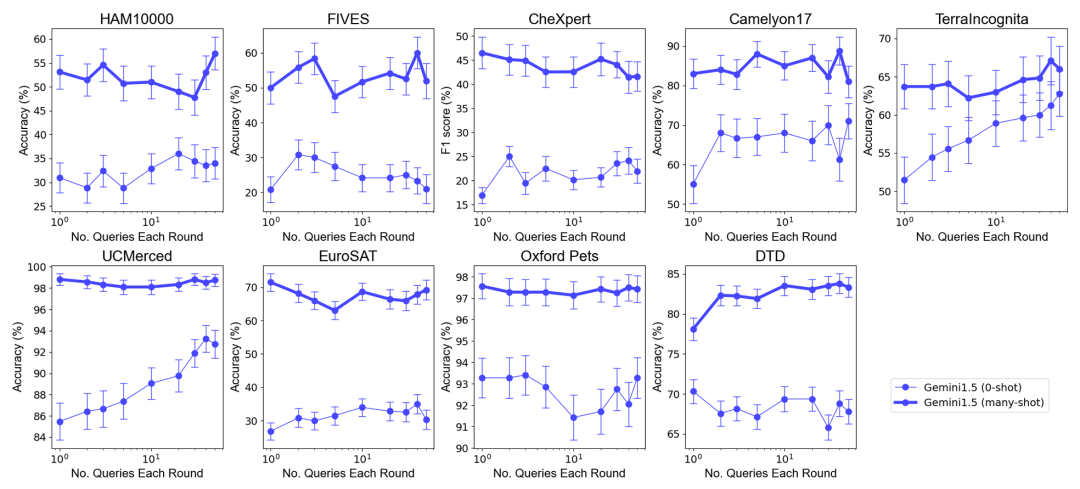

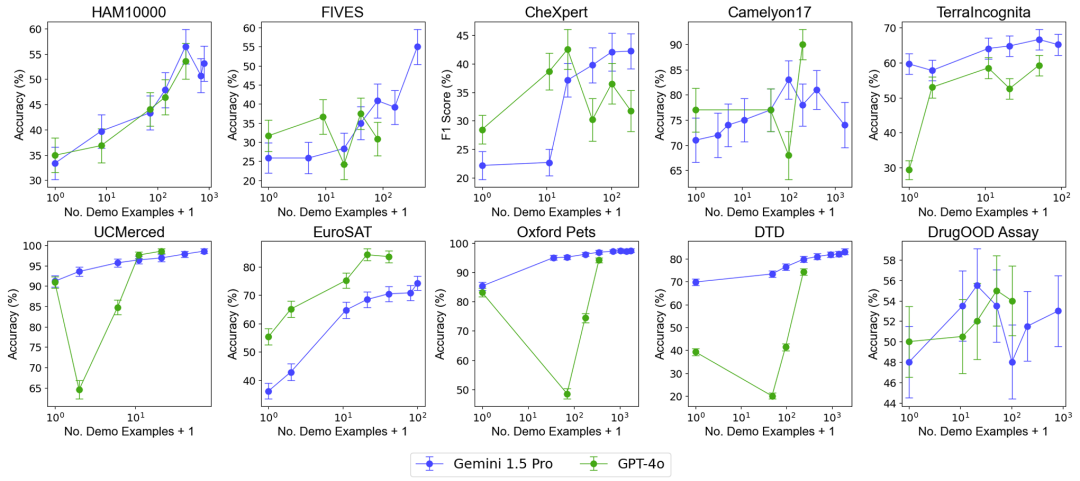

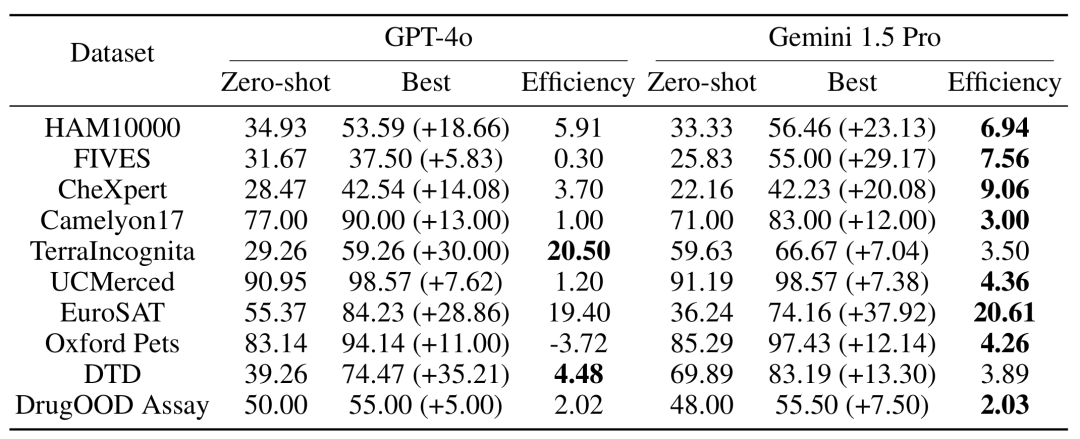

為了測試增加範例數量對模型效能的影響,研究團隊逐步增加了上下文中提供的範例數量,最高達到近 2000 個範例。同時,考慮到多樣本學習的高成本和高延遲,研究團隊也探索了批量處理查詢的影響。在這裡,批次查詢指的是在單次 API 呼叫中處理多個查詢。 整體表現:包含近2000 個範例的多樣本情境學習在所有資料集上均優於少樣本學習。隨著範例數量的增加,Gemini 1.5 Pro 模型的效能呈現持續的對數線性提升,而 GPT-4o 的表現較不穩定。

資料效率:研究測量了模型的上下文學習資料效率,即模型從範例中學習的速度。結果表明,Gemini 1.5 Pro 在絕大部分資料集上顯示出比 GPT-4o 更高的上下文學習資料效率,這意味著它能夠更有效地從範例中學習。

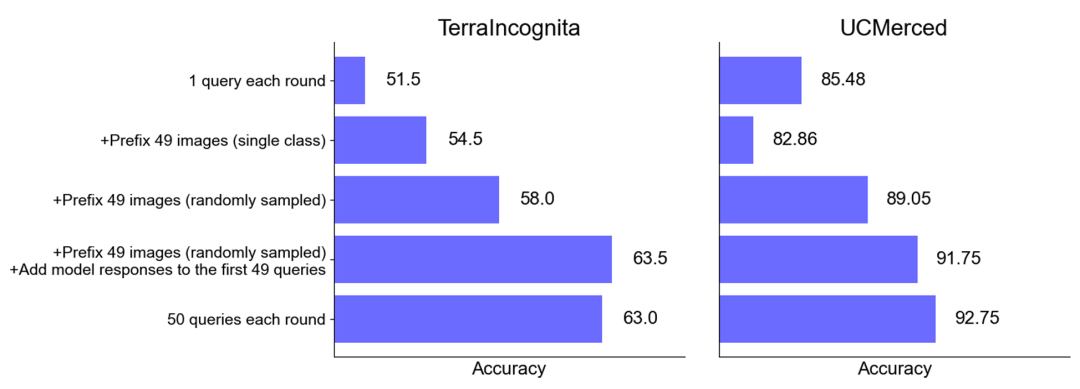

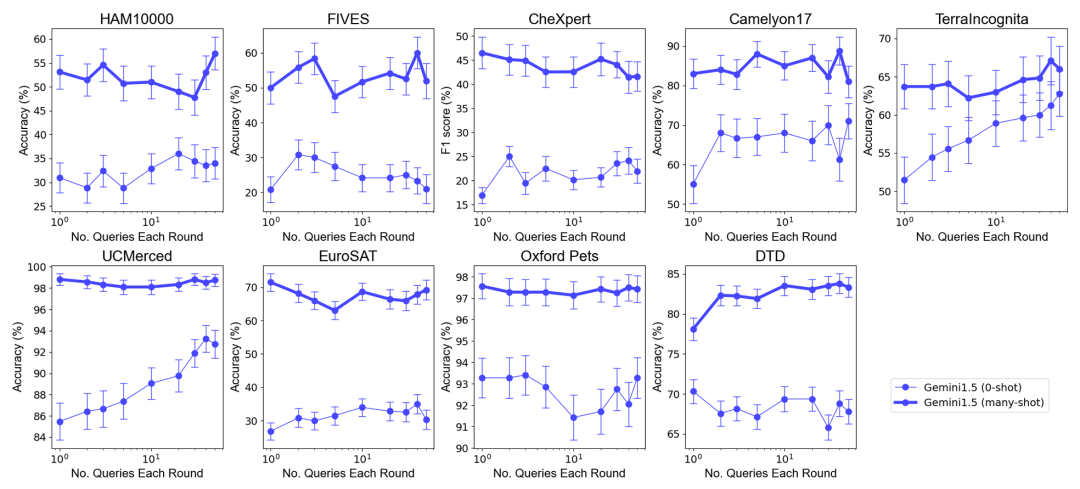

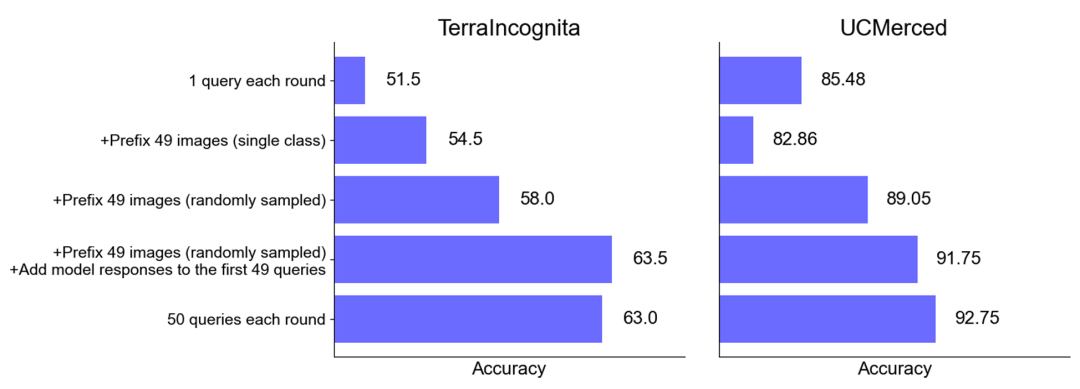

總體表現:在選擇最優範例集大小下的零樣本和多樣本情境中,將多個查詢合併為一次請求,不會降低效能。值得注意的是,在零樣本場景中,單一查詢在許多資料集上表現較差。相比之下,批量查詢甚至可以提高效能。

零樣本場景下的效能提升:對於某些資料集(如UCMerced),批次查詢在零樣本場景下顯著提高了效能。研究團隊分析認為,這主要歸因於領域校準 (domain calibration)、類別校準 (class calibration) 以及自我學習 (self-ICL)。

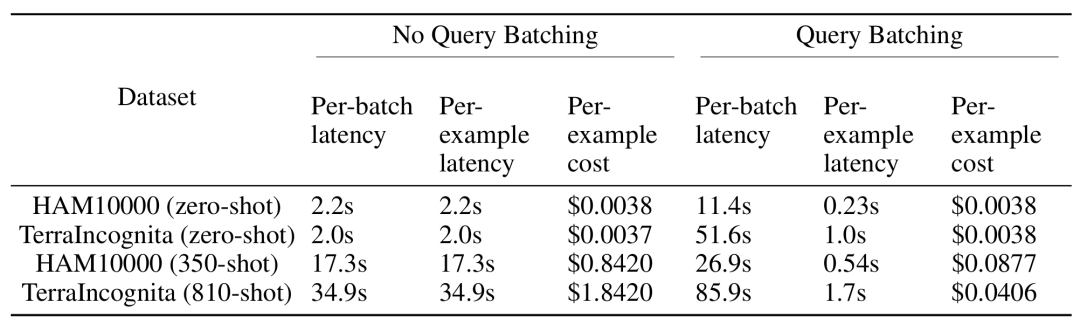

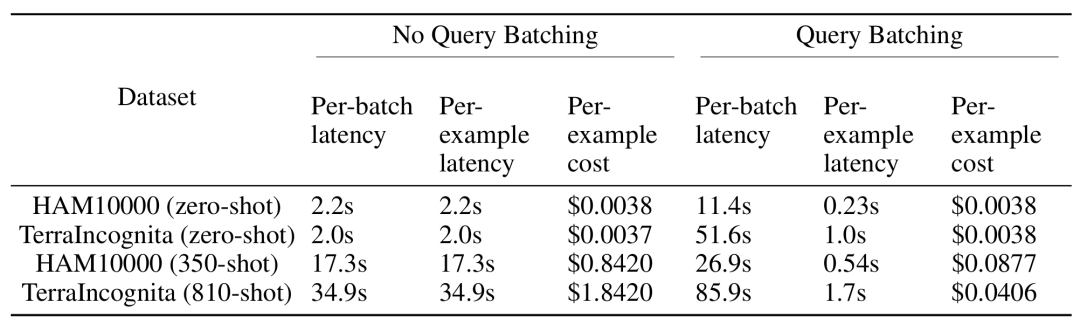

#多樣本上下文學習雖然在推理時需要處理更長的輸入上下文,但透過批次查詢可以顯著降低每個範例的延遲和推理成本。例如,在 HAM10000 資料集中,使用 Gemini 1.5 Pro 模型進行 350 個範例的批次查詢,延遲從 17.3 秒降至 0.54 秒,成本從每個範例 0.842 美元降至 0.0877 美元。

#研究結果表明,多樣本上下文學習能夠顯著提高多模態基礎模型的表現,尤其是Gemini 1.5 Pro 模型在多個資料集上表現出持續的效能提升,使其能夠更有效地適應新任務和新領域,而無需傳統的微調。 其次,批次處理查詢可以在相似甚至更好的模型表現的同時,降低推理成本和延遲,顯示出在實際應用中的巨大潛力。 總的來說,吳恩達團隊的研究為多模態基礎模型的應用開闢了新的路徑,特別是在快速適應新任務和領域方面。

以上是吳恩達團隊新作:多模態多樣本情境學習,無需微調快速適應新任務的詳細內容。更多資訊請關注PHP中文網其他相關文章!