Pada 7 April, Alibaba Cloud memberitahu Qianwen tentang model parameter 32 bilion sumber terbuka Qwen1.5-32B, yang boleh memaksimumkan keseimbangan prestasi, kecekapan dan penggunaan memori, memberikan perusahaan dan pembangun pilihan model yang lebih menjimatkan kos. Pada masa ini, Pemberitahuan Qianwen telah menggunakan sumber terbuka sejumlah 6 model bahasa yang besar, dan muat turun terkumpul dalam komuniti sumber terbuka di dalam dan luar negara telah melebihi 3 juta.

Soalan Am Qianwen sebelum ini telah membangunkan 500 juta, 1.8 bilion, 4 bilion, 7 bilion, 14 bilion dan 72 bilion model parameter, dan semuanya telah dinaik taraf kepada versi 1.5. Antaranya, beberapa model bersaiz kecil boleh digunakan dengan mudah pada bahagian peranti, dan model parameter 72 bilion mempunyai prestasi terkemuka industri dan telah disenaraikan pada HuggingFace dan senarai model lain berkali-kali. Model parameter 32 bilion sumber terbuka akan mencapai keseimbangan yang lebih ideal antara prestasi, kecekapan dan penggunaan memori. Sebagai contoh, berbanding model 14B, 32B mempunyai keupayaan yang lebih kukuh dalam senario ejen berbanding 72B, 32B mempunyai kos penaakulan yang lebih rendah. Pasukan masalah umum berharap model sumber terbuka 32B dapat memberikan penyelesaian yang lebih baik untuk aplikasi hiliran.

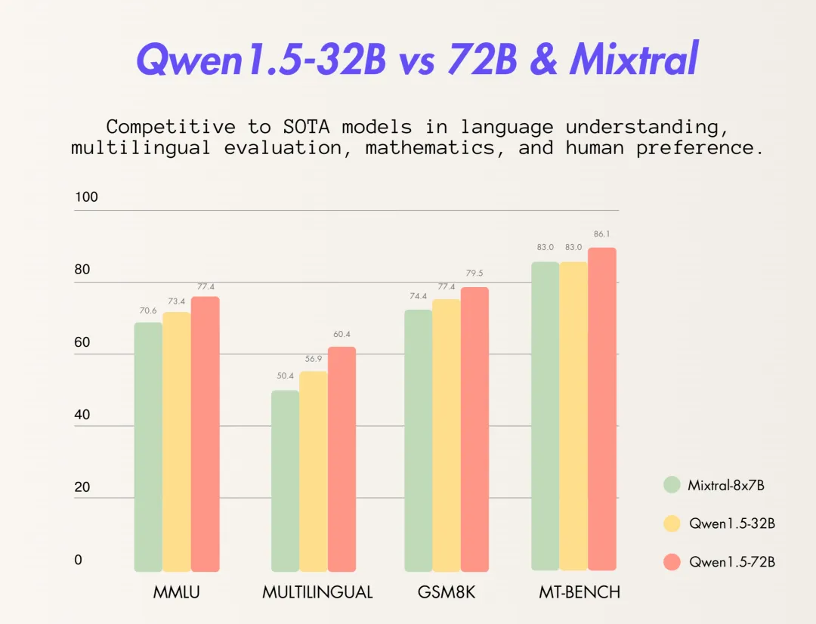

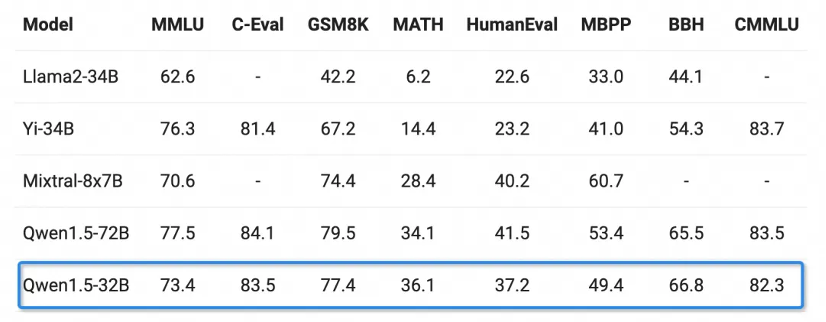

Dari segi keupayaan asas, model parameter Qianwen 32 bilion telah menunjukkan prestasi yang baik dalam berbilang ujian seperti MMLU, GSM8K, HumanEval, BBH, dll. Prestasinya hampir dengan model parameter Qianwen 72 bilion, jauh melebihi prestasinya 30 bilion model parameter.

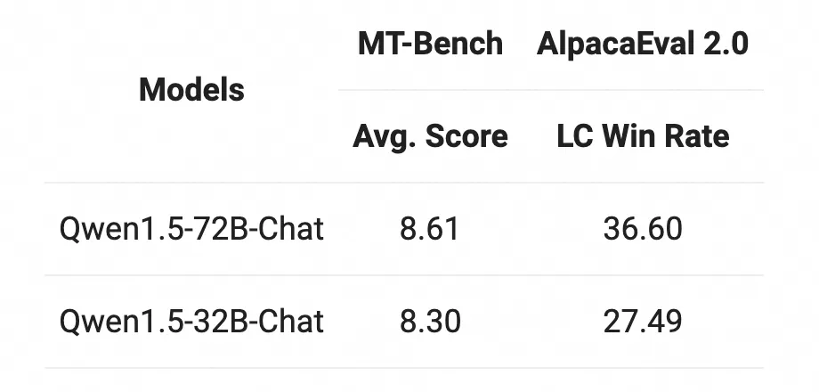

Bagi model Chat, model Qwen1.5-32B-Chat memperoleh lebih daripada 8 mata dalam penilaian MT-Bench, dan jurang dengan Qwen1.5-72B-Chat agak kecil.

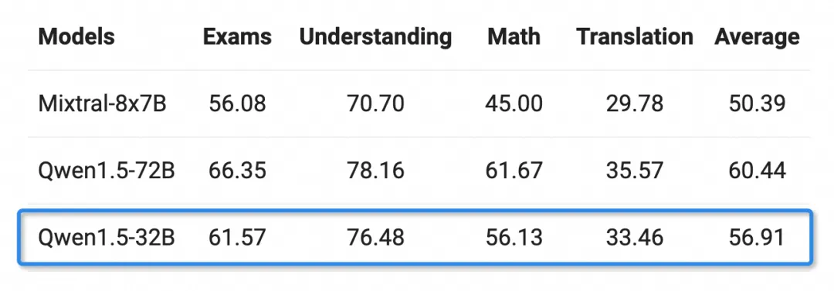

Orang yang mempunyai kemahiran bahasa yang kaya boleh melakukannya dalam pelbagai bidang seperti peperiksaan, pemahaman, matematik dan terjemahan selepas memilih 12 bahasa termasuk bahasa Arab, Sepanyol, Perancis, Jepun, Korea, dll. dinilai. Keupayaan berbilang bahasa Qwen1.5-32B adalah terhad kepada model parameter umum Qwen 72 bilion.

Atas ialah kandungan terperinci Tongyi Qianwen mempunyai 32 bilion model parameter sumber terbuka, dan telah merealisasikan kesemua 7 model bahasa utama sebagai sumber terbuka.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!