Beberapa masa lalu, bidang model besar sumber terbuka telah memperkenalkan model baharu - "Yi" dengan saiz tetingkap konteks melebihi 200k dan mampu memproses 400,000 aksara Cina pada satu masa.

Pengerusi dan Ketua Pegawai Eksekutif Kerja Inovasi Kai-Fu Lee mengasaskan syarikat model besar "Zero One Everything" dan membina model besar ini, yang merangkumi dua versi Yi-6B dan Yi-34B

Menurut Bahasa Inggeris Hugging Face platform komuniti sumber terbuka dan senarai penilaian Cina C-Eval, Yi-34B mencapai beberapa pengiktirafan penunjuk prestasi terbaik antarabangsa SOTA apabila ia dilancarkan, menjadi "juara berganda" model besar sumber terbuka global, mengalahkan produk pesaing sumber terbuka seperti LLaMA2 dan Falcon.

Yi-34B juga menjadi satu-satunya model domestik yang berjaya mendahului kedudukan model sumber terbuka global Hugging Face pada masa itu, dan digelar "model sumber terbuka terkuat di dunia".

Selepas dikeluarkan, model ini menarik perhatian ramai penyelidik dan pemaju dalam dan luar negara

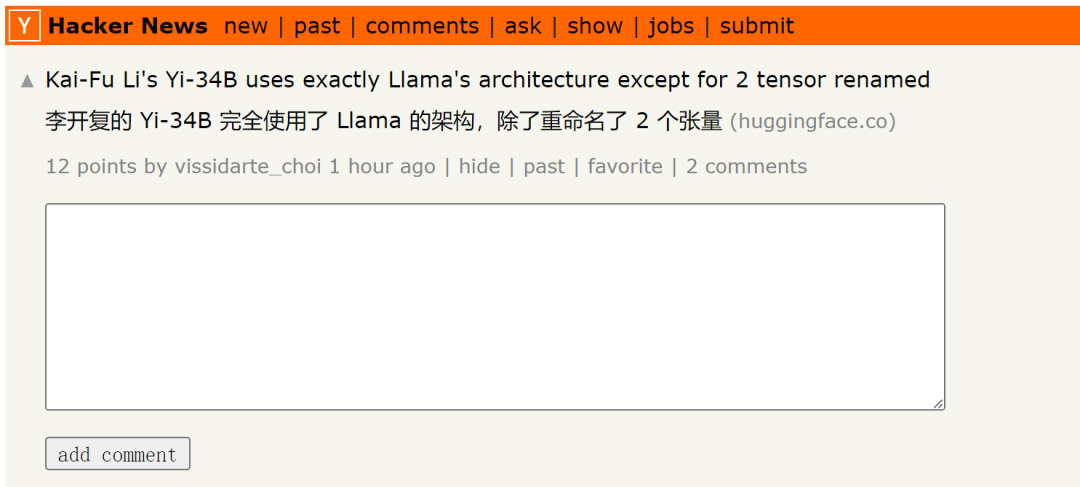

Tetapi baru-baru ini, beberapa penyelidik mendapati bahawa model Yi-34B pada asasnya menggunakan seni bina LLaMA, tetapi baru dinamakan Dua tensor.

Sila klik pautan ini untuk melihat siaran asal: https://news.ycombinator.com/item?id=38258015

Siaran itu juga menyebut:

Kod Yi-4Bsebenarnya Ia adalah pemfaktoran semula kod LLaMA, tetapi nampaknya tidak membuat sebarang perubahan yang ketara. Model ini jelas merupakan pengeditan berdasarkan fail Apache versi 2.0 LLaMA asal, tetapi tidak menyebut tentang LLaMA:

Yi vs LLaMA perbandingan kod. Pautan kod: https://www.diffchecker.com/bJTqkvmQ/

Selain itu, perubahan kod ini tidak diserahkan kepada projek transformer melalui Pull Request, tetapi dilampirkan dalam bentuk kod luaran Mei ini menjadi risiko keselamatan atau tidak disokong oleh rangka kerja. Papan pendahulu HuggingFace tidak akan menanda aras model ini dengan tetingkap konteks sehingga 200K kerana ia tidak mempunyai strategi kod tersuai.

Mereka mendakwa ini adalah model 32K, tetapi ia dikonfigurasikan sebagai model 4K, tiada konfigurasi penskalaan RoPE, dan tiada penjelasan tentang cara menskala (Nota: Zero One Thousand Things sebelum ini menyatakan bahawa model itu sendiri adalah dilatih pada urutan 4K, tetapi dalam inferens Peringkat boleh dilanjutkan kepada 32K). Pada masa ini, tiada maklumat mengenai data penalaan halusnya. Mereka juga tidak memberikan arahan untuk menghasilkan semula penanda aras mereka, termasuk skor MMLU yang mencurigakan.

Sesiapa yang telah bekerja dalam bidang kecerdasan buatan untuk seketika tidak akan buta tentang perkara ini. Adakah ini pengiklanan palsu? Pelanggaran lesen? Adakah ia sebenarnya menipu pada penanda aras? Siapa peduli? Kita boleh menukar kertas, atau dalam kes ini, mengambil semua wang modal teroka. Sekurang-kurangnya Yi berada di atas standard, kerana ia adalah model asas, dan prestasinya sangat bagus

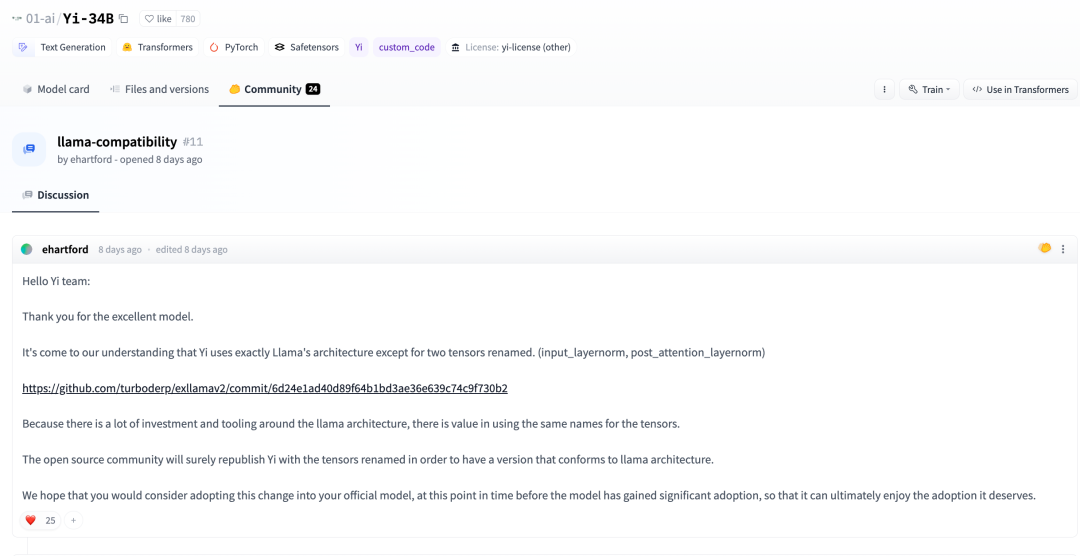

Beberapa hari yang lalu, dalam komuniti Huggingface, seorang pembangun juga menegaskan:

Menurut pemahaman kami, sebagai tambahan untuk menamakan semula kedua-duanya Selain tensor, Yi menggunakan sepenuhnya seni bina LLaMA. (input_layernorm, post_attention_layernorm)

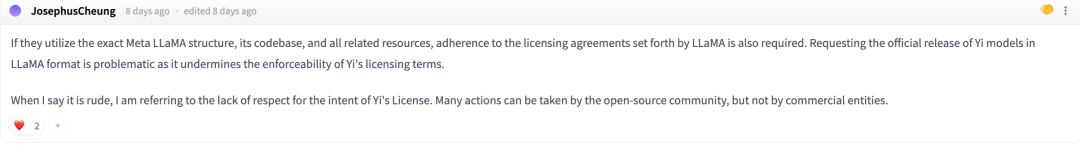

Semasa perbincangan, beberapa netizen berkata: Jika mereka ingin menggunakan seni bina Meta LLaMA, perpustakaan kod dan sumber lain yang berkaitan, mereka mesti mematuhi perjanjian lesen yang ditetapkan oleh LLaMA

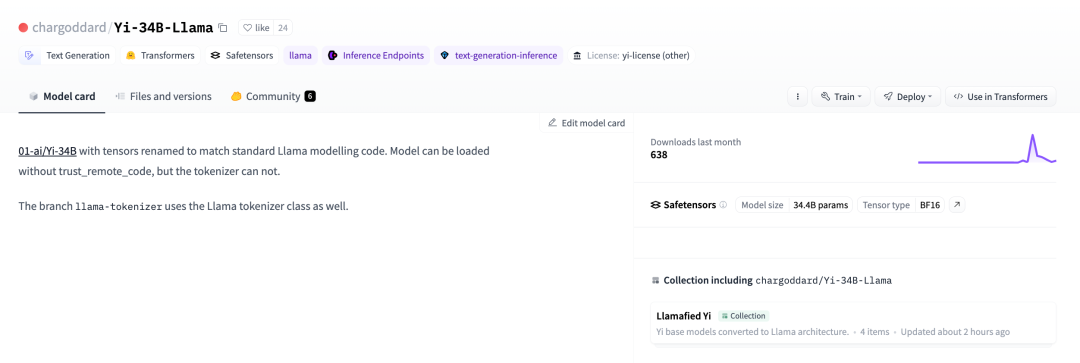

01-ai/Yi-34B, tensor telah dinamakan semula supaya sepadan dengan model LLaMA standard kod. Pautan berkaitan: https://huggingface.co/chargoddard/Yi-34B-LLaMA

Dengan membaca kandungan ini, kita boleh membuat kesimpulan bahawa berita bahawa Jia Yangqing meninggalkan Alibaba dan memulakan perniagaan telah disebut dalam kalangan rakan-rakannya beberapa hari lalu

Mengenai perkara ini, hati mesin juga menyatakan Zero One Thousand Things telah disahkan. Lingyiwu menjawab:

GPT ialah seni bina matang yang diiktiraf dalam industri, dan LLaMA membuat ringkasan tentang GPT. Reka bentuk struktur model R&D besar Zero One Thousand Things adalah berdasarkan struktur matang GPT, melakar keputusan awam peringkat teratas dalam industri Pada masa yang sama, pasukan Zero One Thousand Things telah melakukan banyak kerja mengenai pemahaman model dan latihan Ini adalah kali pertama kami telah mengeluarkan keputusan yang sangat baik. Pada masa yang sama, Zero One Thousand Things juga terus meneroka penemuan penting di peringkat struktur model.

Struktur model hanyalah sebahagian daripada latihan model. Model sumber terbuka Yi memberi tumpuan kepada aspek lain, seperti kejuruteraan data, kaedah latihan, kemahiran duduk bayi (pemantauan proses latihan), tetapan hiperparameter, kaedah penilaian, kedalaman pemahaman tentang sifat penunjuk penilaian, dan kedalaman penyelidikan tentang prinsip keupayaan generalisasi model , keupayaan AI Infra teratas dalam industri, dsb., banyak penyelidikan dan pembangunan dan kerja asas telah dilaburkan ini sering memainkan peranan dan nilai yang lebih besar daripada struktur asas Satu Wagon dalam peringkat pra-latihan model besar.

Dalam proses menjalankan sejumlah besar eksperimen latihan, kami menamakan semula kod mengikut keperluan pelaksanaan eksperimen. Kami sangat mementingkan maklum balas daripada komuniti sumber terbuka dan telah mengemas kini kod untuk disepadukan dengan lebih baik ke dalam ekosistem Transformer

Kami sangat berterima kasih atas maklum balas daripada komuniti Kami baru sahaja bermula dalam komuniti sumber terbuka dan berharap dapat berfungsi dengan semua orang untuk mewujudkan komuniti yang makmur Sumber terbuka yang mudah Akan melakukan yang terbaik untuk terus membuat kemajuan

Atas ialah kandungan terperinci Berdasarkan LLaMA tetapi menukar nama tensor, model besar Kai-Fu Lee menimbulkan kontroversi, dan respons rasmi ada di sini. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Bagaimana untuk membuka fail vcf

Bagaimana untuk membuka fail vcf Algoritma apriori peraturan persatuan

Algoritma apriori peraturan persatuan Apakah yang dimaksudkan dengan lebar penuh dan separuh lebar?

Apakah yang dimaksudkan dengan lebar penuh dan separuh lebar? wordpress seo

wordpress seo Apa yang perlu dilakukan jika memuatkan dll gagal

Apa yang perlu dilakukan jika memuatkan dll gagal Bagaimana untuk membaca data dalam fail excel dalam python

Bagaimana untuk membaca data dalam fail excel dalam python tutorial fleksibel

tutorial fleksibel Bagaimana untuk menyelesaikan masalah yang css tidak boleh dimuatkan

Bagaimana untuk menyelesaikan masalah yang css tidak boleh dimuatkan