Beberapa masa lalu, Meta mengeluarkan model AI "Segment Everything (SAM)", yang boleh menjana topeng untuk sebarang objek dalam mana-mana imej atau video, menyebabkan penyelidik dalam bidang penglihatan komputer (CV) berseru: "CV tidak wujud". Selepas itu, terdapat gelombang "penciptaan sekunder" dalam bidang CV Beberapa kerja berturut-turut menggabungkan fungsi seperti pengesanan sasaran dan penjanaan imej berdasarkan segmentasi, tetapi kebanyakan penyelidikan adalah berdasarkan imej statik.

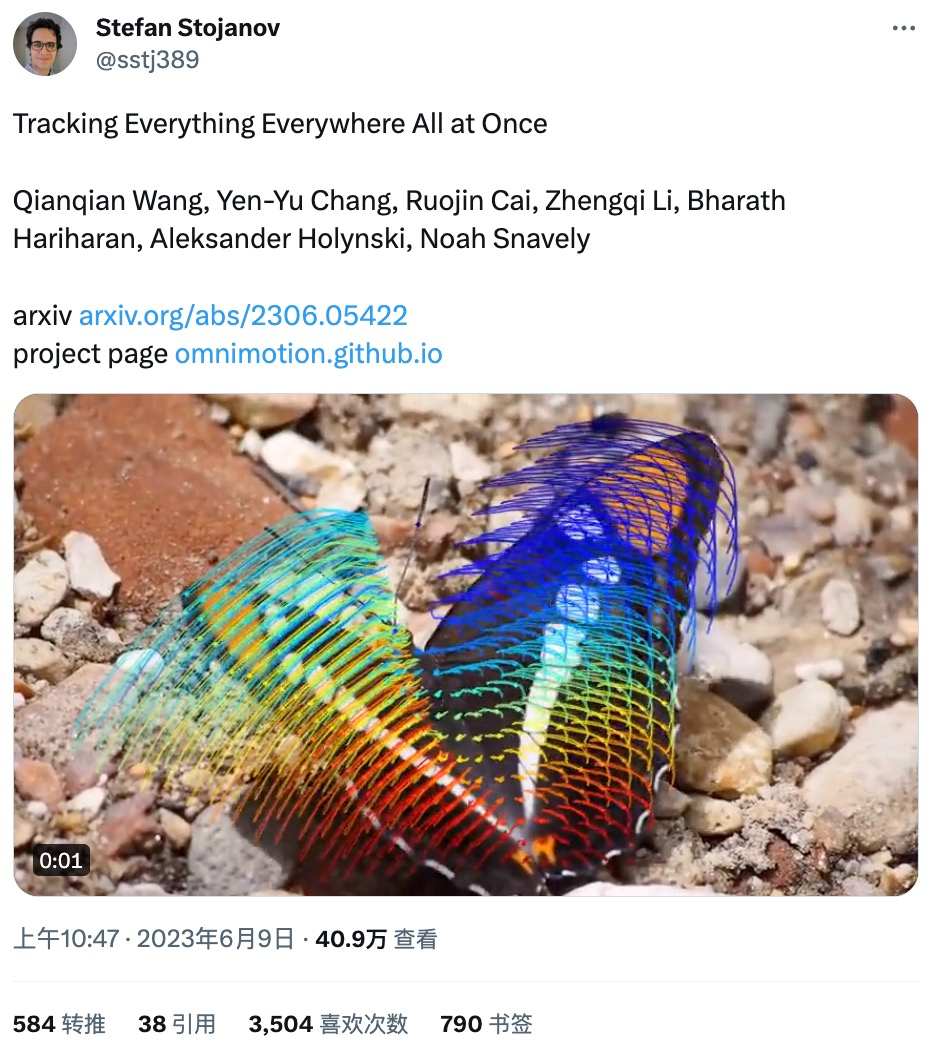

Kini, penyelidikan baharu yang dipanggil "Menjejaki Segala-galanya" mencadangkan kaedah baharu untuk anggaran gerakan dalam video dinamik, yang boleh menjejak trajektori pergerakan objek dengan tepat dan sepenuhnya.

Penyelidikan ini diketuai oleh penyelidik dari Cornell University, Google Research dan UC Penyelidik Berkeley bekerjasama. Mereka bersama-sama mencadangkan OmniMotion, perwakilan gerakan yang lengkap dan konsisten di peringkat global, dan mencadangkan kaedah pengoptimuman masa ujian baharu untuk melaksanakan anggaran gerakan yang tepat dan lengkap bagi setiap piksel dalam video.

Sesetengah netizen mengesyorkan Kajian ini telah ditweet semula dan menerima 3,500+ suka hanya dalam satu hari Kandungan penyelidikan diterima dengan baik.

Jika dilihat dari demo yang dikeluarkan oleh kajian, kesan motion tracking adalah sangat baik seperti menjejak pergerakan. trajektori kanggaru melompat:

Lengkung gerakan berayun:

Anda juga boleh melihat status penjejakan gerakan secara interaktif:

Anda boleh menjejaki gerakan walaupun jika objek terhalang. Contohnya, seekor anjing dihalang oleh pokok semasa berlari:

Dalam bidang penglihatan komputer, terdapat dua kaedah anggaran gerakan yang biasa digunakan: pengesanan ciri jarang dan aliran optik padat. Walau bagaimanapun, kedua-dua kaedah mempunyai kekurangannya sendiri Penjejakan ciri jarang tidak boleh memodelkan pergerakan semua piksel padat aliran optik tidak dapat menangkap trajektori gerakan untuk masa yang lama.

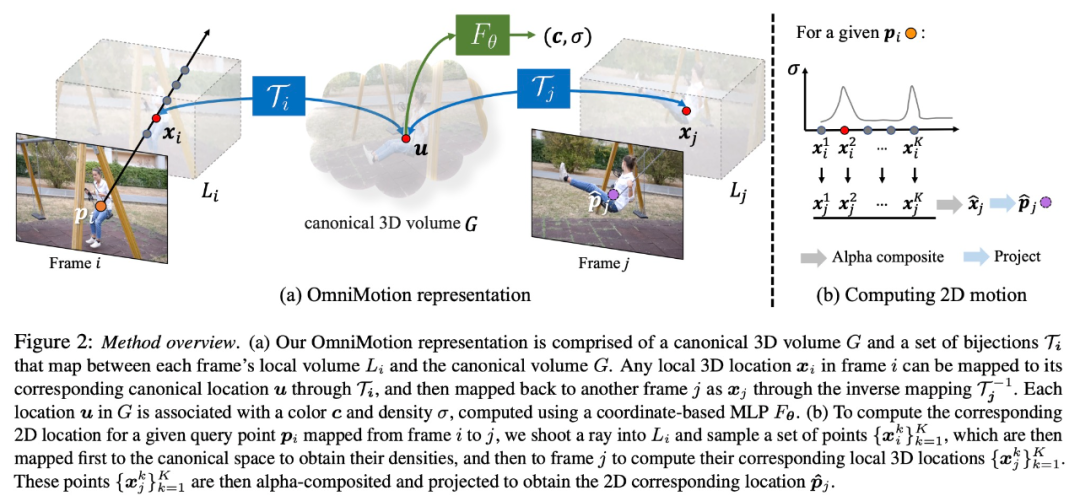

OmniMotion yang dicadangkan dalam penyelidikan ini menggunakan volum kanonik kuasi-3D untuk mencirikan video dan menjejaki setiap piksel melalui bijection antara ruang tempatan dan ruang kanonik. Perwakilan ini membolehkan konsistensi global, membolehkan penjejakan gerakan walaupun objek tertutup, dan memodelkan sebarang gabungan gerakan kamera dan objek. Kajian ini secara eksperimen menunjukkan bahawa kaedah yang dicadangkan dengan ketara mengatasi kaedah SOTA sedia ada.

Kajian ini mengambil sebagai input koleksi bingkai dengan anggaran gerakan bising yang berpasangan (cth., medan aliran optik) untuk membentuk perwakilan gerakan yang lengkap dan konsisten secara global bagi keseluruhan video. Kajian itu kemudiannya menambah proses pengoptimuman yang membolehkannya menanyakan perwakilan dengan mana-mana piksel dalam mana-mana bingkai untuk menghasilkan trajektori gerakan yang lancar dan tepat sepanjang video. Terutamanya, kaedah ini boleh mengenal pasti apabila titik dalam bingkai tersumbat dan juga boleh menjejaki titik melalui oklusi.

Perwakilan OmniMotion

Kaedah anggaran gerakan tradisional (seperti aliran optik berpasangan), apabila objek tersekat Penjejakan daripada objek akan hilang. Untuk menyediakan trajektori gerakan yang tepat dan konsisten walaupun di bawah oklusi, kajian ini mencadangkan perwakilan gerakan global OmniMotion.

Penyelidikan ini cuba menjejaki gerakan dunia sebenar dengan tepat tanpa pembinaan semula 3D dinamik yang eksplisit. Perwakilan OmniMotion mewakili pemandangan dalam video sebagai volum 3D kanonik, yang dipetakan kepada volum tempatan dalam setiap bingkai melalui bijection kanonik tempatan. Bijection kanonik tempatan diparameterkan sebagai rangkaian saraf dan menangkap gerakan kamera dan pemandangan tanpa memisahkan keduanya. Berdasarkan pendekatan ini, video boleh dilihat sebagai hasil pemaparan daripada volum tempatan kamera statik tetap.

Oleh kerana OmniMotion tidak membezakan secara jelas antara gerakan kamera dan adegan, representasi yang terbentuk bukanlah pembinaan semula pemandangan 3D yang tepat secara fizikal . Oleh itu, kajian itu memanggilnya pencirian kuasi-3D.

OmniMotion mengekalkan maklumat tentang semua titik pemandangan yang diunjurkan ke setiap piksel, serta susunan kedalaman relatifnya, yang membolehkan titik dalam bingkai dialihkan walaupun ia terhalang buat sementara waktu.

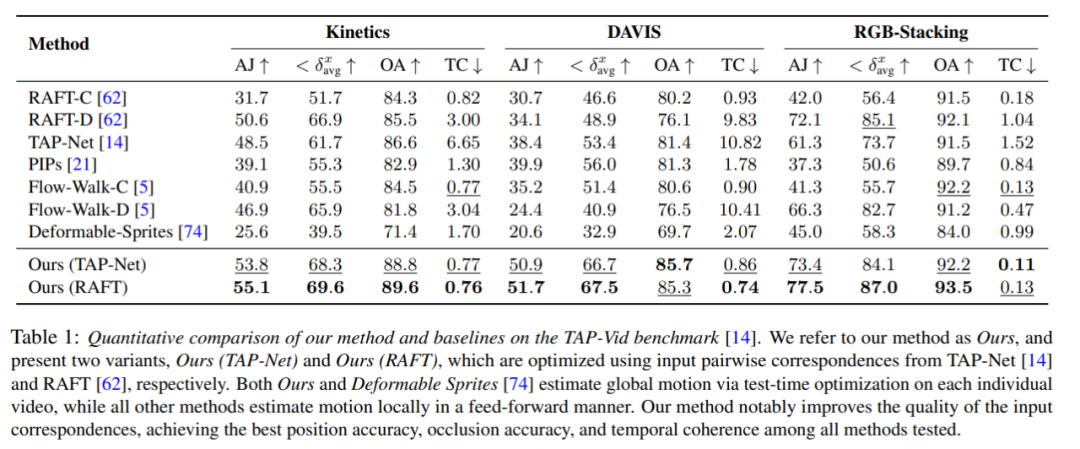

Perbandingan kuantitatif

Para penyelidik membandingkan kaedah yang dicadangkan dengan penanda aras TAP-Vid, dan hasilnya ditunjukkan dalam Jadual 1. Dapat dilihat bahawa kaedah mereka secara konsisten mencapai ketepatan kedudukan terbaik, ketepatan oklusi dan ketekalan masa pada set data yang berbeza. Kaedah mereka mengendalikan dengan baik input surat-menyurat berpasangan yang berbeza daripada RAFT dan TAP-Net dan menyediakan penambahbaikan yang konsisten ke atas kedua-dua kaedah asas.

Perbandingan kualitatif

Seperti yang ditunjukkan dalam Rajah 3, penyelidik Their kaedah secara kualitatif dibandingkan dengan kaedah asas. Kaedah baharu menunjukkan keupayaan pengecaman dan penjejakan yang sangat baik semasa peristiwa oklusi (lama), sambil menyediakan kedudukan yang munasabah untuk mata semasa oklusi dan mengendalikan paralaks gerakan kamera besar.

Eksperimen dan analisis Ablasi

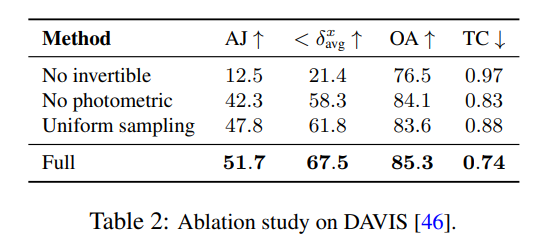

Penyelidikan Penyelidik menggunakan eksperimen ablasi untuk mengesahkan keberkesanan keputusan reka bentuk mereka, dan hasilnya ditunjukkan dalam Jadual 2.

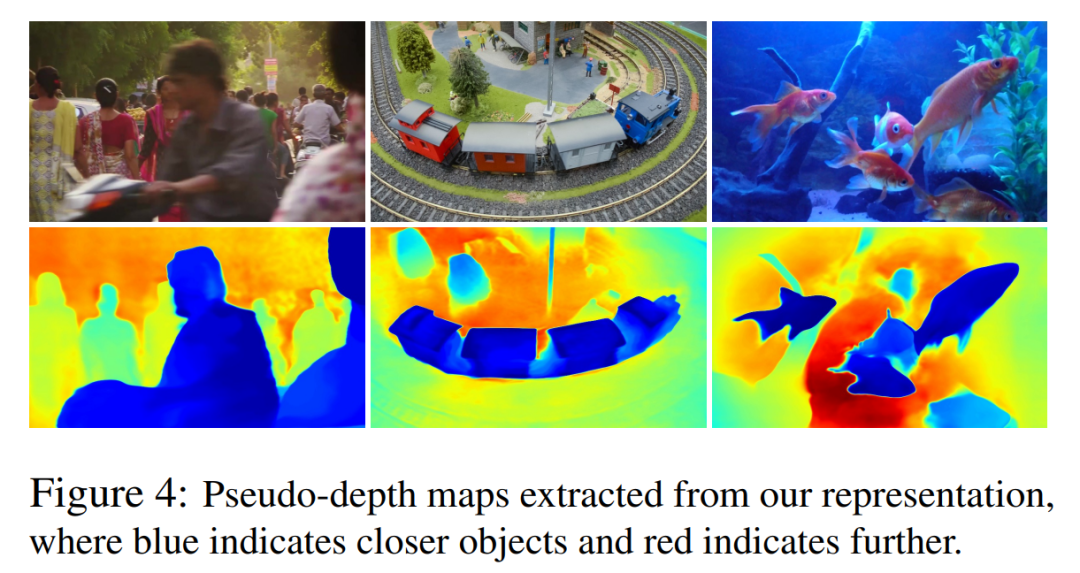

Dalam Rajah 4, mereka menunjukkan peta pseudo-depth yang dijana oleh model mereka untuk menunjukkan pengisihan Kedalaman yang dipelajari.

Perlu diingatkan bahawa angka-angka ini tidak sepadan dengan kedalaman fizikal, walau bagaimanapun, ia menunjukkan bahawa kaedah baharu ini mampu menentukan urutan relatif antara permukaan yang berbeza dengan berkesan hanya menggunakan isyarat aliran fotometrik dan optik, yang berguna. untuk Penjejakan dalam oklusi adalah kritikal. Lebih banyak eksperimen ablasi dan keputusan analisis boleh didapati dalam bahan tambahan.

Atas ialah kandungan terperinci Algoritma video 'jejaki segala-galanya' yang menjejaki setiap piksel pada bila-bila masa, di mana-mana sahaja, malah tidak takut dengan halangan ada di sini.. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Apa yang perlu dilakukan dengan kad video

Apa yang perlu dilakukan dengan kad video

Bagaimana untuk memuat turun video dari Douyin

Bagaimana untuk memuat turun video dari Douyin

Senarai harga peringkat Douyin 1-75

Senarai harga peringkat Douyin 1-75

Berapakah Snapdragon 8gen2 yang setara dengan Apple?

Berapakah Snapdragon 8gen2 yang setara dengan Apple?

Perkara yang perlu dilakukan jika ralat berlaku dalam skrip halaman semasa

Perkara yang perlu dilakukan jika ralat berlaku dalam skrip halaman semasa

Bagaimana untuk memasang pemacu

Bagaimana untuk memasang pemacu

Bagaimana untuk menetapkan nombor halaman dalam perkataan

Bagaimana untuk menetapkan nombor halaman dalam perkataan

Apakah platform lazada?

Apakah platform lazada?