Selepas perbicaraan, Sam Altman membawa pasukannya melakukan "perjalanan" di Eropah.

Dalam temu bual baru-baru ini, Altman tidak menyembunyikannya, mendedahkan bahawa semua kemajuan dalam AInya sendiri perlu menunggu GPU untuk mengejarnya.

Beliau membincangkan API OpenAI dan rancangan produk, yang menarik perhatian ramai orang.

Ramai netizen menyatakan saya suka keterusterangan Altman.

Perlu dinyatakan bahawa keupayaan pelbagai mod GPT-4 harus tersedia kepada kebanyakan pengguna Plus pada tahun 2024, dengan syarat mereka mempunyai GPU yang mencukupi.

Superkomputer Microsoft Big Brother membelanjakan 1.2 bilion dolar AS untuk membina OpenAI masih jauh daripada dapat memenuhi kuasa pengkomputeran yang diperlukan untuk operasi GPT-4. Lagipun, parameter GPT-4 dikatakan mempunyai 100 trilion.

Di samping itu, Altman turut mendedahkan bahawa GPT-3 turut disertakan dalam pelan sumber terbuka OpenAI.

Saya tidak tahu sama ada temu bual ini mendedahkan terlalu banyak "rahsia" OpenAI Manuskrip sumber telah dipadamkan, sila kodkannya dengan cepat.

Temu bual terkini telah dihoskan oleh Raza Habib, Ketua Pegawai Eksekutif platform pembangunan AI Humanloop, yang menemu bual Altman dan 20 pembangun lain.

Perbincangan ini menyentuh isu pembangun praktikal, serta isu yang lebih besar yang berkaitan dengan misi OpenAI dan impak sosial AI.

Berikut ialah perkara utama:

1 OpenAI memerlukan GPU yang mendesak

2 Pelan jalan OpenAI terbaru: GPT-4 multi-modal akan dibuka pada 2024

3 tidak akan dikeluarkan dalam masa terdekat

4 OpenAI hanya menjadikan ChatGPT, "aplikasi pembunuh", dengan matlamat menjadikan ChatGPT pembantu kerja yang sangat pintar

5 GPT-3 Dalam pelan sumber terbuka

6 Undang-undang penskalaan prestasi model terus berkesan

Seterusnya, saya akan memperkenalkan apa yang dikatakan oleh Sam Altman daripada 6 perkara utama Apa yang berlaku?

OpenAI pada masa ini sangat bergantung pada GPUSemua topik dalam temu bual berkisar tentang, "OpenAI terlalu kekurangan GPU."

Ini telah menangguhkan banyak rancangan jangka pendek mereka.

Pada masa ini, ramai pelanggan OpenAI merungut tentang kebolehpercayaan dan kelajuan API. Sam Altman menjelaskan bahawa sebab utama ialah GPU terlalu pendek.

OpenAI ialah pelanggan pertama superkomputer NVIDIA DGX-1

Bagi , panjang konteks yang menyokong 32k token belum lagi boleh dilancarkan kepada lebih ramai orang.

Memandangkan OpenAI masih belum mengatasi halangan teknikal, nampaknya mereka akan mempunyai konteks untuk menyokong token 100k-1M tahun ini, tetapi mereka perlu membuat satu kejayaan dalam penyelidikan.

API Penalaan Halus juga kini dihadkan oleh ketersediaan GPU.

OpenAI belum lagi menggunakan kaedah penalaan halus yang cekap seperti Penyesuai atau LoRa, jadi penalaan halus sangat intensif secara pengiraan untuk dijalankan dan diurus.

Walau bagaimanapun, mereka akan memberikan sokongan yang lebih baik untuk penalaan halus pada masa hadapan. OpenAI juga mungkin menjadi tuan rumah kepada pasaran model yang disumbangkan oleh komuniti.

Akhir sekali, peruntukan kapasiti khusus juga dihadkan oleh ketersediaan GPU.

Pada awal tahun ini, netizen mendedahkan bahawa OpenAI secara senyap-senyap melancarkan platform pembangun baharu, Foundry, untuk membolehkan pelanggan menjalankan model pembelajaran mesin baharu syarikat pada kapasiti khusus.

Produk ini "direka untuk pelanggan termaju yang menjalankan beban kerja yang lebih besar." Untuk menggunakan perkhidmatan ini, pelanggan mesti sanggup membayar yuran pendahuluan sebanyak $100k.

Namun, seperti yang dapat dilihat daripada maklumat gambar yang didedahkan, contoh itu bukanlah murah.

Menjalankan versi ringan GPT-3.5 akan menelan kos $78,000 untuk 3 bulan delegasi dan $264,000 untuk setahun.

Ia juga boleh dilihat dari sisi lain bahawa penggunaan GPU adalah mahal.

Altman berkongsi pelan hala tuju jangka terdekat tentatif untuk API OpenAI:

2023 :

· GPT-4 yang pantas dan murahーー Ini adalah keutamaan OpenAI.

Secara umum, matlamat OpenAI adalah untuk mengurangkan "kos pintar" sebanyak mungkin. Jadi mereka akan bekerja keras untuk terus mengurangkan kos API mereka.

·Tetingkap konteks yang lebih panjang ーーDalam masa terdekat, tetingkap konteks mungkin menyokong sehingga 1 juta token.

· API penalaan halus - API penalaan halus akan diperluaskan kepada model terbaharu, tetapi bentuk yang tepat bergantung pada jenis pembangun sebenarnya nak .

· API dengan memori ーー Pada masa ini kebanyakan token dibazirkan dalam penghantaran di atas Pada masa hadapan, akan ada versi API yang boleh mengingati sejarah perbualan.ーーGPT-4 menunjukkan keupayaan berbilang modal yang berkuasa apabila ia dikeluarkan, tetapi sehingga GPU berpuas hati, ciri ini tidak boleh diperluaskan kepada semua orang.

Pemalam "tidak mempunyai PMF" dan tidak akan muncul dalam API dalam jangka pendek Ramai pembangun sangat berminat untuk mengakses pemalam ChatGPT melalui API, tetapi Sam berkata pemalam ini Ia tidak akan dikeluarkan dalam masa terdekat. "Kecuali untuk Penyemakan Imbas, sistem pemalam tidak menemui PMF."

Kecuali ChatGPT, OpenAI tidak akan mengeluarkan sebarang produk lagi

Setiap langkah yang dibuat oleh OpenAI membuatkan pembangun gementar.

Ramai pembangun menyatakan bahawa mereka gugup menggunakan API OpenAI untuk membina aplikasi apabila OpenAI mungkin mengeluarkan produk yang bersaing dengan mereka.

Altman berkata OpenAI tidak akan mengeluarkan lebih banyak produk di luar ChatGPT.

Pada pendapatnya, sebuah syarikat yang hebat mempunyai "aplikasi pembunuh", dan ChatGPT akan menjadi aplikasi yang memecahkan rekod ini.

Visi ChatGPT adalah untuk menjadi pembantu kerja super pintar. OpenAI tidak akan menyentuh banyak kes penggunaan GPT lain.

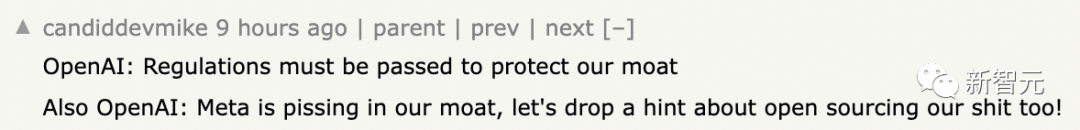

Peraturan adalah perlu, tetapi begitu juga sumber terbuka

Walaupun Altman meminta pengawalseliaan model akan datang, dia tidak percaya bahawa model sedia ada berbahaya.

Dia percaya bahawa mengawal selia atau mengharamkan model sedia ada adalah satu kesilapan besar.

Dalam temu bual itu, beliau mengulangi kepercayaannya terhadap kepentingan sumber terbuka dan berkata OpenAI sedang mempertimbangkan untuk menjadikan GPT-3 sumber terbuka.

Kini, sebahagian daripada sebab OpenAI tidak menjadi sumber terbuka adalah kerana beliau meragui berapa ramai individu dan syarikat yang mempunyai keupayaan untuk menjadi hos dan menyediakan model besar."Undang-undang skala" prestasi model masih sah

Baru-baru ini, banyak artikel mendakwa bahawa era model kecerdasan buatan gergasi telah berakhir. Walau bagaimanapun, ia tidak menggambarkan dengan tepat niat asal Altman.

Data dalaman OpenAI menunjukkan bahawa undang-undang penskalaan untuk prestasi model masih berkuat kuasa dan menjadikan model lebih besar akan terus menghasilkan prestasi.

Ini tidak bermakna OpenAI tidak akan terus mencuba untuk menjadikan model lebih besar, ia hanya bermakna mereka mungkin hanya akan meningkat sebanyak 1x/2x setahun dan bukannya mengikut urutan magnitud . Hakikat bahawa undang-undang penskalaan terus berkuat kuasa mempunyai implikasi penting untuk garis masa pembangunan AGI.

Andaian penskalaan ialah kita mungkin sudah mempunyai kebanyakan bahagian yang diperlukan untuk membina AGI, dan kebanyakan kerja yang tinggal akan menskalakan kaedah sedia ada kepada model yang lebih besar dan set data yang lebih besar.

Jika era penskalaan sudah berakhir, maka kita mungkin harus mengharapkan AGI berada lebih jauh. Kesahan undang-undang penskalaan yang berterusan menunjukkan bahawa garis masa untuk melaksanakan AGI akan menjadi lebih pendek.

Ada netizen bergurau,

OpenAI: Mesti Lindungi parit kami melalui peraturan. OpenAI sekali lagi menyebut bahawa Meta sedang kencing di parit kami, yang juga bermakna model kami perlu menjadi sumber terbuka.

Sesetengah orang berkata jika GPT-3 benar-benar sumber terbuka, seperti LLMa, ia akan mengambil masa lebih kurang 5 hari untuk siap pada cip M1 Ia sedang berjalan.

Pembangun komuniti boleh membantu OpenAI menyelesaikan kesesakan GPU, dengan syarat mereka membuka sumber model mereka. Dalam masa beberapa hari, pembangun akan dapat menjalankannya pada CPU dan peranti tepi.

Mengenai kekurangan GPU, sesetengah orang berpendapat bahawa terdapat masalah dengan rantaian modal OpenAI dan ia tidak mampu membelinya.

Walau bagaimanapun, ada yang mengatakan bahawa terdapat kekurangan bekalan. Melainkan terdapat revolusi dalam pembuatan cip, kemungkinan akan sentiasa terdapat kekurangan bekalan berbanding GPU pengguna.

Sesetengah netizen meragui bahawa nilai Nvidia masih dipandang rendah? Perubahan langkah dalam permintaan pengkomputeran boleh bertahan selama bertahun-tahun...

Nvidia baru sahaja menyertai kelab trilion dolar, boleh dikatakan, kuasa pengkomputeran tanpa had Permintaan boleh membawa kepada dunia dengan kilang cip melebihi $2 trilion.

Rujukan:

//m.sbmmt.com/link / c55d22f5c88cc6f04c0bb2e0025dd70b

//m.sbmmt.com/link/d5776aeecb3c65f5>

//m.sbmmt.com/link/d5776aeecb3c65f5>

Atas ialah kandungan terperinci GPT-3 merancang untuk menjadi sumber terbuka! Sam Altman mendedahkan bahawa terdapat keperluan mendesak untuk GPU, dan keupayaan pelbagai mod GPT-4 akan tersedia tahun depan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!