Salah satu fenomena paling misteri dalam kemunculan model besar ialah Petua Rantaian Pemikiran (CoT), yang telah menunjukkan hasil yang menakjubkan dalam menyelesaikan masalah penaakulan matematik dan membuat keputusan. Betapa pentingnya CoT? Apakah mekanisme di sebalik kejayaannya? Dalam artikel ini, beberapa penyelidik dari Universiti Peking membuktikan bahawa CoT amat diperlukan dalam merealisasikan inferens model bahasa besar (LLM), dan mendedahkan cara CoT boleh mengeluarkan potensi besar LLM dari perspektif teori dan eksperimen.

Penyelidikan terkini mendapati bahawa Rangkaian Pemikiran (CoT) boleh meningkatkan prestasi model bahasa besar (LLM) dengan ketara, terutamanya untuk memproses masalah kompleks yang melibatkan matematik atau penaakulan. Tetapi walaupun banyak kejayaan, mekanisme di sebalik CoT dan cara membuka kunci potensi LLM masih sukar difahami.

Baru-baru ini, satu kajian baharu dari Universiti Peking mendedahkan misteri di sebalik CoT dari perspektif teori.

Pautan kertas: https://arxiv.org/abs/2305.15408

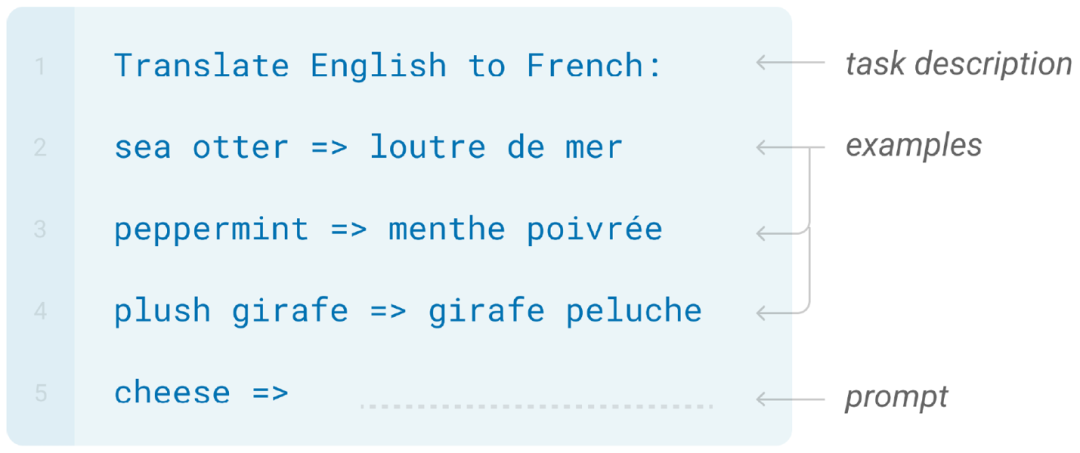

Model bahasa besar berasaskan pengubah telah menjadi model biasa dalam pemprosesan bahasa semula jadi dan telah digunakan secara meluas dalam pelbagai tugas. Model besar arus perdana biasanya dilaksanakan berdasarkan paradigma autoregresif Secara khusus, pelbagai tugas (seperti terjemahan teks, penjanaan teks, menjawab soalan, dll.) boleh dianggap secara seragam sebagai masalah penjanaan urutan, di mana input soalan dan penerangan. daripada soalan dikodkan bersama-sama ke dalam urutan perkataan (token), dipanggil prompt (prompt);

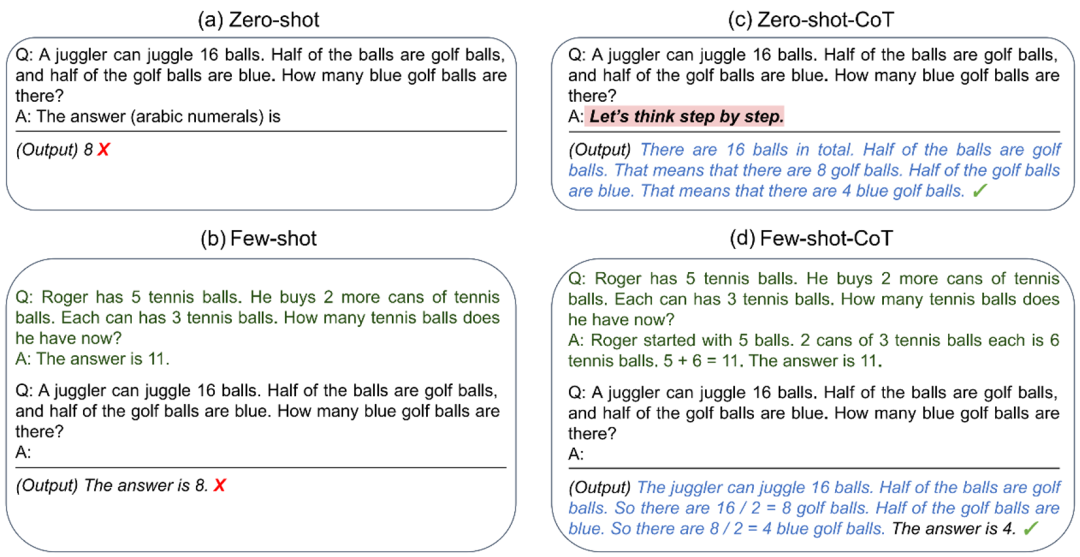

Sebilangan besar kajian dalam bidang model besar telah menunjukkan bahawa reka bentuk yang baik kata-kata gesaan Memainkan peranan penting dalam prestasi model. Terutama apabila ia berkaitan dengan aritmetik atau tugas yang berkaitan dengan penaakulan, CoT telah ditunjukkan untuk meningkatkan dengan ketara ketepatan jawapan yang dijana. Seperti yang ditunjukkan dalam rajah di bawah, untuk tugasan yang memerlukan penaakulan matematik, jawapan yang dijana secara langsung oleh model besar selalunya salah (angka a,b di bawah). Walau bagaimanapun, jika anda mengubah suai gesaan supaya model besar mengeluarkan keseluruhan rantaian pemikiran (langkah derivasi perantaraan), anda akhirnya akan dapat jawapan yang betul (c, d di bawah).

Dalam amalan, terdapat dua cara arus perdana untuk melaksanakan gesaan rantaian pemikiran: satu ialah menambah Frasa tertentu seperti " Mari kita fikir langkah demi langkah" dicetuskan (seperti ditunjukkan dalam c di atas); yang lain adalah untuk menyediakan sebilangan kecil contoh demonstrasi rantai pemikiran untuk membolehkan model besar mensimulasikan proses terbitan yang sepadan (seperti ditunjukkan dalam d di atas).

Walau bagaimanapun, walaupun CoT telah mencapai prestasi yang luar biasa dalam sebilangan besar eksperimen, mekanisme teori di sebaliknya kekal sebagai misteri. Di satu pihak, adakah model besar sememangnya mempunyai kelemahan teori yang wujud dalam menjawab soalan secara langsung tentang matematik, penaakulan, dsb.? Sebaliknya, mengapakah CoT boleh meningkatkan keupayaan model besar pada tugasan ini? Kertas kerja ini menjawab soalan di atas dari perspektif teori.

Khususnya, penyelidik mengkaji CoT dari perspektif kebolehan ekspresi model: Untuk tugasan matematik dan tugasan membuat keputusan am, kertas kerja ini mengkaji model Transformer berdasarkan autoregresi dalam dua keupayaan Ekspresif berikut dari segi: (1) menjana jawapan secara langsung, dan (2) menggunakan CoT untuk menjana langkah penyelesaian yang lengkap.

Model besar yang diwakili oleh GPT-4 telah menunjukkan keupayaan matematik yang menakjubkan. Contohnya, ia boleh menyelesaikan kebanyakan masalah matematik sekolah menengah dengan betul dan juga telah menjadi pembantu penyelidik untuk ahli matematik.

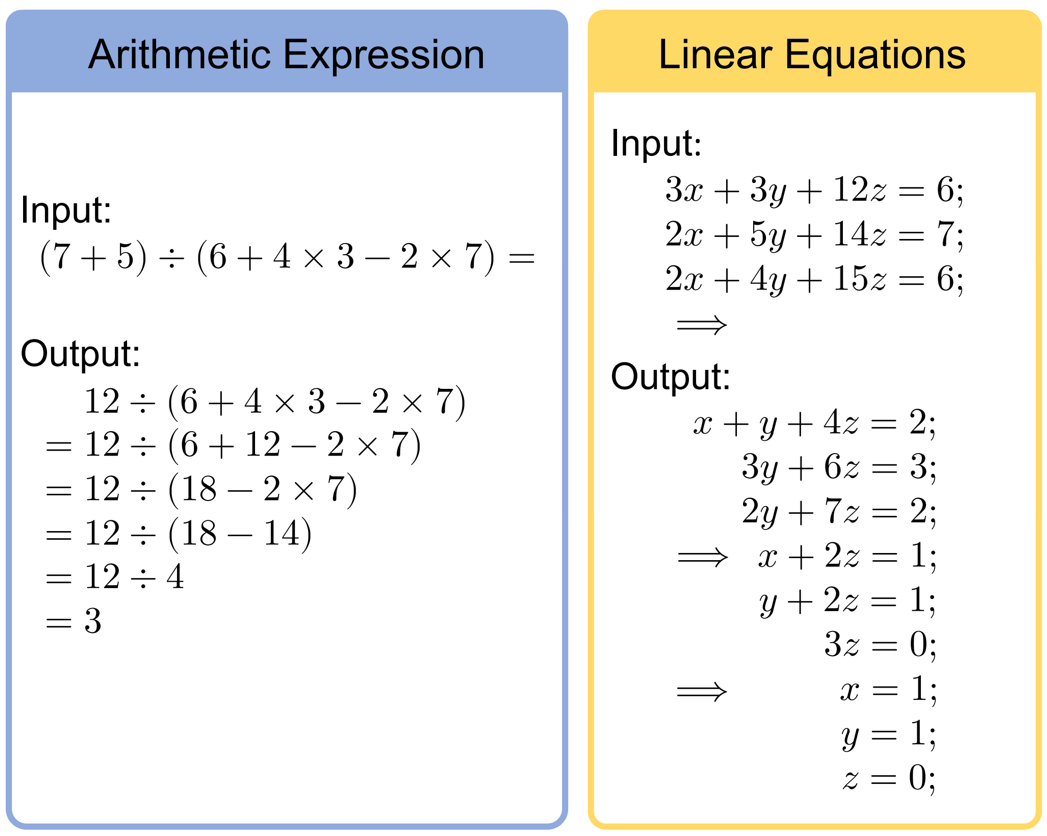

Untuk mengkaji keupayaan matematik model besar, artikel ini memilih dua tugasan matematik yang sangat asas tetapi teras: aritmetik dan persamaan (rajah berikut menunjukkan input kedua-dua contoh output tugasan ini ). Oleh kerana ia adalah komponen asas untuk menyelesaikan masalah matematik yang kompleks, dengan mengkaji dua masalah matematik teras ini, kita boleh memperoleh pemahaman yang lebih mendalam tentang keupayaan model besar mengenai masalah matematik umum.

Para penyelidik mula-mula meneroka sama ada Transformer boleh mengeluarkan jawapan kepada soalan di atas tanpa mengeluarkan langkah perantaraan. Mereka menganggap andaian yang sangat konsisten dengan realiti - Transformer ketepatan log, iaitu, setiap neuron Transformer hanya boleh mewakili nombor titik terapung ketepatan terhad (ketepatan ialah log n bit), di mana n ialah panjang maksimum daripada ayat tersebut. Andaian ini sangat hampir dengan realiti, contohnya dalam GPT-3, ketepatan mesin (16 atau 32 bit) biasanya jauh lebih kecil daripada panjang ayat output maksimum (2048).

Di bawah andaian ini, penyelidik membuktikan hasil teras yang mustahil: Untuk model Transformer autoregresif dengan lapisan malar dan lebar d, untuk mengeluarkan secara langsung Jawapannya ialah apabila menyelesaikan dua masalah matematik di atas, lebar model yang sangat besar d perlu digunakan. Secara khusus, d perlu berkembang lebih besar daripada polinomial apabila panjang input n bertambah.

Sebab penting untuk keputusan ini ialah tiada algoritma selari yang cekap untuk dua masalah di atas, jadi Transformer, sebagai model selari biasa, tidak dapat menyelesaikannya. Artikel ini menggunakan teori kerumitan litar dalam sains komputer teori untuk membuktikan dengan teliti teorem di atas.

Jadi, bagaimana jika model tidak mengeluarkan jawapan secara langsung, tetapi mengeluarkan langkah-langkah terbitan perantaraan dalam bentuk rajah di atas? Para penyelidik seterusnya membuktikan melalui pembinaan bahawa apabila model boleh mengeluarkan langkah perantaraan, model Transformer autoregresif dengan saiz tetap (tidak bergantung pada panjang input n) boleh menyelesaikan dua masalah matematik di atas.

Membandingkan keputusan sebelumnya, dapat dilihat bahawa penambahan CoT sangat meningkatkan keupayaan ekspresi model besar. Para penyelidik seterusnya memberikan pemahaman intuitif tentang perkara ini: Ini kerana pengenalan CoT akan terus menyuap semula perkataan output yang dijana ke lapisan input, yang meningkatkan kedalaman berkesan model, menjadikannya berkadar dengan panjang output CoT, sekali gus meningkatkan kecekapan model Kerumitan selari Transformer telah bertambah baik.

Selain masalah matematik, penyelidik mempertimbangkan lagi keupayaan CoT untuk menyelesaikan tugasan umum. Bermula dari masalah membuat keputusan, mereka menganggap rangka kerja umum untuk menyelesaikan masalah membuat keputusan, yang dipanggil pengaturcaraan dinamik.

Idea asas pengaturcaraan dinamik (DP) adalah untuk menguraikan masalah yang kompleks kepada satu siri sub-masalah berskala kecil yang boleh diselesaikan mengikut turutan. Penguraian masalah memastikan wujud perkaitan (tindih) yang ketara antara pelbagai sub-masalah, supaya setiap sub-masalah dapat diselesaikan dengan cekap menggunakan jawapan kepada sub-masalah sebelumnya.

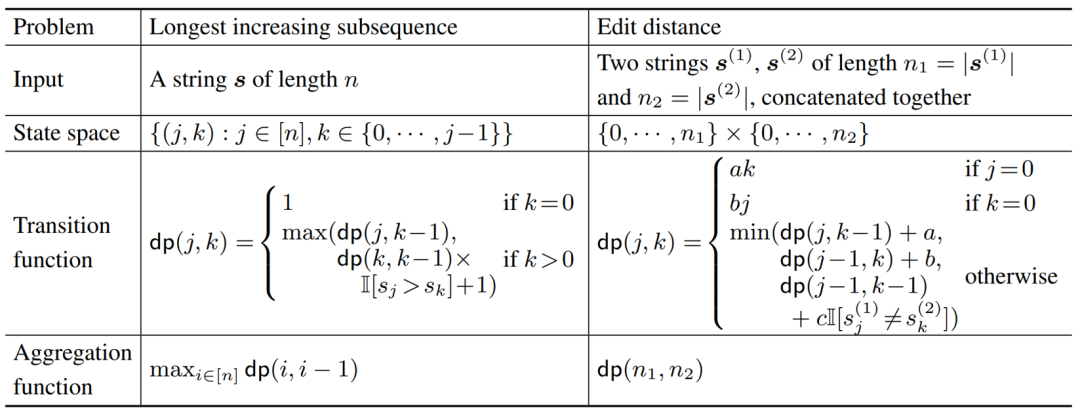

Jujukan menaik terpanjang (LIS) dan menyelesaikan jarak suntingan (ED) ialah dua masalah DP terkenal yang dicadangkan dalam buku "Pengenalan kepada Algoritma" Jadual berikut menyenaraikan fungsi Pengagregatan ini nyatakan ruang, fungsi peralihan untuk dua masalah.

Para penyelidik membuktikan bahawa model Transformer autoregresif boleh menyelesaikan sub-masalah seperti berikut Urutan mengeluarkan rantai pemikiran pengaturcaraan dinamik yang lengkap, supaya jawapan yang betul boleh dikeluarkan untuk semua tugas yang boleh diselesaikan dengan pengaturcaraan dinamik. Begitu juga, penyelidik seterusnya menunjukkan bahawa rantai pemikiran generatif adalah perlu: untuk banyak masalah pengaturcaraan dinamik yang sukar, model Transformer bersaiz polinomial lapisan malar tidak boleh mengeluarkan jawapan yang betul secara langsung. Artikel itu memberikan contoh balas kepada masalah ujian keahlian tatabahasa tanpa konteks.

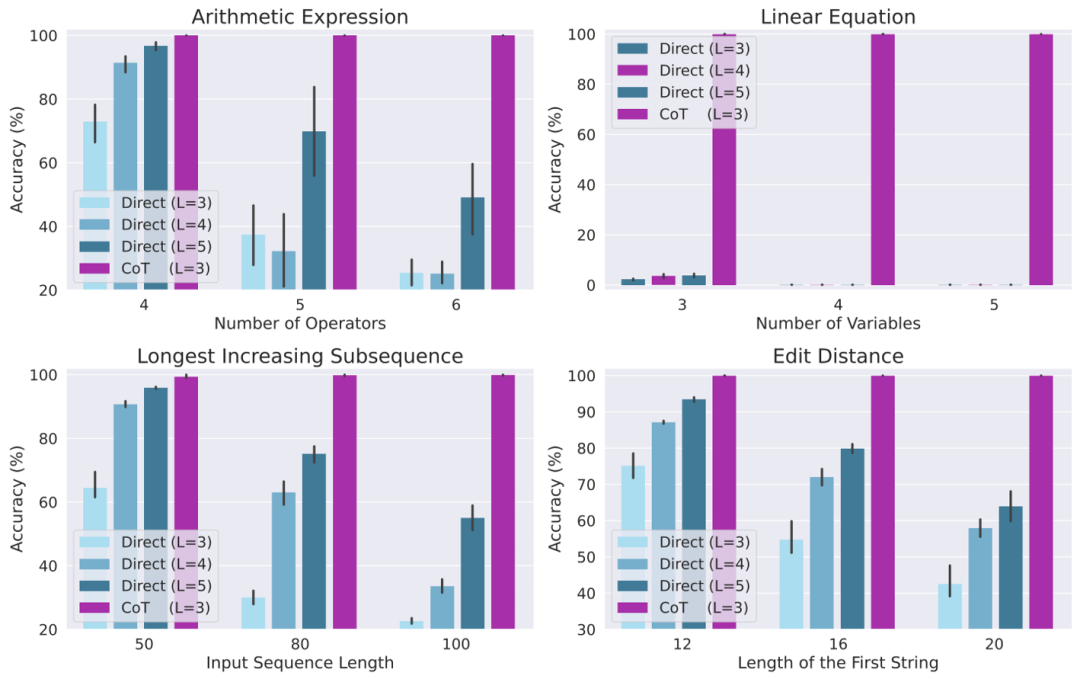

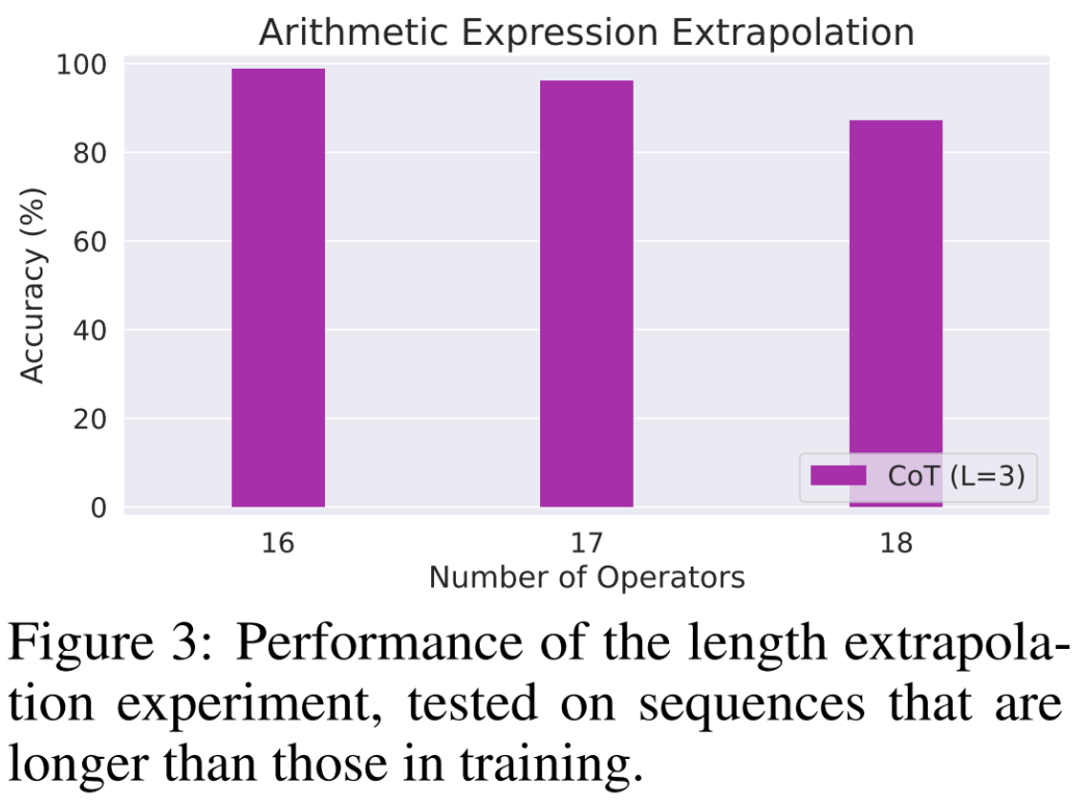

Penyelidik akhirnya mereka bentuk sebilangan besar eksperimen untuk mengesahkan teori di atas, dengan mengambil kira empat tugas yang berbeza: menilai ungkapan aritmetik, menyelesaikan persamaan linear, dan menyelesaikan urutan naik terpanjang dan menyelesaikan jarak suntingan.

Hasil eksperimen menunjukkan bahawa apabila dilatih menggunakan data CoT, model Transformer autoregresif 3 lapisan telah dapat mencapai prestasi yang hampir sempurna pada semua tugas. Walau bagaimanapun, secara langsung mengeluarkan jawapan yang betul menunjukkan prestasi yang buruk pada semua tugas (walaupun dengan model yang lebih mendalam). Keputusan ini jelas menunjukkan keupayaan Autoregressive Transformer untuk menyelesaikan pelbagai tugas yang kompleks dan menunjukkan kepentingan CoT dalam menyelesaikan tugasan ini.

Atas ialah kandungan terperinci Bagaimanakah rantai pemikiran melepaskan keupayaan tersembunyi model bahasa? Penyelidikan teori terkini mendedahkan misteri di sebaliknya. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Cara menggunakan onclick dalam HTML

Cara menggunakan onclick dalam HTML

tingkap tidak boleh bermula

tingkap tidak boleh bermula

Pengenalan kepada teorem Kirchhoff

Pengenalan kepada teorem Kirchhoff

Penjelasan terperinci tentang penggunaan arahan netsh

Penjelasan terperinci tentang penggunaan arahan netsh

Apakah masalah yang boleh diselesaikan oleh acara js yang menggelegak?

Apakah masalah yang boleh diselesaikan oleh acara js yang menggelegak?

ERR_CONNECTION_REFUSED

ERR_CONNECTION_REFUSED

Tetapkan pencetak lalai

Tetapkan pencetak lalai

Apakah klasifikasi sistem linux?

Apakah klasifikasi sistem linux?