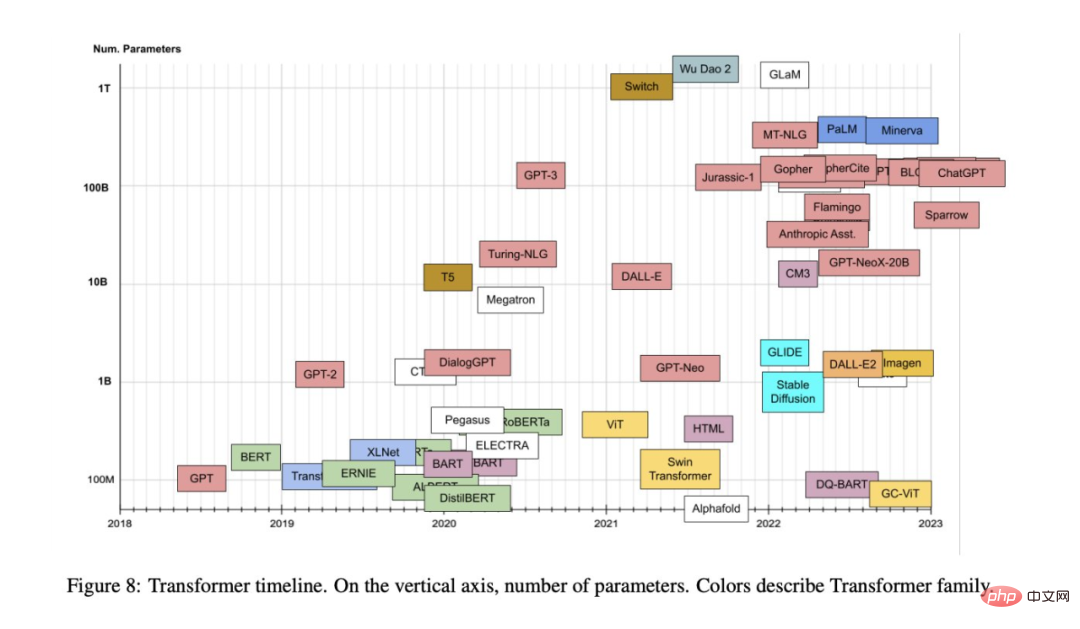

Sejak ia dicadangkan pada 2017, model Transformer telah menunjukkan kekuatan yang tidak pernah berlaku sebelum ini dalam bidang lain seperti pemprosesan bahasa semula jadi dan penglihatan komputer, dan mencetuskan kejayaan teknologi seperti ChatGPT People juga telah mencadangkan pelbagai Varian berasaskan asal model itu.

Memandangkan akademia dan industri terus mencadangkan model baharu berdasarkan mekanisme perhatian Transformer, kadangkala sukar bagi kami untuk merumuskan hala tuju ini. Baru-baru ini, artikel komprehensif oleh Xavier Amatriain, ketua strategi produk AI di LinkedIn, boleh membantu kami menyelesaikan masalah ini.

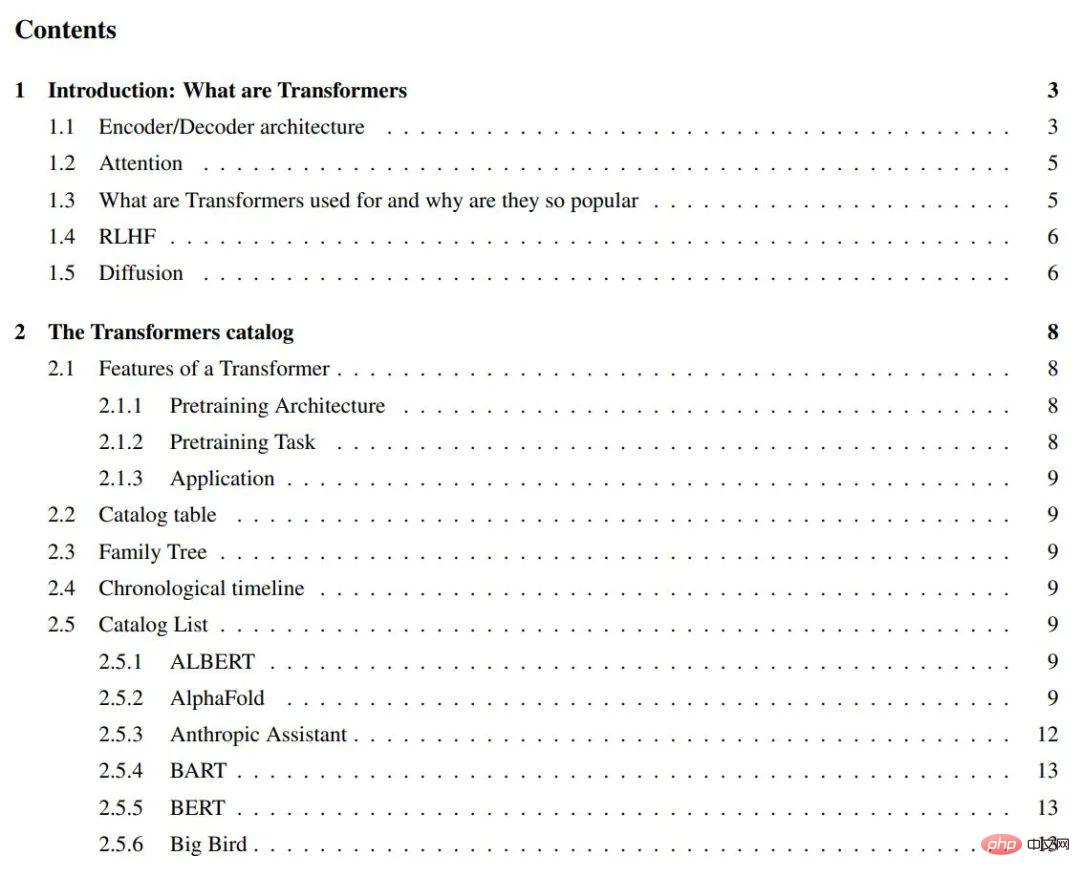

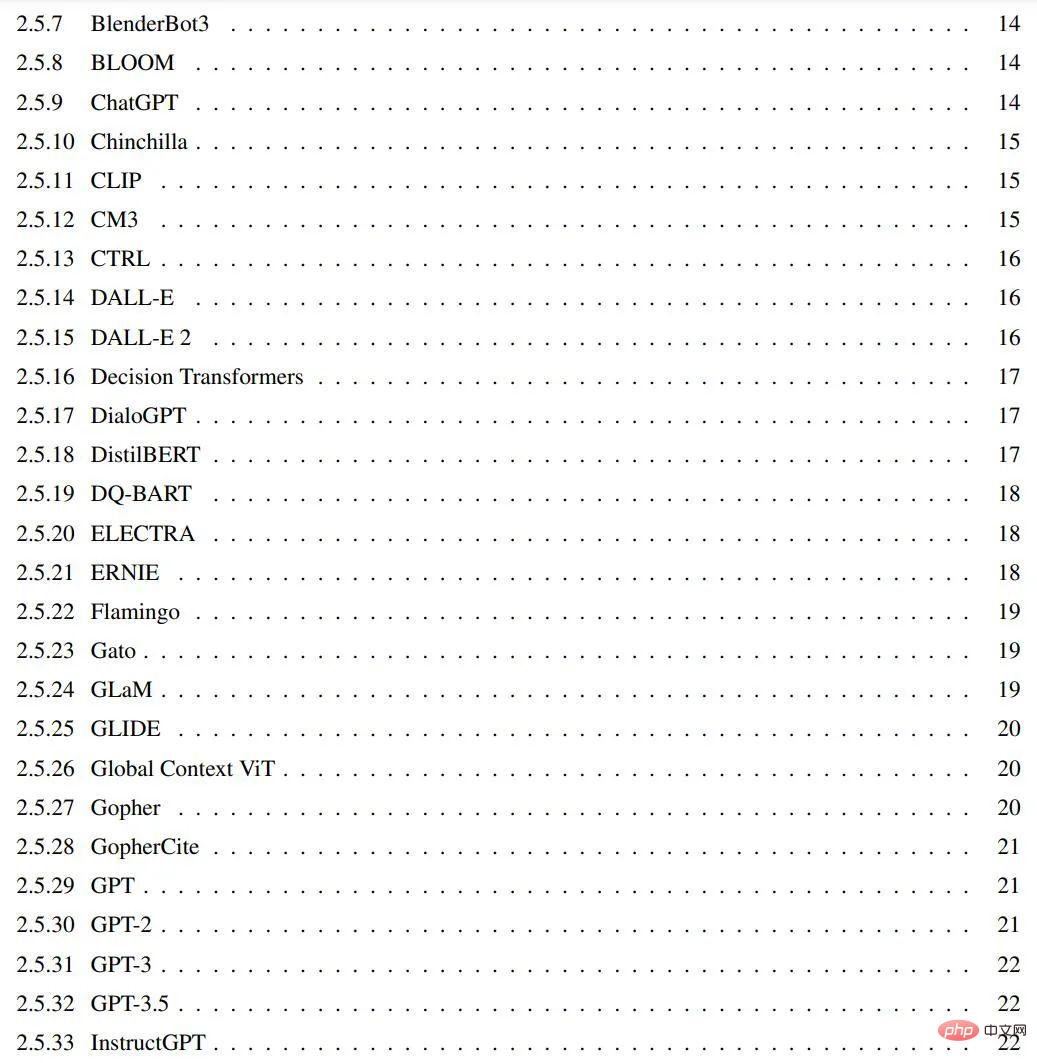

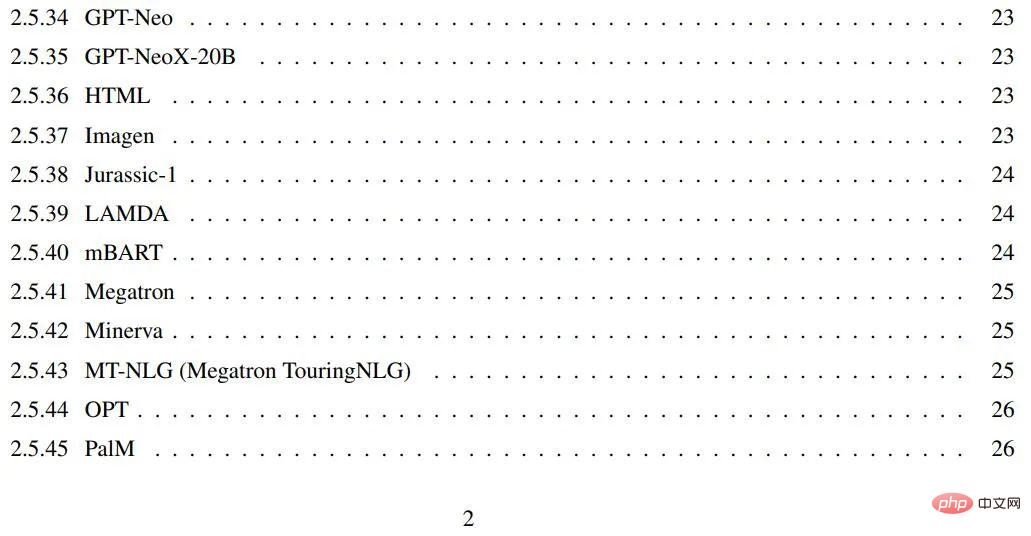

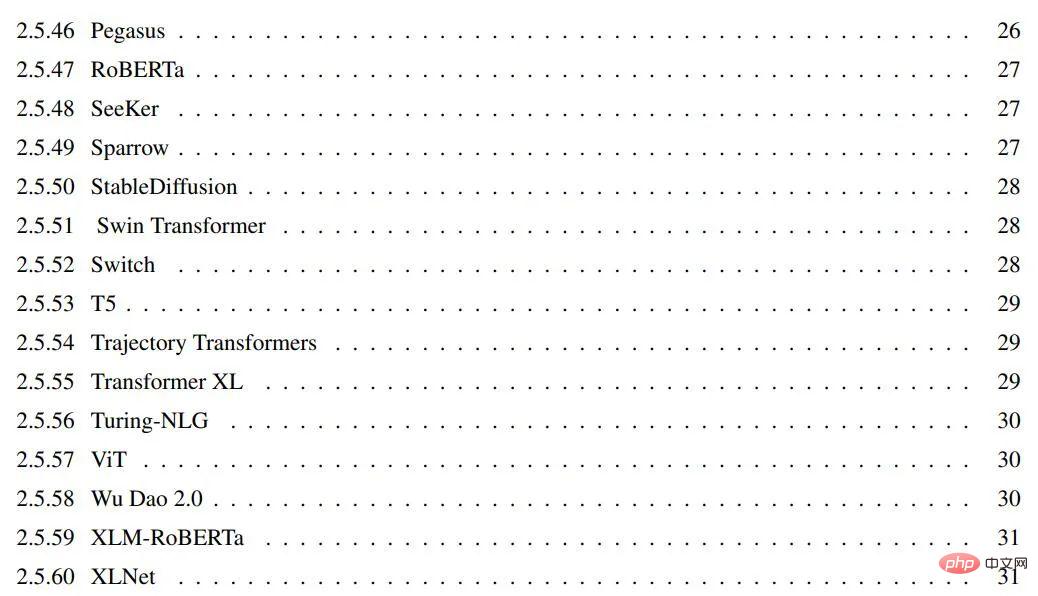

Dalam beberapa tahun lalu, satu selepas satu lagi Terdapat berpuluh-puluh model daripada keluarga Transformer, semuanya dengan nama yang menarik dan mudah difahami. Matlamat artikel ini adalah untuk menyediakan katalog dan klasifikasi yang agak komprehensif tetapi ringkas bagi model Transformer yang paling popular Selain itu, artikel ini juga memperkenalkan aspek dan inovasi yang paling penting dalam model Transformer.

Kertas kerja "Transformer models: an introduction and catalog":

Pautan kertas:

https://arxiv.org/abs/2302.07730

GitHub: https://github.com/xamat/TransformerCatalog

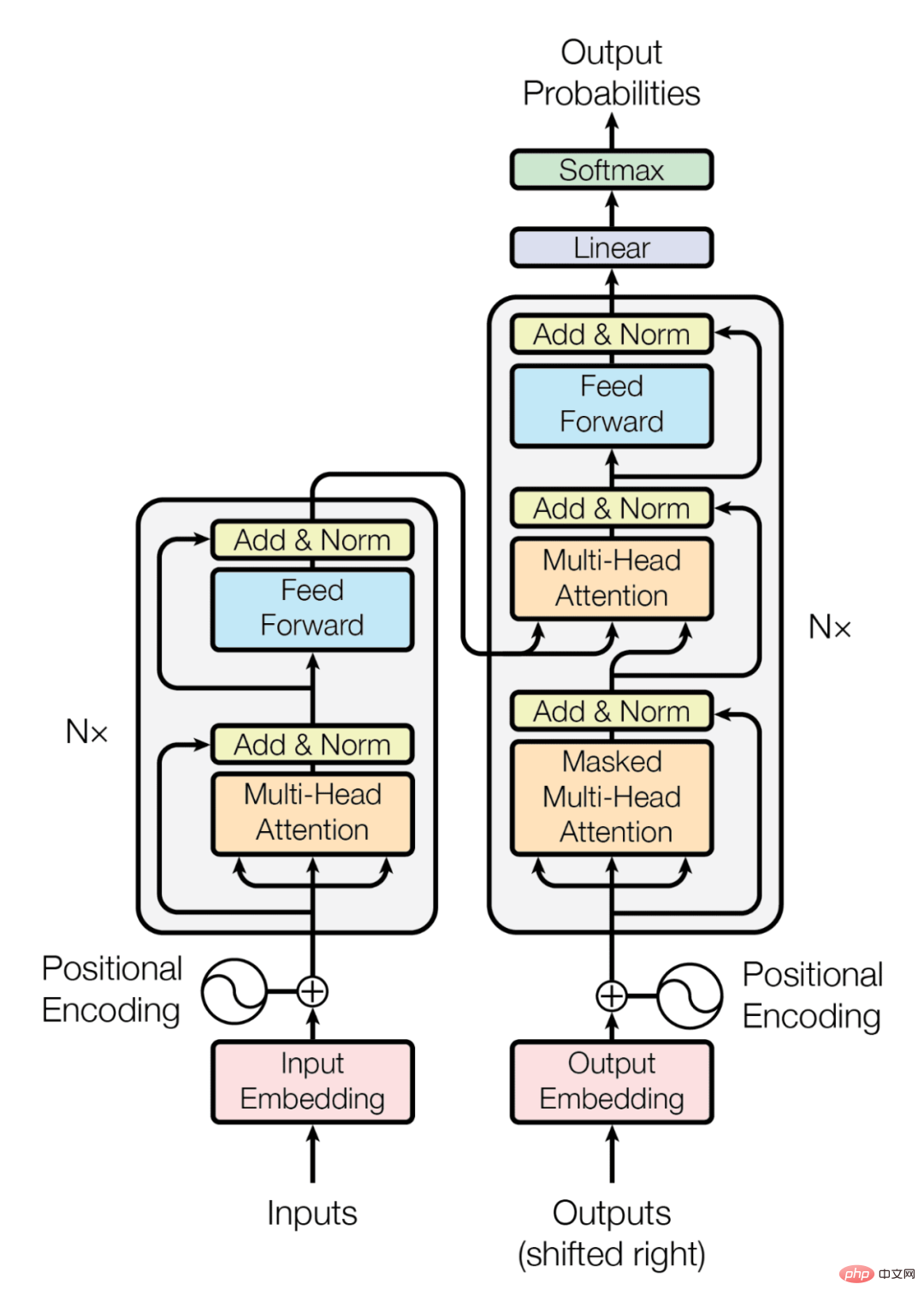

Transformer ialah kelas yang terdiri daripada beberapa model pembelajaran mendalam yang ditakrifkan oleh ciri-ciri seni bina. Pertama kali muncul dalam kertas terkenal "Perhatian adalah Semua yang Anda Perlukan" yang diterbitkan oleh penyelidik Google pada 2017 (kertas kerja ini telah dipetik lebih daripada 38,000 kali dalam masa 5 tahun sahaja) dan catatan blog yang berkaitan. Seni bina Transformer ialah contoh khusus model pengekod-penyahkod [2] yang menjadi popular 2-3 tahun lalu. Walau bagaimanapun, sehingga itu, perhatian hanyalah satu daripada mekanisme yang digunakan oleh model ini, yang kebanyakannya berdasarkan LSTM (Memori Jangka Pendek Panjang) [3] dan varian RNN (Rangkaian Neural Berulang) [4] lain. Wawasan utama kertas Transformers ialah, seperti yang dicadangkan oleh tajuk, perhatian boleh digunakan sebagai satu-satunya mekanisme untuk memperoleh kebergantungan antara input dan output. Membincangkan semua butiran seni bina Transformer adalah di luar skop blog ini. Untuk tujuan ini, artikel ini mengesyorkan merujuk kepada kertas asal di atas atau siaran Transformers, yang kedua-duanya sangat menarik. Oleh itu, artikel ini akan menerangkan secara ringkas aspek yang paling penting dan ia juga akan disebut dalam jadual kandungan di bawah. Artikel ini akan bermula dengan rajah seni bina asas dalam kertas asal, dan kemudian mengembangkan kandungan yang berkaitan.

Seni Bina Pengekod/Penyahkod

Seni Bina Pengekod/Penyahkod Universal (lihat Rajah 1) oleh Terdiri daripada dua model. Pengekod mengambil input dan mengekodnya ke dalam vektor panjang tetap. Penyahkod mengambil vektor ini dan menyahkodnya ke dalam urutan output. Pengekod dan penyahkod dilatih bersama untuk meminimumkan kemungkinan log bersyarat. Setelah dilatih, pengekod/penyahkod boleh menjana output diberikan urutan input, atau ia boleh menjaringkan urutan input/output. Dalam seni bina Transformer asal, pengekod dan penyahkod mempunyai 6 lapisan yang sama. Setiap pengekod dalam 6 lapisan ini mempunyai dua sublapisan: lapisan perhatian berbilang kepala dan rangkaian suapan hadapan yang mudah. Setiap sub-lapisan mempunyai sambungan baki dan normalisasi lapisan. Saiz output pengekod ialah 512. Penyahkod menambah sub-lapisan ketiga, yang merupakan satu lagi lapisan perhatian berbilang kepala pada output pengekod. Selain itu, satu lagi lapisan berbilang kepala dalam penyahkod bertopeng.

Rajah 1: Seni bina pengubah

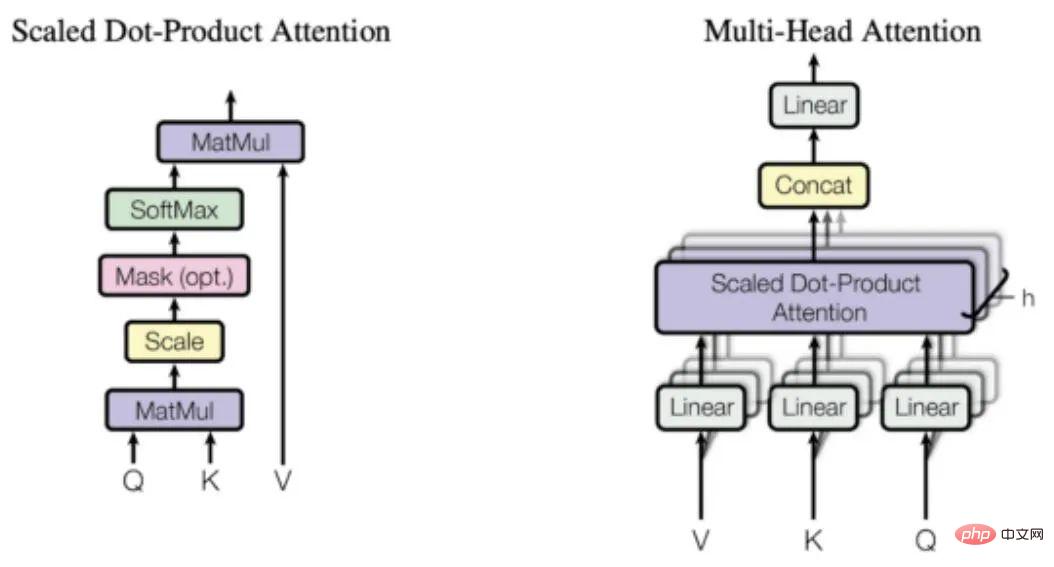

Rajah 2: Mekanisme Perhatian

Perhatian

Adalah jelas daripada huraian di atas bahawa satu-satunya elemen khas seni bina model ialah perhatian berbilang kepala, tetapi, seperti yang diterangkan di atas, di sinilah kuasa penuh model itu terletak. Jadi, apa sebenarnya perhatian? Fungsi perhatian ialah pemetaan antara pertanyaan dan set pasangan nilai kunci kepada output. Output dikira sebagai jumlah nilai wajaran, di mana berat yang diberikan kepada setiap nilai dikira oleh fungsi keserasian pertanyaan dengan kunci yang sepadan. Transformer menggunakan perhatian berbilang kepala, iaitu pengiraan selari bagi fungsi perhatian khusus yang dipanggil perhatian produk titik berskala. Untuk butiran lanjut tentang cara mekanisme perhatian berfungsi, artikel ini akan merujuk sekali lagi kepada siaran The Illustrated Transformer, dan gambar rajah daripada kertas asal akan diterbitkan semula dalam Rajah 2 untuk memahami idea utama. Lapisan perhatian mempunyai beberapa kelebihan berbanding rangkaian berulang dan konvolusi, dua yang paling penting ialah kerumitan pengiraan yang lebih rendah dan ketersambungan yang lebih tinggi, yang amat berguna untuk mempelajari kebergantungan jangka panjang dalam jujukan .

Apakah Transformer digunakan dan mengapa ia begitu popular

Transformer asal direka untuk terjemahan bahasa , terutamanya dari bahasa Inggeris ke Jerman. Walau bagaimanapun, seperti yang dapat dilihat dari kertas penyelidikan asal, seni bina digeneralisasikan dengan baik kepada tugas bahasa lain. Trend khusus ini dengan cepat menarik perhatian komuniti penyelidikan. Dalam bulan-bulan berikutnya, kebanyakan kedudukan tugasan ML yang berkaitan dengan bahasa telah dikuasai sepenuhnya oleh beberapa versi seni bina Transformer (cth., ranking SQUAD yang terkenal, di mana semua model teratas ialah koleksi Transformers ). Salah satu sebab utama Transformers dapat mendominasi kebanyakan ranking NLP dengan begitu pantas ialah keupayaan mereka untuk menyesuaikan diri dengan pantas kepada tugas lain, a.k.a. pembelajaran pemindahan. Model Transformer Pra-latihan boleh disesuaikan dengan sangat mudah dan cepat kepada tugas yang mereka tidak dilatih, yang mempunyai kelebihan yang besar. Sebagai pengamal ML, anda tidak perlu lagi melatih model besar pada set data yang besar. Apa yang anda perlu lakukan ialah menggunakan semula model terlatih dalam tugas anda, mungkin hanya mengubahnya sedikit dengan set data yang lebih kecil. Satu teknik khusus yang digunakan untuk menyesuaikan model terlatih kepada tugasan yang berbeza dipanggil penalaan halus.

Transformer terbukti sangat mudah disesuaikan dengan tugasan lain sehinggakan walaupun pada asalnya ia dibangunkan untuk tugasan yang berkaitan dengan bahasa, ia digunakan dengan cepat untuk Tugas-tugas lain terdiri daripada aplikasi visual atau audio dan muzik, sepanjang jalan. untuk bermain catur atau membuat matematik.

Sudah tentu, tiada satu pun daripada aplikasi ini boleh dilakukan jika bukan kerana banyak alatan yang membolehkan sesiapa sahaja menulis beberapa baris kod dengan mudah. Transformer bukan sahaja boleh disepadukan dengan cepat ke dalam rangka kerja kecerdasan buatan utama (iaitu Pytorch8 dan TF9), malah seluruh syarikat boleh dibina berdasarkannya. Huggingface, sebuah syarikat permulaan yang telah mengumpul lebih $60 juta setakat ini, dibina hampir keseluruhannya berdasarkan idea untuk mengkomersialkan perpustakaan Transformer sumber terbuka.

Akhir sekali, adalah perlu untuk bercakap tentang kesan GPT-3 pada Transformer pada peringkat awal popularitinya. GPT-3 ialah model Transformer yang dilancarkan oleh OpenAI pada Mei 2020 dan merupakan susulan kepada GPT dan GPT-2 mereka yang terdahulu. Syarikat itu mencipta banyak buzz dengan memperkenalkan model itu dalam pracetak, yang mereka dakwa sangat berkuasa sehingga mereka tidak dapat mengeluarkannya kepada dunia. Sejak itu, model itu bukan sahaja dikeluarkan, tetapi juga dikomersialkan melalui kerjasama besar-besaran antara OpenAI dan Microsoft. GPT-3 menyokong lebih 300 aplikasi berbeza dan merupakan asas kepada strategi perniagaan OpenAI (yang masuk akal untuk syarikat yang telah mengumpulkan lebih daripada $1 bilion dalam pembiayaan).

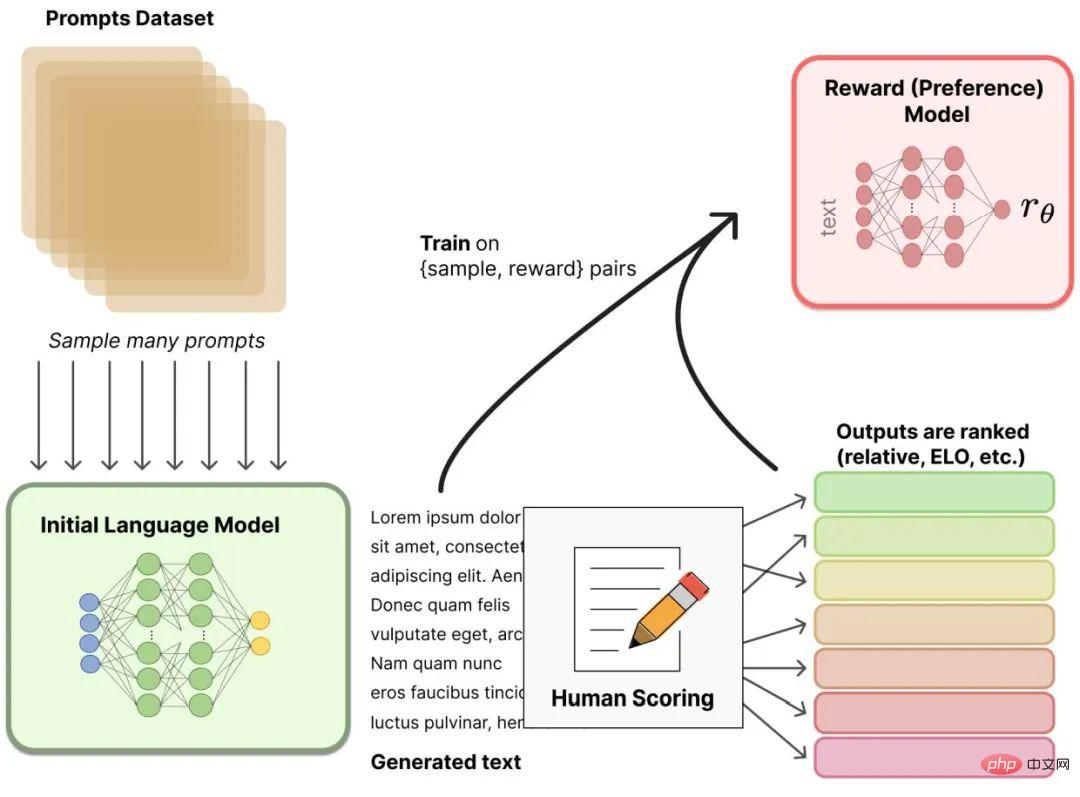

RLHF

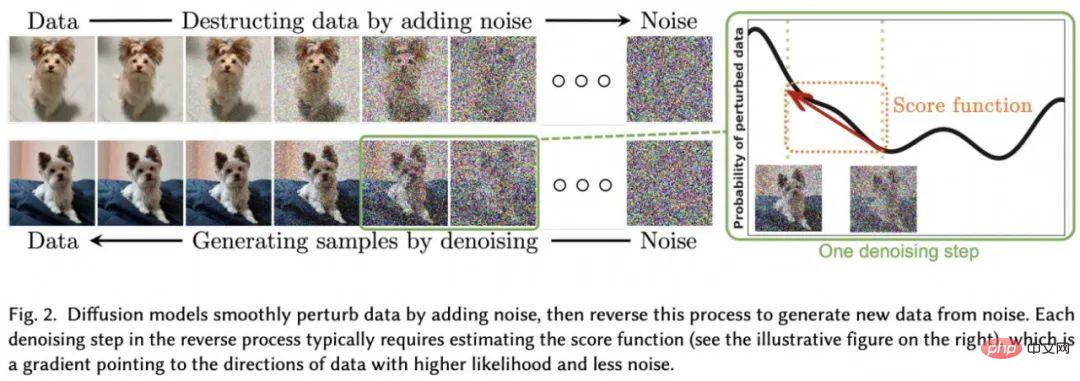

Baru-baru ini, pembelajaran peneguhan daripada maklum balas manusia (atau keutamaan) (RLHF (juga dikenali sebagai RLHP) ) telah menjadi tambahan besar kepada kit alat kecerdasan buatan Konsep ini telah dicadangkan dalam kertas kerja 2017 "Pembelajaran tetulang mendalam daripada pilihan manusia", dan baru-baru ini ia telah digunakan untuk ChatGPT dan ejen perbualan yang serupa seperti BlenderBot atau Sparrow idea adalah mudah: sebaik sahaja model bahasa telah dilatih, pengguna boleh menjana respons yang berbeza kepada perbualan dan meminta manusia menentukan kedudukan keputusan ini (aka keutamaan atau maklum balas) dalam persekitaran pembelajaran pengukuhan untuk melatih ganjaran (Lihat Rajah 3). Model penyebaran telah menjadi SOTA baharu dalam penjanaan imej, nampaknya mengetepikan kaedah sebelumnya seperti GAN (Generative Adversarial Networks). Apakah model resapan? Ia adalah kelas model pembolehubah terpendam yang dilatih dengan inferens variasi. Rangkaian yang dilatih dengan cara ini sebenarnya mempelajari ruang terpendam yang diwakili oleh imej ini (lihat Rajah 4). Model resapan berkaitan dengan model generatif lain, seperti [Generative Adversarial Networks (GAN)] 16 yang terkenal, yang telah digantikan dalam banyak aplikasi, terutamanya dengan (denoising) Autoencoder. Sesetengah pengarang juga mengatakan bahawa model resapan hanyalah contoh khusus pengekod auto. Walau bagaimanapun, mereka juga mengakui bahawa perbezaan kecil mengubah aplikasi mereka daripada perwakilan asas autokonder kepada sifat generatif model resapan semata-mata.

Rajah 3: Pembelajaran pengukuhan dengan maklum balas manusia.

Rajah 4: Seni bina model resapan kemungkinan dipetik daripada "Diffusion Model" : Tinjauan Komprehensif Kaedah dan Aplikasi》

Model yang diperkenalkan dalam artikel ini termasuk:

Atas ialah kandungan terperinci Dipetik 38,000 kali dalam tempoh lima tahun, alam semesta Transformer telah berkembang seperti ini. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Adakah kelajuan php8.0 dipertingkatkan?

Adakah kelajuan php8.0 dipertingkatkan?

Apakah maksud topeng ps?

Apakah maksud topeng ps?

Pengenalan sintaks kelajuan

Pengenalan sintaks kelajuan

Bagaimana untuk memulihkan set kepala Bluetooth kepada mod binaural

Bagaimana untuk memulihkan set kepala Bluetooth kepada mod binaural

Bagaimanakah prestasi thinkphp?

Bagaimanakah prestasi thinkphp?

apa itu web seluruh dunia

apa itu web seluruh dunia

Win11 Komputer Saya Ditambah pada Tutorial Desktop

Win11 Komputer Saya Ditambah pada Tutorial Desktop

Apakah perbezaan antara firewall perkakasan dan firewall perisian

Apakah perbezaan antara firewall perkakasan dan firewall perisian