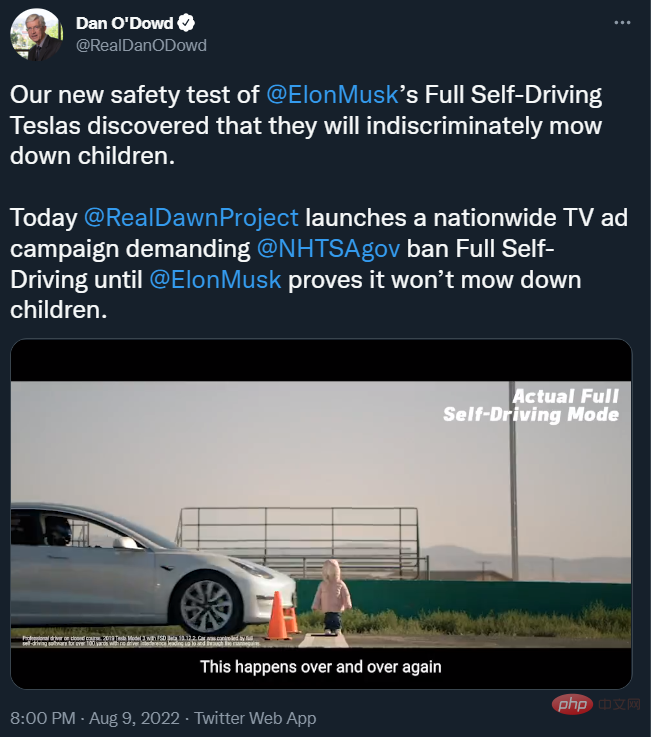

Dan O'Dowd ialah CEO syarikat pembangunan terbenam Green Hills Software Dia melancarkan acara yang dipanggil "The Dawn Project" tahun lepas untuk melarang penggunaan perisian yang tidak selamat dalam sistem selamat Ini termasuk menguji pemanduan autonomi Tesla perisian.

Untuk mensimulasikan reaksi kereta pandu sendiri apabila bertemu dengan kanak-kanak melintas jalan secara realiti, The Dawn Project baru-baru ini menjalankan ujian baharu, dan hasilnya menunjukkan bahawa dilengkapi dengan FSD Beta 10.12.2 memandu sendiri Model 3 perisian akan terkena model humanoid kanak-kanak:

Semasa ujian, Model 3 memukul model dengan kuat, menyebabkan komponen model menjadi Pemisahan:

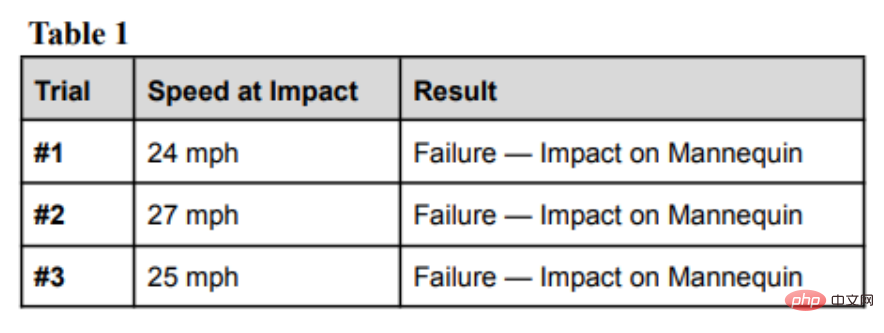

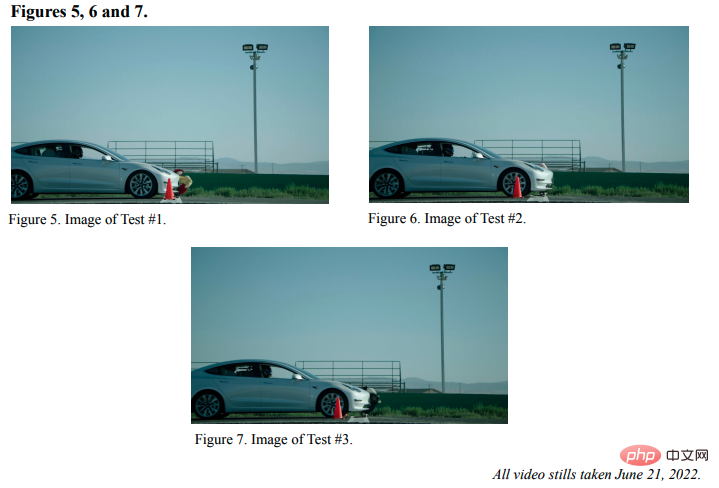

Pasukan projek menguji 3 kali dan memukul peragawati setiap kali. Ini nampaknya bukan lagi kemalangan, menunjukkan bahawa sistem FSD Model 3 mempunyai bahaya keselamatan.

Mari kita lihat proses khusus ujian.

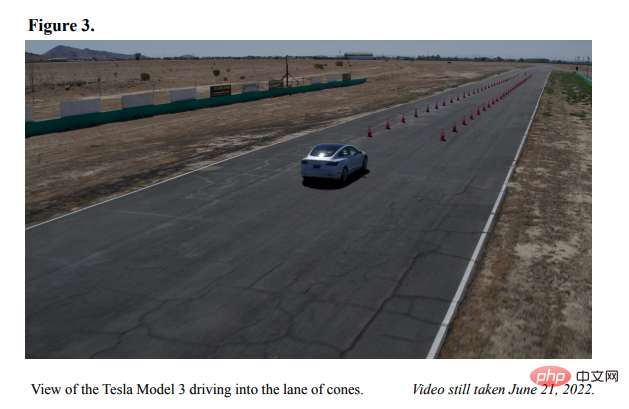

Untuk menjadikan persekitaran ujian lebih kondusif kepada sistem FSD Tesla, sebagai tambahan kepada model kenderaan dan humanoid, terdapat pembolehubah lain di jalan raya yang mungkin menjejaskan ujian telah dikeluarkan.

Kon trafik standard diletakkan pada kedua-dua belah trek ujian, dan patung bersaiz kanak-kanak diletakkan di tengah-tengah hujung trek ujian, sama seperti kanak-kanak cuba untuk lintas jalan. Semasa ujian, pemandu ujian profesional mula-mula meningkatkan kelajuan kereta kepada 40 batu sejam. Sebaik sahaja kenderaan memasuki trek ujian, ia bertukar kepada mod FSD, dan pemandu tidak lagi mengendalikan stereng, juga tidak memijak pemecut atau brek.

Model 3 FSD Beta 10.12.2 mempunyai kelajuan awal 40 mph apabila memasuki mod FSD. Dalam 3 ujian, Model 3 memukul model humanoid di hadapan Kelajuan apabila perlanggaran berlaku adalah seperti yang ditunjukkan dalam jadual di bawah

Laporan pemandu menunjukkan: Tesla Model 3 FSD Beta 10.12.2 bertindak seperti hilang dalam mod FSD, perlahan sedikit, kemudian memecut semula selepas menumbangkan model humanoid, dan kelajuan pada masa impak adalah kira-kira 25 mph.

Keputusan ini bercanggah dengan dakwaan lama Musk bahawa FSD selamat. Musk tweet pada Januari tahun ini: "Tiada kemalangan yang disebabkan oleh Tesla FSD," yang tidak berlaku. Berpuluh-puluh pemandu telah memfailkan aduan keselamatan dengan Pentadbiran Keselamatan Lalu Lintas Lebuhraya Kebangsaan berhubung kemalangan yang melibatkan FSD, lapor Los Angeles Times.

Bulan lepas, Jabatan Kenderaan Bermotor California (DMV) turut menuduh Tesla secara palsu mempromosikan ciri Autopilot dan FSDnya.

Walaupun FSD mendakwa sebagai autonomi sepenuhnya, ia sebenarnya hanya beroperasi sebagai alat tambah pilihan, dengan fungsi utamanya ialah menukar lorong secara automatik, keluar masuk lebuh raya serta mengenali tanda berhenti dan isyarat lalu lintas. Perisian ini masih dalam ujian beta, tetapi mempunyai lebih daripada 100,000 pelanggan yang telah membelinya, dengan siapa Tesla sedang menguji perisian dalam masa nyata dan cuba mendapatkan sistem AI untuk belajar daripada pemandu berpengalaman.

Atas ialah kandungan terperinci Kereta pandu sendiri sepenuhnya Tesla melanggar boneka kanak-kanak tiga kali dan tidak berhenti dan memecut semula selepas perlanggaran. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Apakah kemahiran yang diperlukan untuk bekerja dalam industri PHP?

Apakah kemahiran yang diperlukan untuk bekerja dalam industri PHP?

Apa yang perlu dilakukan jika suhu CPU terlalu tinggi

Apa yang perlu dilakukan jika suhu CPU terlalu tinggi

Apakah perisian sistem

Apakah perisian sistem

Bagaimana untuk membeli dan menjual Bitcoin secara sah

Bagaimana untuk membeli dan menjual Bitcoin secara sah

Apakah parameter marquee?

Apakah parameter marquee?

Bagaimana untuk memuat turun pemacu tetikus Razer

Bagaimana untuk memuat turun pemacu tetikus Razer

Bina pelayan git anda sendiri

Bina pelayan git anda sendiri

0x80070057 penyelesaian ralat parameter

0x80070057 penyelesaian ralat parameter