Pembelajaran pengukuhan berbilang ejen (MARL) ialah masalah mencabar yang bukan sahaja memerlukan mengenal pasti hala tuju penambahbaikan dasar bagi setiap ejen, tetapi juga memerlukan penggabungan kemas kini polisi ejen individu untuk meningkatkan prestasi Keseluruhan. Baru-baru ini, masalah ini pada mulanya telah diselesaikan, dan beberapa penyelidik telah memperkenalkan kaedah pelaksanaan terdesentralisasi latihan berpusat (CTDE), yang membolehkan ejen mengakses maklumat global semasa fasa latihan. Walau bagaimanapun, kaedah ini tidak dapat merangkumi kerumitan penuh interaksi berbilang ejen.

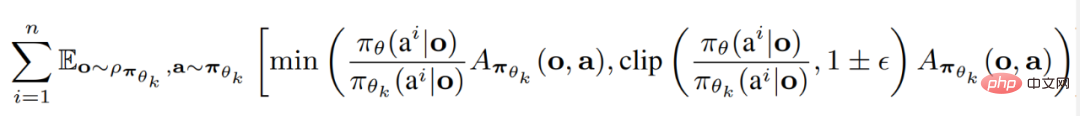

Malah, beberapa kaedah ini telah terbukti gagal. Untuk menyelesaikan masalah ini, seseorang mencadangkan teorem penguraian dominasi berbilang agen. Atas dasar ini, algoritma HATRPO dan HAPPO diperolehi. Walau bagaimanapun, terdapat batasan untuk pendekatan ini, yang masih bergantung pada objektif pemaksimum yang direka dengan teliti.

Dalam beberapa tahun kebelakangan ini, model jujukan (SM) telah mencapai kemajuan yang ketara dalam bidang pemprosesan bahasa semula jadi (NLP). Sebagai contoh, siri GPT dan BERT berprestasi baik pada pelbagai tugas hiliran dan mencapai prestasi yang kukuh pada tugas generalisasi sampel kecil.

Memandangkan model jujukan secara semulajadi sesuai dengan ciri jujukan bahasa, ia boleh digunakan untuk tugas bahasa, tetapi kaedah jujukan tidak terhad kepada tugas NLP, tetapi merupakan model asas umum yang boleh digunakan secara meluas. Sebagai contoh, dalam penglihatan komputer (CV), seseorang boleh membahagikan imej kepada subimej dan menyusunnya dalam urutan seolah-olah ia adalah token dalam tugasan NLP. Model terkini yang lebih terkenal seperti Flamingo, DALL-E, GATO, dll. semuanya mempunyai bayangan kaedah jujukan.

Dengan kemunculan seni bina rangkaian seperti Transformer, teknologi pemodelan jujukan juga telah menarik perhatian besar daripada komuniti RL, yang telah mempromosikan satu siri pembangunan RL luar talian berdasarkan seni bina Transformer. Kaedah ini menunjukkan potensi besar dalam menyelesaikan beberapa masalah latihan RL yang paling asas.

Walaupun kejayaan ketara kaedah ini, tiada satu pun yang direka bentuk untuk memodelkan aspek paling sukar (dan unik kepada MARL) bagi sistem berbilang ejen - Interaksi antara ejen. Malah, jika kita hanya memberi semua ejen polisi Transformer dan melatih mereka secara individu, ini masih tidak dijamin untuk meningkatkan prestasi bersama MARL. Oleh itu, walaupun terdapat sejumlah besar model jujukan berkuasa yang tersedia, MARL tidak benar-benar memanfaatkan prestasi model jujukan.

Bagaimana untuk menggunakan model jujukan untuk menyelesaikan masalah MARL? Penyelidik dari Universiti Shanghai Jiao Tong, Makmal Otak Digital, Universiti Oxford, dsb. mencadangkan seni bina Transformer (MAT, Multi-Agent Transformer) baharu, yang boleh mengubah masalah MARL kolaboratif dengan berkesan kepada masalah model jujukan Ia memetakan turutan pemerhatian ejen kepada urutan tindakan optimum ejen.

Matlamat kertas kerja ini adalah untuk membina jambatan antara MARL dan SM untuk membuka kunci keupayaan pemodelan model jujukan moden untuk MARL. Teras MAT ialah seni bina penyahkod pengekod, yang menggunakan teorem penguraian kelebihan berbilang ejen untuk mengubah masalah carian strategi bersama menjadi proses membuat keputusan yang berurutan, supaya masalah berbilang ejen akan mempamerkan kerumitan masa linear, dan kebanyakannya. yang penting, Melakukannya memastikan peningkatan prestasi monotonik MAT. Tidak seperti teknik sebelumnya seperti Decision Transformer yang memerlukan data luar talian yang dikumpul terlebih dahulu, MAT dilatih secara strategik dalam talian melalui percubaan dan kesilapan dalam talian dari persekitaran.

Untuk mengesahkan MAT, penyelidik menjalankan eksperimen yang meluas pada penanda aras StarCraftII, Multi-Agent MuJoCo, Dexterous Hands Manipulation dan Google Research Football. Keputusan menunjukkan bahawa MAT mempunyai prestasi dan kecekapan data yang lebih baik berbanding garis dasar yang kukuh seperti MAPPO dan HAPPO. Di samping itu, kajian ini juga membuktikan bahawa tidak kira bagaimana bilangan ejen berubah, MAT melakukan lebih baik pada tugas yang tidak kelihatan, tetapi ia boleh dikatakan sebagai pelajar sampel kecil yang sangat baik.

Dalam bahagian ini, penyelidik mula-mula memperkenalkan formula masalah MARL kolaboratif dan teorem penguraian kelebihan berbilang ejen, yang merupakan asas artikel ini. Kemudian, mereka menyemak kaedah MARL berkaitan MAT sedia ada, akhirnya membawa kepada Transformer.

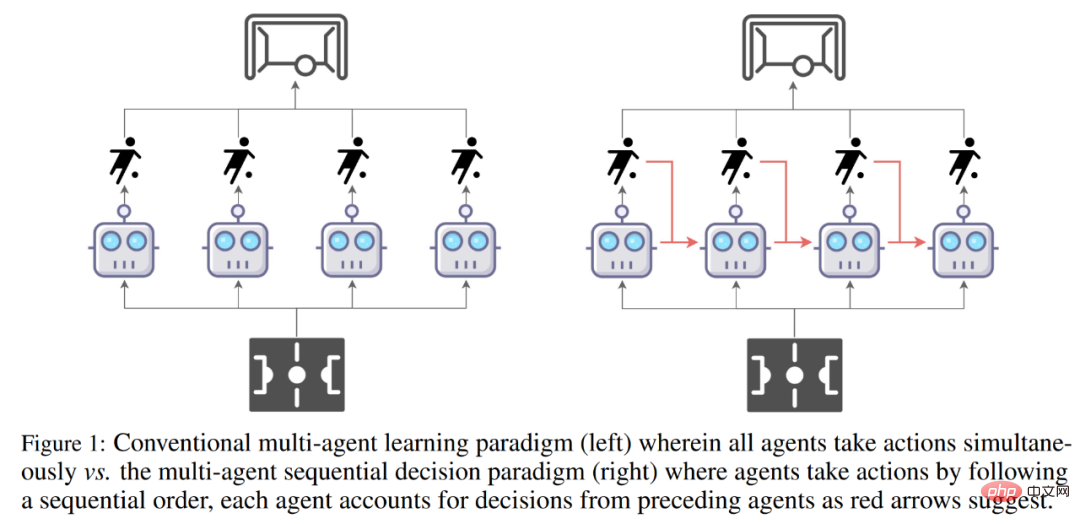

Perbandingan paradigma pembelajaran berbilang ejen tradisional (kiri) dan paradigma membuat keputusan jujukan berbilang ejen (kanan).

Masalah MARL Kolaboratif biasanya terdiri daripada proses keputusan Markov yang boleh diperhatikan secara diskret (Dis-POMDP)  Datang dan buat model.

Datang dan buat model.

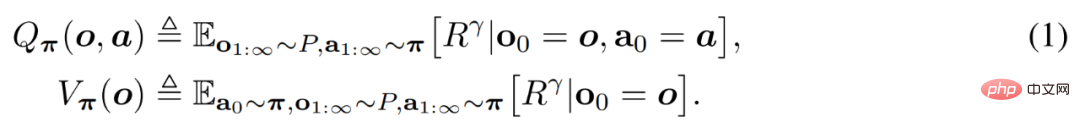

Ejen menilai nilai tindakan dan pemerhatian melalui Q_π(o, a) dan V_π(o), yang ditakrifkan sebagai mengikuti.

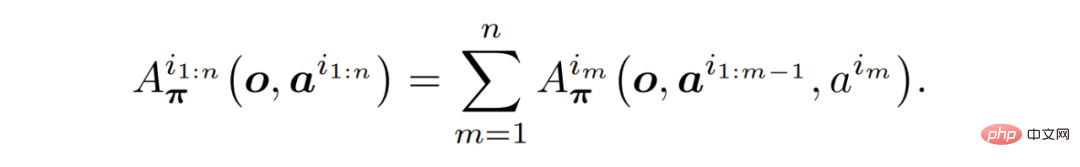

Teorem 1 (Penguraian Kelebihan Berbilang Agen): Biarkan i_1:n menjadi susunan ejen. Formula berikut sentiasa berlaku tanpa andaian lanjut.

Yang penting, Teorem 1 menyediakan gerak hati tentang cara memilih tindakan peningkatan tambahan.

Para penyelidik meringkaskan dua algoritma SOTA MARL semasa, yang kedua-duanya dibina pada Pengoptimuman Dasar Proksimal (PPO) . PPO ialah kaedah RL yang terkenal dengan kesederhanaan dan kestabilan prestasinya.

Pengoptimuman dasar proksimal berbilang ejen (MAPPO) ialah kaedah pertama dan paling mudah untuk menggunakan PPO pada MARL.

Pengoptimuman Dasar Proksimal Agen Heterogen (HAPPO) ialah salah satu daripada algoritma SOTA semasa, yang boleh menggunakan sepenuhnya Teorem (1) untuk Mencapai pembelajaran domain amanah berbilang ejen dengan jaminan pengangkatan monotonik.

Model Transformer

Berdasarkan apa yang diterangkan dalam Teorem ( 1) Sifat jujukan dan prinsip di sebalik HAPPO kini boleh dipertimbangkan secara intuitif untuk menggunakan model Transformer untuk melaksanakan pembelajaran domain amanah berbilang ejen. Dengan menganggap pasukan ejen sebagai urutan, seni bina Transformer membenarkan pemodelan pasukan ejen dengan nombor dan jenis berubah-ubah sambil mengelakkan kekurangan MAPPO/HAPPO.

Untuk merealisasikan paradigma pemodelan jujukan MARL, penyelesaian yang disediakan oleh penyelidik ialah Transformer berbilang ejen (MAT). Idea untuk menggunakan seni bina Transformer berpunca daripada fakta bahawa ejen memerhatikan hubungan antara input jujukan (o^i_1,..., o^i_n) dan output jujukan tindakan (a^i_1, . ., a^i_n) Pemetaan ialah tugas pemodelan urutan yang serupa dengan terjemahan mesin. Apabila Teorem (1) mengelak, tindakan a^i_m bergantung pada keputusan sebelumnya semua agen a^i_1:m−1.

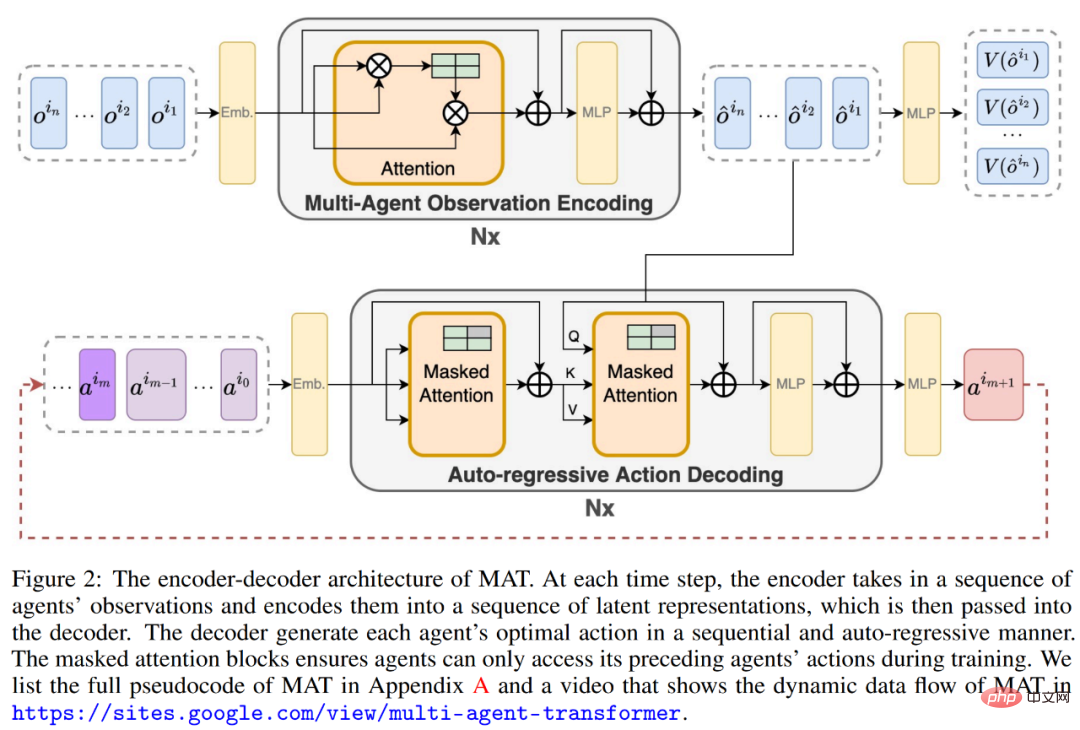

Oleh itu, seperti yang ditunjukkan dalam Rajah (2) di bawah, MAT mengandungi pengekod untuk mempelajari perwakilan pemerhatian bersama dan kaedah autoregresif untuk mengeluarkan tindakan bagi setiap ejen.

Parameter pengekod diwakili oleh φ, yang memperoleh urutan pemerhatian dalam sebarang susunan (o^i_1 , . . . , o^i_n) dan melepasinya melalui beberapa blok pengiraan. Setiap blok terdiri daripada mekanisme perhatian kendiri, perceptron berbilang lapisan (MLP) dan sambungan baki untuk mengelakkan kecerunan lenyap dan degradasi rangkaian dengan kedalaman yang semakin meningkat.

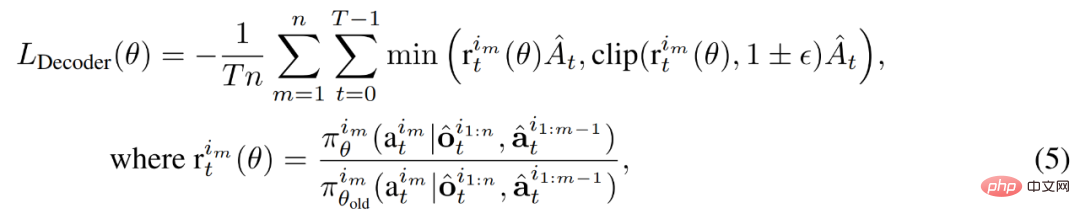

Parameter penyahkod diwakili oleh θ, yang akan membenamkan tindakan bersama a^i_0:m−1, m = {1, i_0 ialah Sebarang simbol yang menunjukkan permulaan penyahkodan) dihantar ke jujukan blok penyahkodan. Yang penting, setiap blok penyahkodan mempunyai mekanisme perhatian diri yang bertopeng. Untuk melatih penyahkod, kami meminimumkan objektif PPO yang dipangkas seperti berikut.

Aliran data terperinci dalam MAT ditunjukkan dalam animasi di bawah.

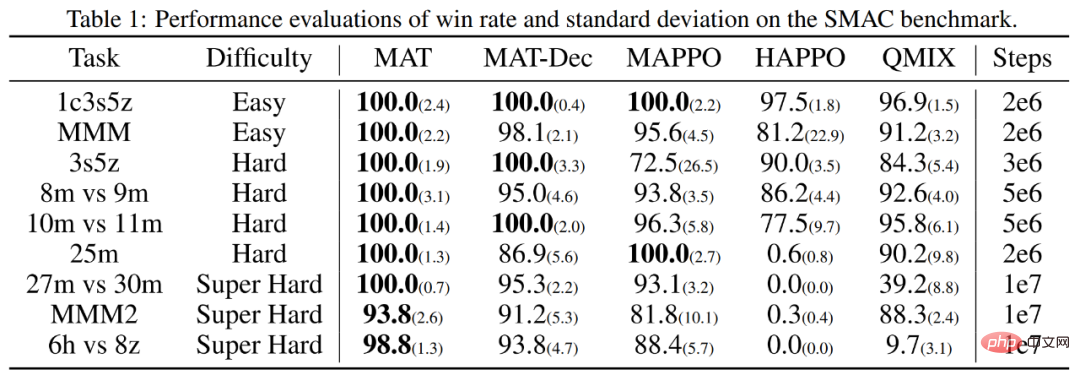

Untuk menilai sama ada MAT memenuhi jangkaan, penyelidik menguji penanda aras StarCraft II Multi-Agent Challenge (SMAC) (MAPPO pada bahagian atas MAT telah diuji pada penanda aras MuJoCo berbilang ejen (di mana HAPPO mempunyai prestasi SOTA).

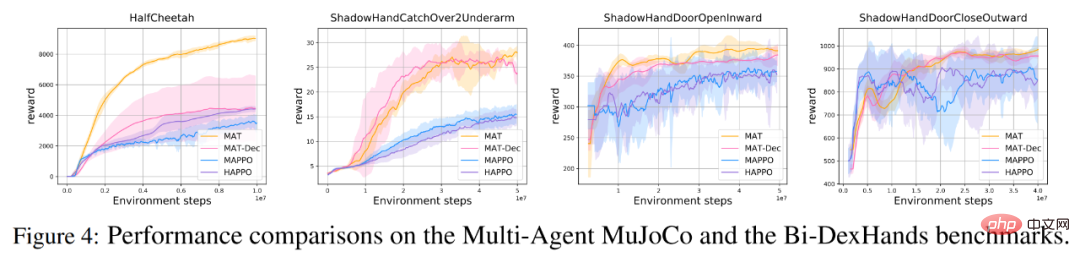

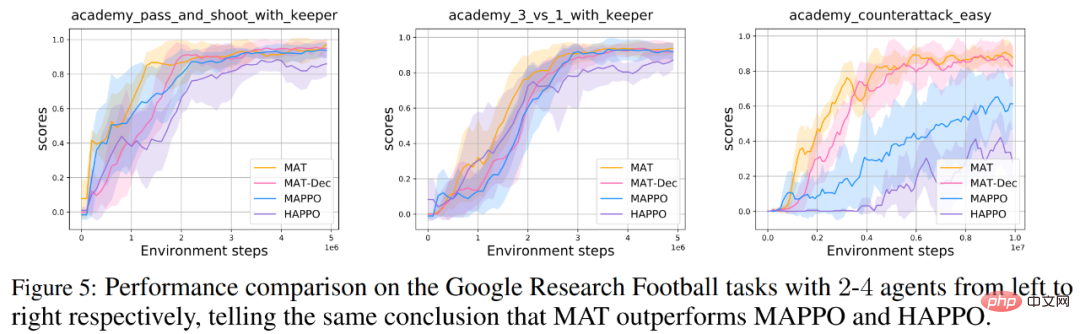

Selain itu, para penyelidik juga menjalankan ujian lanjutan pada MAT pada Bimanual Dxterous Manipulation Hand (Bi-DexHands) dan penanda aras Google Research Football. Yang pertama menawarkan pelbagai tugas dua tangan yang mencabar, dan yang kedua menawarkan pelbagai senario kerjasama dalam permainan bola sepak.

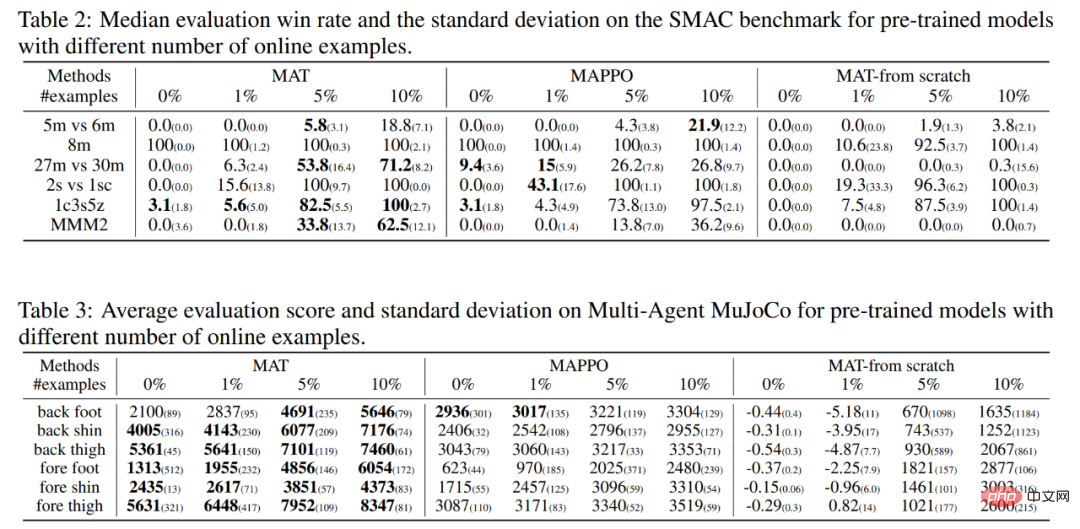

Akhir sekali, memandangkan model Transformer biasanya menunjukkan prestasi generalisasi yang kuat pada tugasan sampel kecil, para penyelidik percaya bahawa MAT juga boleh mempunyai prestasi hebat yang serupa pada keupayaan Generalisasi yang tidak kelihatan. Oleh itu, mereka mereka bentuk percubaan sifar pukulan dan pukulan kecil pada tugas SMAC dan pelbagai ejen MuJoCo.

Seperti yang ditunjukkan dalam Jadual 1 dan Rajah 4 di bawah, untuk penanda aras SMAC, MuJoCo berbilang ejen dan Bi-DexHands, MAT ialah Ia adalah jauh lebih baik daripada MAPPO dan HAPPO pada hampir semua tugas, menunjukkan keupayaan pembinaannya yang berkuasa pada tugas ejen homogen dan heterogen. Tambahan pula, MAT juga mencapai prestasi yang lebih baik daripada MAT-Dec, menunjukkan kepentingan seni bina penyahkod dalam reka bentuk MAT.

Begitu juga, penyelidik melakukan penanda aras Google Research Football Serupa keputusan prestasi diperolehi, seperti yang ditunjukkan dalam Rajah 5 di bawah.

Sampel sifar dan beberapa pukulan untuk setiap algoritma diringkaskan dalam Jadual 2 dan 3 Keputusan, di mana nombor tebal menunjukkan prestasi terbaik.

Para penyelidik juga menyediakan prestasi MAT dengan data yang sama, yang dilatih dari awal seperti kumpulan kawalan. Seperti yang ditunjukkan dalam jadual di bawah, MAT mencapai kebanyakan keputusan terbaik, yang menunjukkan prestasi generalisasi yang kukuh bagi pembelajaran beberapa pukulan MAT.

Atas ialah kandungan terperinci Penanda aras konfrontasi koperasi StarCraft II melepasi SOTA, seni bina Transformer baharu menyelesaikan masalah pembelajaran pengukuhan pelbagai ejen. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Kaedah penugasan tatasusunan rentetan

Kaedah penugasan tatasusunan rentetan

Mengapa melumpuhkan kemas kini automatik dalam Windows 11 adalah tidak sah

Mengapa melumpuhkan kemas kini automatik dalam Windows 11 adalah tidak sah

Bagaimana untuk membenamkan gaya CSS dalam HTML

Bagaimana untuk membenamkan gaya CSS dalam HTML

Perbezaan antara telefon gantian rasmi dan telefon baharu

Perbezaan antara telefon gantian rasmi dan telefon baharu

Tidak dapat membuka gedung aplikasi

Tidak dapat membuka gedung aplikasi

Peranan fungsi parseint

Peranan fungsi parseint

Pengesyoran perisian desktop Android

Pengesyoran perisian desktop Android

Harga pasaran Ethereum hari ini

Harga pasaran Ethereum hari ini