Sintesis paparan ialah masalah utama di persimpangan penglihatan komputer dan grafik komputer Ia merujuk kepada mencipta pemandangan baharu daripada berbilang gambar tempat kejadian.

Untuk mensintesis pandangan baharu sesuatu pemandangan dengan tepat, model perlu menangkap berbilang jenis maklumat daripada set kecil imej rujukan, seperti struktur 3D terperinci , bahan dan pencahayaandsb.

Memandangkan penyelidik mencadangkan model Neural Radiation Field (NeRF) model pada 2020, isu ini turut mendapat perhatian yang semakin meningkat, sekali gus menggalakkan pandangan baharu Prestasi sintetik.

Salah satu pemain hebat ialah Google, yang juga telah menerbitkan banyak kertas kerja dalam bidang NeRF ini akan memperkenalkan dua kertas A yang diterbitkan oleh Google di CVPR 2022 dan ECCV 2022, menceritakan evolusi model pemaparan saraf medan cahaya.

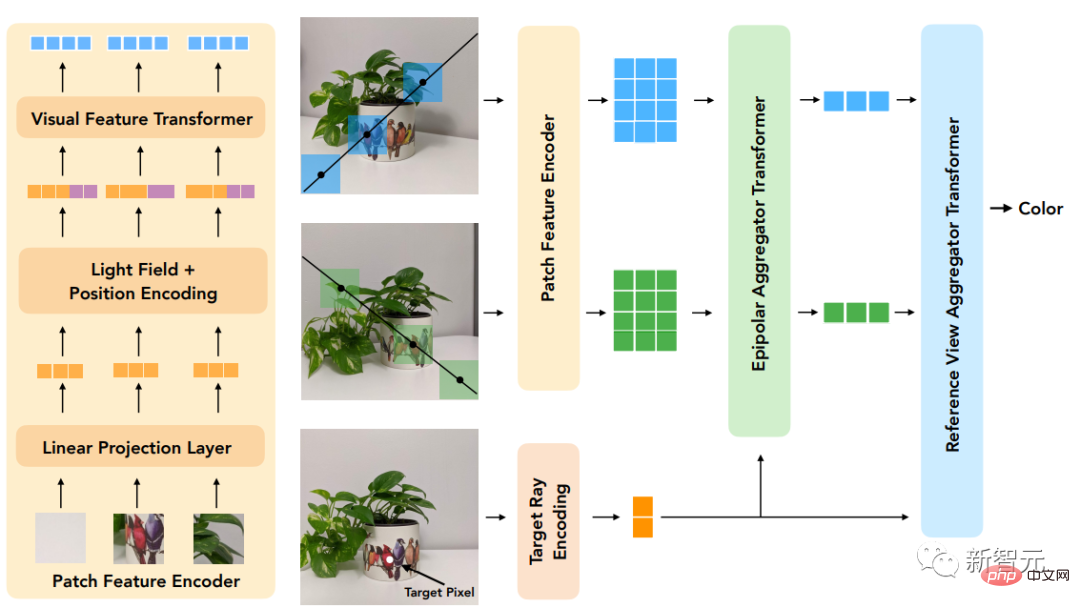

Kertas pertama mencadangkan model dua peringkat berdasarkan Transformer untuk belajar menggabungkan warna piksel rujukan, mula-mula mendapatkan ciri di sepanjang garis epipolar, Ciri di sepanjang paparan rujukan kemudiannya diperoleh untuk menghasilkan warna sinar sasaran, meningkatkan ketepatan pembiakan pandangan .

Pautan kertas: https://arxiv.org/pdf/2112.09687.pdf

KlasikRendering Medan Cahaya boleh menghasilkan semula dengan tepat kesan berkaitan pandangan seperti pantulan, pembiasan dan lutsinar, tetapi memerlukan pensampelan pandangan padat pemandangan. Kaedah berdasarkan pembinaan semula geometri hanya memerlukan pandangan yang jarang tetapi tidak dapat memodelkan kesan bukan Lambertian dengan tepat, iaitu taburan bukan ideal .

Model baharu yang dicadangkan dalam artikel itu menggabungkan kelebihan kedua-dua arah ini dan meringankan batasannya, dengan memfokuskan pada cahaya Dengan memanipulasi perwakilan empat dimensi medan, model boleh belajar untuk mewakili kesan bergantung pada paparan dengan tepat. Geometri pemandangan dipelajari secara tersirat daripada set pandangan yang jarang dengan menguatkuasakan kekangan geometri semasa latihan dan inferens.

Model ini mengatasi model terkini pada pelbagai set data hadapan dan 360° serta mempunyai pergantungan yang teruk pada garisan penglihatan Terdapat kelonggaran yang lebih besar dalam adegan perubahan seksual.

Masalah lain menangani masalah generalisasi mensintesis adegan ghaib dengan menggunakan jujukan Transformer dengan pengekodan kedudukan berkanun . Selepas model dilatih pada set adegan, ia boleh digunakan untuk mensintesis pandangan adegan baharu.

Pautan kertas: https://arxiv.org/pdf/2207.10662.pdf

Artikel mencadangkan paradigma berbeza yang tidak memerlukan ciri kedalaman dan pemaparan volum seperti NeRF Kaedah ini boleh meramalkan secara langsung warna sinar sasaran dalam adegan baharu dengan hanya mengambil sampel set tampalan dari tempat kejadian.

Mula-mula gunakan geometri epipolar untuk mengekstrak patch di sepanjang garisan epipolar setiap paparan rujukan, dan tambahkan setiap patch yang diunjurkan secara linear menjadi satu -vektor ciri dimensi, set ini kemudiannya diproses oleh satu siri Transformer.

Untuk pengekodan kedudukan, penyelidik menggunakan kaedah yang serupa dengan kaedah perwakilan medan cahaya untuk memparameterkan sinar Perbezaannya ialah koordinat dinormalkan berbanding dengan sinar sasaran, dan Menjadikan kaedah bebas daripada bingkai rujukan dan meningkatkan keluasan .

Inti inovasi model ialah ia melaksanakan pemaparan berasaskan imej, menggabungkan warna dan ciri imej rujukan untuk memberikan paparan baharu , dan ia adalah semata-mata Ia berdasarkan Transformer dan beroperasi pada set tampalan imej. Dan mereka menggunakan perwakilan medan cahaya 4D untuk pengekodan kedudukan, membantu mensimulasikan kesan berkaitan paparan.

Hasil percubaan akhir menunjukkan bahawa kaedah ini mengatasi kaedah lain dalam sintesis paparan baharu bagi adegan ghaib, walaupun apabila dilatih dengan data yang jauh lebih sedikit daripada .

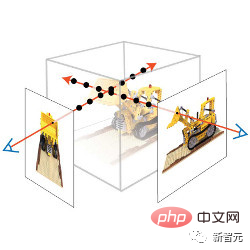

Rendering Neural Medan CahayaInput kepada model terdiri daripada set imej rujukan, parameter kamera yang sepadan (panjang fokus, kedudukan dan orientasi ruang), dan maklumat yang pengguna ingin tentukan Koordinat sinar sasaran warna.

Untuk menghasilkan imej baharu, kita perlu bermula dengan parameter kamera imej input, mula-mula dapatkan koordinat sinar sasaran (setiap satu sepadan dengan piksel), dan untuk setiap pertanyaan Model koordinat.

Penyelesaian penyelidik adalah untuk tidak memproses sepenuhnya setiap imej rujukan, tetapi hanya melihat kawasan yang mungkin mempengaruhi piksel sasaran. Kawasan ini boleh ditentukan oleh geometri epipolar, memetakan setiap piksel sasaran ke garisan pada setiap bingkai rujukan.

Demi keselamatan, anda perlu memilih kawasan kecil di sekeliling beberapa titik pada garisan epipolar untuk membentuk satu set tampalan yang akan diproses sebenarnya oleh model, dan kemudian gunakan Transformer kepada set tampalan ini Dapatkan warna piksel sasaran.

Transformer amat berguna dalam kes ini kerana mekanisme perhatian kendiri di dalamnya secara semula jadi boleh mengambil koleksi tampalan sebagai input dan berat perhatian itu sendiri Ia boleh digunakan untuk meramalkan warna piksel keluaran dengan menggabungkan warna dan ciri paparan rujukan.

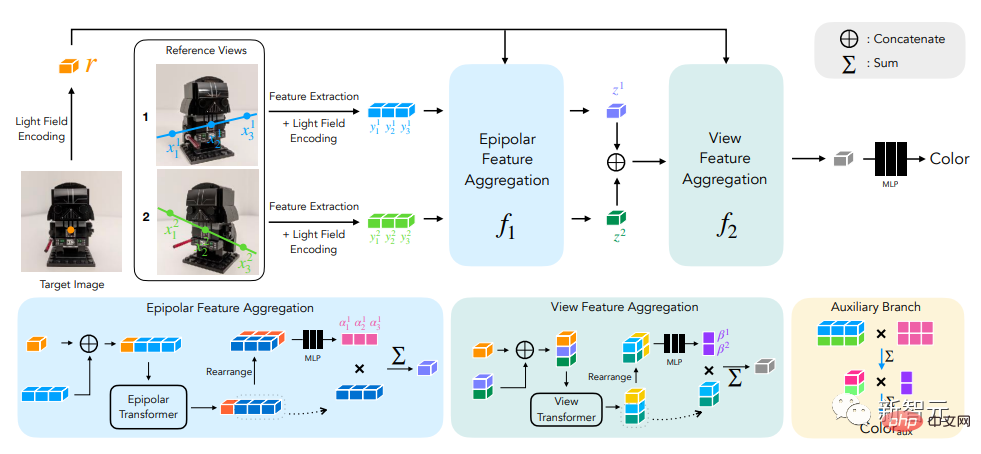

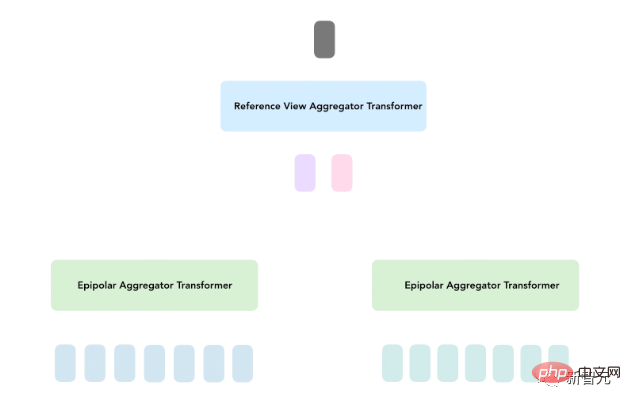

Dalam pemaparan saraf medan cahaya (LFNR), penyelidik menggunakan dua jujukan Transformer untuk memetakan koleksi tampalan untuk menyasarkan warna piksel.

Pengubah pertama mengagregatkan maklumat sepanjang setiap garisan epipolar, dan Transformer kedua mengagregatkan maklumat di sepanjang setiap imej rujukan.

Kaedah ini boleh mentafsirkan Transformer pertama sebagai mencari korespondensi berpotensi piksel sasaran pada setiap bingkai rujukan, manakala Transformer kedua bertanggungjawab untuk kesan ketergantungan oklusi dan garis pandang. penaakulan, yang juga merupakan kesukaran biasa dengan pemaparan berasaskan imej.

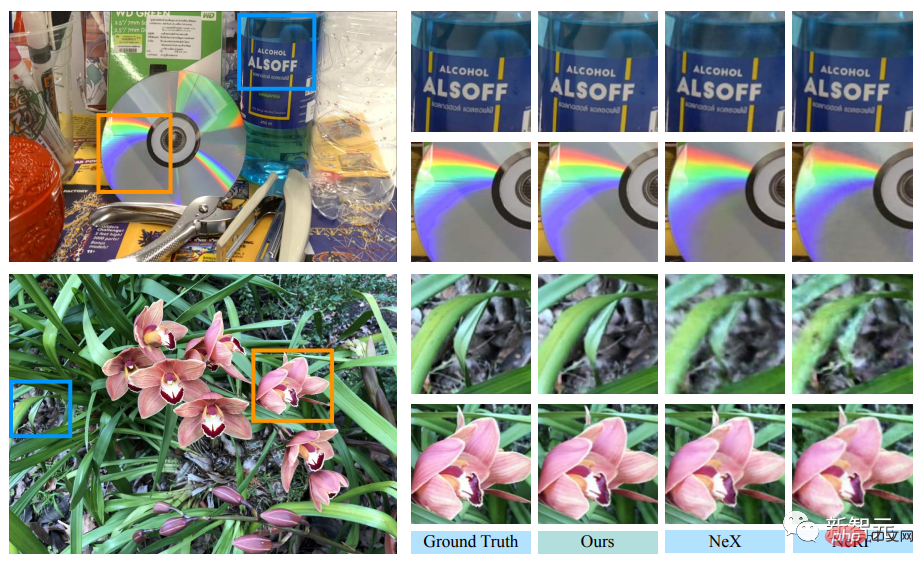

LFNR mengatasi model sota pada penanda aras sintesis paparan yang paling popular (Adegan NeRF’s Blender dan Real Forward-Facing dan NeX’s Shiny The peak). nisbah -kepada-bunyi (PSNR) dipertingkatkan sehingga 5dB, yang bersamaan dengan mengurangkan ralat tahap piksel sebanyak 1.8 kali.

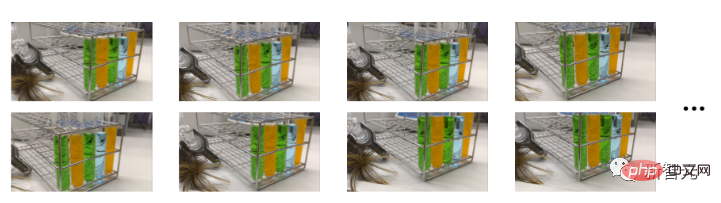

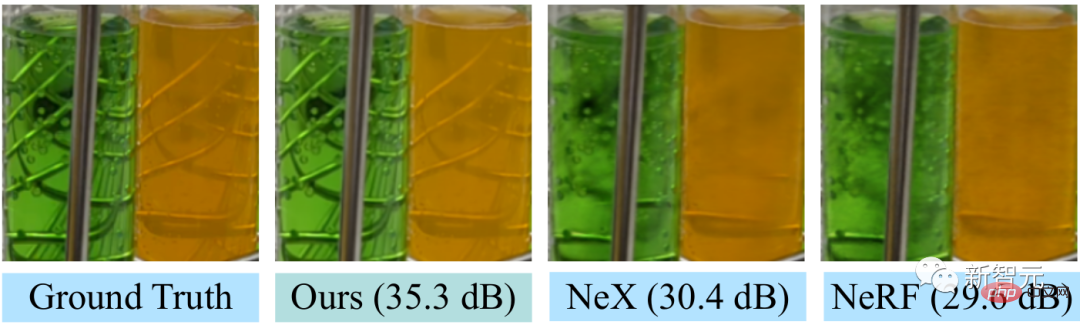

LFNR boleh menghasilkan semula beberapa kesan yang bergantung kepada garis penglihatan yang lebih sukar dalam set data NeX/Shiny, seperti pelangi dan pantulan pada CD, pantulan, pembiasan dan lutsinar pada botol .

Berbanding dengan kaedah sebelumnya seperti NeX dan NeRF, mereka tidak dapat menghasilkan semula kesan berkaitan garis penglihatan, seperti dalam NeX /Dataset berkilat Ketelusan dan indeks biasan tabung uji dalam adegan makmal.

Tetapi LFNR juga mempunyai had.

Transformer pertama melipat maklumat di sepanjang setiap garisan epipolar secara bebas untuk setiap imej rujukan, yang juga bermakna model hanya boleh menentukan maklumat yang perlu dikekalkan berdasarkan koordinat sinar keluaran dan tampalan setiap imej rujukan , yang berfungsi baik dalam latihan pada satu adegan (seperti kebanyakan kaedah rendering saraf), tetapi ia tidak boleh digeneralisasikan kepada adegan yang berbeza.

Model yang boleh digeneralisasikan adalah penting kerana ia boleh digunakan terus pada senario baharu tanpa latihan semula.

Para penyelidik mencadangkan model pemaparan saraf (GPNR) berasaskan patch umum untuk menyelesaikan kekurangan LFNR ini.

Dengan menambahkan Transformer pada model supaya ia berjalan sebelum dua Transformer yang lain dan antara titik kedalaman yang sama bagi semua pertukaran imej rujukan maklumat antara.

GPNR terdiri daripada jujukan tiga Transformer yang memetakan satu set tompok yang diekstrak sepanjang garis epipolar kepada warna piksel. Tompok imej dipetakan kepada ciri awal melalui lapisan unjuran linear, dan kemudian ciri ini terus diperhalusi dan diagregatkan oleh model untuk akhirnya membentuk ciri dan warna.

Sebagai contoh, selepas Transformer pertama mengekstrak jujukan tampalan daripada "bangku taman", model baharu boleh menggunakan "bunga" yang muncul pada kedalaman yang sepadan dalam kedua-dua paparan Petunjuk sedemikian menunjukkan perlawanan yang berpotensi.

Satu lagi idea utama kerja ini adalah untuk menormalkan pengekodan kedudukan mengikut sinar sasaran, kerana kita ingin membuat generalisasi dalam senario yang berbeza, Kuantiti mesti diwakili dalam relatif dan bukannya rangka rujukan mutlak

Untuk menilai prestasi generalisasi model, penyelidik melatih GPNR pada satu set adegan dan mengujinya pada adegan baru.

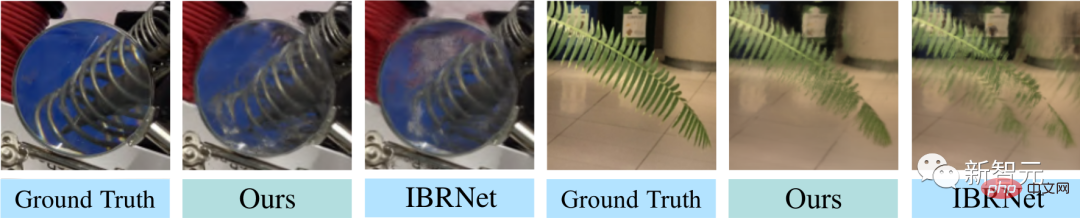

GPNR bertambah baik dengan purata 0.5-1.0 dB pada beberapa penanda aras (mengikuti protokol IBRNet dan MVSNeRF), terutamanya pada penanda aras IBRNet, di mana GPNR bertambah baik menggunakan hanya 11% daripada senario latihan kes, ia melebihi model garis dasar.

GPNR menjana butiran paparan pada adegan NeX/Shiny dan LLFF yang dikekalkan tanpa sebarang penalaan halus. GPNR mengeluarkan semula butiran pada bilah dan pembiasan melalui kanta dengan lebih tepat daripada IBRNet.

Atas ialah kandungan terperinci Hanya berlatih sekali untuk menjana adegan 3D baharu! Sejarah evolusi 'Rendering Neural Medan Cahaya' Google. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!