Beli Saya Kopi☕

*Memo:

-

Siaran saya menerangkan Masalah Kecerunan Lenyap, Masalah Kecerunan Meletup dan Masalah ReLU Mati.

-

Siaran saya menerangkan lapisan dalam PyTorch.

-

Siaran saya menerangkan fungsi pengaktifan dalam PyTorch.

-

Siaran saya menerangkan fungsi kehilangan dalam PyTorch.

-

Siaran saya menerangkan pengoptimum dalam PyTorch.

*Kedua-dua overfitting dan underfitting boleh dikesan melalui Holdout Method atau Cross Validation(K-Fold Cross-Validation). *Pengesahan Silang adalah lebih baik.

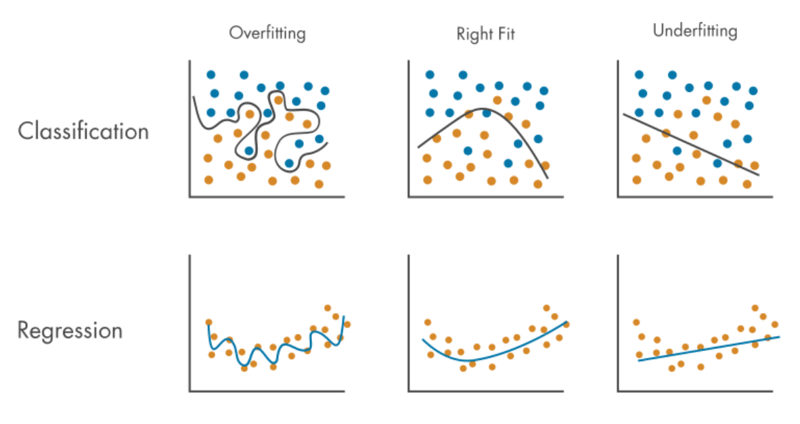

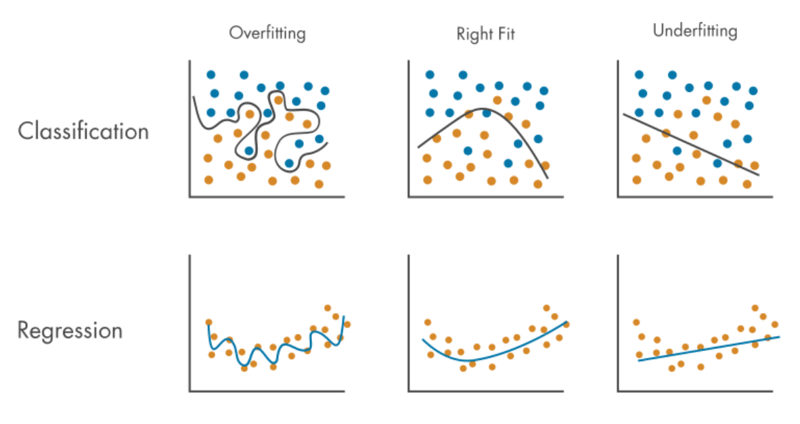

Overfitting:

- adalah masalah yang model boleh membuat ramalan yang tepat untuk data kereta api dengan banyak tetapi sedikit untuk data baharu (termasuk data ujian) jadi model lebih sesuai dengan data kereta api berbanding data baharu.

- berlaku kerana:

- Data kereta api adalah kecil(tidak mencukupi) jadi model hanya boleh mempelajari sebilangan kecil corak.

- Data kereta api tidak seimbang(berat sebelah) mempunyai banyak data khusus(terhad), serupa atau sama tetapi tidak banyak pelbagai data jadi model hanya boleh mempelajari sebilangan kecil corak.

- data kereta api mempunyai banyak hingar(data bising) jadi model mempelajari corak hingar dengan banyak tetapi bukan corak data biasa. *Bunyi(data bising) bermaksud outlier, anomali atau kadangkala data pendua.

- masa latihan terlalu lama dengan bilangan zaman yang terlalu banyak.

- modelnya terlalu kompleks.

- boleh dikurangkan dengan:

- data kereta api yang lebih besar.

- mempunyai banyak pelbagai data.

- mengurangkan bunyi.

- mengocok set data.

- berhenti latihan awal.

- Pembelajaran ensembel.

- Pengaturan untuk mengurangkan kerumitan model:

*Memo:

- Terdapat Keciciran (Regulasi). *Siaran saya menerangkan lapisan Tercicir.

- Terdapat Penyelarasan L1 juga dipanggil Norma L1 atau Regresi Lasso.

- Terdapat Regularisasi L2 juga dipanggil L2 Norm atau Ridge Regression.

-

Siaran saya menerangkan linalg.norm().

-

Siaran saya menerangkan linalg.vector_norm().

-

Siaran saya menerangkan linalg.matrix_norm().

Underfitting:

- adalah masalah yang model tidak boleh membuat ramalan yang tepat untuk data kereta api dan data baharu (termasuk data ujian) banyak jadi model tidak sesuai dengan data kereta api dan data baharu.

- berlaku kerana:

- modelnya terlalu ringkas(tidak cukup kompleks).

- masa latihan terlalu singkat dengan bilangan zaman yang terlalu kecil.

- Penyaturan yang berlebihan (Penyusunan, L1 dan L2 penyusunan) digunakan.

- boleh dikurangkan dengan:

- Meningkatkan kerumitan model.

- Meningkatkan masa latihan dengan bilangan zaman yang lebih besar.

- Mengurangkan penyelarasan.

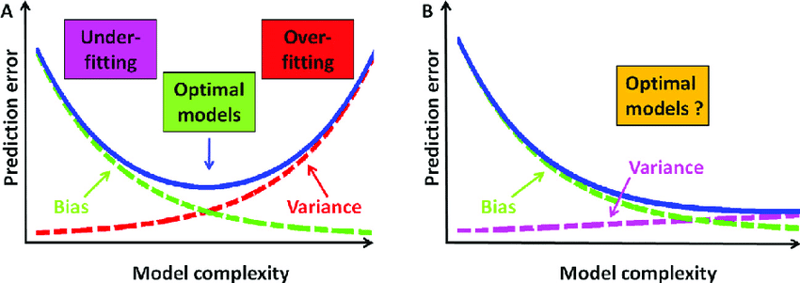

Overfitting dan Underfitting adalah pertukaran:

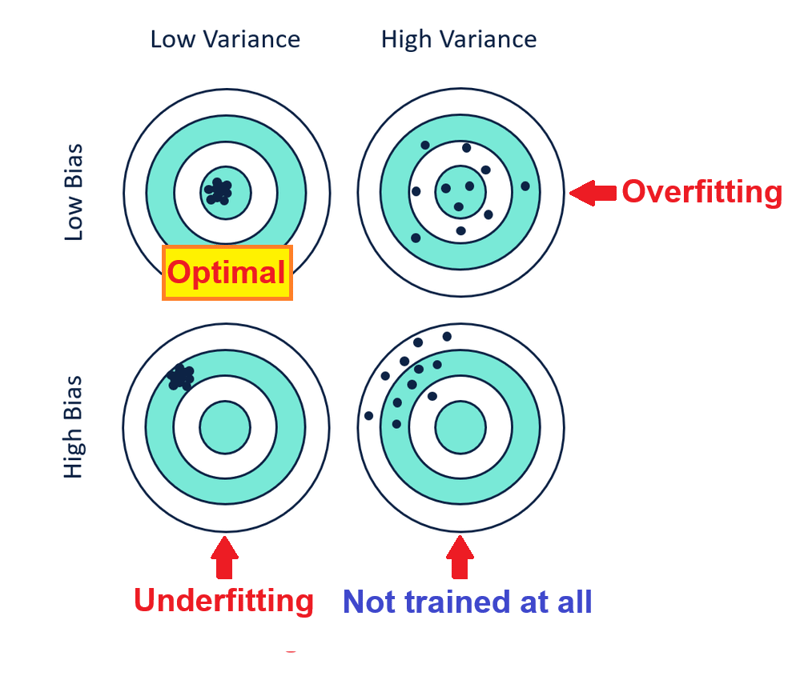

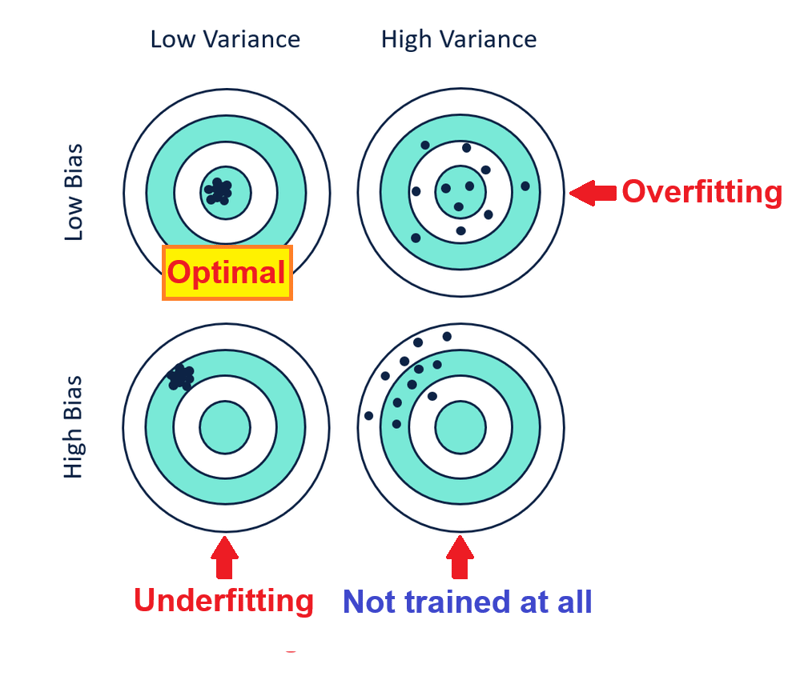

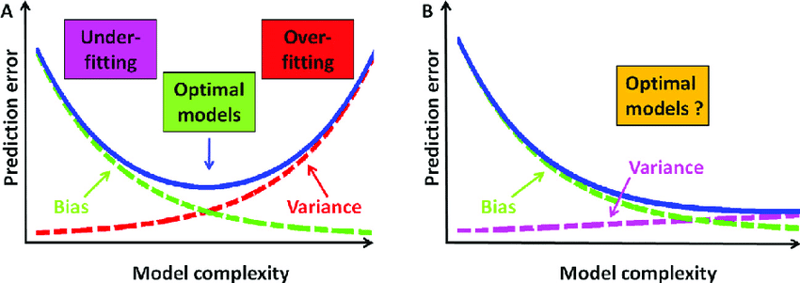

Terlalu banyak tebatan overfitting(5., 6. dan 7.) membawa kepada underfitting dengan bias tinggi dan varians rendah manakala terlalu banyak underfitting mitigation( 1., 2. dan 3.) membawa kepada overfitting dengan berat sebelah rendah dan varians tinggi supaya pengurangannya harus seimbang seperti yang ditunjukkan di bawah:

*Memo:

- Anda juga boleh mengatakan Bias dan Varians adalah pertukaran kerana mengurangkan berat sebelah meningkatkan varians manakala mengurangkan varians meningkatkan bias jadi ia harus seimbang. *Meningkatkan kerumitan model mengurangkan bias tetapi meningkatkan varians manakala mengurangkan kerumitan model mengurangkan varians tetapi meningkatkan bias.

- Pincang rendah bermaksud ketepatan tinggi manakala pincang tinggi bermakna ketepatan rendah.

- Varians rendah bermaksud kepersisan tinggi manakala varians tinggi bermakna kepersisan rendah.

Atas ialah kandungan terperinci Overfitting vs Underfitting. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Penggunaan fungsi sqrt dalam Java

Penggunaan fungsi sqrt dalam Java

Bagaimana untuk mengukur kelajuan rangkaian pada komputer

Bagaimana untuk mengukur kelajuan rangkaian pada komputer

Penyelesaian kepada masalah bahawa input tidak disokong apabila komputer dimulakan

Penyelesaian kepada masalah bahawa input tidak disokong apabila komputer dimulakan

html editor dalam talian

html editor dalam talian

Apakah maksud tambah dalam java?

Apakah maksud tambah dalam java?

Ralat menyambung ke pelayan id apple

Ralat menyambung ke pelayan id apple

Apakah platform Fengxiangjia?

Apakah platform Fengxiangjia?

Apakah yang perlu saya lakukan jika eDonkey Search tidak dapat menyambung ke pelayan?

Apakah yang perlu saya lakukan jika eDonkey Search tidak dapat menyambung ke pelayan?