Maison >Problème commun >Quelle structure le système informatique traditionnel actuel utilise-t-il ?

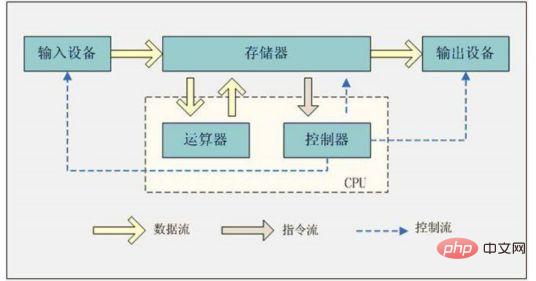

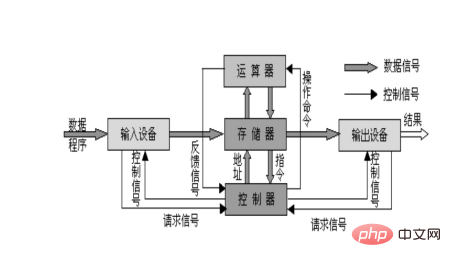

La structure du système informatique adopte la structure "Von Neumann". La structure de von Neumann, également connue sous le nom de structure de Princeton, est une structure de mémoire qui combine la mémoire d'instructions de programme et la mémoire de données. Elle utilise la logique binaire, le stockage et l'exécution du programme, et l'ordinateur est composé de cinq parties (opérateur, contrôleur, mémoire). périphérique d'entrée, périphérique de sortie) ; les caractéristiques de cette structure sont « stockage du programme, données partagées, exécution séquentielle », ce qui nécessite que le CPU récupère les instructions et les données de la mémoire pour effectuer les calculs correspondants.

L'environnement d'exploitation de ce tutoriel : système Windows 7, ordinateur Dell G3.

La structure actuelle du système informatique traditionnel adopte la structure "Von Neumann".

La structure de Von Neumann, également appelée structure de Princeton, est une structure de mémoire qui combine la mémoire d'instructions de programme et la mémoire de données. L'adresse de stockage des instructions du programme et l'adresse de stockage des données pointent vers des emplacements physiques différents dans la même mémoire, de sorte que la largeur des instructions et des données du programme est la même. Par exemple, les instructions du programme et les données du processeur central Intel 8086 sont toutes deux de 16 bits. large.

Le mathématicien von Neumann a proposé trois principes de base pour la fabrication d'ordinateurs, à savoir l'utilisation de la logique binaire, le stockage et l'exécution de programmes, et l'ordinateur est composé de cinq parties (opérateur, contrôleur, mémoire, périphérique d'entrée, périphérique de sortie). Cette théorie s'appelle l'architecture de von Neumann.

Histoire du développement

Avant la naissance des ordinateurs, les gens avaient des goulots d'étranglement dans la précision et la quantité des calculs. La demande de machines comme les ordinateurs était très forte, guidée par la logique et les idées informatiques de von Neumann. construit le premier ordinateur électronique à usage général de l'histoire. Sa théorie informatique est principalement influencée par ses propres fondements mathématiques et est hautement mathématique et logique. Il appelle généralement cette théorie « la théorie logique des ordinateurs ». Son idée de programmes stockés sur ordinateur était une autre de ses grandes innovations en plaçant les programmes stockés dans la mémoire interne, il a réussi à résoudre les problèmes de capacité de stockage informatique trop petite et de vitesse de calcul trop lente à cette époque.

Pendant la Seconde Guerre mondiale, l'armée américaine exigeait des laboratoires qu'ils lui fournissent des résultats de calculs massifs. C'est ainsi qu'est née l'idée de développer un ordinateur électronique. Face à cette demande, les États-Unis ont immédiatement formé une équipe de recherche et développement, comprenant de nombreux ingénieurs et physiciens, pour tenter de développer le premier ordinateur au monde (appelé plus tard machine ENIAC). Bien que la technologie électronique la plus avancée soit adoptée, il manque des principes directeurs. A cette époque, von Neumann apparut. Il évoque un aspect crucial : la structure logique des ordinateurs. Von Neumann a commencé avec logique et a conduit l'équipe à améliorer ENIAC. Sa conception logique présente les caractéristiques suivantes :

(1) Sépare les conceptions de circuits et logiques pour créer des conditions optimales pour la construction de l'ordinateur ;

(2) Combine le système nerveux personnel et l'ordinateur pour proposer de nouveaux concepts, c'est l'ordinateur biologique.

Même si la machine ENIAC a été réalisée avec la technologie de pointe aux États-Unis et même dans le monde à cette époque, elle utilisait un stockage temporaire et déterminait l'unité arithmétique comme base. Elle présentait donc de nombreux défauts, tels qu'un espace de stockage limité. , l'incapacité de stocker des programmes, etc., et sa vitesse d'exécution était lente. C'est intrinsèquement irrationnel. Von Neumann a formulé le plan d'optimisation suivant basé sur cette prémisse :

(1) Utiliser le binaire pour effectuer des opérations, ce qui accélère considérablement l'ordinateur

(2) Stocker le programme, c'est-à-dire enregistrer le programme d'opération via le système interne de l'ordinateur ; mémoire. De cette façon, les programmeurs n'ont qu'à écrire les instructions informatiques pertinentes dans la mémoire, et l'ordinateur peut immédiatement effectuer des opérations informatiques, accélérant considérablement l'efficacité informatique.

Schéma schématique de la structure de Von Neumann

Caractéristiques

La forme structurelle de base suivie par le développement des ordinateurs modernes est toujours la structure de la machine de Von Neumann. Les caractéristiques de cette structure sont « le stockage du programme, les données partagées et l'exécution séquentielle », ce qui nécessite que le CPU récupère les instructions et les données de la mémoire pour effectuer les calculs correspondants. Les principales caractéristiques sont :

(1) Structure à processeur unique, la machine est centrée sur l'unité arithmétique

(2) Adopte l'idée de stockage de programme

(3) Les instructions et les données peuvent également participer ; dans les calculs ;

(4) Les données sont représentées en binaire ;

(5) Sépare complètement le logiciel et le matériel ;

(6) Les instructions sont constituées d'opcodes et d'opérandes ;

LimitationsLa vitesse d'échange d'informations entre le processeur et la mémoire partagée est devenue le principal facteur affectant les performances du système, et l'amélioration de la vitesse d'échange d'informations est soumise à de nombreuses conditions telles que la vitesse des composants de stockage, les performances et la structure de la mémoire. .

La méthode de programme stocké de l'architecture informatique traditionnelle de von Neumann rend le système dépendant de la mémoire. La vitesse du processeur accédant à la mémoire limite la vitesse du système. Le niveau technique des puces de circuits intégrés détermine les performances de la mémoire et des autres matériels. Afin d'améliorer les performances du matériel, les sociétés de fabrication de puces représentées par Intel Corporation ont déployé de gros efforts dans la production de circuits intégrés et ont obtenu d'excellents résultats techniques. Désormais, tous les 18 mois, le niveau d'intégration des circuits intégrés double, les performances doublent et le prix du produit diminue de moitié. C'est ce qu'on appelle la « loi de Moore ». Cette tendance dure depuis plus de 40 ans et devrait se poursuivre encore plusieurs années. Cependant, deux limitations fondamentales auxquelles sont confrontés les produits électroniques existent objectivement : la vitesse de la lumière et les propriétés atomiques des matériaux. Tout d'abord, la vitesse de propagation des informations dépendra en fin de compte de la vitesse du flux d'électrons. Le flux des signaux électroniques dans les composants et les fils entraînera des retards. Une fréquence trop élevée entraînera une distorsion du signal, de sorte que la vitesse des composants ne peut pas être infinie. augmenté jusqu’à atteindre la vitesse de la lumière. Deuxièmement, les signaux électroniques de l'ordinateur sont stockés dans des transistors représentés par des cristaux de silicium. L'amélioration de l'intégration réside dans le fait que les transistors deviennent plus petits, mais ils ne peuvent pas être plus petits que le volume d'un atome de silicium. À mesure que la technologie des semi-conducteurs approche progressivement de la limite de taille des procédés sur silicium, les règles dérivées de la loi de Moore ne s'appliqueront plus.

Analyse des défauts structurels de l'architecture informatique de von Neumann :

(1) Les instructions et les données sont stockées dans la même mémoire, ce qui entraîne une dépendance excessive du système à l'égard de la mémoire. Si le développement des dispositifs de stockage est entravé, le développement des systèmes le sera également.

(2) Les instructions sont stockées en mémoire dans l'ordre de leur exécution, et le compteur d'instructions PC indique l'adresse unitaire de l'instruction à exécuter. Récupérez ensuite les instructions pour effectuer la tâche d’opération. L'exécution des instructions est donc en série. Affecte la vitesse d'exécution du système.

(3) La mémoire est adressée linéairement par accès à l'adresse, et l'accès à l'adresse est organisé en séquence, ce qui est propice au stockage et à l'exécution d'instructions en langage machine et convient aux calculs numériques. Cependant, la mémoire représentée par le langage de haut niveau est un ensemble de variables nommées. Les variables sont appelées par leur nom et non accessibles par adresse. Il existe un grand fossé sémantique entre le langage machine et le langage de haut niveau, appelé fossé sémantique de von Neumann. L'élimination des lacunes sémantiques est devenue un problème majeur auquel est confronté le développement des ordinateurs.

(4) Les ordinateurs à architecture Von Neumann sont nés pour les opérations arithmétiques et logiques. Actuellement, ils ont atteint une vitesse et une précision élevées dans le traitement numérique. Cependant, le développement d'applications de traitement non numérique est lent et nécessite une amélioration de l'architecture. ont été des avancées majeures.

(5) La structure traditionnelle de type von Neumann appartient à la méthode du pilotage piloté. Il exécute des codes d'instructions pour traiter les codes numériques tant que les instructions sont claires et que les données d'entrée sont exactes, il s'exécutera automatiquement après le démarrage du programme et les résultats seront attendus. Une fois qu'il y a des erreurs dans les instructions et les données, la machine ne modifiera pas activement les instructions et n'améliorera pas le programme. Cependant, de nombreuses informations sur la vie humaine sont vagues, et la survenance, l’évolution et les résultats des événements sont imprévisibles. L’intelligence des ordinateurs modernes ne peut pas faire face à des tâches aussi complexes.

Pour plus de connaissances connexes, veuillez visiter la rubrique FAQ !

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!