강의 2672

코스소개:Golang은 GPM 스케줄러 모델과 전체 시나리오 분석에 대한 심층적인 이해를 갖고 있습니다. 스케줄러의 기원과 분석, GMP 모델 소개 및 11가지 요약이 포함된 이 비디오를 시청하시면서 뭔가를 얻으실 수 있기를 바랍니다. 시나리오.

강의 5963

코스소개:flex 속성은 flex-grow, flex-shrink 및 flex-basis 속성에 대한 간략한 속성으로 flex box 모델 객체의 하위 요소가 공간을 할당하는 방법을 설정하거나 검색하는 데 사용됩니다. 참고: 요소가 Flexbox 모델 객체의 자식이 아닌 경우 flex 속성은 효과가 없습니다.

강의 2857

코스소개:과정 소개: 1. 도메인 간 처리, 토큰 관리, 경로 차단 2. 실제 인터페이스 디버깅, API 계층 캡슐화 3. Echarts 및 페이징 구성 요소의 보조 캡슐화 4. Vue 패키징 최적화 및 일반적인 문제 해결

강의 1795

코스소개:Apipost는 API 설계, API 디버깅, API 문서화, 자동화된 테스트를 통합한 API R&D 협업 플랫폼입니다. grpc, http, websocket, 소켓io, 소켓js 유형 인터페이스 디버깅을 지원하고 민영화된 배포를 지원합니다. ApiPost를 정식으로 배우기 전에 관련 개념, 개발 모델 및 전문 용어를 이해해야 합니다. Apipost 공식 홈페이지: https://www.apipost.cn

강의 5521

코스소개:(WeChat 참조: phpcn01) 종합 실습 과정은 처음 두 단계의 학습 결과를 통합하고, 프런트엔드 및 PHP 핵심 지식 포인트를 유연하게 적용하고, 실습 교육을 통해 자신의 프로젝트를 완성하고, 온라인 구현에 대한 지침을 제공하는 것을 목표로 합니다. 종합 실무 핵심 실습 과정으로는 소셜 전자상거래 시스템 백엔드 개발, 제품 관리, 결제/주문 관리, 고객 관리, 유통/쿠폰 시스템 설계, WeChat/Alipay 결제 프로세스 전체, Alibaba Cloud/Pagoda 운영 및 유지 관리, 프로젝트 등이 있습니다. 온라인 운영....

tp6 모델이 쿼리를 위해 여러 데이터 테이블과 연결되면 쿼리가 매우 느려집니다. 최적화 방법이 있습니까? 돕다! ! ! ! !

2023-11-17 08:50:36 0 0 84

역할에 따라 각 사용자에 대한 권한 집합을 정의하기 위해 Laravel Spatie 권한 설정 방법을 설정하는 방법은 무엇입니까?

2023-11-14 12:58:58 0 1 292

Laravel 8의 블레이드 자산을 사용하여 이미지를 표시하지만 리소스 하위 폴더에서 로드

2023-11-09 12:47:02 0 1 314

Laravel 기능 테스트에서 GuzzleHttp 클라이언트를 사용하여 타사 API에 대한 요청을 시뮬레이션하는 방법은 무엇입니까?

2023-11-09 11:42:58 0 1 207

App\Models\User::$profile의 오버로드된 특성에 대한 간접 수정은 유효하지 않습니다.

2023-11-08 11:50:44 0 1 270

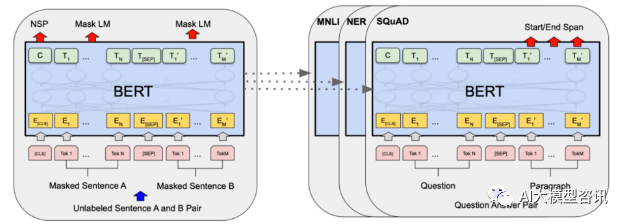

코스소개:2018年谷歌发布了BERT,一经面世便一举击败11个NLP任务的State-of-the-art(Sota)结果,成为了NLP界新的里程碑;BERT的结构如下图所示,左边是BERT模型预训练过程,右边是对于具体任务的微调过程。其中,微调阶段是后续用于一些下游任务的时候进行微调,例如:文本分类,词性标注,问答系统等,BERT无需调整结构就可以在不同的任务上进行微调。通过”预训练语言模型+下游任务微调”的任务设计,带来了强大的模型效果。从此,“预训练语言模型+下游任务微调”便成为了NLP领域主流训

2023-10-07 논평 0 909

코스소개:微调是指在特定任务上对预训练模型进行轻微调整,以提升性能。在情感分析中,可以利用预训练的自然语言处理模型(如BERT、RoBERTa、ALBERT)作为基础模型,并结合特定的情感分析数据集进行微调,从而实现更准确的情感分析结果。通过微调,模型可以根据具体任务的需求进行适应,提高模型在特定任务上的表现。微调模型的目的是为了将通用的自然语言处理模型进行细微调整,以提升其在情感分析任务中的识别能力和预测准确性。通过微调,我们可以将模型的学习能力转移至特定的领域,使其更好地适应特定任务要求。这样的微调过

2024-01-22 논평 0 745

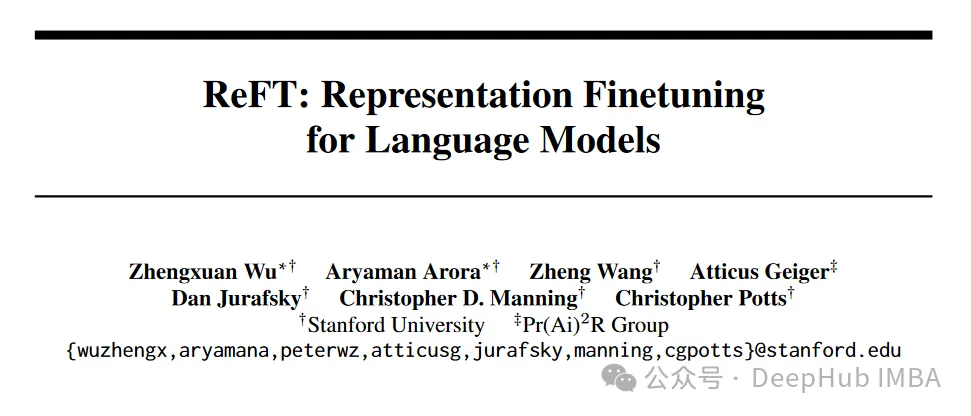

코스소개:ReFT(Representation Finetuning)는 대규모 언어 모델을 미세 조정하는 방식을 재정의하는 획기적인 방법입니다. 최근(4월) 스탠포드 대학 연구진이 arxiv에 발표한 논문에 따르면, ReFT는 기존의 가중치 기반 미세 조정 방법과 크게 다르며 이러한 대규모 모델에 적응하는 보다 효율적이고 효과적인 방법을 제공하여 새로운 환경에 적응합니다. 임무와 영역! 본 논문을 소개하기 전에 PeFT에 대해 먼저 살펴보자. 매개변수 효율적인 미세 조정 PEFT(PEFT)ParameterEfficientFine-Tuning(PEFT)은 소수 또는 추가 모델 매개변수를 미세 조정하기 위한 효율적인 미세 조정 방법입니다. 기존 예측 네트워크를 사용한 미세 조정

2024-04-15 논평 812

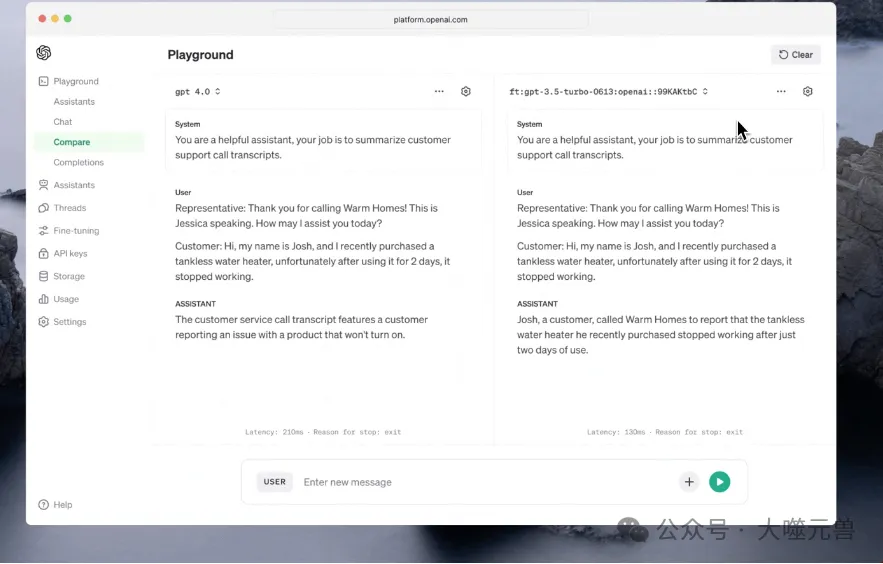

코스소개:OpenAI는 미세 조정 API에 대한 주요 개선 사항과 사용자 정의 모델 루틴의 확장을 발표했습니다. 이러한 업데이트는 개발자에게 AI 모델을 미세 조정할 수 있는 전례 없는 제어 기능을 제공하고 특정 비즈니스 요구에 맞는 맞춤형 모델을 구축할 수 있는 새로운 방법을 제공합니다. 2023년 8월 출시 이후 GPT-3.5의 미세 조정 API는 정교한 AI 모델을 결합하여 특정 작업을 수행하는 전환점이 되었습니다. 미세 조정 도구는 AI 모델 개발에 중요한 역할을 합니다. 이를 통해 개발자는 특정 데이터 세트 및 애플리케이션 시나리오를 기반으로 모델 성능을 최적화할 수 있습니다. 2022년 4월, OpenAI는 미세 조정 API에 대한 일련의 개선 사항을 출시했습니다. 이러한 개선 사항은 모델의 유연성과 정확성을 향상할 뿐만 아니라 개발자에게 더 많은 기능을 제공합니다.

2024-04-07 논평 844

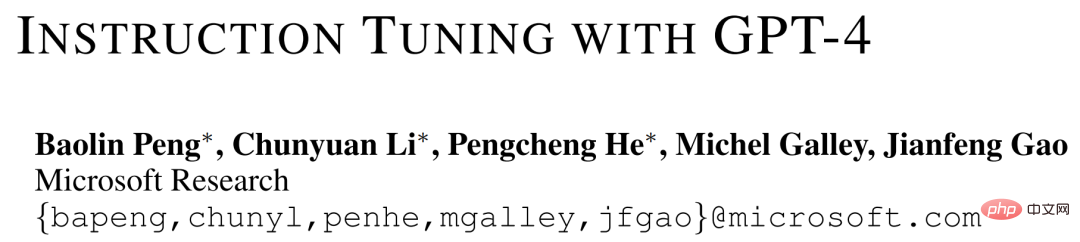

코스소개:我们知道,从谷歌 T5 模型到 OpenAI GPT 系列大模型,大语言模型(LLMs)已经展现出了令人印象深刻的泛化能力,比如上下文学习和思维链推理。同时为了使得 LLMs 遵循自然语言指令和完成真实世界任务,研究人员一直在探索 LLMs 的指令微调方法。实现方式有两种:一是使用人类标注的 prompt 和反馈在广泛任务上微调模型,二是使用通过手动或自动生成指令增强的公共基准和数据集来监督微调。在这些方法中,Self-Instruct 微调是一种简单有效的方法,它从 SOTA 指令微调的教师

2023-04-10 논평 0 1200