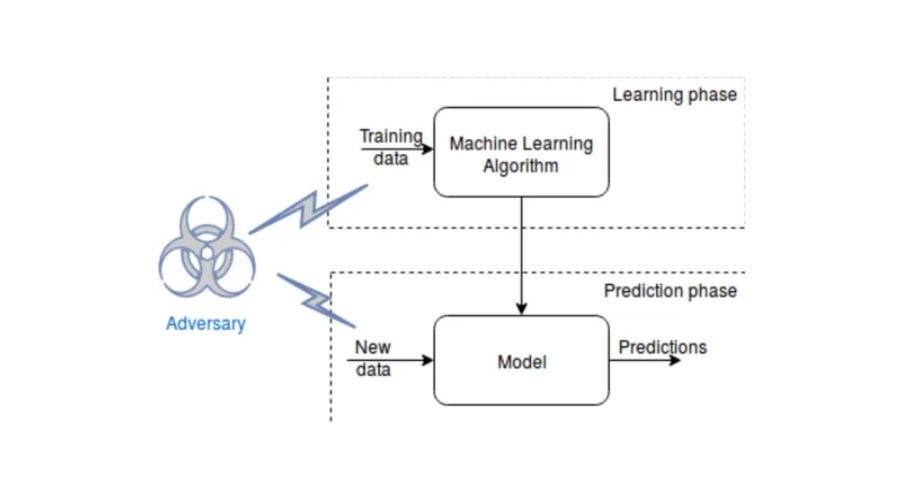

적대 학습은 적대적으로 훈련하여 모델의 견고성을 향상시키는 기계 학습 기술입니다. 이 훈련 방법의 목적은 의도적으로 까다로운 샘플을 도입하여 모델이 부정확하거나 잘못된 예측을 생성하도록 하는 것입니다. 이러한 방식으로 훈련된 모델은 실제 데이터의 변화에 더 잘 적응할 수 있으므로 성능의 안정성이 향상됩니다.

머신러닝 모델에 대한 공격은 화이트박스 공격과 블랙박스 공격 두 가지로 나눌 수 있습니다. 화이트박스 공격은 공격자가 모델의 구조와 매개변수에 액세스하여 공격을 수행할 수 있음을 의미하고, 블랙박스 공격은 공격자가 이 정보에 액세스할 수 없음을 의미합니다. 일반적인 적대적 공격 방법으로는 FGSM(Fast Gradient Sign Method), BIM(Basic Iterative Method), JSMA(Jacobian Matrix-Based Saliency Map) 공격 등이 있습니다.

적대 학습은 모델 견고성을 향상시키는 데 중요한 역할을 합니다. 모델이 더 잘 일반화되고 데이터 구조를 식별 및 적용하여 견고성을 향상시키는 데 도움이 될 수 있습니다. 또한, 적대적 학습은 모델의 약점을 발견하고 모델 개선을 위한 지침을 제공할 수 있습니다. 따라서 적대적 학습은 모델 훈련 및 최적화에 매우 중요합니다.

기계 학습 모델에 적대적 학습을 통합하려면 적대적 사례를 생성하고 이러한 사례를 훈련 프로세스에 통합하는 두 단계가 필요합니다.

그라디언트 기반 방법, 유전 알고리즘, 강화 학습 등 정보를 생성하는 방법에는 여러 가지가 있습니다. 그 중 Gradient 기반의 방법이 가장 많이 사용된다. 이 방법은 입력 손실 함수의 기울기를 계산하고 기울기 방향에 따라 정보를 조정하여 손실을 증가시키는 방법입니다.

적대적 사례는 적대적 훈련과 적대적 강화를 통해 훈련 과정에 통합될 수 있습니다. 훈련 중에 적대적 예를 사용하여 모델 매개변수를 업데이트하는 동시에 훈련 데이터에 적대적 예를 추가하여 모델 견고성을 향상시킵니다.

증강 데이터는 모델 성능을 향상시키는 데 널리 사용되는 간단하고 효과적인 실용적인 방법입니다. 기본 아이디어는 훈련 데이터에 적대적인 예를 도입한 다음 증강된 데이터에 대해 모델을 훈련시키는 것입니다. 훈련된 모델은 원본 및 적대적 예제의 클래스 레이블을 정확하게 예측할 수 있으므로 데이터의 변경 및 왜곡에 더욱 강력해집니다. 이 방법은 실제 응용 분야에서 매우 일반적입니다.

적대적 학습은 컴퓨터 비전, 음성 인식, 자연어 처리 등 다양한 기계 학습 작업에 적용되었습니다.

컴퓨터 비전에서는 이미지 분류 모델의 견고성을 향상시키기 위해 CNN(컨벌루션 신경망)의 견고성을 조정하여 보이지 않는 데이터의 정확성을 향상시킬 수 있습니다.

적대 학습은 음성 인식에서 자동 음성 인식(ASR) 시스템의 견고성을 향상시키는 역할을 합니다. 이 방법은 적대적인 예를 사용하여 인간이 감지할 수 없도록 설계된 방식으로 입력 음성 신호를 변경하지만 ASR 시스템이 이를 잘못 표기하도록 하는 방식으로 작동합니다. 연구에 따르면 적대적 훈련은 이러한 적대적 사례에 대한 ASR 시스템의 견고성을 향상시켜 인식 정확도와 신뢰성을 향상시킬 수 있습니다.

자연어 처리에서는 감정 분석 모델의 견고성을 향상하기 위해 적대 학습이 사용되었습니다. 이 NLP 분야의 적대적 예는 부정확하고 부정확한 모델 예측을 초래하는 방식으로 입력 텍스트를 조작하는 것을 목표로 합니다. 적대적 훈련은 이러한 유형의 적대적 사례에 대해 감정 분석 모델을 더욱 강력하게 만들어 정확성과 견고성을 향상시키는 것으로 나타났습니다.

위 내용은 머신러닝의 적대적 학습 기법에 대한 심층 분석의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!