딥 러닝은 데이터 처리에서 두뇌의 능력을 시뮬레이션하도록 설계된 기계 학습의 한 분야입니다. 기계가 감독 없이 학습할 수 있는 인공 신경망 모델을 구축하여 문제를 해결합니다. 이 접근 방식을 통해 기계는 복잡한 패턴과 특징을 자동으로 추출하고 이해할 수 있습니다. 딥러닝을 통해 기계는 대량의 데이터로부터 학습하고 매우 정확한 예측과 결정을 내릴 수 있습니다. 이를 통해 딥러닝은 컴퓨터 비전, 자연어 처리, 음성 인식 등의 분야에서 큰 성공을 거둘 수 있었습니다.

신경망의 기능을 이해하려면 뉴런의 자극 전달을 고려하세요. 데이터는 수상돌기 말단에서 수신된 후 핵에서 가중치를 부여(w 곱하기)한 다음 축삭을 따라 전달되어 다른 신경 세포에 연결됩니다. 축삭(x)은 한 뉴런의 출력이며 다른 뉴런의 입력이 되어 신경 간의 정보 전달을 보장합니다.

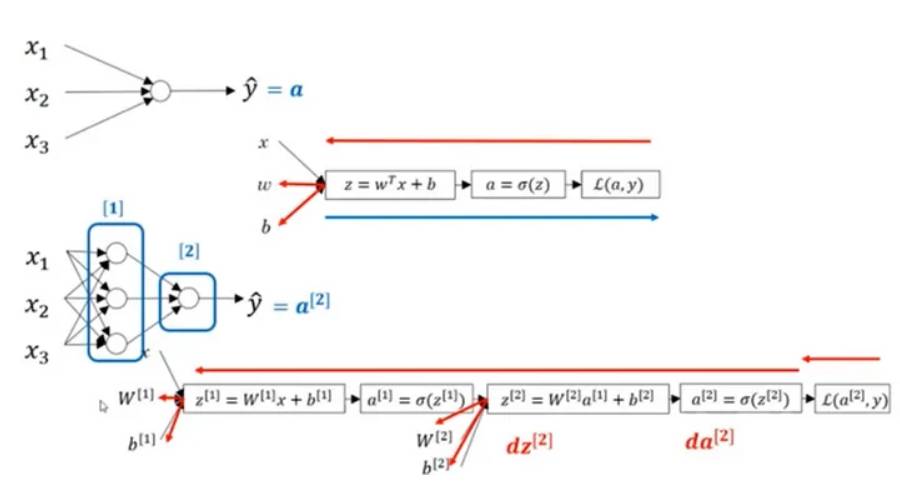

컴퓨터에서 모델링하고 훈련하려면 연산의 알고리즘을 이해하고 명령을 입력하여 출력을 얻어야 합니다.

수학으로 표현하면 다음과 같습니다.

위 그림에는 4개 뉴런으로 구성된 은닉층과 단일 뉴런으로 구성된 출력층으로 구성된 2층 신경망이 나와 있습니다. 입력 레이어의 개수는 신경망의 작동에 영향을 미치지 않는다는 점에 유의해야 합니다. 이러한 레이어의 뉴런 수와 입력 값의 수는 매개변수 w와 b로 표시됩니다. 구체적으로 은닉층에 대한 입력은 x이고, 출력층에 대한 입력은 a의 값이다.

Hyperbolic tangent, ReLU, Leaky ReLU 등의 함수는 Sigmoid를 미분 가능한 활성화 함수로 대체하여 계층에서 사용할 수 있으며, 역전파에서 미분 연산을 통해 가중치가 업데이트됩니다.

ReLU 활성화 함수는 딥러닝에서 널리 사용됩니다. 0보다 작은 ReLU 함수 부분은 미분할 수 없으므로 훈련 중에 학습하지 않습니다. Leaky ReLU 활성화 함수는 이 문제를 해결하며 0보다 작은 부분에서 미분 가능하며 어떤 경우에도 학습합니다. 이로 인해 일부 시나리오에서는 Leaky ReLU가 ReLU보다 더 효과적입니다.

위 내용은 딥러닝에서의 인공신경망 학습방법 분석의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!