원제: 조감도에서 레이더-카메라 융합에 대한 데이터 세트 간 실험 연구

논문 링크: https://arxiv.org/pdf/2309.15465.pdf

저자 소속: Opel Automobile GmbH Rheinland-Pfalzische Technische Universitat Kaiserslautern- Landau 독일 인공 지능 연구 센터

보완적인 센서 정보를 활용함으로써 밀리미터파 레이더 및 카메라 융합 시스템은 첨단 운전자 지원 시스템 및 자율 주행 기능.신뢰할 수 있는 감지 시스템. 카메라 기반 객체 감지의 최근 발전은 밀리미터파 레이더와 카메라의 융합을 위한 새로운 가능성을 제공하며, 융합을 위해 조감도 기능 맵을 활용할 수 있습니다. 본 연구에서는 새롭고 유연한 융합 네트워크를 제안하고 두 가지 데이터 세트(nuScenes 및 View-of-Delft)에 대한 성능을 평가합니다. 실험 결과에 따르면 카메라 계통에는 크고 다양한 훈련 데이터가 필요하지만 밀리미터파 레이더 계통은 고성능 밀리미터파 레이더의 이점을 더 많이 얻습니다. 전이 학습을 통해 이 연구는 소규모 데이터 세트에서 카메라 성능을 향상시킵니다. 연구 결과는 밀리미터파 레이더와 카메라의 융합 방식이 카메라만 사용하거나 밀리미터파 레이더만 사용하는 기본 방식보다 훨씬 우수하다는 것을 보여줍니다.

최근 3D 타겟 탐지의 추세는 통합하는 것입니다. 이미지의 특징 일반적인 조감도(BEV) 표현으로 변환합니다. 이 표현은 여러 카메라 사이에 융합되거나 거리 측정 센서를 사용하여 융합될 수 있는 유연한 융합 아키텍처를 제공합니다. 본 연구에서는 원래 레이저 카메라 융합에 사용되었던 BEVFusion 방법을 밀리미터파 레이더 카메라 융합을 위해 확장합니다. 우리는 선택된 밀리미터파 레이더 데이터 세트를 사용하여 제안된 융합 방법을 훈련하고 평가했습니다. 여러 실험에서 각 데이터 세트의 장점과 단점을 논의합니다. 마지막으로, 추가적인 개선을 위해 전이 학습을 적용합니다

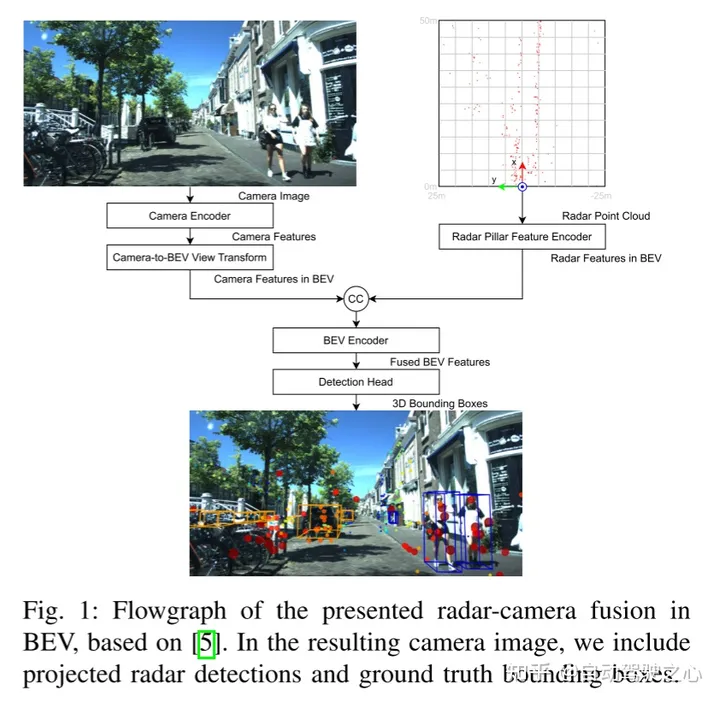

다음은 다시 작성해야 할 내용입니다. 그림 1은 BEVFusion을 기반으로 한 BEV 밀리미터파 레이더-카메라 융합 흐름도를 보여줍니다. 생성된 카메라 이미지에는 투영된 밀리미터파 레이더와 실제 경계 상자의 탐지 결과가 포함됩니다.

이 기사는 BEVFusion의 융합 아키텍처를 따릅니다. 그림 1은 이 기사에서 BEV의 밀리미터파 레이더-카메라 융합의 네트워크 개요를 보여줍니다. 카메라와 밀리미터파 레이더 신호가 BEV에 연결되면 융합이 발생합니다. 아래에서 이 문서에서는 각 블록에 대한 자세한 내용을 제공합니다.

다시 작성해야 하는 내용은 다음과 같습니다. A. 카메라 인코더 및 카메라를 BEV 뷰 변환으로

카메라 인코더 및 뷰 변환은 [15]의 아이디어를 채택합니다. 이는 임의의 카메라 외부를 추출할 수 있는 유연한 프레임워크입니다. 내부 매개변수의 이미지 BEV 기능. 먼저, Tiny-Swin Transformer 네트워크를 사용하여 각 이미지에서 특징을 추출합니다. 다음으로 본 논문에서는 [14]의 Lift 및 Splat 단계를 사용하여 이미지의 특징을 BEV 평면으로 변환합니다. 이를 위해 조밀한 깊이 예측에는 특징이 의사 포인트 클라우드로 변환되고 래스터화되어 BEV 그리드에 누적되는 규칙 기반 블록이 뒤따릅니다.

레이더 열 기능 인코더

이 블록의 목적은 밀리미터파 레이더 포인트 클라우드를 이미지 BEV 기능과 동일한 그리드의 BEV 기능으로 인코딩하는 것입니다. 이를 위해 본 논문에서는 [16]의 Pillar Feature Encoding 기술을 사용하여 포인트 클라우드를 소위 Pillar라고 불리는 무한히 높은 복셀로 래스터화합니다.

다시 작성해야 하는 내용은 다음과 같습니다. C. BEV 인코더

[5]와 유사하게 밀리미터파 레이더 및 카메라의 BEV 기능은 캐스케이드 융합을 통해 구현됩니다. 융합된 특징은 네트워크가 공간적 오정렬을 고려하고 서로 다른 양식 간의 시너지 효과를 활용할 수 있도록 조인트 콘볼루셔널 BEV 인코더로 처리됩니다.

D. 감지 헤드

이 문서에서는 CenterPoint 감지 헤드를 사용하여 각 클래스 열의 객체 중심을 예측합니다. 지도. 추가 회귀 헤드는 객체의 크기, 회전 및 높이뿐만 아니라 nuScene의 속도 및 클래스 속성도 예측합니다. 히트맵은 가우스 포커스 손실을 사용하여 훈련하고 나머지 감지 헤드는 L1 손실을 사용하여 훈련했습니다.

Stäcker, L., Heidenreich, P., Rambach, J., & Stricker, D. (2023) "조감도에서 본 레이더-카메라 융합에 대한 교차 데이터 세트 실험 연구" .ArXiv. /abs/2309.15465

다시 작성해야 하는 내용은 다음과 같습니다. 원본 링크: https://mp.weixin.qq.com/s/5mA5up5a4KJO2PBwUcuIdQ

위 내용은 BEV 하의 데이터 세트 전반에 걸친 레이더-카메라 융합에 대한 실험적 연구의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!