수학적 추론은 현대 LLM(대형 언어 모델)의 중요한 기능입니다. 이 분야의 최근 진전에도 불구하고 폐쇄 소스와 오픈 소스 LLM 사이에는 여전히 분명한 격차가 있습니다. GPT-4, PaLM-2 및 Claude 2와 같은 폐쇄 소스 모델은 GSM8K 및 MATH와 같은 일반적인 수학적 추론 벤치마크에서 우위를 차지하는 반면, Llama, Falcon 및 OPT와 같은 오픈 소스 모델은 모든 벤치마크에서 크게 뒤처집니다

이 문제를 해결하기 위해 연구 커뮤니티에서는 두 가지 방향으로 작업하고 있습니다

(1) Galactica, MINERVA와 같은 지속적인 사전 학습 방법은 1000억 개가 넘는 수학 관련 네트워크 데이터를 기반으로 LLM을 지속적으로 학습할 수 있습니다. 이 방법은 모델의 일반적인 과학적 추론 능력을 향상시킬 수 있지만 계산 비용이 더 높습니다

특정 데이터 세트의 지도 데이터를 사용하는 RFT(거부 샘플링 미세 조정) 및 WizardMath와 같은 특정 데이터 세트 미세 조정 방법 LLM을 미세 조정합니다. 이러한 방법은 특정 영역 내에서 성능을 향상시킬 수 있지만 데이터 미세 조정 이상의 광범위한 수학적 추론 작업으로 일반화되지는 않습니다. 예를 들어, RFT 및 WizardMath는 GSM8K(그 중 하나는 미세 조정된 데이터 세트)에서 정확도를 30% 이상 향상시킬 수 있지만 MMLU-Math 및 AQuA와 같은 도메인 외부 데이터 세트의 정확도를 손상시켜 정확도를 낮춥니다. 10%

최근 워털루 대학과 오하이오 주립 대학과 같은 기관의 연구팀은 LLM의 일반성을 향상시키는 데 사용할 수 있는 가볍지만 일반화 가능한 수학적 수업 미세 조정 방법을 제안했습니다(즉, 제한되지 않음). 미세 조정 작업) 수학적 추론 능력.

재작성된 내용: 과거 집중 방식은 주로 CoT(Chain of Thought) 방식이었는데, 이는 단계별 자연어 설명을 통해 수학적 문제를 해결하는 것입니다. 이 방법은 매우 일반적이며 대부분의 수학 분야에 적용할 수 있지만, 계산 정확도와 복잡한 수학적 또는 알고리즘 추론 프로세스(예: 이차 방정식의 근 풀기 및 행렬 고유값 계산)에 약간의 어려움이 있습니다.

비교 다음으로, PoT(Program of Thought) 및 PAL과 같은 코드 형식 프롬프트 설계 방법은 외부 도구(예: Python 인터프리터)를 사용하여 수학적 솔루션 프로세스를 크게 단순화합니다. 이 접근 방식은 계산 프로세스를 외부 Python 인터프리터로 오프로드하여 복잡한 수학적 및 알고리즘 추론(예: Sympy를 사용하여 2차 방정식 풀기 또는 numpy를 사용하여 행렬 고유값 계산)을 해결하는 것입니다. 그러나 PoT는 특히 내장된 API가 없으면 상식 추론, 형식 논리, 추상 대수와 같은 보다 추상적인 추론 시나리오로 인해 어려움을 겪습니다.

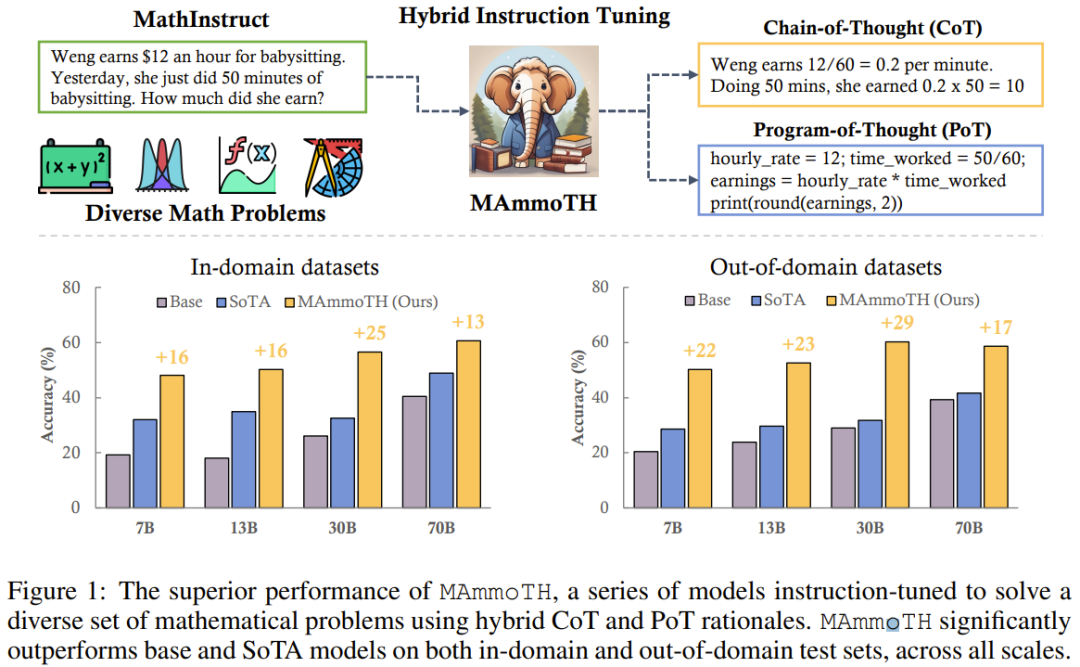

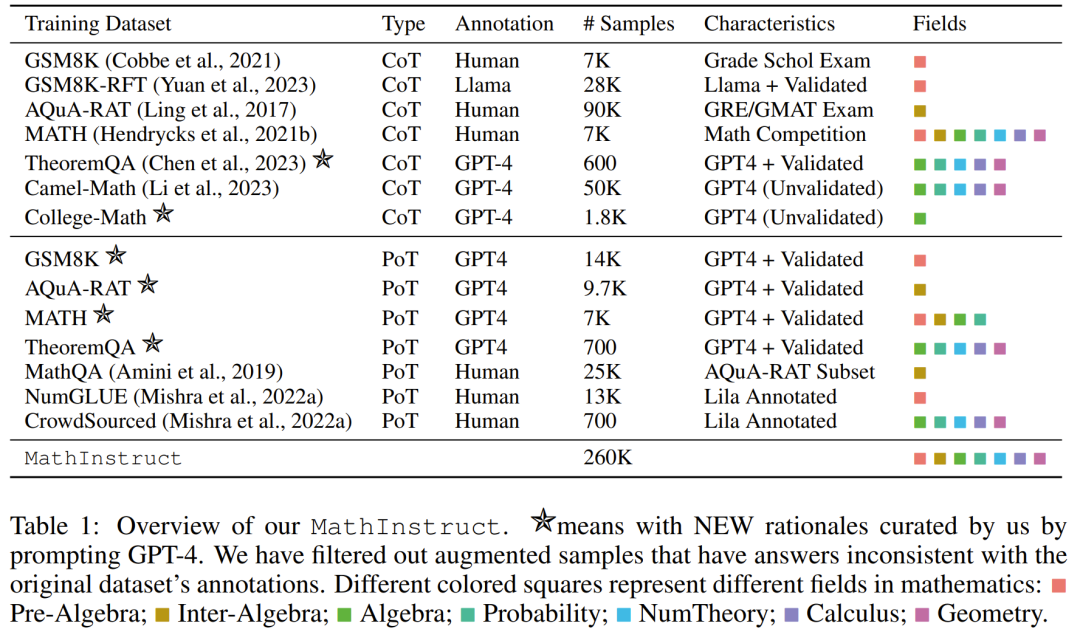

CoT와 PoT 방법의 장점을 모두 고려하기 위해 팀은 두 가지 주요 기능을 갖춘 새로운 수학적 하이브리드 명령 미세 조정 데이터 세트 MathInstruct를 도입했습니다. (1) 다양한 수학 분야와 복잡한 학위를 광범위하게 포괄 , (2) CoT와 PoT 원리의 융합

MathInstruct는 기존의 7가지 수학적 원리 데이터 세트와 새로 컴파일된 6개의 데이터 세트를 기반으로 합니다. 그들은 MathInstruct를 사용하여 다양한 크기(7B에서 70B까지)의 Llama 모델을 미세 조정했습니다. 그들은 그 결과 모델을 MAmmoTH 모델이라고 불렀고, MAmmoTH는 수학 제너럴리스트와 같은 전례 없는 능력을 가지고 있음을 발견했습니다.

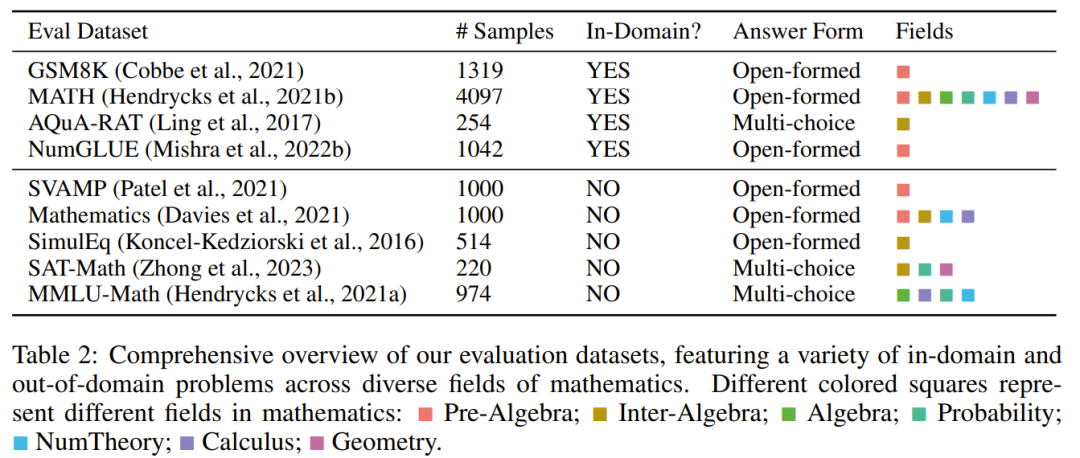

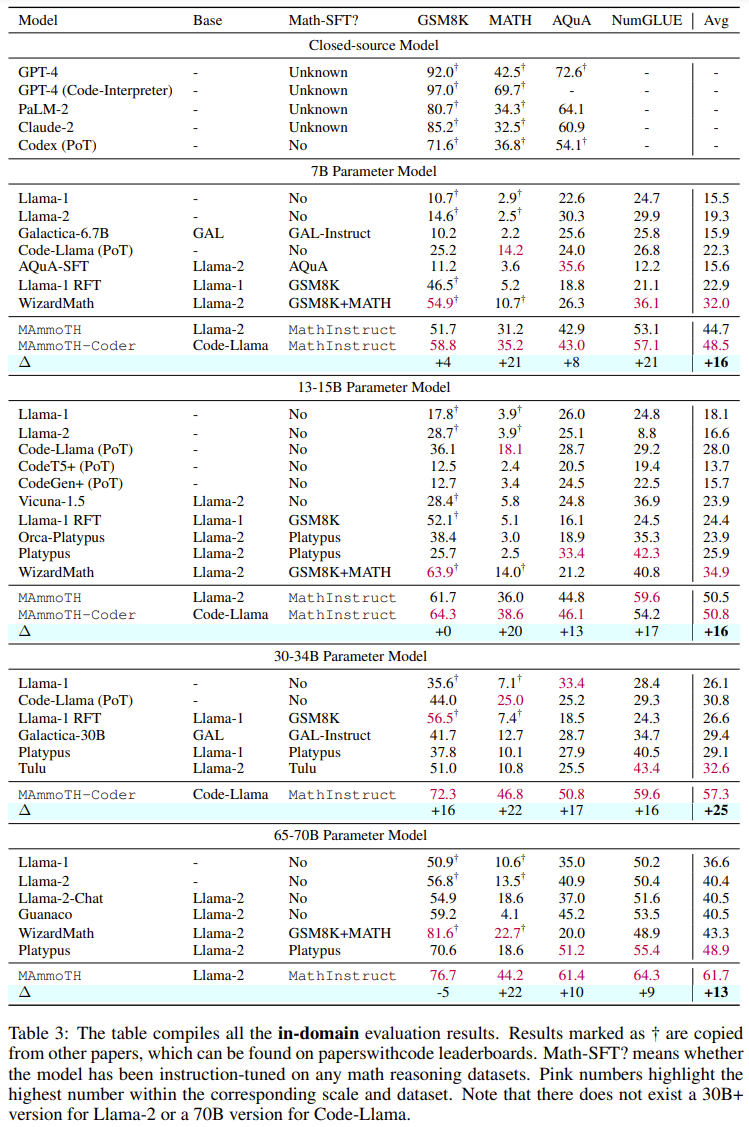

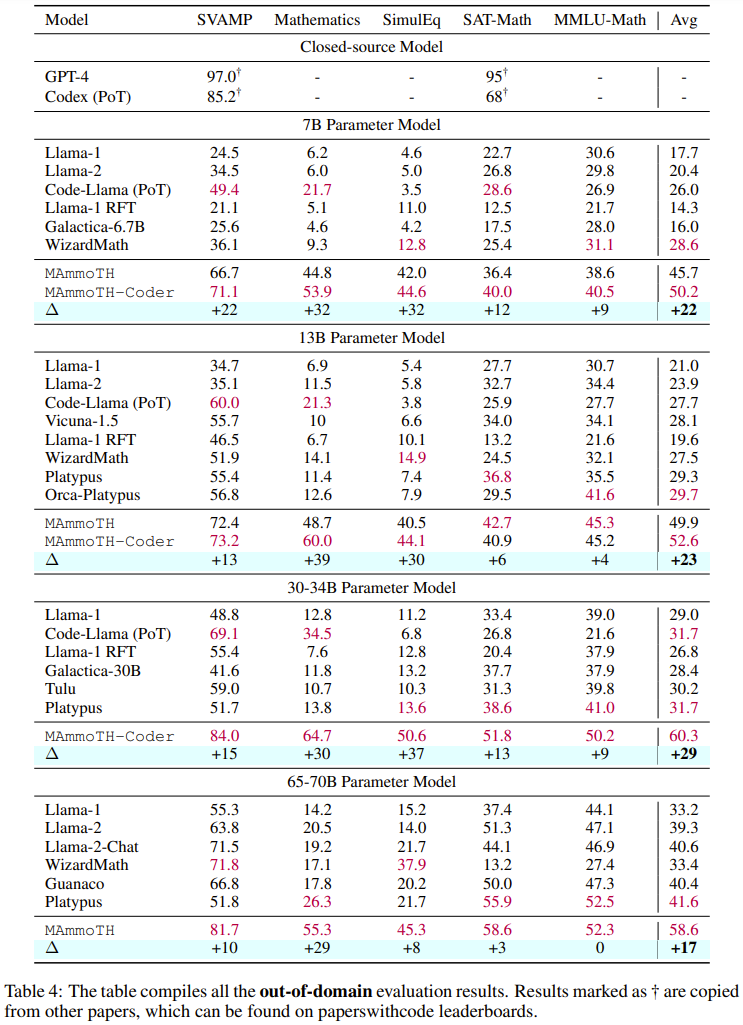

연구팀은 MAmmoTH를 평가하기 위해 도메인 내 테스트 세트(GSM8K, MATH, AQuA-RAT, NumGLUE)와 도메인 외부 테스트 세트(SVAMP, SAT, MMLU-Math, Mathematics, SimulEq)

연구 결과에 따르면 MAmmoTH 모델은 도메인 외부 데이터 세트를 일반화하는 데 더 나은 성능을 발휘하고 수학적 추론에서 오픈 소스 LLM의 능력도 크게 향상시키는 것으로 나타났습니다

일반적으로 사용되는 경쟁 수준 MATH 데이터 세트에서 MAmmoTH의 7B 버전은 WizardMath(이전 MATH의 최고의 오픈 소스 모델)를 3.5배(35.2% 대 10.7%)로 이길 수 있다는 점에 주목할 가치가 있습니다. 미세 조정 후 34B MAmmoTH-Coder는 CoT

를 사용하여 GPT-4를 초과할 수도 있습니다. 이 연구의 기여는 두 가지 측면으로 요약될 수 있습니다. (1) 데이터 엔지니어링 측면에서 고품질 수학 지침을 제안했습니다. 다양한 수학적 문제와 혼합 원리를 포함하는 미세 조정 데이터 세트입니다. (2) 모델링 측면에서 그들은 다양한 데이터 소스와 입출력 형식의 영향을 탐색하기 위해 50개 이상의 다양한 새로운 모델과 크기가 7B에서 70B에 이르는 기준 모델을 훈련하고 평가했습니다.

연구 결과는 다음과 같습니다. , MAmmoTH 및 MAmmoTH-Coder와 같은 새로운 모델은 정확도 측면에서 이전 오픈 소스 모델보다 훨씬 뛰어납니다

팀은 새로운 방법의 코드를 컴파일하고 오픈 소스화한 데이터 세트를 Hugging Face에서 공개했습니다. 동시에 팀은 고품질의 다양한 수학 지침 미세 조정 데이터 세트 목록을 작성하는 것을 목표로 합니다. 즉, (1) 다양한 수학적 영역과 복잡성 수준을 광범위하게 포괄하고 (2) CoT와 PoT 원칙을 결합해야 한다는 두 가지 주요 특성을 가져야 합니다.

For CoT와 PoT 원리를 결합한 두 번째 기능은 데이터 세트의 다양성을 향상시켜 훈련된 모델이 다양한 유형의 수학적 문제를 해결할 수 있도록 만듭니다. 그러나 대부분의 기존 데이터 세트는 제한된 절차적 근거를 제공하므로 CoT와 PoT 원칙 간의 불균형이 발생합니다. 이를 위해 팀은 GPT-4를 사용하여 MATH, AQuA, GSM8K 및 TheoremQA를 포함한 선택된 데이터 세트에 대한 PoT 원칙을 보완했습니다. 그런 다음 이러한 GPT-4 합성 프로그램은 실행 결과를 사람이 주석을 추가한 실제 정보와 비교하여 필터링되어 고품질 원칙만 추가되도록 합니다.

이 지침에 따라 아래 표 1에 자세히 설명된 대로 새로운 데이터 세트 MathInstruct를 만들었습니다.

혼합 CoT 및 PoT 원리를 포함하여 광범위한 핵심 수학 분야(산술, 대수, 확률, 미적분 및 기하학 등)를 포괄하는 260,000개의 쌍(명령, 응답)이 포함되어 있으며, 언어와 어려움.

Reset training

MathInstruct의 모든 하위 집합은 Alpaca의 명령 데이터 집합과 유사한 구조로 통합됩니다. 이 정규화 작업을 통해 결과적으로 미세 조정된 모델이 원본 데이터 세트의 형식에 관계없이 데이터를 일관되게 처리할 수 있습니다.

기본 모델의 경우 팀은 MathInstruct를 통해 Llama-2 및 Code Llama

를 선택했습니다. 조정을 위해 7B, 13B, 34B 및 70B를 포함한 다양한 크기의 모델을 얻었습니다. 아래 표 2를 참조하세요. 세트에는 수학의 여러 영역에 걸쳐 다양한 내부 및 외부 샘플이 포함되어 있습니다.

평가 데이터 세트에는 초등, 중등, 대학 수준을 포함한 다양한 난이도가 포함되어 있습니다. 일부 데이터세트에는 형식적 논리와 상식적 추론도 포함됩니다.

선택한 평가 데이터세트에는 개방형 질문과 객관식 질문이 모두 있습니다.

AQuA 및 MMLU와 같은 객관식 질문의 경우 연구원들은 이 데이터세트의 질문 대부분이 CoT에서 더 잘 처리될 수 있기 때문에 CoT 디코딩을 채택했습니다.CoT 디코딩에는 트리거 단어가 필요하지 않지만 PoT 디코딩에는 "문제를 해결하기 위한 프로그램을 작성하자"라는 트리거 단어가 필요합니다.

주요 결과

전반적으로 MAmmoTH와 MAmmoTH-Coder는 다양한 모델 크기에서 이전 최고의 모델보다 성능이 뛰어납니다. 새 모델은 도메인 내 데이터 세트보다 도메인 외부 데이터 세트에서 더 많은 성능 향상을 달성합니다. 이러한 결과는 새로운 모델이 수학적 일반주의자가 될 가능성이 있음을 나타냅니다. MAmmoTH-Coder-34B 및 MAmmoTH-70B는 일부 데이터 세트에서 비공개 소스 LLM보다 성능이 뛰어납니다.

연구원들은 또한 다양한 기본 모델을 사용하여 비교했습니다. 구체적으로 Llama-2와 Code-Llama라는 두 가지 기본 모델을 비교하는 실험을 수행했습니다. 위의 두 표에서 볼 수 있듯이 Code-Llama는 특히 필드 외부 데이터 세트에서 Llama-2보다 전반적으로 우수합니다. MAmmoTH와 MAmmoTH-Coder의 격차는 5%에 달할 수도 있습니다

데이터 소스에 대한 절제 연구 탐색

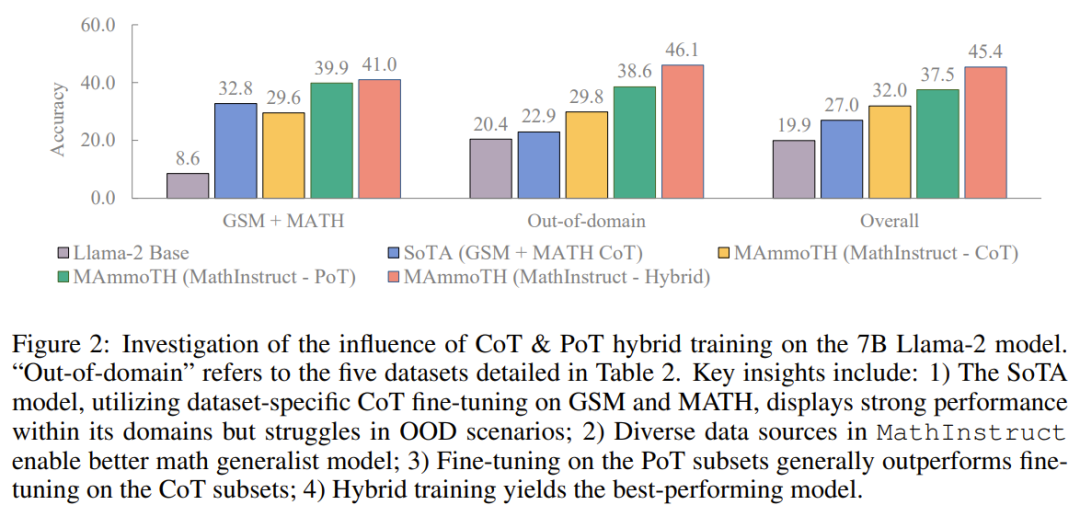

성능 향상의 원천을 탐색하기 위한 연구를 수행했습니다. 기존 벤치마크 모델에 비해 MAmmoTH의 장점을 더 잘 이해하기 위해 연구원들은 일련의 제어된 실험을 수행했습니다. 결과는 그림 2에 나와 있습니다. 요약하면 MAmmoTH의 중요한 성능 이점은 다음과 같습니다. 1) 다음을 포함하는 다양한 데이터 소스 다양한 수학적 영역 및 복잡성 수준, 2) CoT 및 PoT 지침 미세 조정을 위한 하이브리드 전략.

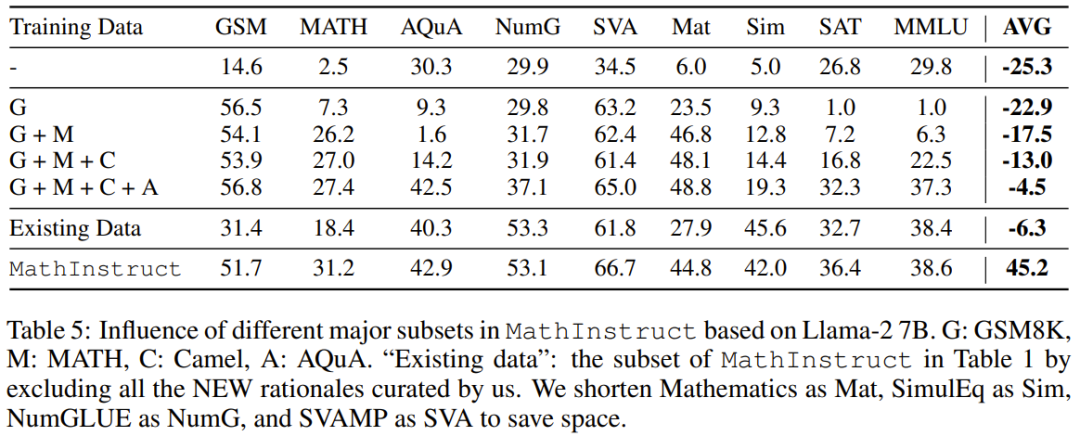

그들은 또한 주요 하위 집합의 영향도 연구했습니다. MAmmoTH 훈련에 사용되는 MathInstruct의 다양한 소스와 관련하여 각 소스가 모델의 전체 성능에 어느 정도 기여하는지 이해하는 것도 중요합니다. 그들은 GSM8K, MATH, Camel 및 AQuA의 네 가지 주요 하위 집합에 중점을 둡니다. 그들은 각 데이터 세트를 훈련에 점진적으로 추가하고 전체 MathInstruct에서 미세 조정된 모델과 성능을 비교하는 실험을 수행했습니다.

그들은 또한 주요 하위 집합의 영향도 연구했습니다. MAmmoTH 훈련에 사용되는 MathInstruct의 다양한 소스와 관련하여 각 소스가 모델의 전체 성능에 어느 정도 기여하는지 이해하는 것도 중요합니다. 그들은 GSM8K, MATH, Camel 및 AQuA의 네 가지 주요 하위 집합에 중점을 둡니다. 그들은 각 데이터 세트를 훈련에 점진적으로 추가하고 전체 MathInstruct에서 미세 조정된 모델과 성능을 비교하는 실험을 수행했습니다.

표 5의 결과에 따르면 훈련 데이터 세트의 다양성이 부족한 경우(예를 들어 GSM8K만 있는 경우) 모델의 일반화 능력이 매우 열악: 모델은 데이터 분포 내의 상황에만 적응할 수 있으며 GSM 문제 이외의 문제를 해결하기가 어렵습니다.

이 결과에서는 MAmmoTH에 대한 다양한 데이터 소스의 중요한 영향이 강조되며 MAmmoTH를 수학 일반주의자로 만드는 것입니다. 이러한 결과는 또한 향후 데이터 큐레이션 및 수집 노력에 귀중한 통찰력과 지침을 제공합니다. 예를 들어 우리는 항상 다양한 데이터를 수집하고 특정 유형의 데이터만 수집해서는 안 됩니다

이 결과에서는 MAmmoTH에 대한 다양한 데이터 소스의 중요한 영향이 강조되며 MAmmoTH를 수학 일반주의자로 만드는 것입니다. 이러한 결과는 또한 향후 데이터 큐레이션 및 수집 노력에 귀중한 통찰력과 지침을 제공합니다. 예를 들어 우리는 항상 다양한 데이터를 수집하고 특정 유형의 데이터만 수집해서는 안 됩니다

위 내용은 MAmmoT를 통해 LLM은 형식 논리부터 4가지 산술 연산까지 수학의 일반화가 됩니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!