바이촨 인텔리전트가 평균 28일 만에 대형 모델을 출시해 업계가 놀랐을 때도 회사는 멈추지 않았다.

9월 6일 오후 기자회견에서 Baichuan Intelligence는 미세 조정된 Baichuan-2 대형 모델의 공식 오픈 소스를 발표했습니다.

중국과학원 학자이자 칭화대학교 인공지능연구소 명예원장 장보가 기자회견에 참석했습니다.

중국과학원 학자이자 칭화대학교 인공지능연구소 명예원장 장보가 기자회견에 참석했습니다.

지난 8월 Baichuan-53B 대형 모델 출시 이후 Baichuan의 또 다른 신제품입니다. 오픈 소스 모델에는 Baichuan2-7B, Baichuan2-13B, Baichuan2-13B-Chat 및 해당 4비트 양자화 버전이 포함되며 모두 무료이며 상업적으로 사용할 수 있습니다.

Baichuan Intelligence는 모델 전체 공개 외에도 이번에 모델 훈련을 위한 Check Point를 오픈 소스로 공개했으며, 새 모델의 훈련 세부 사항을 자세히 설명하는 Baichuan 2 기술 보고서를 게시했습니다. Baichuan Intelligence의 설립자 겸 CEO인 Wang Xiaochuan은 이번 조치가 대형 모델 학술 기관, 개발자 및 기업 사용자가 대형 모델의 훈련 과정에 대한 심층적인 이해를 얻고 대형 모델의 기술 개발을 더 잘 촉진하는 데 도움이 될 수 있기를 희망한다고 밝혔습니다. 학술 연구 및 커뮤니티.

Baichuan 2 대형 모델 원본 링크: https://github.com/baichuan-inc/Baichuan2

기술 보고서: https://cdn.baichuan-ai.com/paper/Baichuan2-technical-report.pdf

오늘날의 오픈 소스 모델은 대형 모델에 비해 크기가 "더 작습니다". 그 중 Baichuan2-7B-Base와 Baichuan2-13B-Base는 모두 2조 6천억 개의 고품질 다국어 데이터를 기반으로 학습되었으며 이전 세대의 오픈 소스 모델을 유지합니다. 우수한 생성 및 생성 기능, 원활한 다단계 대화 기능, 낮은 배포 임계값 등 많은 기능을 기반으로 두 모델은 수학, 코딩, 보안, 논리적 추론 및 의미 이해 능력이 크게 향상되었습니다.

"간단히 말하면 Baichuan7B 70억 매개변수 모델은 이미 영어 벤치마크에서 LLaMA2의 130억 매개변수 모델과 동등합니다. 따라서 작은 것을 사용하여 큰 것을 만들 수 있으며 작은 모델은 Wang Xiaochuan은 "대형 모델의 능력과 동일한 본체에서 정량적 모델은 LLaMA2의 성능을 종합적으로 능가하는 더 높은 성능을 달성할 수 있습니다"라고 말했습니다.

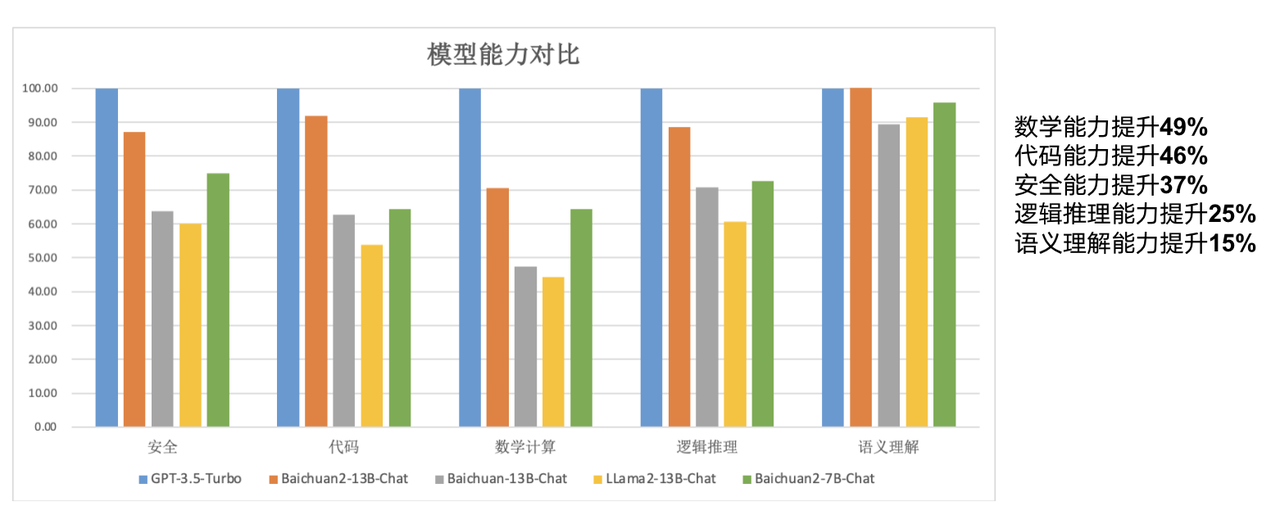

이전 세대 13B 모델과 비교하여 Baichuan2-13B-Base는 수학 능력 49%, 코딩 능력 46%, 보안 능력 37%, 논리적 추론 능력 25%, 의미 이해 능력 15% 향상되었습니다. .

보고서에 따르면 Baichuan Intelligence의 연구원들은 데이터 수집부터 새 모델의 미세 조정까지 많은 최적화를 수행했습니다.

"이전 검색에서 더 많은 경험을 활용하고, 대량의 모델 훈련 데이터에 대해 다세분성 콘텐츠 품질 채점을 수행했으며, 2억 6천만 T의 코퍼스 수준을 사용하여 7B 및 13B 모델을 훈련하고 다국어 지원을 추가했습니다." 왕샤오촨이 말했다. "Qianka A800 클러스터에서 180TFLOPS의 훈련 성능을 달성할 수 있으며 기계 활용률이 50%를 초과합니다. 또한 많은 보안 조정 작업도 완료했습니다.

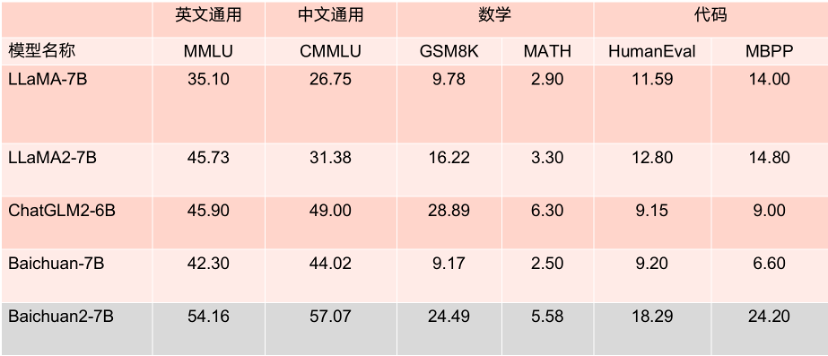

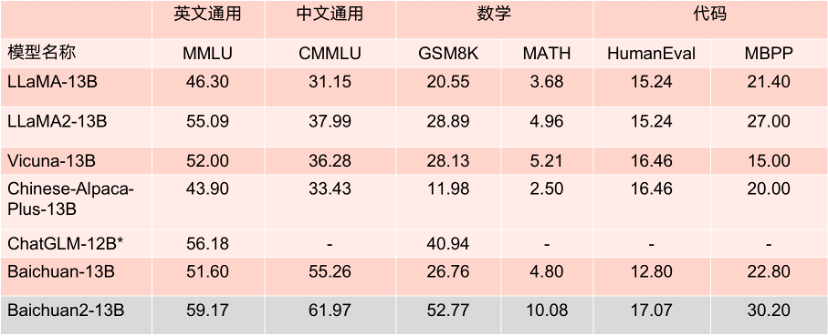

이번 두 오픈 소스 모델은 널리 사용됩니다." 주요 평가 목록에서 성능이 우수합니다. MMLU, CMMLU 및 GSM8K와 같은 여러 권위 있는 평가 벤치마크에서는 동일한 수의 매개변수를 가진 다른 모델에 비해 성능도 매우 뛰어납니다. 인상적이며 동일한 크기의 경쟁 제품인 LLaMA2보다 성능이 훨씬 뛰어납니다.

더 언급할 가치가 있는 점은 MMLU와 같은 여러 권위 있는 영어 평가 벤치마크에 따르면 Baichuan2-7B는 70억 개의 매개변수를 가진 주류 영어 작업에서 130억 개의 매개변수를 가진 LLaMA2와 동등하다는 것입니다.

7B 매개변수 모델의 벤치마크 결과.

13B 매개변수 모델의 벤치마크 결과.

Baichuan2-7B 및 Baichuan2-13B는 학문적 연구에 완전히 개방되어 있을 뿐만 아니라 개발자가 공식 상용 라이센스를 얻기 위해 이메일로 신청한 후 무료로 상업적으로 사용할 수도 있습니다.

"모델 출시 외에도 학술 분야에 더 많은 지원을 제공할 수 있기를 바랍니다"라고 Wang Xiaochuan은 말했습니다. "기술 보고서 외에도 Baichuan2 대형 모델 훈련 프로세스에서 가중치 매개변수 모델도 공개했습니다. 이는 모든 사람이 사전 훈련을 이해하고 미세 조정 및 개선을 수행하는 데 도움이 될 수 있습니다. 이는 중국에서도 처음입니다. 》

대규모 모델 학습에는 대규모 고품질 데이터 획득, 대규모 학습 클러스터의 안정적인 학습, 모델 알고리즘 튜닝 등 여러 단계가 포함됩니다. 각 링크에는 많은 양의 재능, 컴퓨팅 성능 및 기타 리소스에 대한 투자가 필요합니다. 모델을 처음부터 완전히 훈련하는 데 드는 높은 비용으로 인해 학계에서는 대규모 모델 훈련에 대한 심층적인 연구를 수행하는 데 방해가 되었습니다.

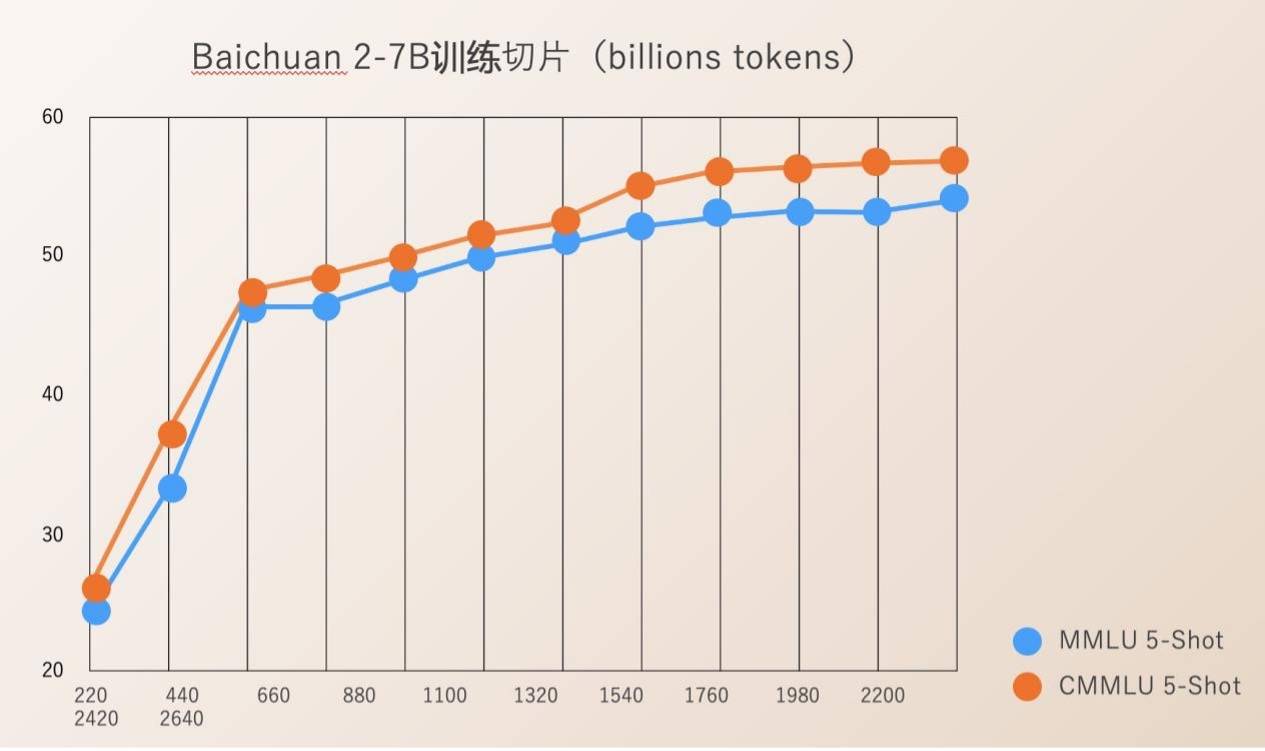

Baichuan Intelligence는 220B에서 2640B까지의 모델 학습 전 과정에 대해 Check Ponit을 오픈 소스로 제공합니다. 이는 과학 연구 기관이 대형 모델 훈련 과정, 모델 지속적인 훈련, 모델 가치 정렬 등을 연구하는 데 큰 가치가 있으며 국내 대형 모델의 과학 연구 진행을 촉진할 수 있습니다.

이전에는 대부분의 오픈 소스 모델이 자체 모델 가중치만 공개했고 훈련 세부 사항은 거의 언급되지 않았습니다. 개발자는 제한된 미세 조정만 수행할 수 있었기 때문에 심층적인 연구를 수행하기가 어려웠습니다.

Baichuan Intelligence에서 발행한 Baichuan 2 기술 보고서는 데이터 처리, 모델 구조 최적화, 스케일링 법칙, 프로세스 지표 등을 포함한 Baichuan 2 훈련의 전체 프로세스를 자세히 설명합니다.

Baichuan Intelligence는 창립 이래 오픈 소스를 통해 중국 대형 모델 생태계의 번영을 촉진하는 것을 회사의 중요한 발전 방향으로 간주해 왔습니다. 설립된 지 4개월이 채 되지 않아 오픈소스 무료 상업용 중국 대형 모델인 Baichuan-7B와 Baichuan-13B를 출시했고, 검색이 강화된 대형 모델인 Baichuan-53B도 평가를 받았습니다. 많은 권위 있는 리뷰에서 상위권에 올랐으며 500만 번 이상 다운로드되었습니다.

지난 주, 대규모 모델 공익 사진의 첫 번째 배치 출시는 기술 분야에서 중요한 뉴스였습니다. 올해 설립된 대형 모델 기업 중 바이촨 인텔리전스는 유일하게 '생성 인공 지능 서비스 관리 임시 조치'에 등록되어 공식적으로 대중에게 서비스를 제공할 수 있다.

업계 최고의 기본 대형 모델 R&D 및 혁신 역량을 갖춘 이번에 오픈 소스로 제공되는 Baichuan 2 대형 모델 2개는 Tencent Cloud, Alibaba Cloud, Volcano Ark, Huawei, MediaTek 등을 포함한 업스트림 및 다운스트림 기업으로부터 긍정적인 반응을 받았습니다. 유명 기업 모두 이번 회의에 참가하여 Baichuan Intelligence와 협력을 맺었습니다. 보도에 따르면 지난 달 Hugging Face에서 Baichuan Intelligence의 대형 모델 다운로드 건수는 337만 건에 달했습니다.

Baichuan Intelligence의 이전 계획에 따르면 올해 1,000억 개의 매개변수를 갖춘 대형 모델을 출시하고 내년 1분기에 '슈퍼 애플리케이션'을 출시할 예정입니다.

위 내용은 Baichuan Intelligent는 Baichuan2 대형 모델을 출시했습니다. 이는 Llama2보다 완전히 앞서 있으며 훈련 슬라이스도 오픈 소스입니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!