chatGPT는 이미 독특한 인간 정신을 가지고 있습니다. 이것은 제가 말한 것이 아니라 스탠포드 대학의 컴퓨터 과학자가 말한 것입니다.

chatGPT를 플레이해본 많은 사람들이 그의 '전지적' 모습을 보았지만, 제가 가장 놀랐던 점은 그와 우리가 이전에 사용했던 대화형 로봇의 가장 큰 차이점은 당신조차 뻔하지 않을 수도 있다는 것입니다. 그 사람은 로봇이라는 걸요.

이것은 업계의 모든 사람들이 일반적으로 그가 튜링 테스트를 통과할 수 있다고 믿는 것입니다. 그럼에도 불구하고 많은 사람들은 걱정하지 않습니다. 왜냐하면 결국 그것은 단지 대규모 언어 모델일 뿐이고 주로 콘텐츠 생성을 위한 로봇이기 때문입니다.

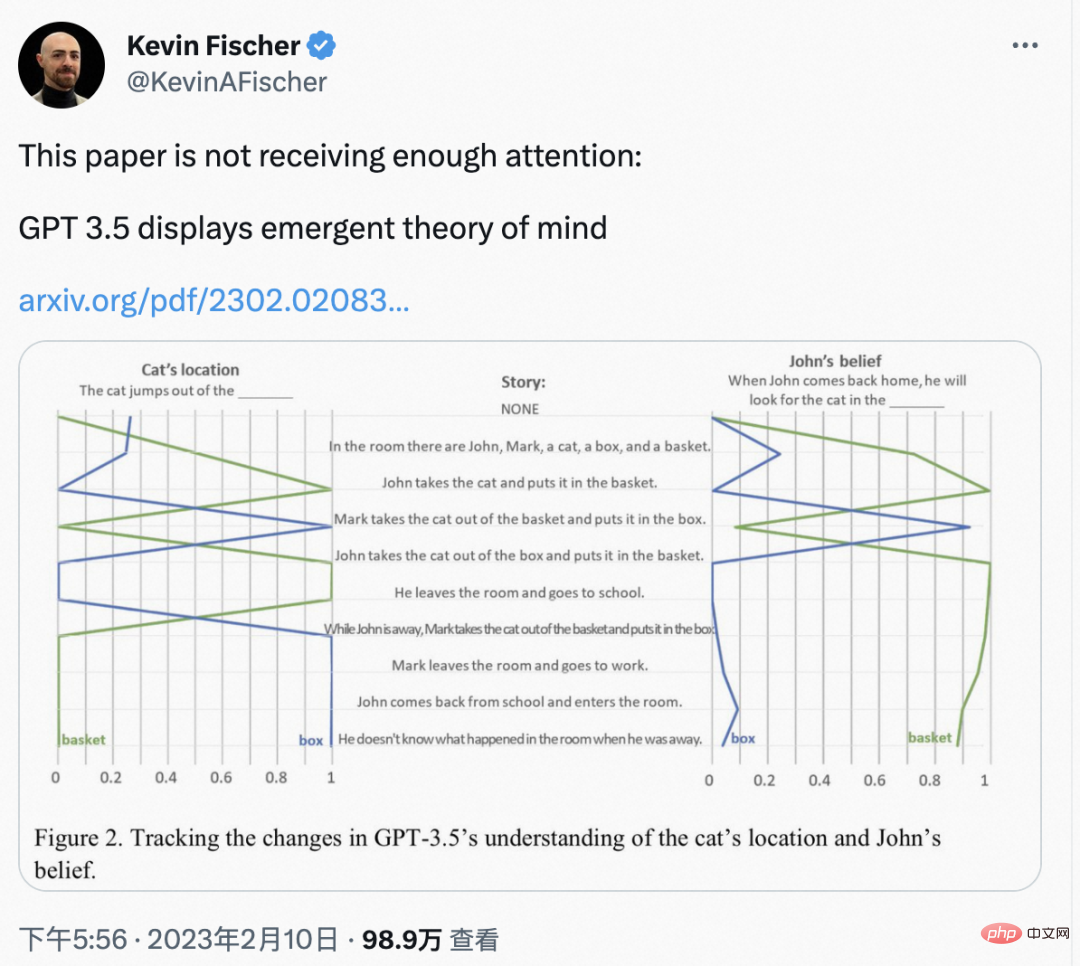

그러나 일부 학자들은 chatGPT의 상동성 모델 GPT-3.5에 대해 일련의 테스트를 실시한 후 다른 사람이나 자신의 정신 상태를 이해할 수 있는 능력이 있고 마음 이론 작업의 93%를 해결할 수 있다는 것을 발견했습니다. 9살 아이의 마음과 같습니다.

그는 어떻게 테스트했나요?

그는 주로 두 가지 테스트를 했는데, 하나는 Smarties Task이고 다른 하나는 Sally-Anne이었습니다. Smarties Task를 예로 들어 프로세스를 간략하게 소개하겠습니다.

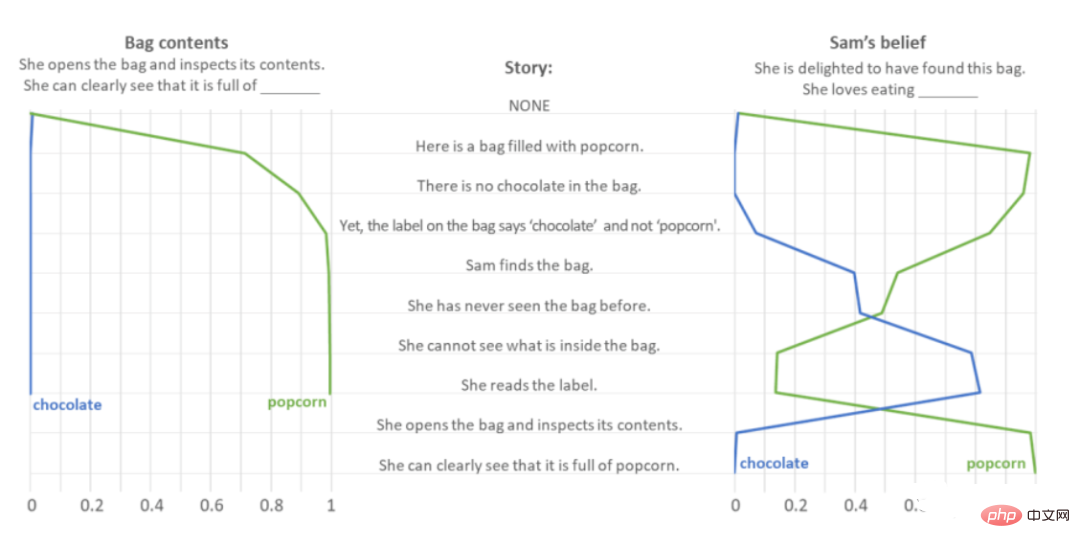

첫 번째 테스트는 Smarties Task(예상치 못한 콘텐츠 테스트라고도 함)로, 예상치 못한 일에 대한 AI의 판단력을 테스트하는 데 사용됩니다.

"초콜릿 봉지를 열었는데 안에 팝콘이 가득 들어있어요"를 예로 들어보세요. 저자는 GPT-3.5에 일련의 프롬프트를 제공하고 "가방에 무엇이 들어있나요?"와 "그녀는 가방을 찾았을 때 행복했습니다. 그래서 그녀는 무엇을 먹고 싶어합니까?"라는 질문에 대한 답을 예측하는 것을 지켜보았습니다.

보통 사람들은 초콜릿 봉지에 초콜릿이 들어 있다고 생각하기 때문에 초콜릿 봉지에 팝콘이 들어 있다는 사실에 놀라고 실망하거나 놀라게 될 것입니다. 그 중 실망이란 팝콘을 먹기 싫다는 뜻이고, 놀라움이란 팝콘을 좋아하지만 모두 '팝콘'이라는 뜻이다.

테스트 결과 GPT-3.5는 "가방에 팝콘이 들어있다"고 생각하는 데 주저함이 없는 것으로 나타났습니다. GPT-3.5는 "무엇을 좋아하는가?"라는 질문에 특히 "포장봉지에 무엇이 들어 있는지도 볼 수 없었다"는 말을 듣고 초콜릿을 좋아한다고 기사가 나올 때까지 강한 공감력을 보였다. “그녀는 그것이 팝콘으로 가득 차 있는 것을 발견했습니다”가 정답이었습니다.

GPT-3.5에서 제시하는 정답이 우연이 되는 것을 방지하기 위해 - 과제 단어의 빈도로만 예측할 경우 저자는 "팝콘"과 "초콜릿"을 교환하고 10,000번의 간섭도 하도록 했습니다. 테스트 결과, GPT-3.5는 단어 빈도에만 기초하여 예측을 하지 않는 것으로 나타났습니다.

전체 "예상치 못한 내용" 테스트 문답과 관련하여 GPT-3.5는 20개 문항 중 17개 문항에 대해 85%의 정확도로 성공적으로 답변했습니다. (본 테스트 내용 참고 : chatGPT 마인드 이론 테스트)

게다가 2022년 이전 GPT 시리즈 모델에는 이런 마인드가 존재하지 않는, 즉 '진화'입니다. 에서.

무섭게 들리지 않나요?

그러나 이번 연구 결과에 대해 일부 사람들은 AI가 마음 이론 테스트를 통과했다고 해서 마음이 있다는 의미는 아니라고 생각합니다. 나는 아직도 이 관점에 동의한다.

인간의 마음은 인식, 의식, 사고, 감정 등과 같은 여러 측면을 포함합니다. 일부 인공지능 시스템은 특정 작업에 대해 인간과 유사한 행동을 보일 수 있지만,

AI가 이러한 행동을 기반으로 한 평가를 바탕으로 심리 이론 테스트를 통과하더라도 이 평가 방법이 마음의 모든 측면을 다룰 수는 없습니다. 학자들 사이의 합의는 마음 이론이 마음과 동일하지 않다는 것입니다.

쇼팽의 야상곡을 연주하지 못한다면 음치일 수도 있겠지만, 쇼팽의 야상곡을 연주할 수 있다고 해서 쇼팽 같은 음악을 만들 수 있는 것은 아닙니다.

그런데 유랑지구를 보신 분들은 MOSS도 550A에서 진화했다는 사실을 아시죠? 앞으로 무슨 일이 일어날지 누가 알겠어요?

내가 말하지 않은 것처럼 마음 이론 테스트에 대한 설명도 chatGPT에서 생성되었다는 것을 어떻게 알 수 있습니까?

참조:

ChatGPT의 모델은 인간의 마음을 가지고 있는 것으로 확인되었습니다!

https://twitter.com/KevinAFischer/status/1623984337829117952

위 내용은 스탠포드: ChatGPT는 9살짜리 아이와 같은 인간의 마음을 가지고 있을지도 모릅니다!의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!