희소 전문가 모델은 30년이 된 개념으로 오늘날에도 여전히 널리 사용되고 있으며 딥 러닝에서 널리 사용되는 아키텍처입니다. 이러한 아키텍처에는 MoE(하이브리드 전문가 시스템), 스위치 변환기, 라우팅 네트워크, BASE 레이어 등이 포함됩니다. 희소 전문가 모델은 자연어 처리, 컴퓨터 비전, 음성 인식 등 다양한 분야에서 좋은 성능을 보여왔습니다.

최근 구글 AI 리더 제프 딘(Jeff Dean) 등이 희소 전문가 모델에 대한 리뷰를 작성해 희소 전문가 모델의 개념을 검토하고, 일반 알고리즘에 대한 기본 설명을 제공하며, 마지막으로 향후 연구 방향을 기대하고 있다.

논문 주소: https://arxiv.org/pdf/2209.01667.pdf

컴퓨팅 예산, 훈련 데이터 및 모델 크기 증가, 기계 학습(특히 자연어) 상당한 진전을 이루었습니다. 잘 알려진 이정표 언어 모델에는 GPT-2(Radford et al., 2018), BERT(Devlin et al., 2018), T5(Raffel et al., 2019), GPT-3(Brown et al., 2020)이 있습니다. , Gopher(Rae et al., 2021), Chinchilla(Hoffmann et al., 2022) 및 PaLM(Chowdhery et al., 2022).

그러나 이제 최첨단 모델에는 수천 개의 전용 상호 연결된 가속기가 필요하고 훈련하는 데 몇 주 또는 몇 달이 걸리기 때문에 이러한 모델을 생산하는 데 비용이 많이 듭니다(Patterson et al., 2021). 기계 학습 시스템이 확장됨에 따라 현장에서는 보다 효율적인 교육 및 서비스 패러다임을 추구합니다. 희소 전문가 모델이 유망한 솔루션으로 등장했습니다.

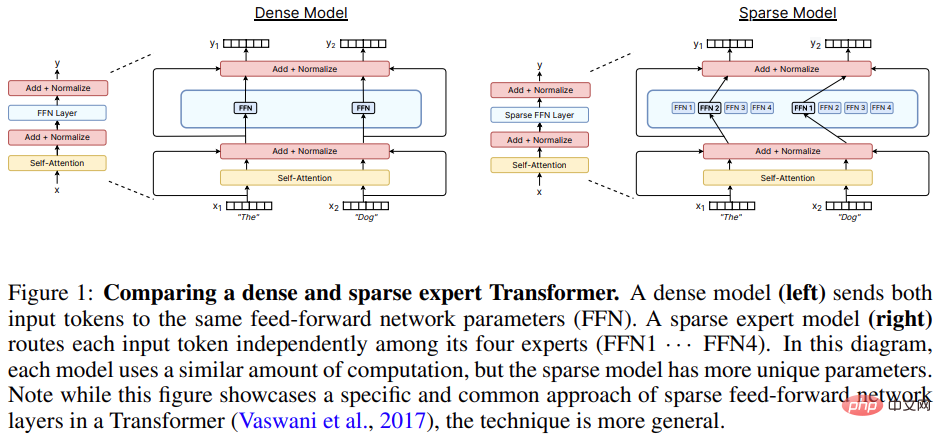

희소 전문가 모델(MoE(혼합 전문가 시스템)이 가장 널리 사용되는 변형)는 일련의 매개변수가 "전문가"와 각 "전문가"로 구분되는 특별한 유형의 신경망입니다. 독특한 무게감을 가지고 있습니다.

훈련 및 추론 중에 모델은 입력 샘플을 특정 전문가 가중치에 제공하여 각 입력에 대해 전체 네트워크를 사용하는 기존 방법과 달리 각 샘플이 네트워크 매개변수의 하위 집합과만 상호 작용할 수 있도록 합니다. 각 샘플에 소수의 전문가만 사용되므로 전체 모델에 비해 계산 노력이 크게 줄어듭니다.

많은 현대의 희소 전문가 모델이 Shazeer 외(2017)에서 영감을 얻습니다. 연구는 당시 최대 규모의 모델을 훈련해 최첨단 언어 모델링 및 번역 결과를 달성했다. 희소 전문가 모델의 인기는 Transformer 언어 모델과 함께 사용될 때 더욱 급증했습니다(Lepikhin et al., 2020; Fedus et al., 2021). 대부분의 작업은 자연어 처리에 관한 것이지만, 희소 전문가 모델은 컴퓨터 비전(Puigcerver et al., 2020), 음성 인식(You et al., 2021) 및 다중 양식 학습을 포함한 다양한 분야에서도 성공적으로 사용되었습니다. (무스타파 외, 2022) Clark et al.(2022)은 다양한 모델 크기와 전문가 수에 따라 희소 전문가 모델의 확장 속성을 연구했습니다. 또한, 현재 많은 벤치마크에서 최첨단 결과는 ST-MoE(Zoph et al., 2022)와 같은 희소 전문가 모델에 의해 보유되고 있습니다. 이 분야는 연구와 엔지니어링의 발전으로 빠르게 발전하고 있습니다.

이 리뷰 논문은 좁은 딥러닝 시대(2012년 시작)에서 연구 범위를 희박한 전문가 모델로 좁히고 최근 진행 상황을 검토하며 유망한 미래 방안에 대해 논의합니다.

머신러닝에서 MoE의 개념은 최소 30년 전으로 거슬러 올라갑니다. 초기 개념에서 전문가들은 완전한 신경망을 정의했으며 MoE는 앙상블 방법과 유사했습니다.

Eigen et al.(2013)은 지터링된 MNIST에서 스택 레이어 전문 하이브리드 아키텍처를 사용하도록 제안했습니다. 이 작업은 후속 모델의 효율적인 구현을 위한 기반을 마련했습니다.

Shazeer et al.(2017)은 두 개의 LSTM 레이어 사이에 MoE 레이어를 삽입할 것을 제안했으며, 결과적으로 생성된 희소 모델은 기계 번역에서 SOTA 성능을 달성했습니다. 그러나 이 방법은 성공했음에도 불구하고 후속 연구는 동면과 정체 상태에 빠져 대부분의 연구는 Transformer로 방향을 틀었다.

2020년과 2021년 사이에 GShard와 Switch Transformer가 출시되었으며 둘 다 Transformer의 피드포워드 레이어를 전문가 레이어로 대체했습니다.

전문가 계층을 활용하는 접근 방식이 지배적인 패러다임이 되었지만, 지난 2년간의 연구에서는 전문가 모델의 개념을 모듈화 및 구성성을 달성하기 위해 완전히 독립적인 모델로 재검토했습니다.

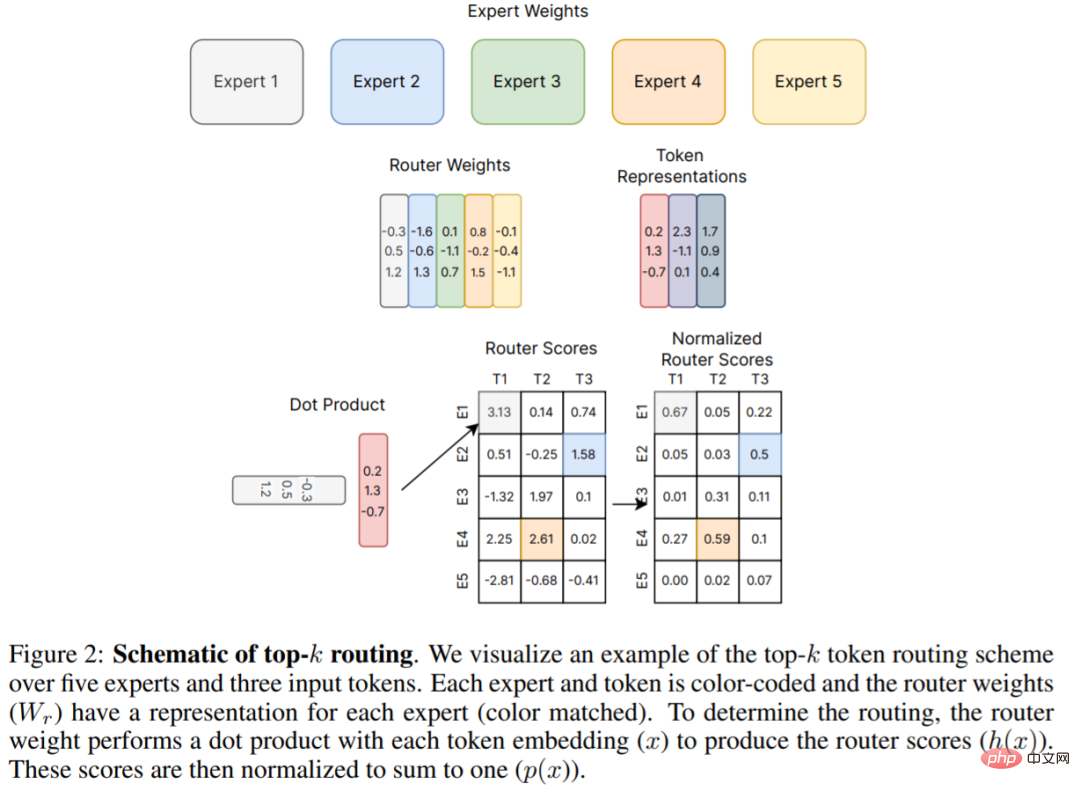

아래 그림 2는 Shazeer et al.(2017)이 제안한 최초의 top-k 라우팅 메커니즘으로, 이는 이후 많은 연구의 기초가 됩니다. 이 검토 논문에서는 4장에서 라우팅 알고리즘의 새로운 개발에 대해 자세히 설명합니다.

하드웨어

최신 희소 전문가 모델은 최대 규모의 신경망을 훈련하기 위해 분산 시스템과 공동 설계되었습니다.

대규모 신경망에 대한 연구(Brown et al., 2020; Rae et al., 2021; Chowdhery et al., 2022)는 신경망이 단일 가속기의 메모리 용량을 훨씬 초과했음을 보여줍니다. 함수, 최적화 변수와 같은 Tensor에는 다양한 병렬 전략을 사용한 샤딩이 필요합니다.

세 가지 일반적인 병렬 방법에는 데이터 병렬성(모델 가중치 복사, 데이터 샤딩), 텐서 모델 병렬성(데이터 및 가중치 텐서가 장치 간에 샤딩됨), 파이프라인 병렬성(전체 레이어 또는 레이어 그룹이 디바이스 간에 샤딩됨)이 포함됩니다. 하이브리드 전문가 모델은 종종 이러한 병렬 시나리오에 적응할 수 있습니다.

MoE 모델의 훈련 및 배포 측면에서 Jaszczur et al.(2021)은 Transformer 모델의 모든 레이어를 희소화하여 37배의 추론 가속화를 달성했습니다. 라이브러리 정적 전문가 배치 크기의 제약 문제가 해결되었습니다.

데이터 병렬성, 모델 병렬성 및 전문가 병렬성 외에도 Rajbhandari et al.(2022)은 ZeRO 파티셔닝 및 ZeRO-Offload를 지원하는 DeepSpeed-MoE 라이브러리를 제안하여 10배의 추론 개선 및 SOTA 변환 성능을 달성했습니다. 생산 서비스에서 모델의 실용성이 입증되었습니다.

밀도 신경 언어 모델의 교차 엔트로피 손실은 모델 매개변수 수, 데이터 볼륨 및 계산 예산과 관련하여 거듭제곱 법칙으로 동작합니다(Kaplan et al., 2020). 멱함수 법칙 계수는 나중에 Hoffmann et al.(2022)에서 수정되었으며, 이는 최적의 모델을 계산하려면 데이터와 매개변수 확장의 더 긴밀한 균형이 필요함을 시사합니다. 대조적으로, 경험적으로 확장한 희소 전문가 모델에 대한 초기 연구는 강력한 경험적 결과를 얻었지만 확장 법칙을 주의 깊게 설명하지 않았습니다. 또한 일부 연구에서는 업스트림(예: 사전 훈련)과 다운스트림(예: 미세 조정) 작업 간의 차이점을 강조하여(Fedus et al., 2021; Artetxe et al., 2021) 희소 전문가 모델에 대한 이해를 더욱 복잡하게 만들었습니다.

Upstream Extensions

Sparse 전문가 모델은 대규모 데이터 세트에 대해 훈련할 때 좋은 성능을 발휘합니다. 자연어 처리의 일반적인 패턴은 관심 있는 특정 데이터 분포에 대해 업스트림 훈련(예: 사전 훈련)을 수행한 후 다운스트림 훈련(예: 미세 조정)을 수행하는 것입니다. 업스트림 단계에서는 희소 전문가 모델이 밀도가 높은 대응 모델보다 일관되게 더 높은 이득을 산출합니다. Shazeer et al.(2017)은 10억 단어 언어 모델링 벤치마크(Chelba et al., 2013)에서 모델 매개변수 및 계산 예산과 관련된 스케일링 곡선을 제안하여 밀집 버전에 비해 상당한 이득을 달성했습니다. Lepikhin et al.(2020)은 모델 확장 기능의 개선된 버전을 제안하고 최대 600B 매개변수 희소 모델에서 13.5의 BLEU 점수 이득을 달성했습니다. Switch Transformer(Fedus et al., 2021)는 동일한 계산 리소스를 사용하여 T5 모델에서 벽 시간 속도가 4~7배 향상되는 것을 측정했습니다. 또한 이 연구에서는 매개변수 개수의 함수로 교차 엔트로피 손실의 규모를 조사했지만 전문가가 256명을 넘으면 이득이 감소하는 것으로 관찰되었습니다.

다운스트림 확장

그러나 안정적인 업스트림 확장은 다운스트림 작업에서 즉시 일관된 이익을 얻지 못했습니다. 전송 문제를 강조한 연구에서 Fedus et al.(2021)은 낮은 계산, 높은 매개변수 인코더-디코더 Transformer(1.6T 매개변수, 희소 레이어당 전문가 2048명)를 사용하여 4배의 사전 훈련을 관찰했지만 실제로는 그렇습니다. SuperGLUE와 같은 집중적인 추론 작업에서는 미세 조정이 잘 이루어지지 않습니다. 이 발견은 추가로 필요한 연구와 계산과 매개변수 사이에 필요할 수 있는 균형을 암시합니다.

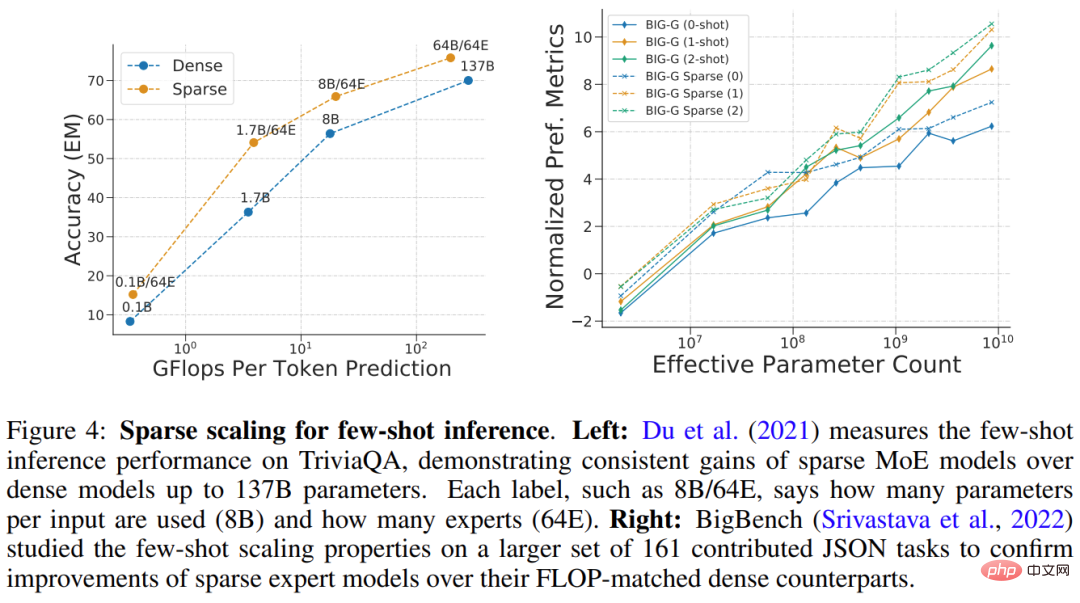

Du et al.(2021)은 희소 레이어당 64명의 전문가를 사용하여 1B-64B FLOP 범위의 희소 GLaM 모델 확장을 시연했습니다. GLaM은 제로샷 및 원샷 성능 측면에서 175B 매개변수 GPT-3 모델(Brown et al., 2020)을 능가하는 SOTA 결과를 달성했습니다. 동시에 추론 중에 각 토큰이 사용하는 FLOP는 49만큼 감소했습니다. %. 소비량이 65% 감소했습니다(아래 그림 4(왼쪽) 참조). 아래 그림 4(오른쪽)는 소수의 추론에서 좋은 성능을 보이는 희소 모델의 또 다른 예입니다.

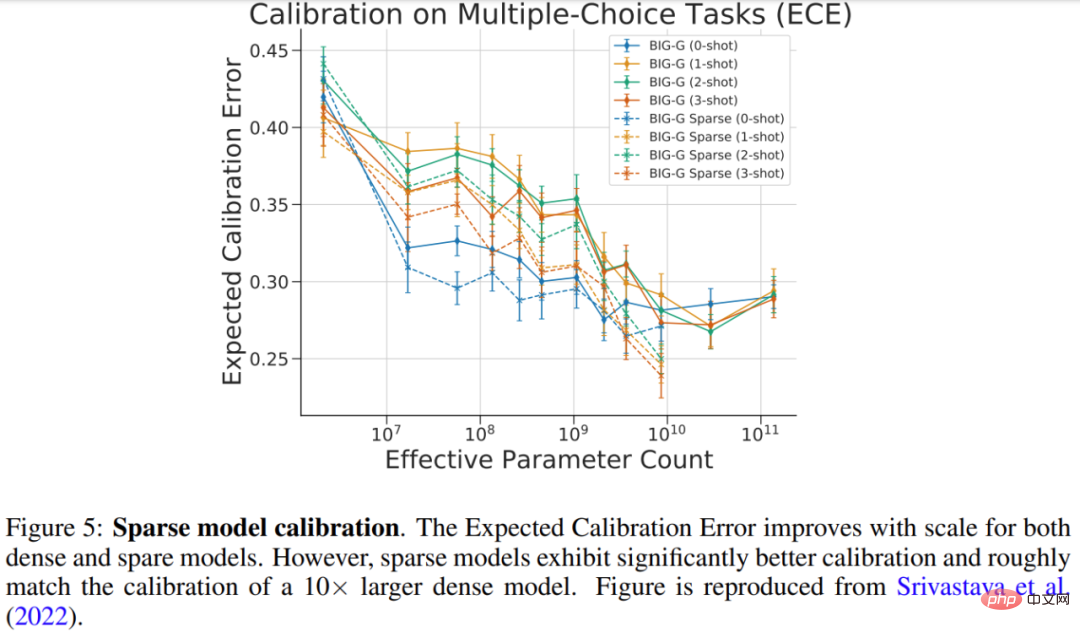

Srivastava et al.(2022)은 예측 확률이 올바른 확률과 얼마나 잘 일치하는지 측정하는 객관식 BIG-Bench 작업에 대한 희소 모델 보정을 연구했습니다. 연구 결과는 아래 그림 5에 나와 있습니다. 더 큰 밀도 모델과 희소 모델 모두에 대해 보정이 향상되었지만 희소 모델의 보정은 10배 더 많은 FLOP를 사용하는 밀도 모델의 보정과 비슷했습니다.

전문가 레이어의 수, 크기 및 빈도 확장

희소 전문가 모델의 확장을 제어하는 몇 가지 중요한 하이퍼 매개변수가 있습니다. 여기에는 1) 전문가 수, 2) 전문가 수 전문가 규모별 전문가 수, 3) 전문가 계층의 빈도. 이러한 결정은 업스트림 및 다운스트림 확장에 상당한 영향을 미칠 수 있습니다.

많은 초기 작업이 계층당 상대적으로 작은 수천 명의 전문가로 확장되어 사전 훈련 및 번역 품질이 뛰어났습니다(Shazeer et al., 2017; Lepikhin et al., 2020; Fedus et al., 2021). 그러나 희소 모델의 품질은 도메인 이동(Artetxe et al., 2021) 또는 다양한 작업 분포에 대한 미세 조정(Fedus et al., 2021) 시 불균형적으로 저하됩니다. 계산과 매개변수의 더 나은 균형을 달성하기 위해 소수 샷 추론(GLaM(Du et al., 2021)) 및 미세 조정(ST-MoE(Zoph et al., 2022))을 위한 SOTA 희소 모델만 사용할 수 있습니다. 기껏해야 64명의 더 큰 전문가. 전문가 차원이 증가함에 따라 이러한 모델에는 가속기가 효과적으로 실행되기 위한 특정 시스템 수준 샤딩 전략이 필요합니다(Du et al., 2021; Rajbhandari et al., 2022).

라우팅 알고리즘은 모든 희소 전문 아키텍처의 핵심 기능이며 샘플을 보낼 위치를 결정합니다. 이 영역은 고정되고 학습되지 않은 라우팅 패턴을 사용하는 반직관적 접근 방식을 포함하여 광범위하게 연구되었습니다(Roller et al., 2021). 어떤 전문가를 선택할지에 대해 개별적인 결정이 내려지기 때문에 라우팅 결정은 차별화할 수 없는 경우가 많습니다.

전문가 선택 문제는 나중에 Bandit 문제로 재정의되었으며, 강화 학습을 사용하여 전문가 선택을 학습하는 연구도 있었습니다(Bengio et al., 2016; Rosenbaum et al., 2017; 2019; Clark et al. , 2022 ). Shazeer et al.(2017)은 강화 학습의 어려움을 피하기 위해 차별화 가능한 휴리스틱 알고리즘을 제안했습니다.

이 문서에서는 라우팅 알고리즘의 분류에 대해 자세히 설명하고 이 분야의 핵심 문제인 로드 밸런싱에 대해 자세히 설명합니다.

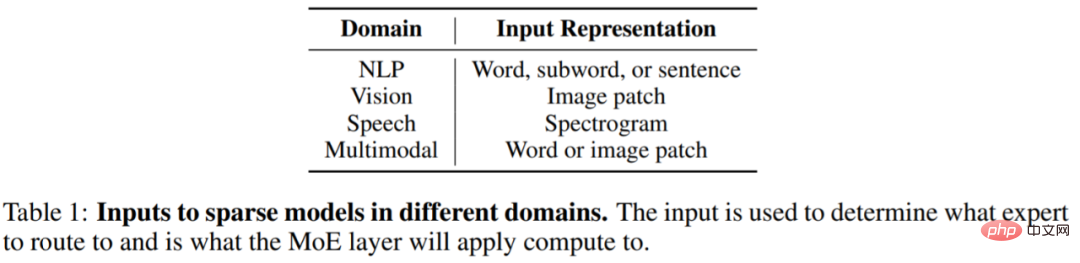

희소 전문가 모델의 영향력은 NLP를 넘어 컴퓨터 비전, 음성 인식, 멀티모달 애플리케이션 등 다른 분야로 빠르게 확산되고 있습니다. 도메인은 다르지만 모델의 아키텍처와 알고리즘은 대략 동일하며 아래 표 1은 다양한 도메인에 대한 희소 레이어 입력 표현을 보여줍니다.

희소 전문가 모델은 최근 몇 년 동안 매우 빠르게 발전했습니다. NLP 분야를 예로 들어 Shazeer et al.(2017)은 LSTM 모델의 표준 레이어 사이에 삽입되는 LSTM 언어 모델링 및 기계 번역을 위한 하이브리드 전문가 레이어를 도입했습니다.

2020년 Lepikhin et al.(2020)은 처음으로 Transformer에 MoE 레이어를 도입했습니다. 연구원들이 각 전문가 레이어를 2048명의 전문가로 확장했을 때 모델은 100개 언어에 대한 SOTA 번역 결과를 달성했습니다.

Fedus et al.(2021)은 SOTA 사전 학습 품질을 달성하는 희소 1.6T 매개변수 언어 모델을 만들었습니다.

새로운 연구가 소수 학습 추론 및 미세 조정 벤치마크 개발을 주도하고 있습니다. Du et al.(2021)은 순수 MoE 디코더 언어 모델을 훈련하여 작은 샘플에서 SOTA 결과를 달성하고 GPT-3을 훈련하는 데 필요한 계산의 1/3만 필요합니다. Zoph et al.(2022)은 광범위한 추론 및 생성 작업에서 SOTA를 달성하는 희소 인코더-디코더 모델인 ST-MoE를 제안했습니다. SuperGLUE에서 미세 조정하면 ST-MoE는 사전 훈련 FLOP의 약 1/20과 추론 FLOP의 1/40만 사용하면서 PaLM-540B보다 성능이 뛰어납니다.

일반적인 질문은 고정된 컴퓨팅 또는 FLOP 예산(예: 20시간 동안 100개의 GPU)이 주어진 경우 최고의 성능을 얻으려면 어떤 유형의 모델을 학습해야 하느냐는 것입니다.

기본적으로 희소 모델을 사용하면 샘플당 FLOP를 대략 일정하게 유지하면서 전문가 수를 늘려 모델의 매개변수 수를 대폭 늘릴 수 있습니다. 이 접근 방식은 모델의 목적에 따라 좋을 수도 있고 나쁠 수도 있습니다.

희소성은 희소성 사용에 따른 모든 추가 매개변수를 전달하는 가속기(예: GPU/TPU)가 많을 때 유용합니다.

희소성을 사용하려면 다운스트림 작업을 신중하게 고려해야 합니다. 사전 학습을 위한 머신은 많지만 미세 조정이나 서빙을 위한 머신은 적은 경우 다운스트림 사용 사례에서 사용할 수 있는 메모리 양에 따라 희소성(예: 전문가 수)을 조정해야 합니다.

어떤 경우에는 희소 모델이 밀도 모델보다 항상 더 나빠 보입니다. 예를 들어, 모든 매개변수가 가속기 메모리에 저장되면 희소 모델은 밀집 모델보다 열등합니다. 희소 모델은 전문가의 추가 모델 매개변수를 호스팅하기 위해 여러 시스템에서 병렬로 훈련하거나 서비스할 수 있는 능력이 있는 경우에 이상적입니다.

또한 이 리뷰 논문에서는 희소 모델 훈련의 개선, 해석 가능성 및 향후 연구 방향을 소개합니다. 관심 있는 친구는 원본 논문을 보고 연구 내용에 대해 자세히 알아볼 수 있습니다.

위 내용은 30년 간의 역사적 리뷰, Jeff Dean: 우리는 '희소 전문가 모델'에 대한 연구 리뷰를 편집했습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!