본 글은 AI 뉴미디어 큐빗(공개 계정 ID: QbitAI)의 승인을 받아 재인쇄되었습니다.

Tesla에 대한 조사로 인해 소셜 미디어에서 소란이 발생했습니다.

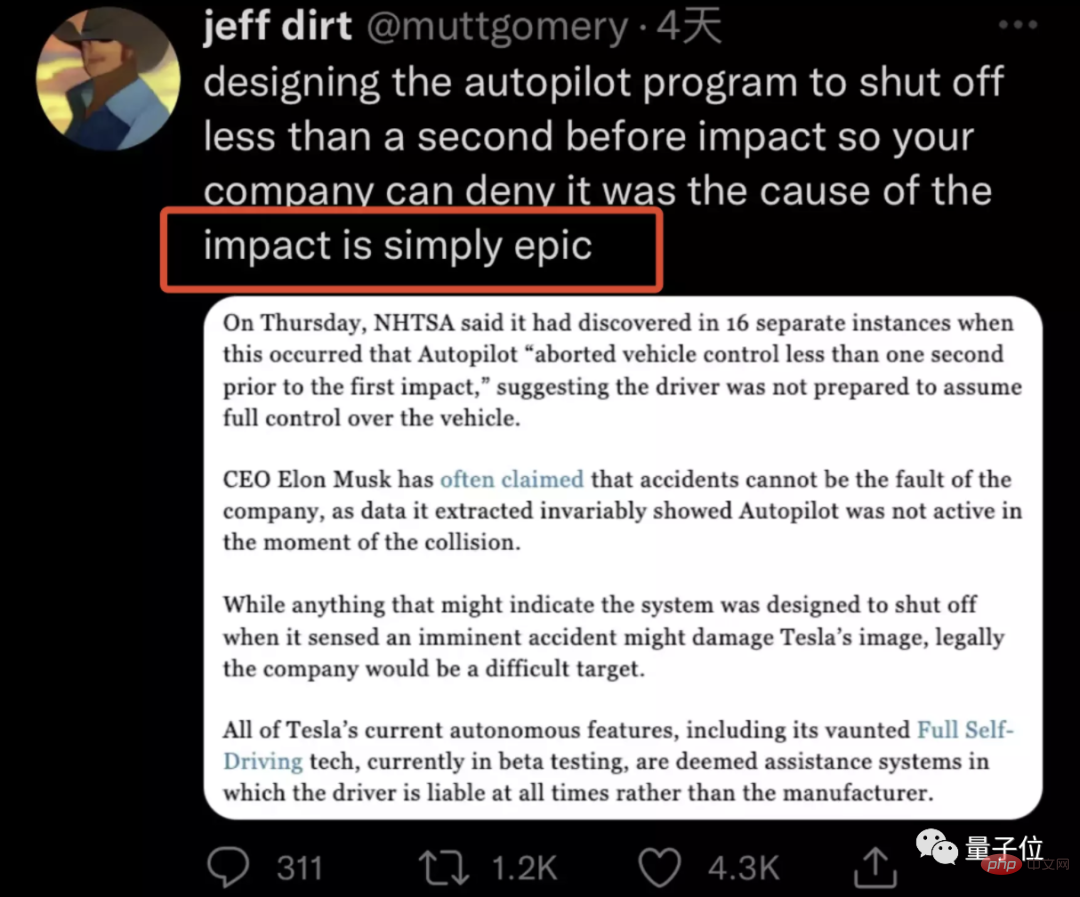

일부 네티즌들은 "epic"이라는 표현을 사용하여 이 조사 결과를 설명했습니다.

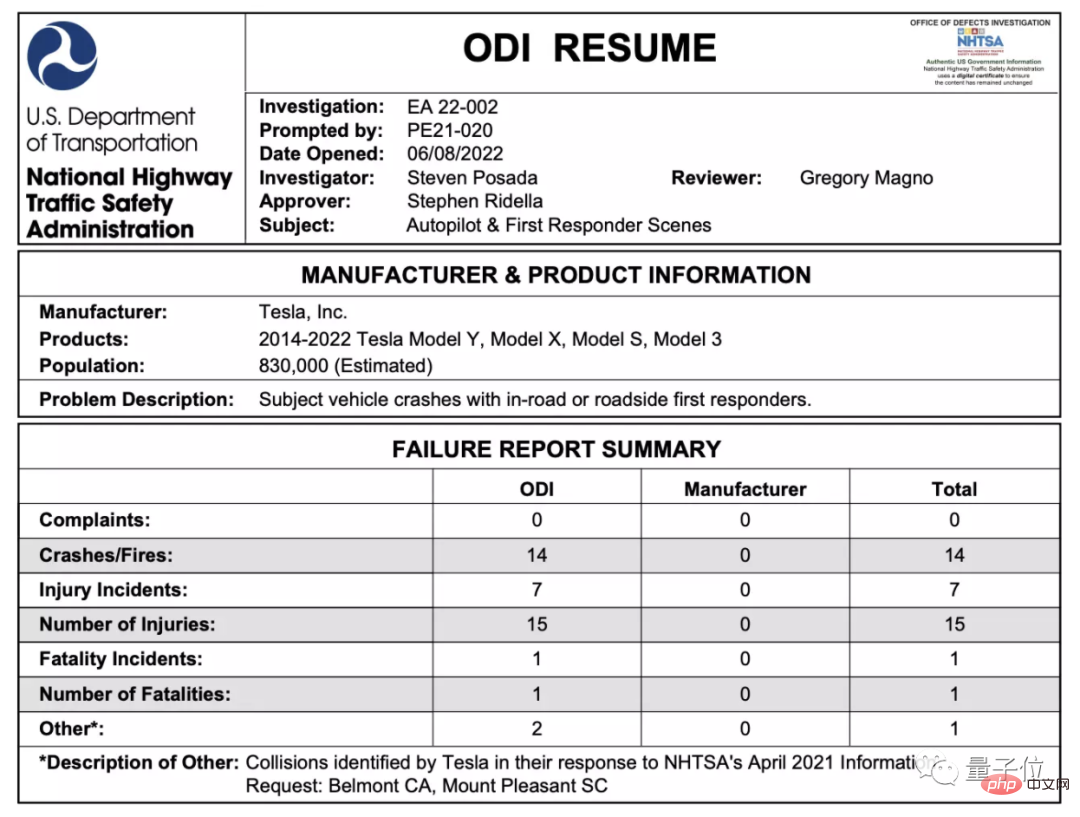

이 조사는 US Highway Safety Administration(NHTSA)에서 수행되었습니다. 노출된 문서에서 한 문장이 눈에 띕니다.

그러자 많은 네티즌들은 의문을 제기하기 시작했습니다.첫 번째 충돌이 발생하기 1초도 채 안 되어 자동 조종 장치가 차량 제어를 중단하고

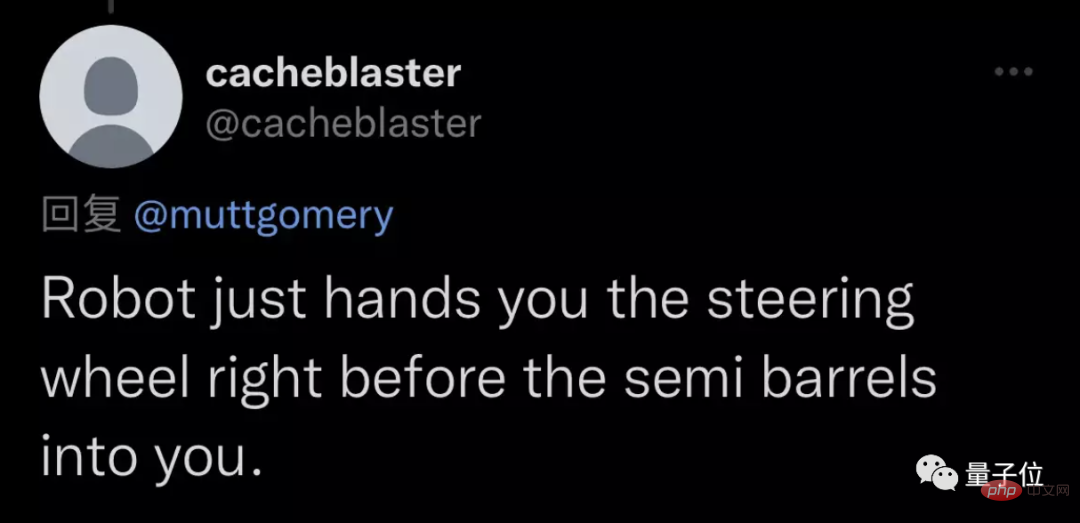

자동 조종 장치정지 차량 제어를 중단했습니다. NHTSA의 이번 발견은 대중에게 폭탄을 터뜨리는 것과 같습니다. “자동차가 충돌하기 전에 로봇이 운전대를 넘겨주는 것”과 같기 때문에...

이런 디자인, 테슬라 부정할 수 있을까요? 오토파일럿 때문에 사고가 났나요?

아 이거...

사고가 일어나기 1초도 채 안되어 운전대가 당신에게 넘겨집니다NHTSA의 테슬라에 대한 조사는 지난해 8월부터 시작됐습니다.

수사에 착수한 직접적인 이유는 자율주행 시스템인 오토파일럿이 켜진 상태에서 기존 사고 현장에 테슬라 2대 이상이 침입한 것,

길가에 이미 주차된 긴급 차량이나 경찰차를 들이받은 것, 사고 차량

.

확인하지 않으면 모르시겠지만 확인하시면 깜짝 놀라실 겁니다.

그들은 이러한 사고 중 16 대부분의 차량 자동 조종 장치가 충돌 전에 전방 충돌 경고

(FCW)

도 적극적으로 개입했습니다. 근데 결국 다 실패했어요(불행히도 한명이 죽었습니다). 무서운 점은 평균적으로 이 16건의 사고에서 오토파일럿이 실제 충격이 발생하기 전 1초도 채 안 되어 차량 제어를

멈췄다는 것입니다.그리고 이것은 인간 운전자에게 운전을 맡길 충분한 시간을 주지 않습니다. 사고 영상을 보면 인간 운전자는 기본적으로 충돌 8초 전부터 기존 사고 현장을 인지하고 있는 모습을 볼 수 있습니다.

그러나 11건의 사고에 대한 법원 데이터에 따르면 인간 운전자는 모두 자동 조종 장치의 요구에 따라 운전대에 손을 댔음에도 불구하고 충돌 전 2~5초 동안 회피 조치를 취하지 않았습니다.

아마도 대부분의 운전자는 그 순간에도 여전히 자동 조종 장치를 "신뢰"했을 것입니다. 차량 중 9대의 운전자는 충돌 전 마지막 순간에 시스템이 발행한 시각 또는 청각 경고에 응답하지 않았습니다.

그러나 전혀 경고를 하지 않은 차량도 4대 있었습니다.

이제 오토파일럿 및 관련 시스템의 안전성을 더욱 깊이 이해하기 위해 (인간 운전자의 감독을 어느 정도 저해하고 위험을 증가시킬 수 있는지) NHTSA는 이 예비 조사를 엔지니어링으로 업그레이드하기로 결정했습니다. 분석 (EA).

그리고 관련 차량은 Model S, Model X, Model 3, Model Y 등 기존 Tesla 모델 4개 모두로 확대되어 총 830,000대에 이릅니다.

이번 조사 결과가 공개되자마자 피해자들이 증언을 위해 나서기 시작했습니다.

한 사용자는 이미 2016년 초 자신의 모델 S가 차선 변경 중에 길가에 주차된 차량과 충돌했다고 말했습니다. 그러나 Tesla는 충돌이 발생하기 전에 브레이크를 밟아 Autopilot이 통제력을 잃었기 때문에 그것이 그녀의 잘못이라고 말했습니다.

여자분은 이때 시스템에서 알람이 울렸다고 하더군요. 브레이크를 밟지 않았고 알람에 주의를 기울이지 않았기 때문이라는 뜻이다.

그러나 머스크는 이 문제에 대해 네티즌들이 이 소식을 전한 지 6시간 만에 우연히 트윗을 보내 2018년 초에 NHTSA의 Tesla 조사 보고서를 폐기했습니다.

보고서에 따르면 Tesla의 Model S (2014년 생산) 및 Model X (2015년 생산) 은 자동차 사고 후 부상 확률이 가장 낮은 것으로 입증되었습니다.

이제 그들은 새로운 Model 3(2018년 생산)이 실제로 Model S와 Model X를 대체했다는 사실을 발견했습니다.

Δ테슬라도 홍보의 물결을 일으킬 기회를 잡았습니다

이것은 며칠 전 상하이에서 발생한 테슬라 자동차 사고에서 "자동차가 충돌했지만 부상자는 없었습니다" 사건에 대한 대응입니다.

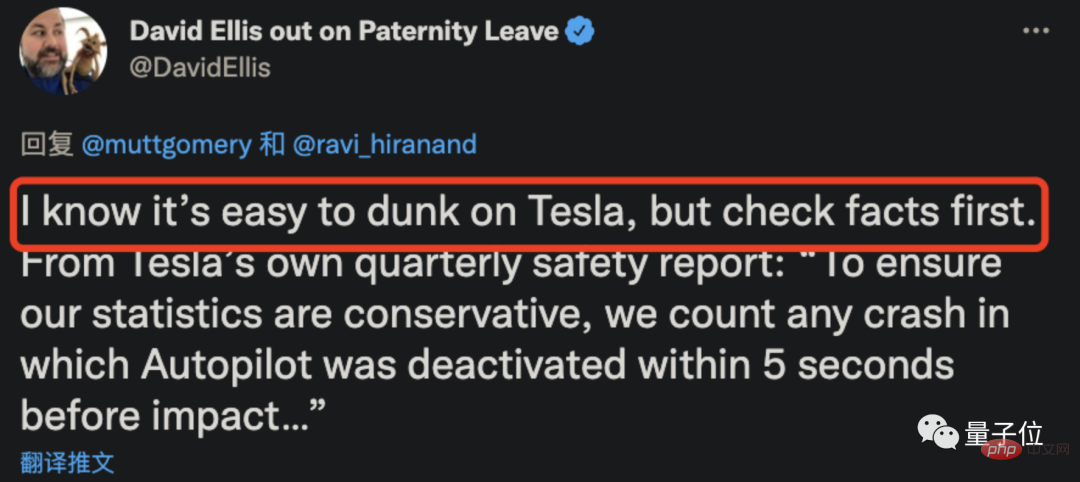

흥미로운 점은 모두가 테슬라의 자율주행이 너무 믿음직스럽지 못하다고 비난하고 있을 때 누군가 일어나 테슬라를 두고 모두의 잘못을 “어두운 것”이라고 불렀다는 것입니다.

사실 사고 1초전에 오토파일럿을 중단한 테슬라는 인간에게 책임을 전가하지 않습니다. Autopilot에 제공됩니다. 나중에 Tesla 관계자도 나와서 이 규칙을 확인했습니다.

그러나 인간은 더 이상 책임을 질 필요가 없지만, 사고 1초 전에 자율주행을 차단하는 '교묘한 조작'도 여전히 인간 운전자가 운전대를 잡을 시간이 없었다는 사실을 바꿀 수는 없다.

NHTSA의 조사 결과를 읽은 후, 이번에 여론의 초점이 되고 있는 오토파일럿을 다시 살펴보겠습니다.

오토파일럿(Autopilot)은 국제자동차공학회(SAE)가 제안한 L2 자율주행 수준에 해당하는 Tesla의 첨단 운전 보조 시스템(ADAS) 입니다.

(SAE는 자율 주행을 L0에서 L5까지 6단계로 나눕니다.) Tesla의 공식 설명에 따르면 오토파일럿의 현재 기능에는 차선 내 자동 조향 지원, 가속 및 제동 기능이 포함됩니다. 차고나 주차 공간에서 차를 불러오는 것 등이 있습니다.

그렇다면 드라이버가 완전히 "관리"될 수 있다는 뜻인가요?

그렇지 않아요.

현재 단계의 Tesla 오토파일럿은 "보조" 역할만 할 수 있으며 완전히 자율적이지는 않습니다.

그리고 운전자도 오토파일럿을 '적극적으로', '적극적으로' 감독해야 합니다.

그러나 공식 소개에서 Tesla는 "완전 자율 주행" 능력에 대해서도 다음과 같이 설명했습니다.

그러나 공식 소개에서 Tesla는 "완전 자율 주행" 능력에 대해서도 다음과 같이 설명했습니다.

모든 신형 Tesla는 향후 거의 모든 상황에서 완전 자율 주행이 가능합니다. 필수 하드웨어입니다.운전자 없이 단거리 및 장거리 이동이 가능합니다.

그러나 Autopilot이 위의 목표를 달성하려면 인간보다 훨씬 안전하다는 것이 매우 중요합니다.

그러나 Autopilot이 위의 목표를 달성하려면 인간보다 훨씬 안전하다는 것이 매우 중요합니다.

이와 관련하여 Tesla는 수십억 마일의 실험을 통해 이를 입증했다고 말합니다.

And

Musk는 Tesla의 안전에 대해 여러 번 언급했습니다.

Tesla의 완전 자율 주행의 안전 수준은 일반 운전자의 안전 수준보다 훨씬 높습니다.

그런데 이게 사실인가요?

그런데 이게 사실인가요?

테슬라와 머스크의 평가와 상관없이, 실용적인 관점에서 테슬라의 오토파일럿은 안전성 측면에서 논란이 되어왔습니다.

예를 들어 빈번한

"고스트 브레이크" 사건은 이 사건을 계속해서 여론의 최전선에 부각시켰고, 이는 NHTSA가 이번 조사를 시작한 주요 이유 중 하나입니다. "고스트 브레이킹"이란 운전자가 Tesla 오토파일럿 보조 운전 기능을 켜면 앞에 장애물이 없거나 앞 차량과 긴급 브레이크가 충돌하더라도 Tesla 차량이 불필요한 제동을 수행하는 것을 의미합니다.

이는 도로 위의 운전자와 다른 차량에 큰 안전 위험을 가져옵니다.

그뿐만 아니라 Tesla와 관련된 뜨거운 이벤트를 자세히 살펴보면 그 중 상당수가 Autopilot의 안전과 관련되어 있음을 어렵지 않게 찾을 수 있습니다.

NHTSA는 이에 대해 어떻게 생각합니까? ?

NHTSA는 이에 대해 어떻게 생각합니까? ?

이 문서에서 NHTSA는 현재 시장에 완전 자율주행차가 없다는 점을 상기시킵니다. "모든 차량은 운전자가 항상 제어할 수 있어야 하며 모든 주법에서는 운전자가 차량을 운전해야 합니다." NHTSA에 따르면 이 조사가 향후 Tesla에 어떤 영향을 미칠지에 대해 다음과 같이 밝혔습니다.

안전 관련 결함이 있는 경우 제조업체에 "리콜 요청" 편지를 보낼 수 있는 권리....

마지막으로 소규모 설문조사를 실시해 보세요. Autopilot을 신뢰하시나요?

전체 보고서:

https://static.nhtsa.gov/odi/inv/2022/INOA-EA22002-3184.PDF

위 내용은 테슬라, 큰 의구심에 직면하다: 오토파일럿은 교통사고 1초 전에 자동으로 종료됐다의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!