언어 모델은 자연어 처리 분야의 연구와 실무를 근본적으로 변화시켰습니다. 최근 몇 년 동안 대형 모델은 여러 분야에서 중요한 발전을 이루었습니다. 적절한 지침이나 프롬프트를 통해 후속 작업을 미세 조정할 필요가 없으며 때로는 놀라운 성능을 발휘할 수도 있습니다.

예를 들어 GPT-3[1]은 러브레터, 스크립트를 작성할 수 있고 데이터를 사용하여 복잡한 수학적 추론 문제를 해결할 수 있으며 PaLM[2]은 농담을 설명할 수 있습니다. 위의 예는 대형 모델 기능의 빙산의 일각에 불과합니다. OpenAI 웹사이트[3]에서 많은 관련 데모를 볼 수 있지만 이러한 기능은 소형 모델에 거의 반영되지 않습니다.

오늘 소개한 논문에서는 소형 모델에는 없지만 대형 모델에는 있는 능력을 창발능력(Emergent Abilities)이라고 하는데, 모델의 규모가 일정 수준에 도달한 후 갑자기 획득되는 능력을 말합니다. . 이는 양적 변화가 질적 변화를 가져오는 과정이다.

창발능력의 출현은 예측하기 어렵습니다. 규모가 커짐에 따라 모델이 갑자기 특정 기능을 획득하는 이유는 여전히 대답하기 위해 추가 연구가 필요한 공개 질문입니다. 이 기사에서 저자는 대형 모델을 이해하는 데 있어 최근 진행 상황을 정리하고 이와 관련된 몇 가지 생각을 여러분과 논의하기를 기대합니다.

관련 논문:

대형모델이란? "큰" 것으로 간주되는 크기는 무엇입니까? 이는 명확한 정의가 없습니다.

일반적으로 소형 모델의 제로샷, 퓨샷과는 확연히 다른 성능을 보여주기 위해서는 모델 매개변수가 수십억 수준에 도달해야 할 수도 있습니다. 최근 몇 년 동안 일련의 작업에서 SOTA 성능을 달성한 수천억, 수조 개의 매개변수를 가진 여러 모델이 있었습니다. 일부 작업에서는 규모가 커짐에 따라 모델의 성능이 안정적으로 향상되는 반면, 다른 작업에서는 특정 규모에서 모델의 성능이 갑자기 증가하는 것을 보여줍니다. 서로 다른 작업을 분류하는 데 두 가지 지표를 사용할 수 있습니다[4]:

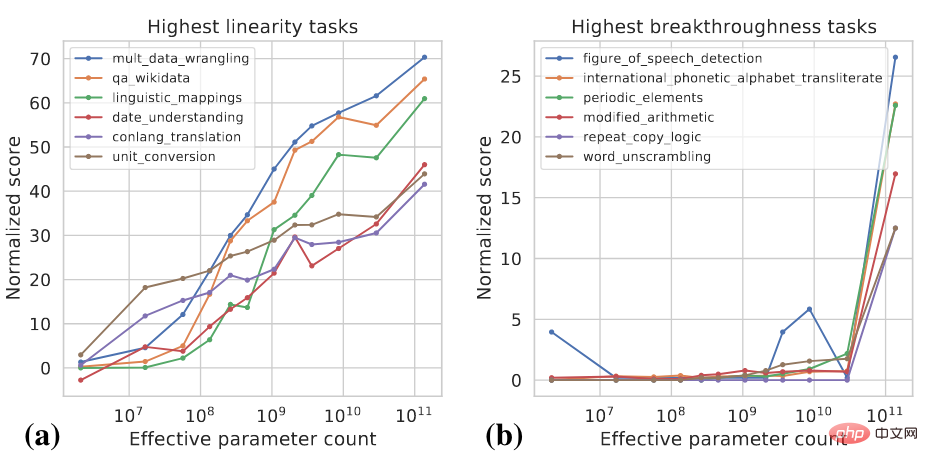

이 두 지표는 모델 크기와 모델 성능의 함수입니다. 구체적인 계산 내용은 [4]를 참조하세요. 아래 그림은 높은 선형성과 높은 혁신성 작업의 몇 가지 예를 보여줍니다.

선형성이 높은 대부분의 작업은 지식 기반입니다. 즉, 사실적 질문에 답하는 것과 같이 훈련 데이터에 있는 정보를 기억하는 데 주로 의존한다는 의미입니다. 모델이 클수록 일반적으로 훈련에 더 많은 데이터를 사용하고 더 많은 지식을 기억할 수 있으므로 모델은 규모가 커짐에 따라 이러한 작업에서 꾸준한 개선을 보여줍니다. 혁신성이 높은 작업에는 여러 가지 다른 능력을 사용하거나 수학적 추론과 같이 정답에 도달하기 위해 여러 단계를 실행해야 하는 보다 복잡한 작업이 포함됩니다. 소형 모델은 이러한 작업을 수행하는 데 필요한 모든 기능을 확보하는 데 어려움을 겪습니다.

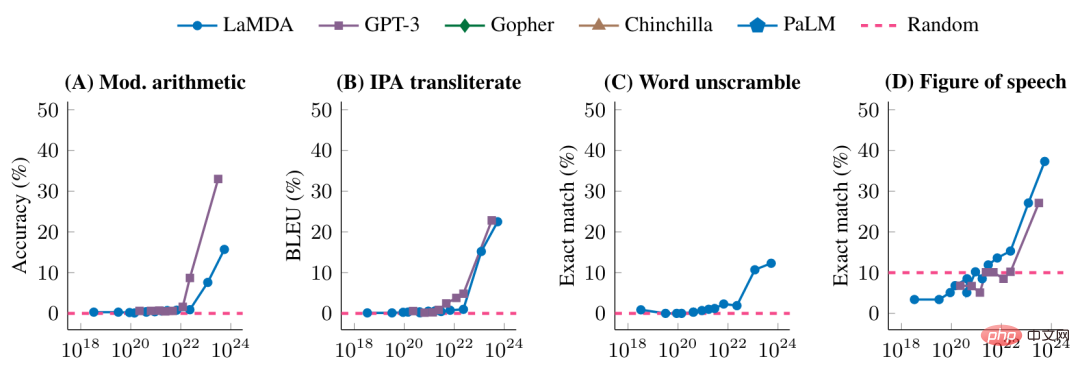

다음 그림은 일부 획기적인 작업에 대한 다양한 모델의 성능을 추가로 보여줍니다.

특정 모델 크기에 도달하지 못한 경우 해당 작업에 대한 모델의 성능은 무작위입니다. 어느 정도 규모에서는 상당한 개선이 있었습니다.

앞서 본 것은 모델 규모가 일정 수준까지 증가한 후 갑자기 특정 기능을 획득한다는 것입니다. 작업별 지표의 관점에서는 이러한 기능이 출현하지만 다른 관점에서는 모델 기능의 잠재적 변화가 더 큽니다. 매끄러운. 이 문서에서는 다음 두 가지 관점에 대해 설명합니다. (1) 더 부드러운 지표 사용, (2) 복잡한 작업을 여러 하위 작업으로 분해합니다.

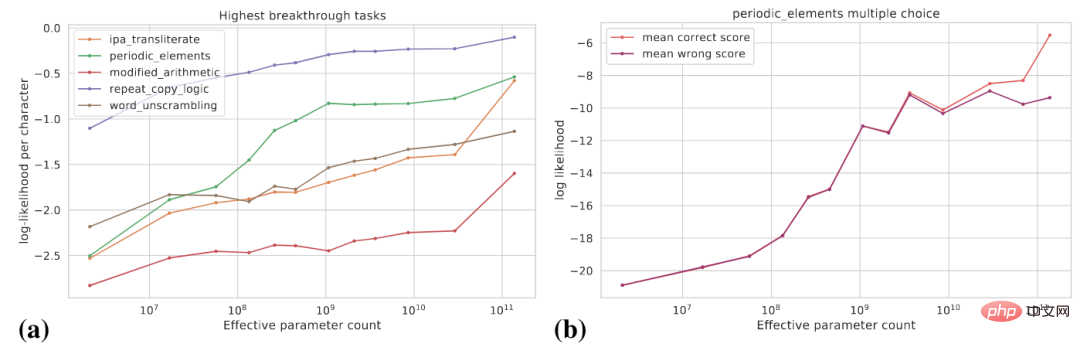

다음 그림 (a)는 일부 혁신성이 높은 작업에 대한 실제 목표의 로그 확률 변화 곡선을 보여줍니다. 모델 크기가 증가함에 따라 실제 목표의 로그 확률이 점차 증가합니다.

그림 (b)는 특정 객관식 작업의 경우 모델 크기가 증가함에 따라 정답의 로그 확률이 점차 증가하는 반면, 오답의 로그 확률은 특정 수준임을 보여줍니다. 특정 크기 이전에는 점차 증가하고 그 이후에는 안정됩니다. 이 척도 이후에는 정답 확률과 오답 확률 사이의 격차가 커지고 모델의 성능이 크게 향상됩니다.

또한 특정 작업에 대해 Exact Match와 BLEU를 사용하여 모델의 성능을 평가할 수 있다고 가정해 보겠습니다. BLEU는 Exact Match보다 더 부드러운 지표입니다. 서로 다른 지표를 사용하여 나타나는 추세는 크게 다를 수 있습니다. .

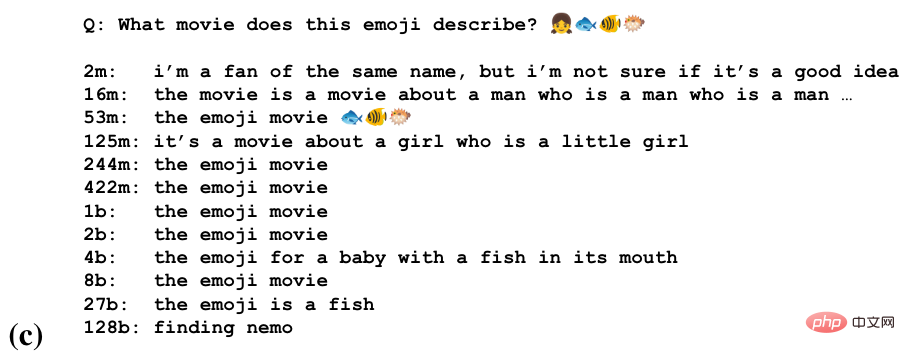

일부 작업의 경우 모델은 다양한 규모에서 이 작업을 수행하는 부분적인 능력을 얻을 수 있습니다. 아래 그림은 일련의 이모티콘을 통해 영화 이름을 추측하는 작업입니다.

모델이 어느 정도 규모에서 영화 이름을 추측하기 시작하고, 어느 정도 단계에서 이모티콘의 의미를 인식하는 것을 볼 수 있습니다. 더 큰 규모로, 가장 큰 규모로 정답을 만들어 보세요.

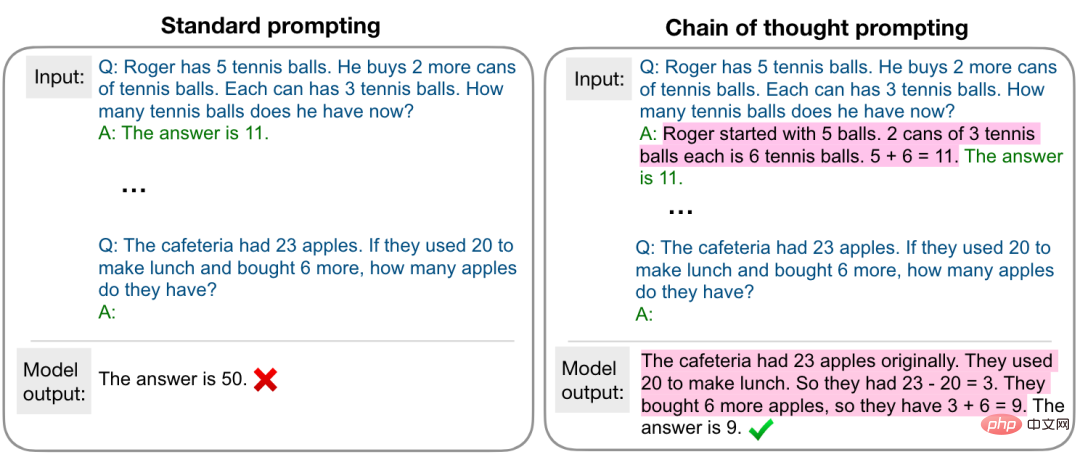

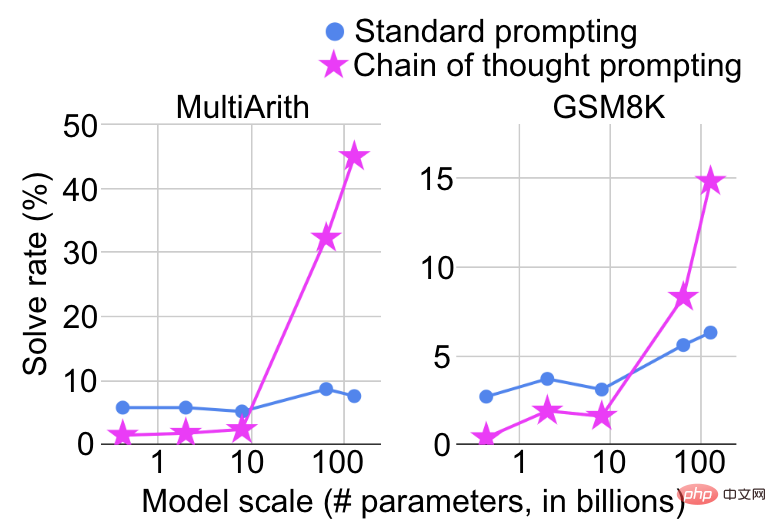

모델의 능력이 갑자기 향상되는 정도는 작업이 형식화되는 방식에 따라 달라집니다. 예를 들어, 복잡한 수학적 추론 작업에서 표준 프롬프트를 사용하여 질문 및 답변 작업으로 처리하면 모델 크기가 증가함에 따라 성능 향상이 매우 제한됩니다. 아래 그림과 같이 사용하면 질문 및 답변 작업으로 처리됩니다. 다단계 추론 작업으로 처리하면 특정 규모에서 상당한 성능 향상이 나타납니다.

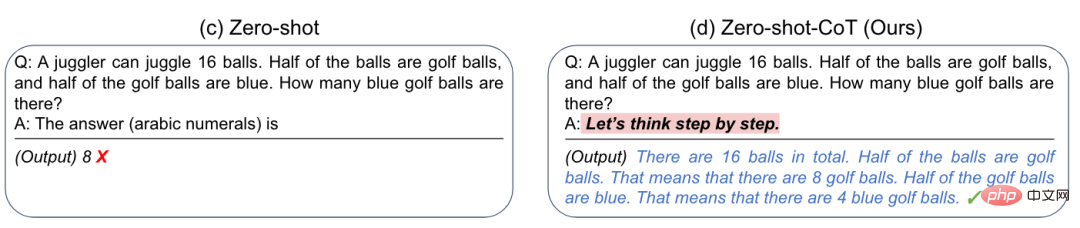

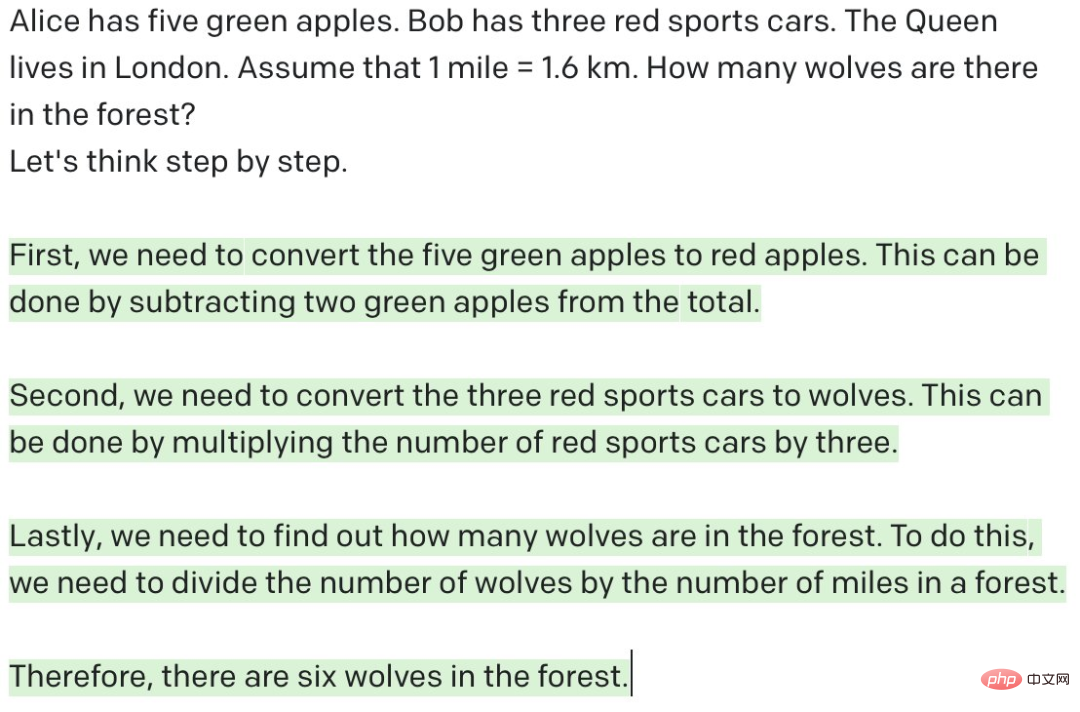

또한 연구원들은 "단계적으로 생각해보자"라는 간단한 프롬프트를 추가함으로써 GPT-3의 제로샷 추론 능력이 크게 향상될 수 있음을 발견했습니다.[6] 아래 그림에서

때때로 대형 모델이 특정 작업을 잘 수행하지 못하는 경우가 있지만 실제로는 잘 수행하지 못하는 것이 아니라 적절한 자극 방법이 필요하다는 영감을 받았습니다. 그것.능력.

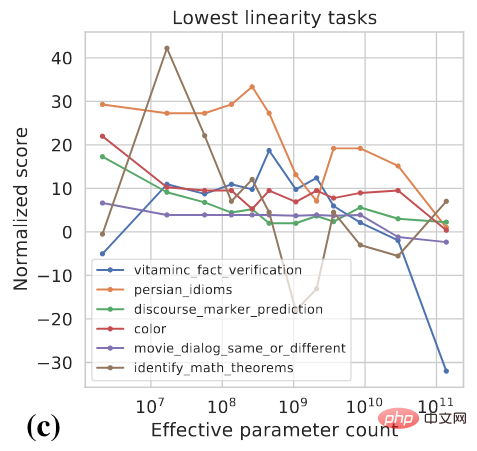

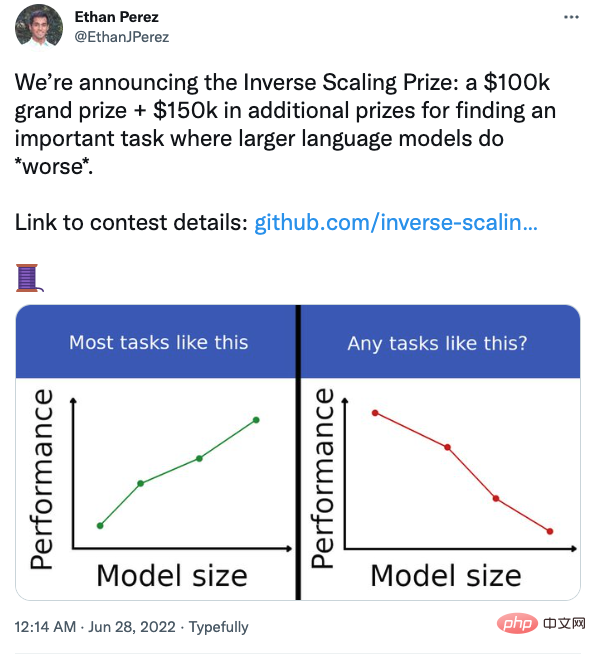

이전 논의에서는 모델 크기가 커질수록 성능이 향상되어야 한다는 직관적인 느낌을 받았는데, 과연 그럴까요? 실제로 일부 작업의 경우 아래 그림과 같이 모델이 커질수록 성능이 실제로 저하될 수 있습니다

뉴욕대학교의 몇몇 연구자들도 모델 성능이 좋은 작업을 찾기 위해 대회를 조직했습니다. 모델이 커질수록 성능이 저하됩니다.

예를 들어 질문 및 답변 작업에서 질문과 함께 자신의 신념을 추가하면 대형 모델이 더 쉽게 영향을 받습니다. 관심 있는 학생들은 주목하시기 바랍니다.

메이 이치(Mei Yiqi) 선생님은 "소위 위대한 선비란 건물이 아니라 스승을 의미합니다."라고 말한 적이 있습니다. 저자는 소위 빅 모델이라는 부적절한 비유로 이 글을 끝냅니다. 매개변수가 있다는 뜻이 아니라 능력이 있다는 뜻입니다.

위 내용은 Google과 Stanford는 공동으로 다음과 같은 기사를 발행했습니다. 왜 대형 모델을 사용해야 하는가?의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!