이번 공유의 주제는 ChatGPT 기술, 현지화 시도 및 오픈 소스 모델입니다. 공유는 세 부분으로 구성됩니다. 첫 번째 부분은 ChatGPT 관련 기술에 대한 전반적인 소개를 제공합니다. ChatGPT 기술의 발전, 현재 문제, ChatGPT 기술 학습의 세 단계, 데이터 구성 및 효과 평가가 두 번째 부분에서 이루어집니다. 기술 국산화를 위한 우리의 시도에는 실험 중에 직면한 문제, 우리의 생각, 모델의 효과와 적용이 포함됩니다. 세 번째 부분에서는 우리가 출시한 중국 오픈 소스 대형 모델을 소개하고 자체 데이터를 사용하여 학습하는 방법을 소개합니다. 로컬 모델 운영 중 실험 중에 발생할 수 있는 문제, 오픈 소스 고급 모델과의 격차, 모델의 효과를 더욱 향상시키는 방법.

ChatGPT는 일반적인 기능 보조자입니다. 2022년 12월 5일, OpenAI CEO 샘 알트만(Sam Altman)은 소셜 미디어에 ChatGPT가 출시 5일 만에 사용자 100만 명을 돌파했다고 게시했습니다. AI 챗봇 ChatGPT가 폭발적인 인기를 끌며 획기적인 이벤트로 자리 잡았습니다. 마이크로소프트는 지분을 100억 달러 늘리고 곧 마이크로소프트 클라우드에 통합하기 위해 논의 중이다.

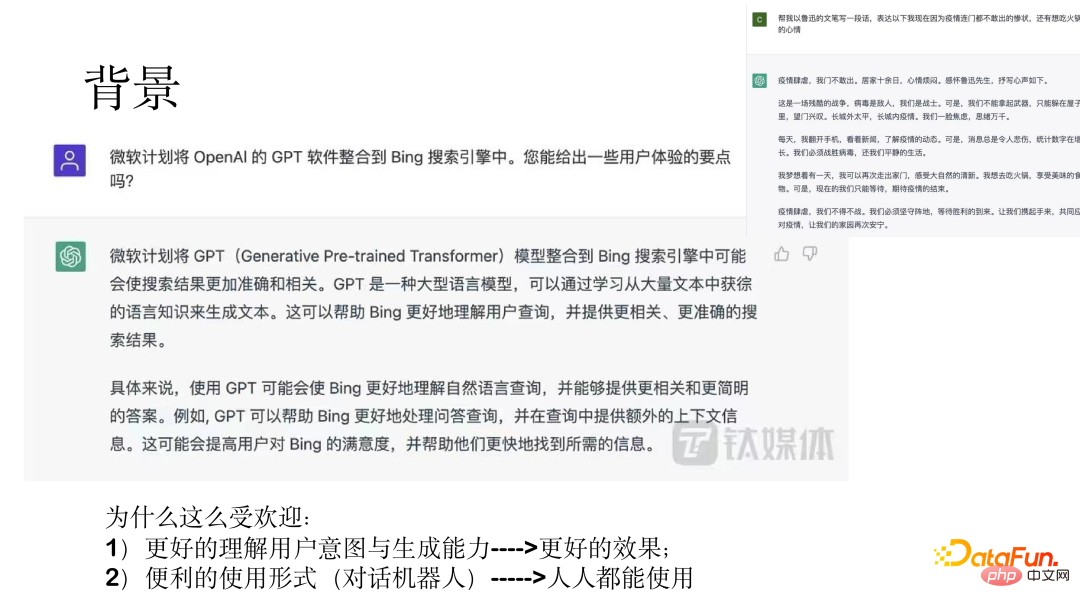

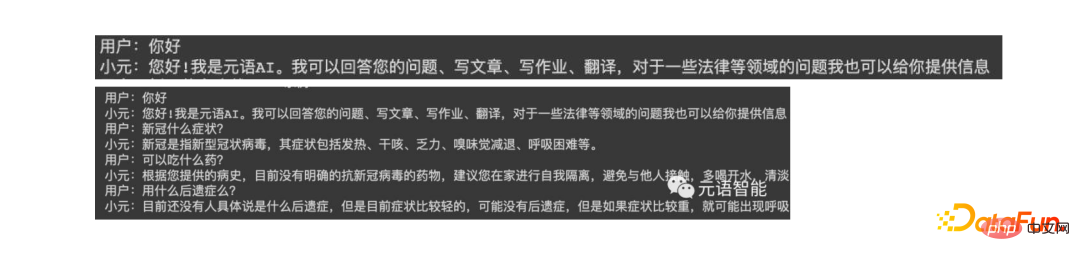

위 사진은 두 가지 예를 보여주며 놀라운 결과를 보여줍니다.

ChatGPT가 인기를 끄는 이유는 한편으로는 사용자 의도를 이해하고 다른 한편으로는 대화형 로봇 형태를 통해 더 나은 효과를 얻을 수 있기 때문입니다. 모든 사람.

다음에서는 모델의 진화, 초기 모델의 문제점, ChatGPT 모델 학습의 3단계, ChatGPT 모델 학습의 데이터 구성 및 효과를 소개합니다.

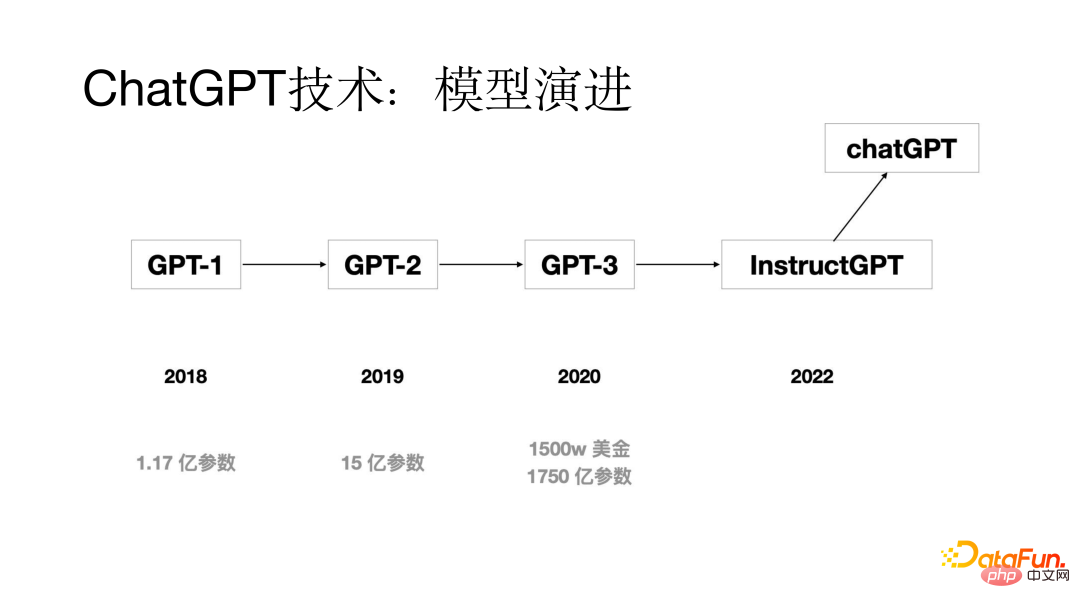

ChatGPT 기술도 여러 세대의 모델을 통해 발전해 왔으며 2019년에는 1억 1700만 개의 모델 매개변수만 사용하여 GPT-2 모델을 제안했습니다. 2020년까지 GPT-3 모델 매개변수는 1,750억 개에 도달했으며, 여러 세대의 모델 업데이트 반복을 통해 ChatGPT 모델이 2022년에 등장할 예정입니다.

ChatGPT 모델이 나오기 전에는 어떤 문제가 있었나요? 분석을 통해 가장 명백한 문제 중 하나가 정렬 문제라는 것을 알 수 있었습니다. 대형 모델의 생성 능력은 상대적으로 강력하지만 생성된 답변이 사용자의 의도에 맞지 않는 경우가 있습니다. 연구를 통해 정렬 문제의 주된 원인은 언어 모델 훈련의 훈련 목표가 사용자의 의도에 따라 생성하는 것이 아니라 다음 단어를 예측하는 것임을 알 수 있었습니다. 정렬 문제를 해결하기 위해 ChatGPT 모델의 학습 프로세스에 RLHF(Reinforcement Learning from Human Feedback) 프로세스가 추가되었습니다.

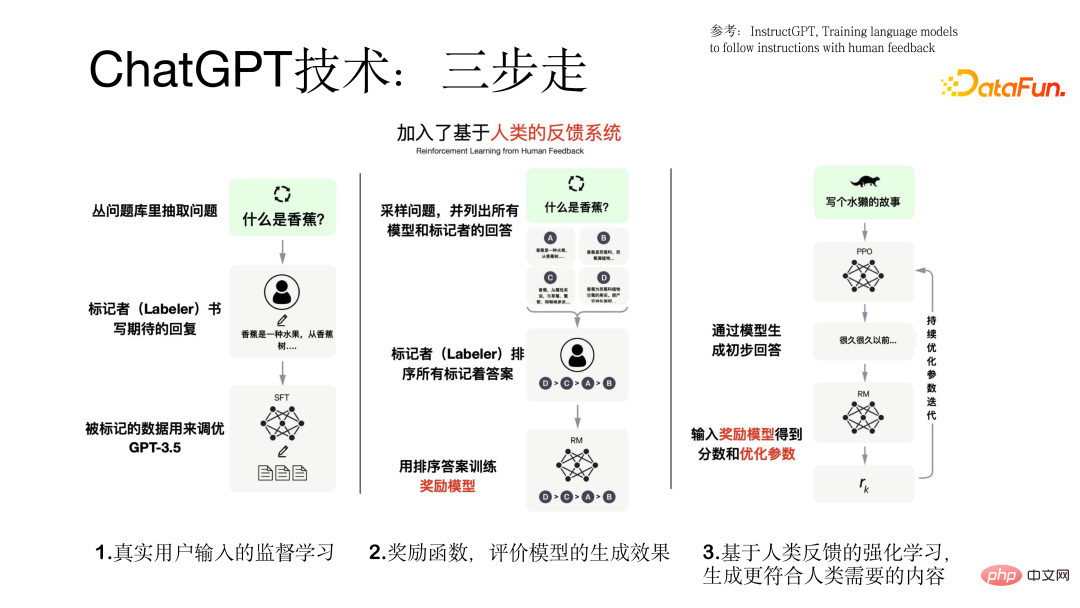

ChatGPT 모델의 훈련 과정은 3단계로 진행됩니다.

첫 번째 단계는 GPT 모델을 기반으로 한 지도 학습에 실제 사용자 입력을 사용하는 것입니다. 이 과정에서 데이터는 실제 사용자로부터 나오며 데이터 품질은 상대적으로 높고 가치가 높습니다.

두 번째 단계는 쿼리에 대해 서로 다른 모델이 서로 다른 출력 결과를 생성하고 이러한 정렬된 데이터 교육 보상 모델을 사용하는 것입니다.

세 번째 단계는 모델에서 생성된 예비 답변을 보상 모델에 입력하는 것입니다. 보상 모델은 생성된 답변이 사용자의 의도에 부합하면 긍정적인 피드백을 제공합니다. 모델을 점점 더 좋게 만들기 위해 부정적인 피드백을 제공하면 됩니다. 이는 생성된 결과가 인간의 요구에 더 부합하도록 만들기 위해 강화 학습을 도입하는 목적입니다. ChatGPT 모델을 훈련하는 3단계 프로세스는 아래 그림에 나와 있습니다.

모델을 학습하기 전에 사용되는 데이터 세트를 준비해야 합니다. 이 과정에서 데이터 콜드 스타트 문제에 직면하게 됩니다. , 는 다음 세 가지 측면 을 통해 해결할 수 있습니다.

(1) 이전 시스템 사용자가 사용하는 데이터 세트 수집

(2) 주석자가 이전 입력을 기반으로 일부 질문에 주석을 달도록 함 실제 사용자에 의한 유사한 프롬프트 및 출력

(3) 데이터 주석자는 Q&A, 스토리 작성, 생성 등의 몇 가지 프롬프트를 제시합니다.

ChatGPT 모델 교육용 데이터에는 데이터 세트의 세 부분(77k 실제 데이터)이 포함되어 있습니다.

(1) 실제 사용자 프롬프트, 사용자 프롬프트, 모델 응답, 데이터 양을 기반으로 한 지도 학습 데이터 13k입니다.

(2) 보상 모델을 훈련하는 데 사용되는 데이터 세트입니다. 이 부분은 하나의 프롬프트에 해당하는 여러 응답을 정렬하기 위한 것이며 데이터 양은 33k입니다.

(3) 모델 훈련을 위해 강화 학습 기술을 사용한 보상 모델 기반 데이터 세트입니다. 사용자 프롬프트만 필요하고 데이터 양은 31k이며 품질 요구 사항이 높습니다.

ChatGPT 모델 훈련을 마친 후 주로 다음 측면에서 모델에 대한 평가가 상대적으로 충분합니다.

(1) 모델에서 생성된 결과가 사용자의 의도를 충족하는지 여부

(2) 생성된 결과가 사용자가 언급한 제약조건을 충족할 수 있는지

(3) 모델이 고객 서비스 분야에서 좋은 결과를 얻을 수 있는지

GPT 기본 모델은 아래와 같습니다.

다음은 ChatGPT 기술의 현지화를 배경과 문제, 솔루션 아이디어, 효과 및 실습의 세 가지 측면에서 소개합니다.

현지화가 필요한 이유는 다음과 같은 측면을 주로 고려합니다.

(1) ChatGPT 기술 자체는 비교적 발전되어 많은 작업에 사용될 수 있습니다. 효과는 상대적으로 좋지만 중국 본토에는 서비스를 제공하지 않습니다.

(2) 국내 기업 수준 고객의 요구 사항을 충족하지 못할 수 있으며 현지화된 기술 지원 및 서비스를 제공하지 못할 수 있습니다.

(3) 가격은 유럽과 미국을 주요 시장으로 미국 달러로 책정되어 있으며 가격이 상대적으로 비싸서 대부분의 국내 사용자가 감당하지 못할 수 있습니다. 테스트 결과 데이터 1개당 비용은 약 0.5위안 정도이며, 데이터량이 많은 고객에게는 상용화가 불가능한 것으로 나타났다.

위의 세 가지 문제로 인해 ChatGPT 기술을 국산화하려고 노력했습니다.

ChatGPT 기술을 현지화하는 과정에서 분산 전략을 채택했습니다.

첫 번째로 수백억 개의 매개변수를 가진 중국 사전 훈련 모델을 훈련시켰습니다. 두 번째로 10억 개 수준의 작업 데이터에 대해 Prompt를 사용하여 작업 지도 학습을 수행한 다음 모델을 대화형으로 만들었습니다. 대화 또는 인간-컴퓨터 상호 작용 마지막으로 보상 모델 및 사용자 피드백의 강화 학습 RLHF 기술을 소개합니다.

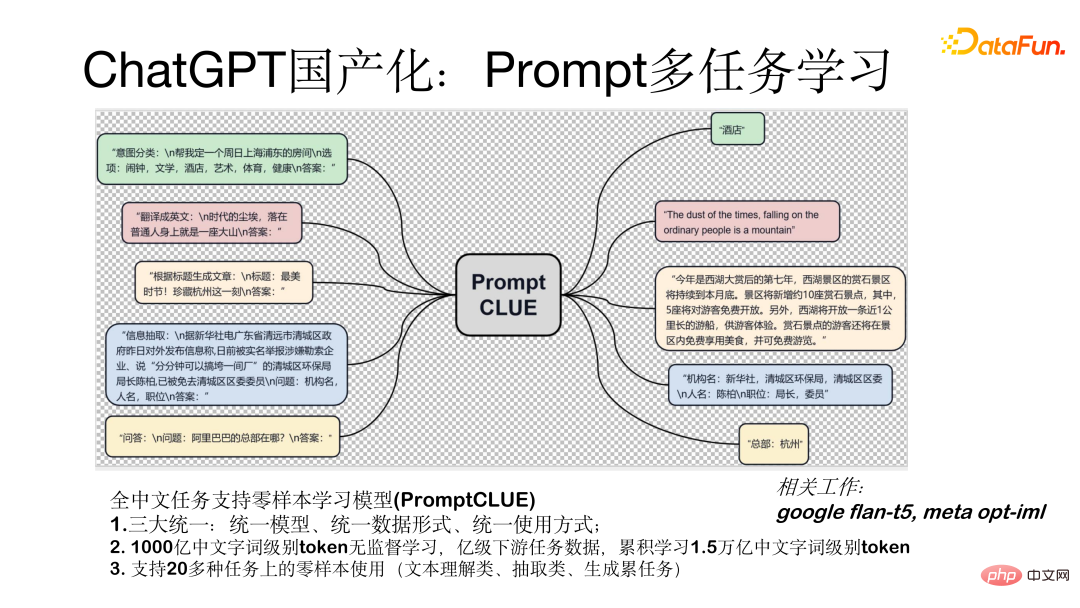

Prompt 다중 작업 학습 모델(PromptCLUE)은 모든 중국어 작업에 대해 제로샷 학습을 지원하는 모델입니다. 이 모델은 통합 모델, 통합 데이터 형식(모든 작업이 프롬프트 형식으로 변환됨), 통합 사용 방법(제로 샘플 형식에서 사용됨)의 세 가지 주요 통합을 달성합니다. 이 모델은 1,000억 개의 중국어 단어 수준 토큰에 대한 비지도 학습을 기반으로 하며, 10억 개 수준의 다운스트림 작업 데이터를 학습하고 1조 5천억 개의 중국어 단어 수준 토큰을 축적했습니다. 20개 이상의 작업(텍스트 이해, 추출, 생성 작업)에서 제로 샘플 사용을 지원합니다.

모델을 대화형으로 만드는 방법, 즉 인간-컴퓨터 상호 작용 형태의 모델로 변환하는 방법은 무엇입니까? 우리는 주로 다음 작업을 수행했습니다.

우선 순서대로 모델이 더 나은 생성 효과를 갖도록 하기 위해 텍스트 이해 및 추출 작업을 제거하여 질문과 대답, 대화 및 생성 작업의 학습을 강화했습니다. 둘째, 대화 모델로 변환한 후 생성 결과는 컨텍스트에 의해 간섭됩니다. 이 문제를 해결하기 위해 우리는 모델이 필요할 때 관련 없는 컨텍스트를 무시할 수 있도록 하는 간섭 방지 데이터를 추가했습니다. 마지막으로 모델이 사용자의 의도를 더 잘 이해할 수 있도록 실제 사용자 피드백 데이터를 기반으로 하는 학습 프로세스를 추가합니다. 아래 그림은 모델을 이용한 단일 라운드 및 다중 라운드 테스트의 형태를 보여줍니다.

다음은 모델을 테스트한 결과 ChatGPT 모델과 비교해보면 아직 1~2년 정도의 공백이 있지만, 현재 우리는 몇 가지 유용한 시도를 하여 특정 결과를 얻었으며 대화, 질문 및 답변, 글쓰기 등의 상호작용을 수행할 수 있습니다. 아래 이미지는 테스트 결과를 보여줍니다.

저희가 최근 출시한 메타언어 기능대화 대형 모델(ChatYuan)은 7억 7천만 개의 매개변수를 가지고 있는데, 온라인 버전은 100억 개의 매개변수를 가진 모델이며 Huggingface, ModelScope, Github 및 paddlepaddle을 포함한 여러 플랫폼에서 출시되었습니다. 모델을 로컬로 다운로드하고 사용자 데이터 세트를 기반으로 세부 조정할 수 있습니다. 수억 개의 기능적 대화 다중 라운드 대화 데이터와 결합된 PromptCLUE-large를 기반으로 추가로 훈련됩니다.

위에서는 Huggingface 플랫폼을 예로 들어 모델을 로컬에서 사용하는 방법을 보여줍니다. 플랫폼에서 ChatYuan을 검색하고, 모델을 로드하고, 간단한 패키징을 수행합니다. 샘플을 샘플링할지 여부와 같은 몇 가지 중요한 매개변수가 사용됩니다. 다양한 샘플을 생성해야 하는 경우 샘플링이 필요합니다.

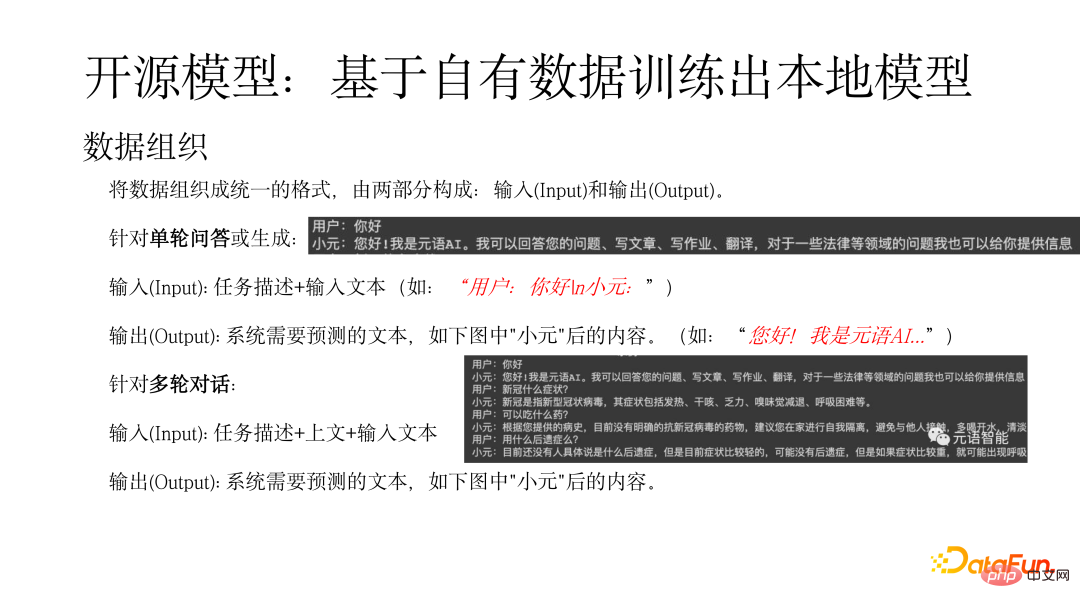

먼저 데이터를 입력(Input)과 출력(Output)의 두 부분으로 구성된 통일된 형태로 구성해야 합니다. 단일 질문 및 답변 또는 생성된 입력(입력): 작업 설명 + 입력 텍스트(예: "사용자: Hello n Xiaoyuan:")의 경우 출력(출력)은 시스템이 예측해야 하는 텍스트(예: 예: "안녕하세요! 저는 메타언어 AI입니다..."). 다단계 대화 입력(입력): 작업 설명 + 위 + 입력 텍스트의 경우 출력은 아래 그림의 "Xiaoyuan" 뒤의 내용과 같이 시스템이 예측해야 하는 텍스트를 나타냅니다.

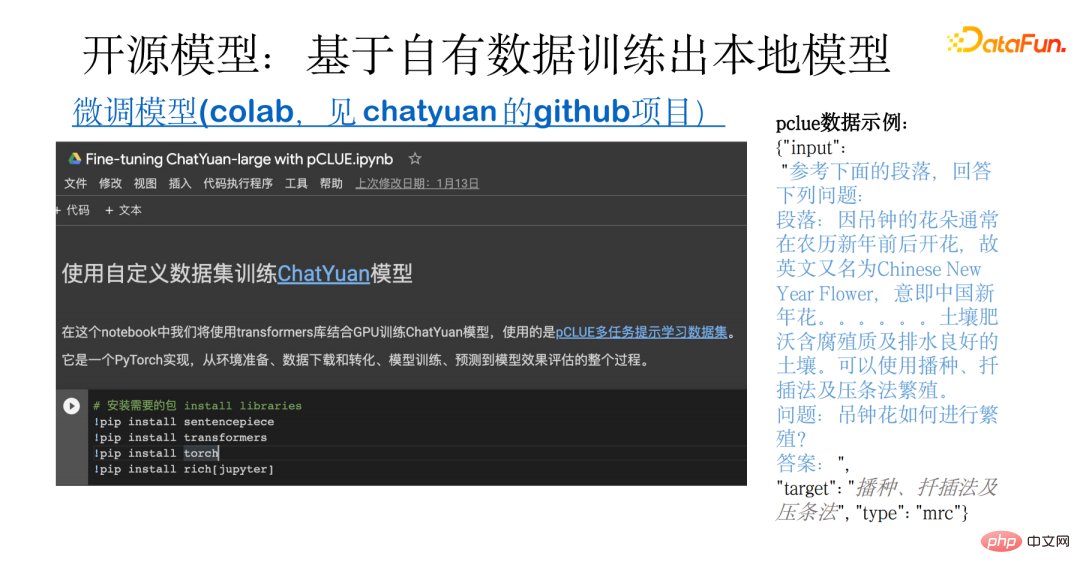

아래 그림은 자신의 데이터를 기반으로 로컬 모델을 훈련시키는 예를 보여줍니다. 이 예에서는 데이터 준비부터 오픈 소스 데이터 다운로드 및 변환은 물론 모델 훈련, 예측, 평가까지 전체 프로세스를 다룹니다. 기본은 pCLUE 다중 작업 데이터 세트입니다. 사용자는 자신의 데이터를 학습에 사용할 수도 있고 pCLUE를 사용하여 사전 학습에 효과를 테스트할 수도 있습니다.

ChatYuan과 ChatGPT는 둘 다 채팅이나 전문 분야에서 사용할 수 있는 범용 기능 대화 모델입니다. 법률과 의학으로서, 상호작용과 생성. ChatGPT 모델과 비교하면 여전히 일정한 격차가 있는데, 이는 주로 다음 측면에 반영됩니다.

모델 효과를 더욱 향상하려면 다음 측면에서 시작할 수 있습니다.

(1) 비지도 사전 학습 및 대량 사용을 포함한 추가 학습을 위해 업계 데이터와 결합합니다. 고품질 데이터 지도 학습.

(2) 실제 사용자 피드백 데이터를 활용하여 학습하면 분포 차이를 보상할 수 있습니다.

(3) 사용자 의도를 일치시키기 위해 강화 학습을 도입합니다.

(4) 더 큰 모델을 선택하세요. 일반적으로 모델이 클수록 모델 능력이 더 강해집니다.

ChatGPT가 가져온 새로운 기술과 사용 시나리오를 통해 사람들은 AI의 엄청난 잠재력을 볼 수 있습니다. 더 많은 애플리케이션이 업그레이드되어 일부 새로운 애플리케이션에 대한 가능성이 창출될 것입니다.

Yuanyu Intelligence는 대형 모델 서비스 제공업체로서 이 분야에서도 끊임없이 탐구하고 있습니다. 관심 있는 파트너는 당사 웹사이트와 공식 계정에 관심을 가져주시기 바랍니다.

오늘의 나눔은 여기까지입니다. 모두 감사합니다.

위 내용은 ChatGPT 기술의 국산화 시도의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!