텍스트 내 학습의 수학

Feb 26, 2025 am 12:03 AM현대적인 대형 언어 모델 (LLM)의 주요 기능인

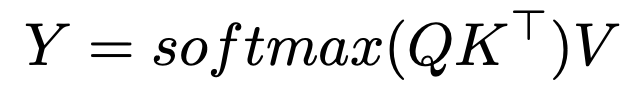

,주의 할당을 수정합니다 :

c

가 무한대에 접근 할 때,주의는 가장 유사한 토큰에만 초점을 맞춘 한 가지 벡터가됩니다. 효과적으로 가장 가까운 이웃 검색입니다. 유한 한

c를 사용하면주의가 가우시안 커널 스무딩과 유사합니다. 이는 ICL이 입력 출력 쌍에서 가장 가까운 이웃 알고리즘을 구현할 수 있음을 시사합니다.

주의 메커니즘은 학습 알고리즘을 구현하여 데모 쌍에서 학습하여 ICL을 가능하게합니다. 다중주의 층과 MLP의 상호 작용은 복잡하지만 연구는 ICL의 역학에 대한 빛을 발산합니다. 이 기사는 이러한 통찰력에 대한 높은 수준의 개요를 제공합니다

추가 읽기 :

-

변압기는 텍스트에서 무엇을 배울 수 있습니까? 간단한 기능 클래스의 사례 연구 - 승인 이 기사는 미시간 대학교 (University of Michigan)의 2024 년 가을 대학원 과정에서 영감을 받았습니다. 모든 오류는 전적으로 저자입니다.

위 내용은 텍스트 내 학습의 수학의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

인기 기사

인기 기사

뜨거운 기사 태그

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

뜨거운 주제

7279

7279

9

9

1622

1622

14

14

1340

1340

46

46

1257

1257

25

25

1205

1205

29

29

MCP (Model Context Protocol) 란 무엇입니까?

Mar 03, 2025 pm 07:09 PM

MCP (Model Context Protocol) 란 무엇입니까?

Mar 03, 2025 pm 07:09 PM

MCP (Model Context Protocol) 란 무엇입니까?

Omniparser V2 및 Omnitool을 사용하여 지역 비전 에이전트 구축

Mar 03, 2025 pm 07:08 PM

Omniparser V2 및 Omnitool을 사용하여 지역 비전 에이전트 구축

Mar 03, 2025 pm 07:08 PM

Omniparser V2 및 Omnitool을 사용하여 지역 비전 에이전트 구축

나는 Cursor AI와 함께 Vibe 코딩을 시도했는데 놀랍습니다!

Mar 20, 2025 pm 03:34 PM

나는 Cursor AI와 함께 Vibe 코딩을 시도했는데 놀랍습니다!

Mar 20, 2025 pm 03:34 PM

나는 Cursor AI와 함께 Vibe 코딩을 시도했는데 놀랍습니다!

활주로 ACT-One Guide : 나는 그것을 테스트하기 위해 스스로 촬영했다

Mar 03, 2025 am 09:42 AM

활주로 ACT-One Guide : 나는 그것을 테스트하기 위해 스스로 촬영했다

Mar 03, 2025 am 09:42 AM

활주로 ACT-One Guide : 나는 그것을 테스트하기 위해 스스로 촬영했다

Elon Musk & Sam Altman은 5 천억 달러 이상의 Stargate 프로젝트를 충돌시킵니다.

Mar 08, 2025 am 11:15 AM

Elon Musk & Sam Altman은 5 천억 달러 이상의 Stargate 프로젝트를 충돌시킵니다.

Mar 08, 2025 am 11:15 AM

Elon Musk & Sam Altman은 5 천억 달러 이상의 Stargate 프로젝트를 충돌시킵니다.

DeepSeek은 3FS 및 Smallpond 프레임 워크를 릴리스합니다

Mar 03, 2025 pm 07:07 PM

DeepSeek은 3FS 및 Smallpond 프레임 워크를 릴리스합니다

Mar 03, 2025 pm 07:07 PM

DeepSeek은 3FS 및 Smallpond 프레임 워크를 릴리스합니다