편집자 | ScienceAI

인공지능(AI), 특히 의료 AI 분야에서는 공정한 의료 결과를 보장하기 위해 공정성 문제를 해결하는 것이 중요합니다.

최근 공정성을 높이기 위한 노력으로 새로운 방법과 데이터 세트가 도입되었습니다. 그러나 진료소에서 환자 진단을 위해 다양한 영상 기술(예: 다양한 망막 영상 방식)에 의존하는 경우가 많음에도 불구하고 영역 이전의 맥락에서 공정성 문제는 거의 조사되지 않았습니다.

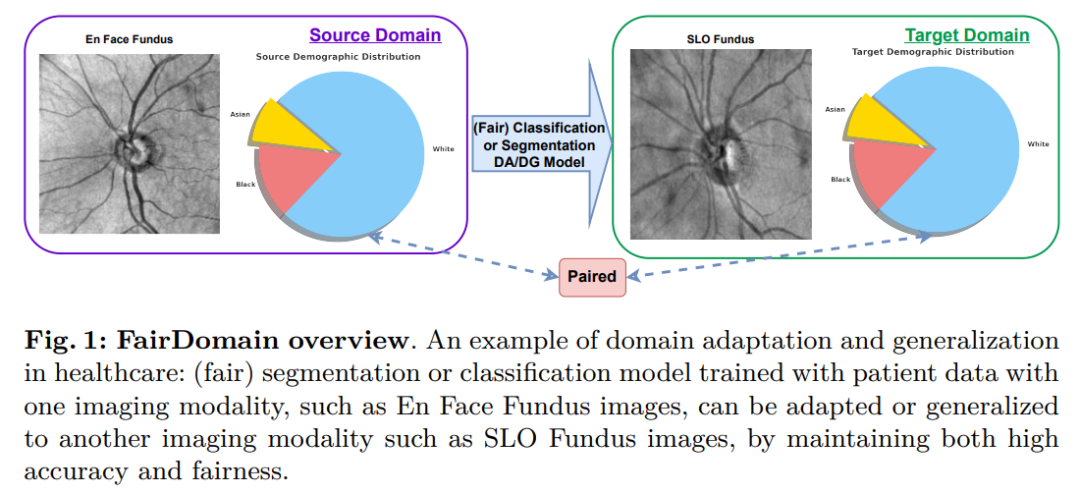

본 논문에서는 도메인 이전 시 알고리즘의 공정성에 대한 최초의 체계적인 연구인 FairDomain을 제안합니다. 의료 영상 분할 및 분류를 위한 최첨단 DA(Domain Adaptation) 및 DG(Domain Generalization) 알고리즘을 테스트합니다. , 다양한 영역 간에 편견이 어떻게 전달되는지 이해하도록 설계되었습니다.

또한 인구통계학적 특성 성별을 기반으로 기능 중요도를 조정하는 self-attention 메커니즘을 사용하여 다양한 DA 및 DG 알고리즘의 공정성을 향상시키는 새로운 플러그 앤 플레이 FIA(Fair Identity Attention) 모듈을 제안합니다.

또한, 우리는 도메인 이동 시나리오를 엄격하게 평가하기 위해 동일한 환자 모집단의 두 쌍의 영상 기법에 대한 의료 분할 및 분류 작업을 포함하는 공정성에 초점을 맞춘 최초의 도메인 이동 데이터 세트를 구성하고 게시했습니다. 원본 도메인과 대상 도메인 간의 인구 분포 차이로 인한 교란 효과를 제외하면 도메인 이전 모델 성능을 보다 명확하게 정량화할 수 있습니다.

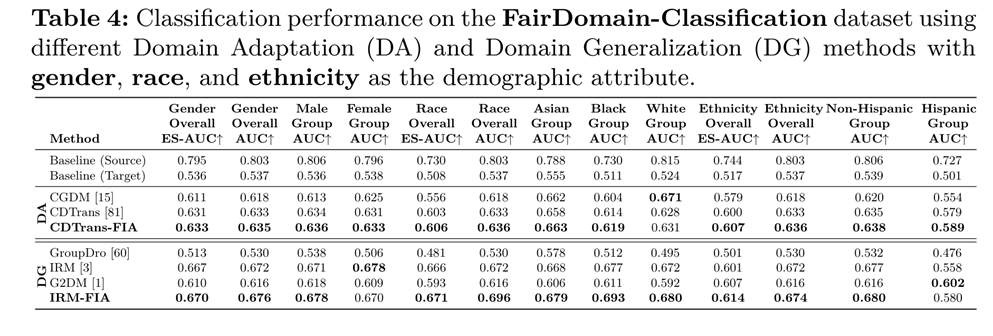

우리의 광범위한 평가에 따르면 제안된 FIA는 모든 도메인 이전 작업(예: DA 및 DG)에서 다양한 인구 통계에서 모델 공정성과 성능을 크게 향상시켜 세분화 및 분류 작업 모두에서 최첨단 성능을 발휘하는 것으로 나타났습니다. 방법.

ECCV 2024 최종 초안 작업을 여기에서 공유하세요. "FairDomain: 도메인 간 의료 영상 분할 및 분류의 공정성 달성"

기사 주소: https://arxiv.org/abs/2407.08813

코드 주소: https://github.com/Harvard-Ophalmology-AI-Lab/FairDomain

데이터 세트 웹사이트: https://ophai.hms.harvard.edu/datasets/harvard-fairdomain20k

데이터세트 다운로드 링크: https://drive.google.com/drive/folders/1huH93JVeXMj9rK6p1OZRub868vv0UK0O?usp=sharing

Harvard-Ophalmology-AI-Lab은 고품질의 공정성 데이터 세트와 더 많은 공정성 데이터 세트를 제공하기 위해 최선을 다하고 있습니다. 연구실의 데이터 세트 홈페이지를 클릭하세요: https://ophai.hms.harvard.edu/datasets/

Background

최근 몇 년간 의료 영상 분야에서 딥 러닝의 발전으로 분류 및 분류가 크게 향상되었습니다. 세분화 작업 효과. 이러한 기술은 진단 정확도를 높이고 치료 계획을 단순화하며 궁극적으로 환자 건강을 개선하는 데 도움이 됩니다. 그러나 다양한 의료 환경에 딥 러닝 모델을 배포할 때 중요한 과제는 알고리즘에 내재된 편견과 특정 인구통계학적 집단에 대한 차별로 인해 의료 진단 및 치료의 공정성이 훼손될 수 있다는 것입니다.

최근 일부 연구에서는 의료 영상의 알고리즘 편향 문제를 해결하기 시작했으며 딥 러닝 모델의 공정성을 향상시키는 몇 가지 방법을 개발했습니다. 그러나 이러한 방법은 일반적으로 훈련 및 테스트 단계에서 데이터 분포가 변경되지 않는다고 가정하는데, 이는 실제 의료 시나리오에서는 사실이 아닌 경우가 많습니다.

예를 들어, 다양한 일차 진료소와 전문 병원에서는 진단을 위해 다양한 영상 기술(예: 다양한 망막 영상 방식)을 사용하여 상당한 영역 이동이 발생하고 이는 결과적으로 모델 성능과 공정성에 영향을 미칠 수 있습니다.

따라서 실제 배포에서는 도메인 이전을 고려해야 하며, 크로스 도메인 시나리오에서 공정성을 유지할 수 있는 모델을 학습해야 합니다.

도메인 적응 및 도메인 일반화가 문헌에서 광범위하게 연구되었지만 이러한 연구는 모델이 다양한 인구 그룹에 걸쳐 공정한 예측을 제공하는지 확인하는 중요성을 무시하고 주로 모델 정확도를 향상시키는 데 중점을 두었습니다. 특히 의료 분야에서는 의사결정 모델이 인간의 건강과 안전에 직접적인 영향을 미치기 때문에 영역 간 공정성을 연구하는 것은 큰 의미가 있습니다.

그러나 현재 도메인 간 공정성 문제를 탐구하기 시작한 연구는 소수에 불과하며 이러한 연구에는 체계적이고 포괄적인 조사가 부족하고 일반적으로 도메인 적응 또는 일반화에만 초점을 맞추고 두 가지를 동시에 수행하는 경우는 거의 없습니다. 또한, 기존 연구는 주로 의료 분류 문제를 해결하는 반면, 도메인 이전 시 똑같이 중요한 의료 세분화 작업을 무시합니다.

이러한 문제를 해결하기 위해 도메인 이전에 따른 알고리즘 공정성을 체계적으로 탐구하는 의료 영상 분야 최초의 연구인 FairDomain을 소개합니다.

다양한 인구통계학적 특성 하에서 정확성과 공정성을 평가하고 공정성이 다양한 도메인에 어떻게 전달되는지 이해하기 위해 여러 최첨단 도메인 적응 및 일반화 알고리즘을 사용하여 광범위한 실험을 수행합니다.

Unsere Beobachtungen zeigen, dass sich die Gruppenleistungsunterschiede zwischen Quell- und Zieldomänen bei verschiedenen medizinischen Klassifizierungs- und Segmentierungsaufgaben deutlich verschärfen. Dies zeigt die Notwendigkeit, fairnessorientierte Algorithmen zu entwickeln, um dieses dringende Problem wirksam anzugehen.

Um die Mängel bestehender Bemühungen zur Verzerrungsminderung auszugleichen, führen wir einen neuen vielseitigen Fair Identity Attention (FIA)-Mechanismus ein, der nahtlos in verschiedene Domänenanpassungs- und Generalisierungsstrategien integriert werden kann von demografischen Merkmalen (z. B. Rassengruppe) zur Förderung der Fairness.

Eine zentrale Herausforderung bei der Entwicklung des FairDomain-Benchmarks ist das Fehlen eines medizinischen Bildgebungsdatensatzes, der Domänenverschiebungen in realen medizinischen Bereichen, die oft durch unterschiedliche Bildgebungstechnologien verursacht werden, wirklich widerspiegelt.

In vorhandenen medizinischen Datensätzen führen Unterschiede in der Patientendemografie zwischen Quell- und Zieldomänen zu Verwirrungen, was es schwierig macht zu unterscheiden, ob beobachtete algorithmische Verzerrungen auf Änderungen der demografischen Verteilung oder inhärente Domänenverschiebungen zurückzuführen sind.

Um dieses Problem zu lösen, haben wir einen einzigartigen Datensatz kuratiert, der aus gepaarten Netzhautfundusbildern derselben Patientenkohorte besteht und dabei zwei verschiedene Bildgebungsmodalitäten (En-Face- und SLO-Fundusbilder) verwendet, speziell für die Analyse der algorithmischen Verzerrung von Domänenübertragungsszenarien.

Zusammenfassung unserer Beiträge:

2. Die Technologie zur fairen Identitätsaufmerksamkeit wird eingeführt, um die Genauigkeit und Fairness bei der Domänenanpassung und -verallgemeinerung zu verbessern.

3. Erstellung eines umfangreichen gepaarten medizinischen Segmentierungs- und Klassifizierungsdatensatzes für die Fairness-Forschung, insbesondere zur Untersuchung von Fairness-Fragen bei Domänenübertragungen.

Datenerfassung und Qualitätskontrolle

Die Probanden wurden zwischen 2010 und 2021 aus einer großen akademischen Augenklinik der Harvard Medical School ausgewählt. In dieser Studie werden zwei domänenübergreifende Aufgaben untersucht, nämlich medizinische Segmentierungs- und medizinische Klassifizierungsaufgaben. Für die medizinische Segmentierungsaufgabe umfassen die Daten:

4

5. Anmerkung zu Tassen- und Tellermasken. Konkret wird zunächst die Pixelanmerkung des Bereichs zwischen Becher und Bandscheibe durch das OCT-Gerät erfasst, und die Software des OCT-Herstellers segmentiert den Bandscheibenrand im 3D-OCT in die Öffnungen der Bruchschen Membran und erkennt den Becherrand als innere Begrenzungsmembran (ILM). ) die Ebene schneiden Der Schnittpunkt der minimalen Oberfläche. Aufgrund des hohen Kontrasts der Bruchschen Membranöffnungen und inneren Grenzmembranen zum Hintergrund können diese Grenzen leicht segmentiert werden. Da die Software des OCT-Herstellers 3D-Informationen nutzt, ist die Tassen-Scheiben-Segmentierung im Allgemeinen zuverlässig. Angesichts der begrenzten Verfügbarkeit und der hohen Kosten von OCT-Geräten in der Primärversorgung schlagen wir eine Methode zur Übertragung von 3D-OCT-Anmerkungen auf 2D-SLO-Fundusbilder vor, um die Effizienz des frühen Glaukom-Screenings zu verbessern. Wir verwenden das NiftyReg-Tool, um SLO-Fundusbilder präzise mit OCT-abgeleiteten Pixelanmerkungen auszurichten und so eine große Anzahl hochwertiger SLO-Fundusmaskenanmerkungen zu generieren. Dieser Prozess wurde von einem Team medizinischer Experten mit einer Erfolgsquote bei der Registrierung von 80 % validiert, wodurch der Anmerkungsprozess für eine breitere Verwendung in der Grundversorgung optimiert wurde. Wir nutzen diese ausgerichteten und manuell überprüften Anmerkungen in Kombination mit SLO- und En-face-Fundusbildern, um die algorithmische Fairness von Segmentierungsmodellen unter Domänenverschiebung zu untersuchen. Für die medizinische Klassifizierungsaufgabe umfassen die Daten die folgenden vier Arten: 1. SLO-Fundusbildscan; 4 . Die Probanden im medizinischen Klassifizierungsdatensatz werden basierend auf den Ergebnissen der Gesichtsfeldtests in zwei Kategorien unterteilt: normal und Glaukom.Datenfunktionen

Der medizinische Segmentierungsdatensatz enthält 10.000 Proben von 10.000 Probanden. Wir teilen die Daten in einen Trainingssatz mit 8000 Proben und einen Testsatz mit 2000 Proben auf. Das Durchschnittsalter der Patienten betrug 60,3 ± 16,5 Jahre. Der Datensatz enthält sechs demografische Attribute, darunter Alter, Geschlecht, Rasse, ethnische Zugehörigkeit, bevorzugte Sprache und Familienstand. Die demografische Verteilung ist wie folgt: Geschlecht: 58,5 % weiblich, 41,5 % männlich;Rasse: 9,2 % asiatisch, 14,7 % schwarz, 76,1 % weiß;

Ethnizität: 90,6 % nicht-hispanisch, 3,7 % hispanisch 5,7 % entfielen auf Unbekannt; Bevorzugte Sprache: 92,4 % auf Englisch, 1,5 % auf Spanisch, 1 % auf andere Sprachen, 5,1 % auf Unbekannt. Familienstand: verheiratet oder verpartnert 57,7 %, ledig 27,1 %, geschieden 6,8 %, rechtskräftig getrennt 0,8 %, verwitwet 5,2 %, unbekannt 2,4 %. Ebenso enthält der medizinische Klassifizierungsdatensatz 10.000 Proben von 10.000 Probanden mit einem Durchschnittsalter von 60,9 ± 16,1 Jahren. Wir teilen die Daten in einen Trainingssatz mit 8000 Proben und einen Testsatz mit 2000 Proben auf. Die demografische Verteilung ist wie folgt: Geschlecht: 72,5 % weiblich, 27,5 % männlich; Rasse: 8,7 % asiatisch, 14,5 % schwarz, 76,8 % weiß; Ethnizität: 96,0 % Nicht-Hispanoamerikaner, 4,0 % sind Hispanoamerikaner. ;Bevorzugte Sprache: 92,6 % Englisch, 1,7 % Spanisch, 3,6 % andere Sprachen, 2,1 % unbekannt;

Familienstand: 58,5 % verheiratet oder in einer Partnerschaft, 26,1 % ledig, 6,9 % geschieden, 0,8 % davon sind verwitwet 1,9 %, auf „Unbekannt“ entfielen 5,8 %.

Diese detaillierten demografischen Informationen bieten eine reichhaltige Datengrundlage für eingehende Untersuchungen zur Fairness bei domänenübergreifenden Aufgaben.

Methoden zur Verbesserung der Fairness domänenübergreifender KI-Modelle Fair Identity Attention (FIA)

Problemdefinition

Domänenanpassung (DA) und Domänengeneralisierung (DG) Es handelt sich um eine Schlüsseltechnik in Die Entwicklung von Modellen für maschinelles Lernen ist darauf ausgelegt, die Variabilität zu bewältigen, die auftreten kann, wenn ein Modell von einem bestimmten Bereich auf einen anderen angewendet wird.

Im Bereich der medizinischen Bildgebung sind DA- und DG-Techniken von entscheidender Bedeutung für die Erstellung von Modellen, die Schwankungen zwischen verschiedenen medizinischen Einrichtungen, Bildgebungsgeräten und Patientenpopulationen zuverlässig bewältigen können. Ziel dieses Artikels ist es, die Fairness-Dynamik im Kontext der Domänenübertragung zu untersuchen und Methoden zu entwickeln, um sicherzustellen, dass Modelle bei der Anpassung oder Verallgemeinerung an neue Domänen fair und zuverlässig bleiben.

Unser Ziel ist es, eine Methodenfunktion f zu entwickeln, die die häufige Verschlechterung der Fairness abmildert, wenn ein Modell von der Quelldomäne in die Zieldomäne übertragen wird. Solche Verschärfungen sind in erster Linie auf die Möglichkeit zurückzuführen, dass Domänenverschiebungen bestehende Verzerrungen im Datensatz verstärken, insbesondere solche im Zusammenhang mit demografischen Merkmalen wie Geschlecht, Rasse oder ethnischer Zugehörigkeit.

Um dieses Problem anzugehen, schlagen wir einen auf Aufmerksamkeitsmechanismen basierenden Ansatz vor, der darauf abzielt, Bildmerkmale zu identifizieren und zu nutzen, die für nachgelagerte Aufgaben wie Segmentierung und Klassifizierung relevant sind, und dabei demografische Attribute zu berücksichtigen.

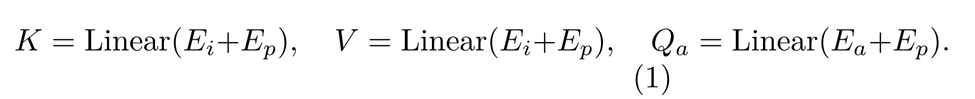

Abbildung 3 zeigt die Architektur des vorgeschlagenen Fair-Identity-Aufmerksamkeitsmoduls. Dieses Modul erhält zunächst die Eingabebild-Einbettung E_i und die Attribut-Einbettung E_a durch Verarbeitung des Eingabebildes und der eingegebenen statistischen Attributbeschriftungen. Diese Einbettungen werden dann zur Positionseinbettung E_p hinzugefügt. Die detaillierte Berechnungsformel lautet wie folgt:

Durch Berechnung des Skalarprodukts von Abfrage und Schlüssel extrahieren wir die Ähnlichkeitsmatrix, die sich auf das aktuelle Merkmalsattribut bezieht. Das Skalarprodukt aus dieser Matrix und diesem Wert wird dann verwendet, um Features zu extrahieren, die in nachgelagerten Aufgaben für jedes Feature-Attribut von Bedeutung sind. Dieser Prozess wird durch die folgende Formel dargestellt:

wobei D ein Skalierungsfaktor ist, um übermäßig große Werte in der Softmax-Funktion zu vermeiden.

Anschließend fügt eine Restverbindung E_i zur Ausgabe der Aufmerksamkeit hinzu, um die Integrität der Eingabeinformationen aufrechtzuerhalten. Schließlich extrahieren eine Normalisierungsschicht und eine mehrschichtige Perzeptronschicht (MLP) weitere Merkmale. Nach einer weiteren Restoperation an den Ausgaben dieser beiden Schichten erhalten wir die endgültige Ausgabe des Fair-Attention-Moduls.

Der Fair Identity Attention Mechanism ist ein leistungsstarkes und vielseitiges Tool, das entwickelt wurde, um die Modellleistung zu verbessern und gleichzeitig Fairnessprobleme zu lösen. Durch die explizite Berücksichtigung demografischer Merkmale wie Geschlecht, Rasse oder ethnischer Zugehörigkeit wird sichergestellt, dass erlernte Darstellungen nicht unbeabsichtigt die in den Daten vorhandenen Vorurteile verstärken.

Durch seine Architektur lässt es sich als Plug-in-Komponente nahtlos in jedes bestehende Netzwerk integrieren. Dieser modulare Charakter ermöglicht es Forschern und Praktikern, faire Identitätsaufmerksamkeit in ihre Modelle zu integrieren, ohne dass umfangreiche Änderungen an der zugrunde liegenden Architektur erforderlich sind.

Daher trägt das Modul „Fair Identity Attention“ nicht nur zur Verbesserung der Modellgenauigkeit und Fairness bei Segmentierungs- und Klassifizierungsaufgaben bei, sondern fördert auch die Implementierung vertrauenswürdiger KI, indem es die faire Behandlung verschiedener Gruppen im Datensatz fördert.

Experimente

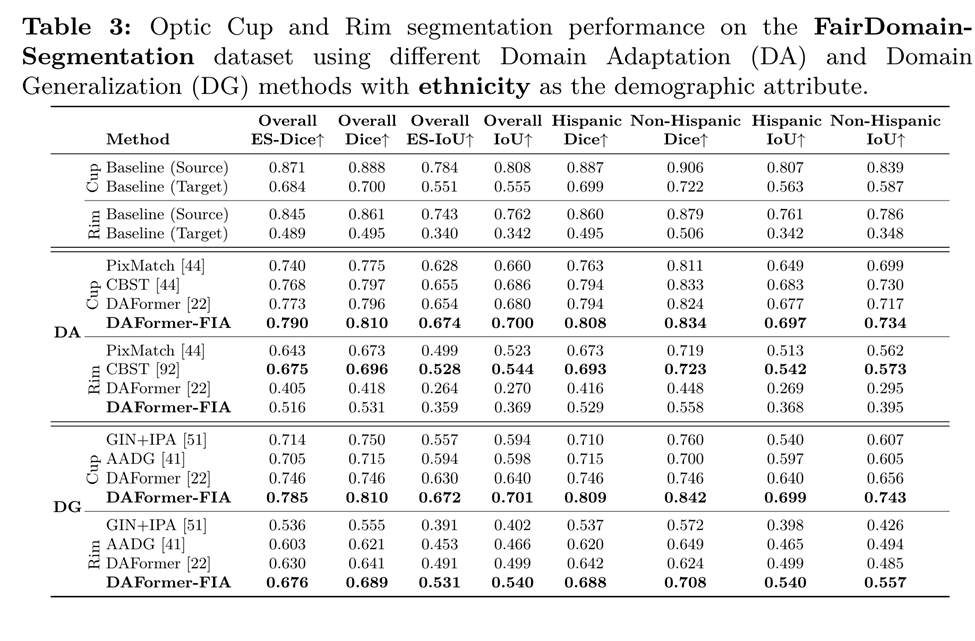

In unseren Experimenten analysieren wir zunächst die Fairness im Kontext des Domänentransfers und konzentrieren uns dabei insbesondere auf die Aufgabe der Tassen- und Tellersegmentierung. Unter Cup-to-Disc-Segmentierung versteht man den Prozess der genauen Abgrenzung von Augenhöhle und Papille in Fundusbildern, der für die Berechnung des Cup-to-Disc-Verhältnisses (CDR) von entscheidender Bedeutung ist, einem Schlüsselparameter bei der Beurteilung des Fortschreitens und Risikos eines Glaukoms.

Diese Aufgabe ist im Bereich der medizinischen Bildgebung besonders wichtig, insbesondere bei der Diagnose und Behandlung von Augenerkrankungen wie dem Glaukom. Da es sich bei der Augenhöhle um einen wichtigen Teilbereich der Papille handelt, formulieren wir die Segmentierungsaufgabe in eine Segmentierung von Augenhöhle und Rand (der Gewebebereich zwischen der Augenhöhle und dem Rand der Papille) um, um Fehler aufgrund der großen Überlappung zwischen Augenhöhle und Papille zu vermeiden optische Disc. Dies führt zu Leistungsverzerrungen.

Wir haben die Fairness-Leistung in drei verschiedenen Bevölkerungsgruppen (Geschlecht, Rasse und ethnische Zugehörigkeit) in zwei verschiedenen Bereichen untersucht: En-face-Fundusbilder, die mit der optischen Kohärenztomographie (OCT) aufgenommen wurden, und Scanning-Laser-Fundusbilder (SLO).

In nachfolgenden Experimenten haben wir das En-Face-Fundusbild als Quelldomäne und das SLO-Fundusbild als Zieldomäne ausgewählt. Der Grund dafür ist, dass En-face-Fundusbilder im Vergleich zu SLO-Fundusbildern in der Augenheilkunde häufiger anzutreffen sind und daher die Datenverfügbarkeit deutlich höher ist.

Daher entscheiden wir uns dafür, das En-face-Fundusbild als Quelldomäne und das SLO-Fundusbild als Zieldomäne zu verwenden. Für die Klassifizierungsaufgabe verwenden wir die Fundusbilder dieser beiden Domänen als Quell- und Zieldomänen, klassifiziert in zwei Kategorien: normal und Glaukom.

Bewertungsmetriken

Wir verwenden Dice- und IoU-Metriken, um die Segmentierungsleistung zu bewerten, und AUC, um die Leistung von Klassifizierungsaufgaben zu bewerten. Diese traditionellen Segmentierungs- und Klassifizierungsmetriken spiegeln zwar die Modellleistung wider, berücksichtigen jedoch nicht grundsätzlich die Fairness zwischen demografischen Gruppen.

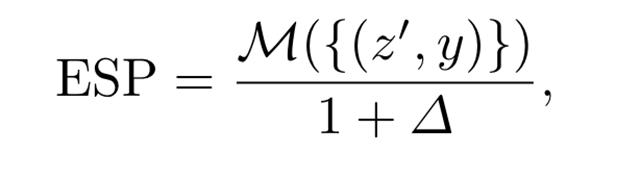

Um den potenziellen Kompromiss zwischen Modellleistung und Fairness in der medizinischen Bildgebung anzugehen, verwenden wir die neuartige Equity Scaled Performance (ESP)-Metrik, um Leistung und Fairness bei Segmentierungs- und Klassifizierungsaufgaben zu bewerten.

Lassen Sie ∈{Dice,IoU,AUC,...}M in {Dice,IoU, AUC, .}M∈{Dice,IoU,AUC,...} eine allgemeine Leistung darstellen, die für die Segmentierung oder den Klassifizierungsindex geeignet ist . Herkömmliche Bewertungen ignorieren häufig demografische Identitätsmerkmale und verfehlen dadurch kritische Fairness-Bewertungen. Um die Fairness einzubeziehen, berechnen wir zunächst den Leistungsunterschied Δ, definiert als die kollektive Abweichung der Kennzahlen jeder demografischen Gruppe von der Gesamtleistung, die wie folgt formuliert wird:

Wenn Leistungsgerechtigkeit zwischen den Gruppen erreicht wird, liegt Δ nahe bei Null , spiegelt den kleinsten Unterschied wider. Dann kann die ESP-Metrik wie folgt formuliert werden:

Diese einheitliche Metrik hilft bei der umfassenden Bewertung von Deep-Learning-Modellen, wobei der Schwerpunkt nicht nur auf deren Genauigkeit liegt (z. B. durch Messungen wie Dice, IoU und AUC), sondern auch auch auf ihre Leistung in unterschiedlicher Gerechtigkeit zwischen Bevölkerungsgruppen.

Cup-Rim-Segmentierungsergebnisse unter Domänenverschiebungen

Glaukom-Klassifizierungsergebnisse unter Domänenverschiebungen

Zusammenfassung

Dieser Artikel konzentriert sich auf künstliche Intelligenz (insbesondere medizinische). Fairnessfragen in der KI), die für eine gerechte Gesundheitsversorgung von entscheidender Bedeutung sind.

Da Kliniken möglicherweise unterschiedliche Bildgebungstechnologien verwenden, bleibt die Frage der Fairness bei der Domänenübertragung weitgehend unerforscht. Unsere Arbeit stellt FairDomain vor, eine umfassende Studie zur algorithmischen Fairness bei Domänenübertragungsaufgaben, einschließlich Domänenanpassung und -verallgemeinerung, die zwei gemeinsame Aufgaben der medizinischen Segmentierung und Klassifizierung umfasst.

Wir schlagen ein neuartiges Plug-and-Play-Modul „Fair Identity Attention“ (FIA) vor, um die Korrelation von Merkmalen basierend auf demografischen Attributen durch einen Aufmerksamkeitsmechanismus zu erlernen und so die Fairness bei Domänenübertragungsaufgaben zu verbessern.

Wir haben außerdem den ersten fairnessfokussierten domänenübergreifenden Datensatz erstellt, der zwei gepaarte Bildgebungsbilder derselben Patientenkohorte enthält, um die verwirrenden Auswirkungen von Änderungen der demografischen Verteilung auf die Modellgerechtigkeit auszuschließen und eine präzise Bewertung der Auswirkungen des Domänentransfers auf die Modellgerechtigkeit zu ermöglichen.

Unser Fair-Identity-Attention-Modell kann bestehende Domänenanpassungs- und Generalisierungsmethoden verbessern, sodass die Modellleistung unter Berücksichtigung der Fairness verbessert werden kann.

Hinweis: Das Titelbild wird von KI generiert.

위 내용은 ECCV2024 | Harvard 팀, 도메인 간 의료 이미지 분할 및 분류의 공정성을 달성하기 위해 FairDomain 개발의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!