コース 2672

コース紹介:Golang は、GPM スケジューラー モデルと完全なシナリオ分析を深く理解しています。このビデオを見て何かを得ることができれば幸いです。スケジューラーの起源と分析、GMP モデルの概要、および 11 の概要が含まれています。シナリオ。

コース 5963

コース紹介:flex プロパティは、フレックス ボックス モデル オブジェクトの子要素がスペースを割り当てる方法を設定または取得するために使用されます。これは、flex-grow、flex-shrink、および flex-basis プロパティの短縮形プロパティです。注: 要素がフレックスボックス モデル オブジェクトの子でない場合、flex プロパティは効果がありません。

コース 2857

コース紹介:コースの紹介: 1. クロスドメイン処理、トークン管理、ルート インターセプト; 2. リアル インターフェイスのデバッグ、API レイヤーのカプセル化; 3. Echart とページング コンポーネントの二次カプセル化; 4. Vue パッケージ化の最適化と一般的な問題への回答。

コース 1795

コース紹介:Apipost は、API 設計、API デバッグ、API ドキュメント、自動テストを統合する API R&D コラボレーション プラットフォームです。grpc、http、websocket、socketio、socketjs タイプのインターフェイスのデバッグをサポートし、プライベート化された展開をサポートします。 ApiPost を正式に学習する前に、いくつかの関連概念、開発モデル、専門用語を理解する必要があります。 アピポスト公式サイト:https://www.apipost.cn

コース 5521

コース紹介:(WeChat にご相談ください: phpcn01) 総合実践コースは、最初の 2 段階の学習結果を統合し、フロントエンドと PHP のコア知識ポイントの柔軟な適用を実現し、実践的なトレーニングを通じて独自のプロジェクトを完成させ、オンライン実装のガイダンスを提供することを目的としています。 総合的な実践的な主要実践コースには、ソーシャル電子商取引システムのバックエンド開発、商品管理、支払い/注文管理、顧客管理、流通/クーポン システム設計、WeChat/Alipay 決済プロセス全体、Alibaba Cloud/Pagoda の運用と保守、およびプロジェクトが含まれます。オンライン操作....

tp6 モデルがクエリ用の複数のデータ テーブルに関連付けられている場合、クエリが非常に遅くなります。最適化するにはどうすればよいですか? 最適化方法はありますか?ヘルプ! ! ! ! !

2023-11-17 08:50:36 0 0 84

Laravel Spatieの権限設定方法を設定して、ロールに基づいて各ユーザーの権限のセットを定義するにはどうすればよいですか?

2023-11-14 12:58:58 0 1 292

Laravel 8のブレードアセットを使用して画像を表示しますが、リソースサブフォルダーからロードします

2023-11-09 12:47:02 0 1 314

Laravel の機能テストで GuzzleHttp クライアントを使用してサードパーティ API へのリクエストをシミュレートするにはどうすればよいですか?

2023-11-09 11:42:58 0 1 207

App\Models\User::$profile のオーバーロードされた属性の間接的な変更は無効です。

2023-11-08 11:50:44 0 1 270

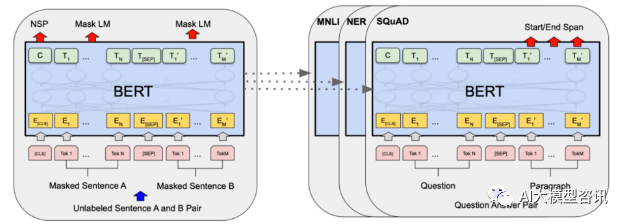

コース紹介:2018 年に Google が BERT をリリースしました。リリースされると、11 個の NLP タスクの最先端 (Sota) 結果を一気に打ち破り、NLP 界の新たなマイルストーンとなりました。BERT の構造は次のとおりです。下の図では、左側は BERT モデルのプリセット、右側はトレーニング プロセス、右側は特定のタスクの微調整プロセスです。このうち、微調整ステージは、テキスト分類、品詞のタグ付け、質問と回答システムなど、その後のいくつかの下流タスクで使用されるときに微調整するためのものです。BERT はさまざまな上で微調整できます。構造を調整せずにタスクを実行できます。 「事前トレーニング済み言語モデル + 下流タスク微調整」のタスク設計により、強力なモデル効果をもたらします。以来、「言語モデルの事前トレーニング + 下流タスクの微調整」が NLP 分野のトレーニングの主流になりました。

2023-10-07 コメント 0 909

コース紹介:微調整とは、パフォーマンスを向上させるために、特定のタスクに関して事前トレーニングされたモデルにわずかな調整を行うことを指します。感情分析では、事前トレーニングされた自然言語処理モデル (BERT、RoBERTa、ALBERT など) を基本モデルとして使用し、特定の感情分析データセットと組み合わせて微調整して、より正確な感情分析結果を得ることができます。微調整を通じて、特定のタスクのニーズに応じてモデルを適応させ、特定のタスクにおけるモデルのパフォーマンスを向上させることができます。モデルを微調整する目的は、一般的な自然言語処理モデルを微調整して、感情分析タスクにおける認識能力と予測精度を向上させることです。微調整を通じて、モデルの学習機能を特定の領域に移し、特定のタスクの要件により適したものにすることができます。このような微調整

2024-01-22 コメント 0 745

コース紹介:ReFT (Representation Finetuning) は、大規模な言語モデルを微調整する方法を再定義する画期的な手法です。スタンフォード大学の研究者らがarxivに最近(4月)発表した論文によると、ReFTは従来の重みベースの微調整手法とは大きく異なり、これらの大規模モデルを新しいものに適応させるためのより効率的かつ効果的な方法を提供するという。タスクとエリア!この論文を紹介する前に、PeFT について見てみましょう。パラメーターの効率的な微調整 PeFTParameterEfficientFine-Tuning (PEFT) は、少数または追加のモデル パラメーターを微調整するための効率的な微調整方法です。従来の予測ネットワークによる微調整

2024-04-15 コメント 812

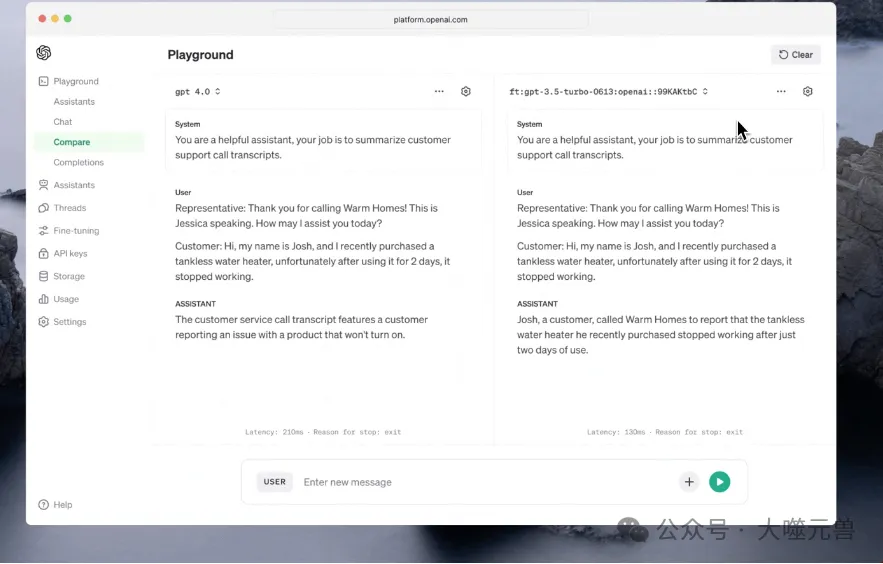

コース紹介:OpenAI は、微調整 API の大幅な機能強化と、カスタム モデル ルーチンの拡張を発表しました。これらのアップデートにより、開発者は AI モデルを微調整するための前例のない制御が可能になり、特定のビジネス ニーズに合わせてカスタマイズされたモデルを構築する新しい方法が提供されます。 2023 年 8 月の発表以来、GPT-3.5 の微調整 API は、洗練された AI モデルを組み合わせて特定のタスクを実行する上での転換点となりました。微調整ツールは、AI モデルの開発において重要な役割を果たします。これらにより、開発者は特定のデータ セットとアプリケーション シナリオに基づいてモデルのパフォーマンスを最適化できます。 2022 年 4 月に、OpenAI は微調整 API に対する一連の改善をリリースしました。これらの改善により、モデルの柔軟性と精度が向上するだけでなく、開発者にさらに多くの機能が提供されます。

2024-04-07 コメント 844

コース紹介:Google T5 モデルから OpenAI GPT シリーズの大規模モデルに至る大規模言語モデル (LLM) は、コンテキスト学習や思考連鎖推論などの優れた一般化機能を実証していることがわかっています。同時に、LLM が自然言語の命令に従い、現実世界のタスクを完了できるようにするために、研究者は LLM の命令を微調整する方法を模索してきました。これは 2 つの方法で行われます。人間による注釈付きのプロンプトとフィードバックを使用して幅広いタスクでモデルを微調整する方法と、手動または自動で生成された指示で強化された公開ベンチマークとデータセットを使用して微調整を監視する方法です。このうち、Self-Instruct 微調整は、SOTA の指示から教師を微調整するシンプルで効果的な方法です。

2023-04-10 コメント 0 1200