テクノロジー周辺機器

テクノロジー周辺機器

AI

AI

北京大学とスタンフォード大学による新しいオープンソース フレームワークである Pika は、理解力を高めるために LLM を使用することで、複雑なプロンプト ワードの普及モデルをより深く理解できるようにします。

北京大学とスタンフォード大学による新しいオープンソース フレームワークである Pika は、理解力を高めるために LLM を使用することで、複雑なプロンプト ワードの普及モデルをより深く理解できるようにします。

北京大学とスタンフォード大学による新しいオープンソース フレームワークである Pika は、理解力を高めるために LLM を使用することで、複雑なプロンプト ワードの普及モデルをより深く理解できるようにします。

ピカ北京大学とスタンフォード大学が提携、オープンソース最新のテキスト画像生成/編集フレームワーク!

追加のトレーニングを行わなくても、普及モデルはより強力なプロンプト単語理解機能を備えることができます。

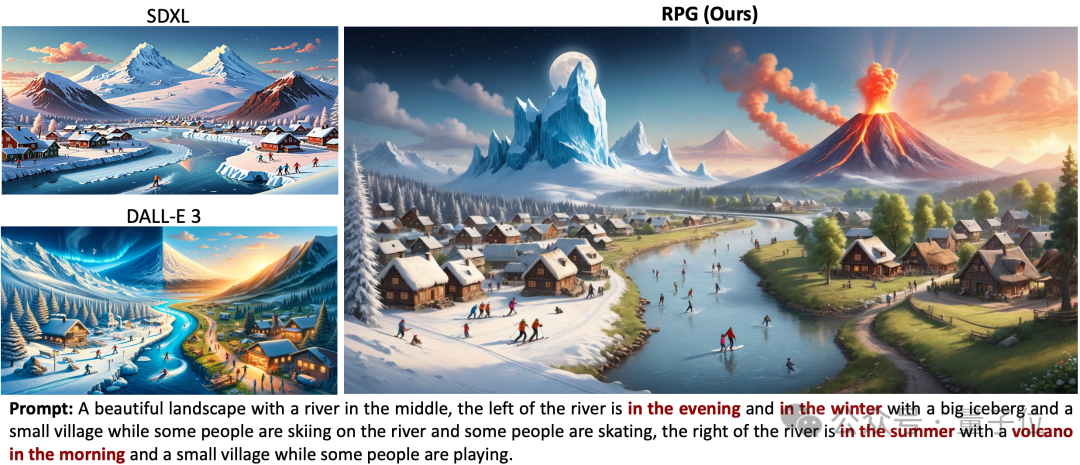

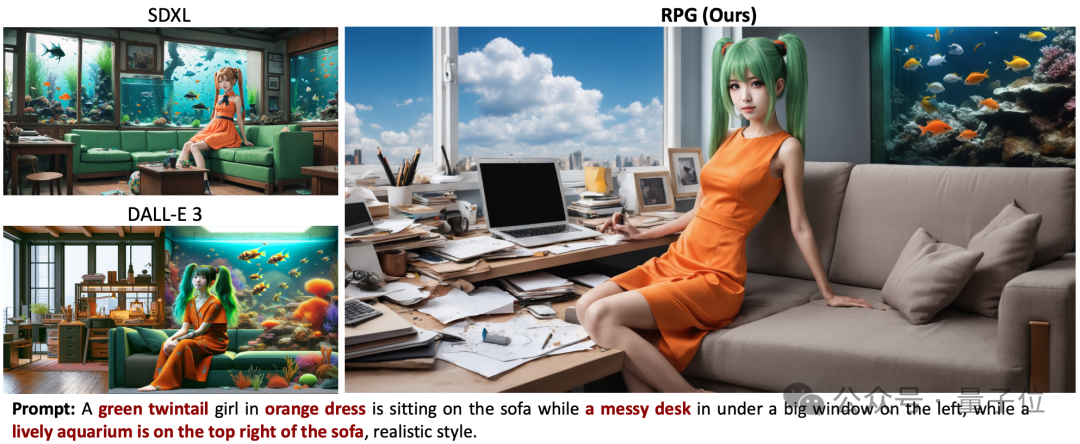

非常に長く複雑なプロンプトワードに直面しても、精度はより高く、詳細はより適切に制御され、生成された画像はより自然になります。 最強の画像生成モデルDall・E 3やSDXLを上回る効果。 たとえば、写真の左右に氷と炎の 2 つの層があり、左側に氷山、右側に火山がある必要があります。 SDXL はプロンプト ワードの要件をまったく満たしておらず、Dall·E 3 は火山の詳細を生成しませんでした。

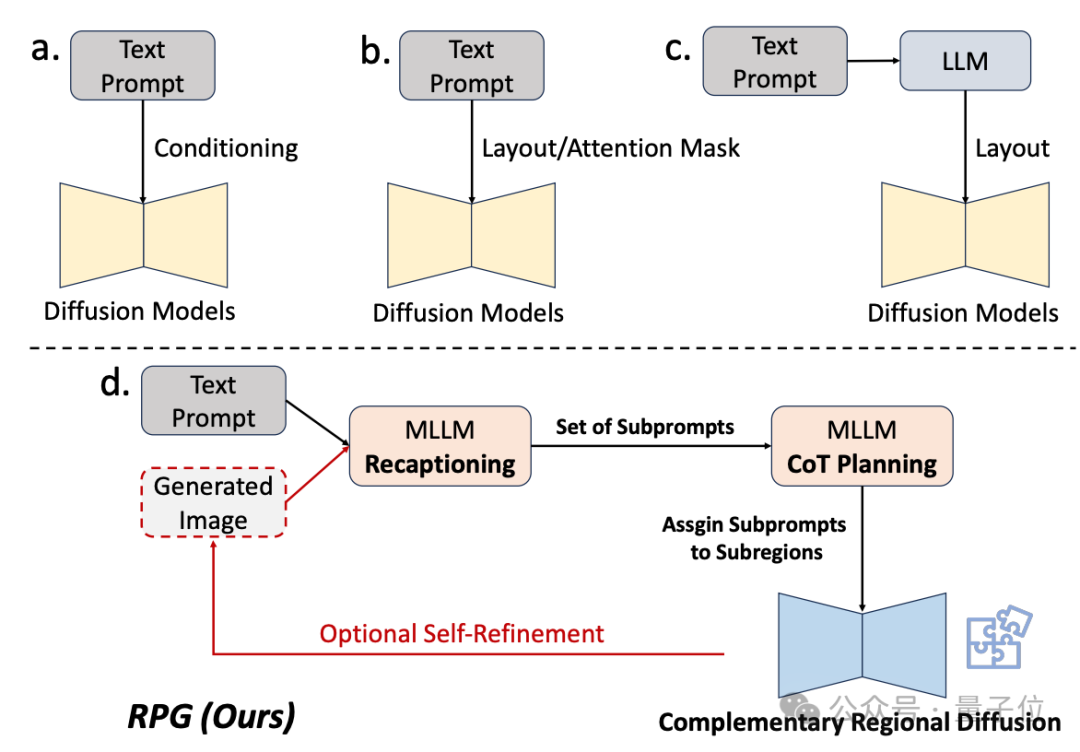

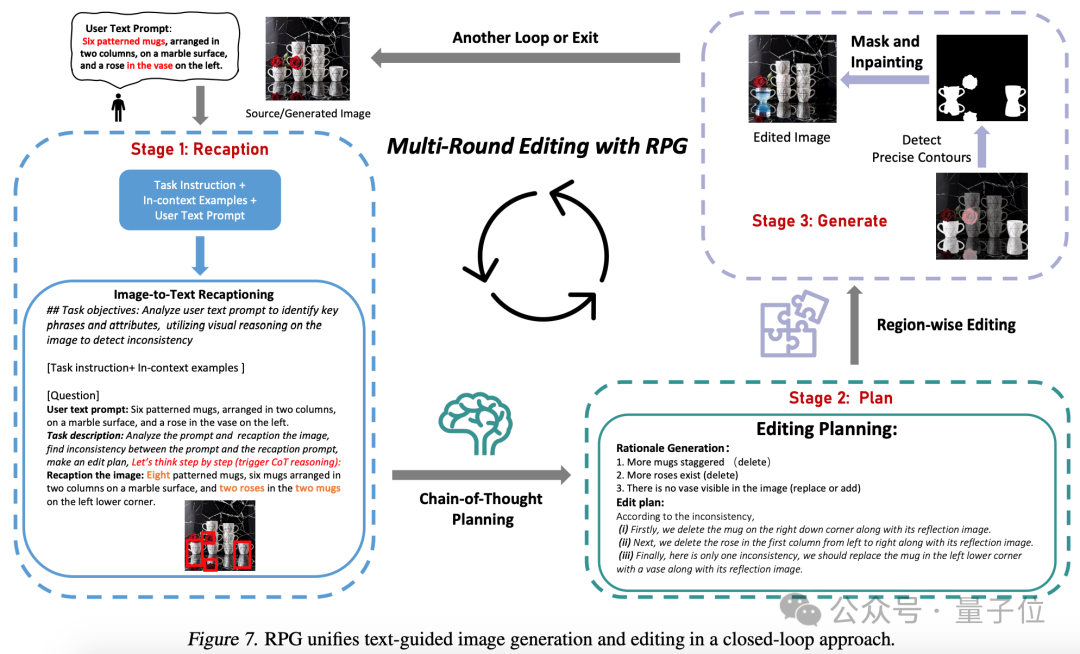

RPG (Recaption, Plan and Generate) です。

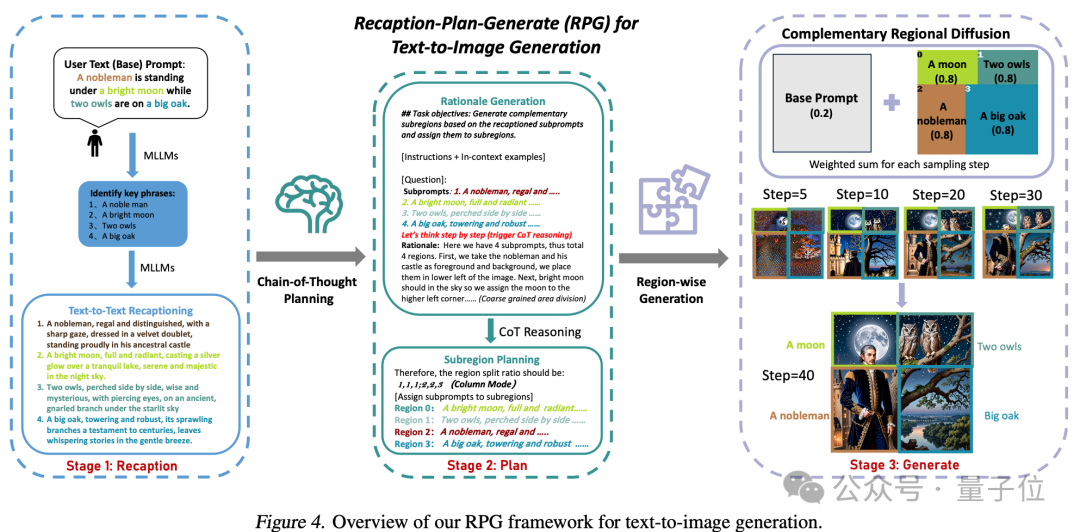

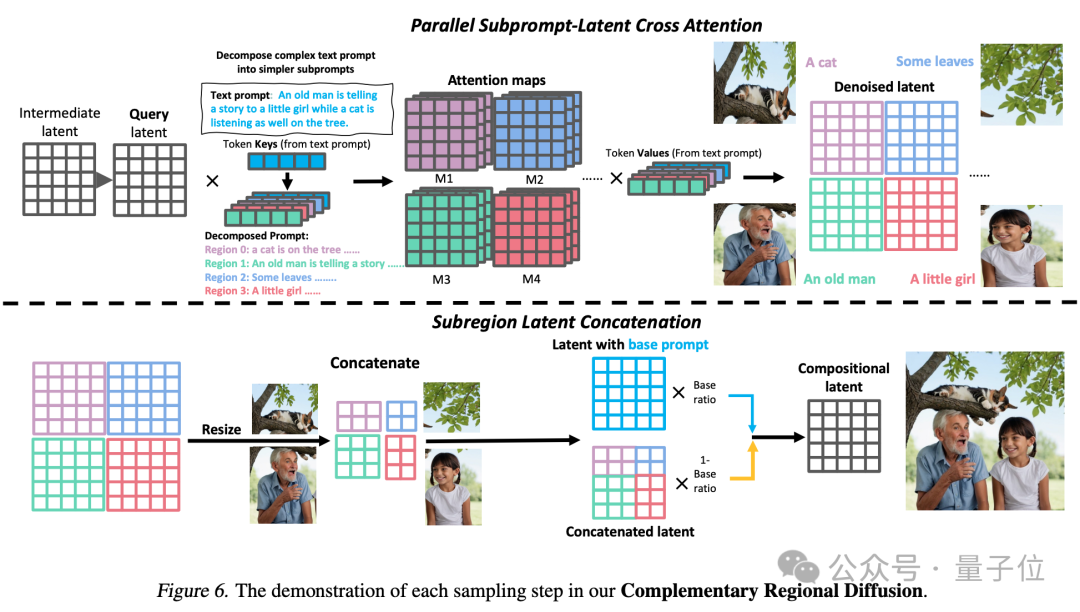

1. マルチモーダル再キャプション : 大規模なモデルを使用する 複雑なテキスト プロンプトを次のように分解する複数のサブプロンプトを作成し、各サブプロンプトをより詳細に再説明して、プロンプトの単語を理解する拡散モデルの能力を向上させます。

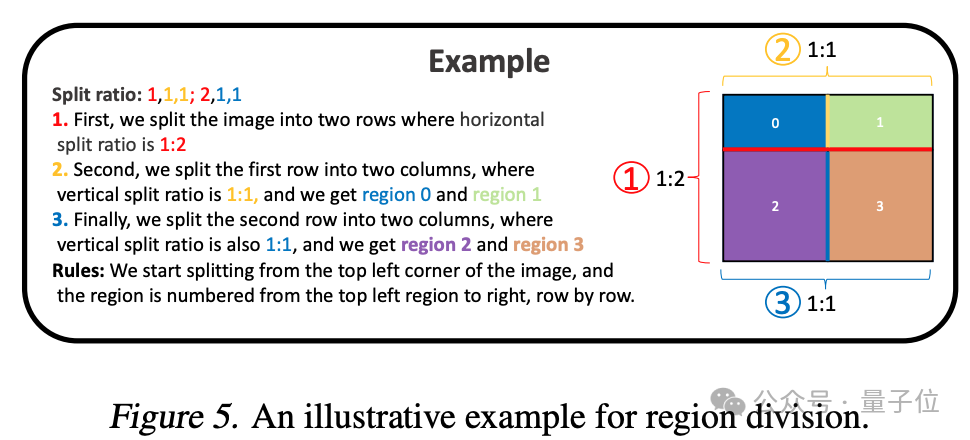

2. 思考連鎖計画 (思考連鎖計画): マルチモーダル大規模モデルの思考連鎖推論機能を使用して、画像空間を分割します。各サブ領域は異なるサブキューと一致し、複雑な生成タスクを複数の単純な生成タスクに分割します。

3. 補完的な地域拡散: 空間を分割した後、重複しない領域はサブプロンプトに基づいて画像を生成し、スプライシングを実行します。

最後に、プロンプトワードの要件をよりよく満たす画像が生成されます。

最後に、プロンプトワードの要件をよりよく満たす画像が生成されます。

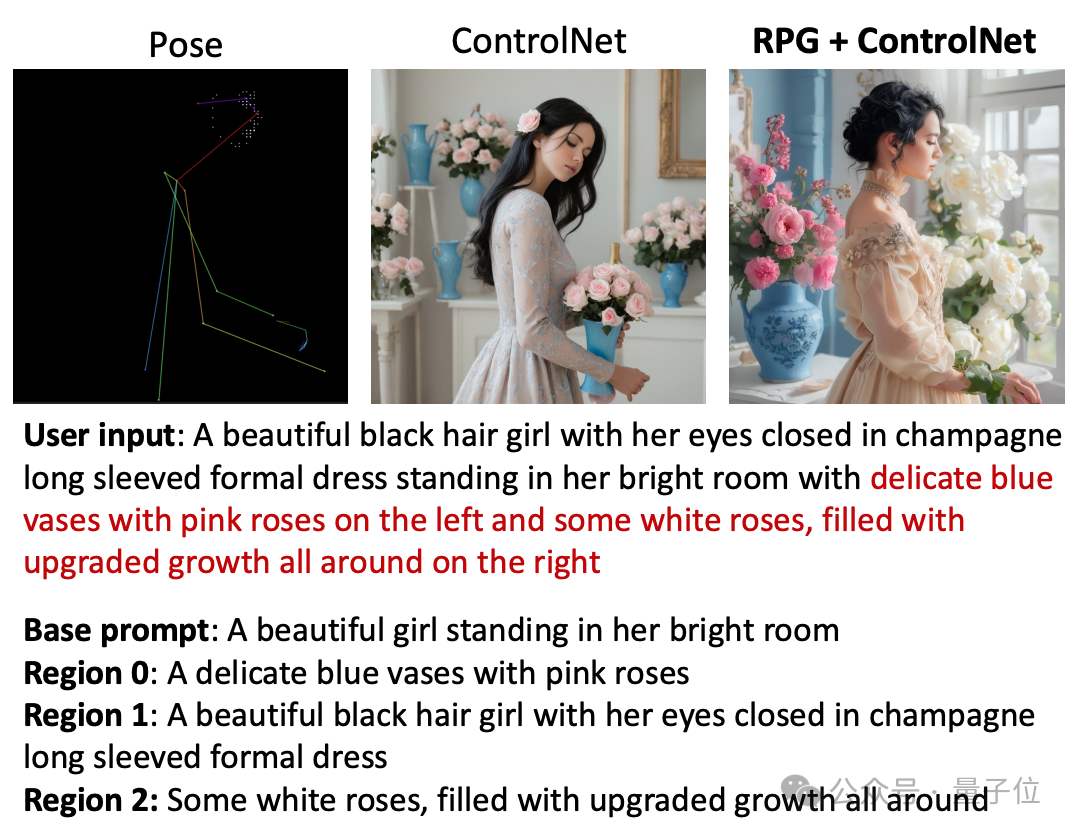

#RPG フレームワークは、姿勢、奥行き、その他の情報を画像生成に使用することもできます。

#RPG フレームワークは、姿勢、奥行き、その他の情報を画像生成に使用することもできます。

ControlNet と比較して、RPG は入力プロンプトの単語をさらに分割できます。

ユーザーの声: 明るい部屋に、シャンパン色の長袖のフォーマルドレスを着た美しい黒髪の少女が目を閉じて立っていた。ピンクのバラが入った繊細な青い花瓶が部屋の左側に置かれ、右側には鮮やかな白いバラが数本置かれていました。

基本的なプロンプトワード: 美しい女の子が明るい部屋に立っています。

エリア 0: ピンクのバラで満たされた繊細な青い花瓶

エリア 1: 目を閉じたシャンパン色の長袖のフォーマル ドレスを着た黒髪の美しい少女。

エリア 2: 鮮やかな白いバラ。

は、閉ループ画像の生成と編集も実現できます。

は、閉ループ画像の生成と編集も実現できます。

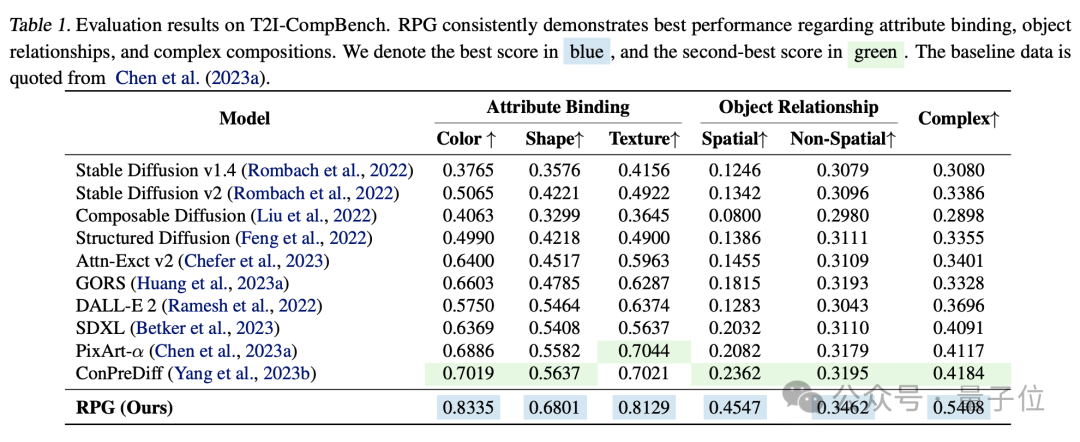

実験的な比較に基づくと、RPG は、色、形状、スペース、テキストの精度などの点で他の画像生成モデルを上回っています。

研究チーム

この研究には、北京大学の Ling Yang 氏と Zhaochen Yu 氏の 2 人の共著者がいます。

参加著者には、AI スタートアップ Pika の共同創設者兼 CTO である Chenlin Meng 氏が含まれます。

彼女はスタンフォード大学でコンピューター サイエンスの博士号を取得しており、コンピューター ビジョンと 3D ビジョンに関する豊富な学術経験を持っており、ノイズ除去拡散暗黙モデル (DDIM) の論文に参加しており、現在 1 つの記事で 1,700 件の引用が行われています。生成 AI 関連の研究論文は、ICLR、NeurIPS、CVPR、ICML などのトップカンファレンスで数多く発表されており、その多くが Oral に選出されています。

昨年、Pika は AI 動画生成製品 Pika 1.0 で瞬く間にヒット商品となりましたが、スタンフォード大学の中国人女性博士 2 名による設立の背景により、さらに注目を集めました。

△左がGuo Wenjing (Pika CEO)、右がChenlin Meng

副学部長も研究に参加北京大学コンピューターサイエンス学科 Cui Bin 教授、彼はデータ科学技術研究所の所長でもあります。

さらに、スタンフォード AI 研究所の Minkai Xu 博士とスタンフォード大学助教授の Stefano Ermon が共同でこの研究に参加しました。

ペーパーアドレス: https://arxiv.org/abs/2401.11708

コードアドレス: https://github.com/YangLing0818/RPG-拡散マスター

以上が北京大学とスタンフォード大学による新しいオープンソース フレームワークである Pika は、理解力を高めるために LLM を使用することで、複雑なプロンプト ワードの普及モデルをより深く理解できるようにします。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7364

7364

15

15

1628

1628

14

14

1353

1353

52

52

1265

1265

25

25

1214

1214

29

29

C言語でchar配列の使用方法

Apr 03, 2025 pm 03:24 PM

C言語でchar配列の使用方法

Apr 03, 2025 pm 03:24 PM

Char Arrayは文字シーケンスをC言語で保存し、char array_name [size]として宣言されます。アクセス要素はサブスクリプト演算子に渡され、要素は文字列のエンドポイントを表すnullターミネーター「\ 0」で終了します。 C言語は、strlen()、strcpy()、strcat()、strcmp()など、さまざまな文字列操作関数を提供します。

Cスイッチステートメントでデフォルトに起因するエラーを避けてください

Apr 03, 2025 pm 03:45 PM

Cスイッチステートメントでデフォルトに起因するエラーを避けてください

Apr 03, 2025 pm 03:45 PM

Cスイッチステートメントでデフォルトに起因するエラーを回避するための戦略:定数の代わりに列挙を使用し、ケースステートメントの値を列挙の有効なメンバーに制限します。最後のケースステートメントでフォールスルーを使用して、プログラムが以下のコードを引き続き実行できるようにします。フォールスルーなしのスイッチステートメントの場合、エラー処理のためのデフォルトステートメントを常に追加するか、デフォルトの動作を提供します。

C言語合計の機能は何ですか?

Apr 03, 2025 pm 02:21 PM

C言語合計の機能は何ですか?

Apr 03, 2025 pm 02:21 PM

C言語に組み込みの合計機能はないため、自分で書く必要があります。合計は、配列を通過して要素を蓄積することで達成できます。ループバージョン:合計は、ループとアレイの長さを使用して計算されます。ポインターバージョン:ポインターを使用してアレイ要素を指し示し、効率的な合計が自己概要ポインターを通じて達成されます。アレイバージョンを動的に割り当てます:[アレイ]を動的に割り当ててメモリを自分で管理し、メモリの漏れを防ぐために割り当てられたメモリが解放されます。

c言語の優先順位は何ですか!x?

Apr 03, 2025 pm 02:06 PM

c言語の優先順位は何ですか!x?

Apr 03, 2025 pm 02:06 PM

論理非操作者(!)には、括弧の横に優先順位があります。つまり、表現では、他のほとんどの演算子に先行します。優先順位を理解するには、暗記の暗記だけでなく、さらに重要なことに、複雑な表現での検出不可能なエラーを避けるために、その背後にある論理と潜在的な落とし穴を理解する必要があります。ブラケットを追加すると、表現の意図を明確にし、コードの明確さと保守性を向上させ、予期しない動作を防ぐことができます。

スイッチケースステートメントのデフォルトの重要性(C言語)

Apr 03, 2025 pm 03:57 PM

スイッチケースステートメントのデフォルトの重要性(C言語)

Apr 03, 2025 pm 03:57 PM

デフォルトステートメントは、変数値がケースステートメントと一致しない場合にコードブロックが実行されることを保証するデフォルトの処理パスを提供するため、スイッチケースステートメントで重要です。これにより、予期しない動作やエラーが防止され、コードの堅牢性が向上します。

C言語関数の返品値の種類は何ですか? C言語関数の返品値のタイプの概要?

Apr 03, 2025 pm 11:18 PM

C言語関数の返品値の種類は何ですか? C言語関数の返品値のタイプの概要?

Apr 03, 2025 pm 11:18 PM

c言語関数の返品値タイプには、int、float、double、char、void、およびポインタータイプが含まれます。 intは整数を返すために使用され、フロートとダブルはフロートを返すために使用され、charは文字を返します。 voidとは、関数が値を返さないことを意味します。ポインタータイプはメモリアドレスを返し、メモリの漏れを避けるように注意してください。構造またはコンソーシアムは、複数の関連データを返すことができます。

C言語関数の概念

Apr 03, 2025 pm 10:09 PM

C言語関数の概念

Apr 03, 2025 pm 10:09 PM

C言語関数は再利用可能なコードブロックです。彼らは入力を受け取り、操作を実行し、結果を返すことができます。これにより、再利用性が改善され、複雑さが軽減されます。関数の内部メカニズムには、パラメーターの渡し、関数の実行、および戻り値が含まれます。プロセス全体には、関数インラインなどの最適化が含まれます。単一の責任、少数のパラメーター、命名仕様、エラー処理の原則に従って、優れた関数が書かれています。関数と組み合わせたポインターは、外部変数値の変更など、より強力な関数を実現できます。関数ポインターは機能をパラメーターまたはストアアドレスとして渡し、機能への動的呼び出しを実装するために使用されます。機能