Google、SF映画が現実化しないように新たな「ロボットコード」を策定

DeepMind ロボット工学チームは最近、ロボットが実験室の外でより速く、より適切で、より安全な意思決定を行えるようにすることを目的とした 3 つの新しい開発を発表しました。その一例として、彼らは「ロボット コード」を通じてトレーニング データを収集するシステムを開発しました。これは、ロボットのオフィス アシスタントがユーザーのためにより多くのプリンタ用紙を取りに来る一方で、たまたま邪魔になった人間の同僚を攻撃することを回避できるようにするためです。この開発により、ロボットの効率と安全性がさらに向上します。

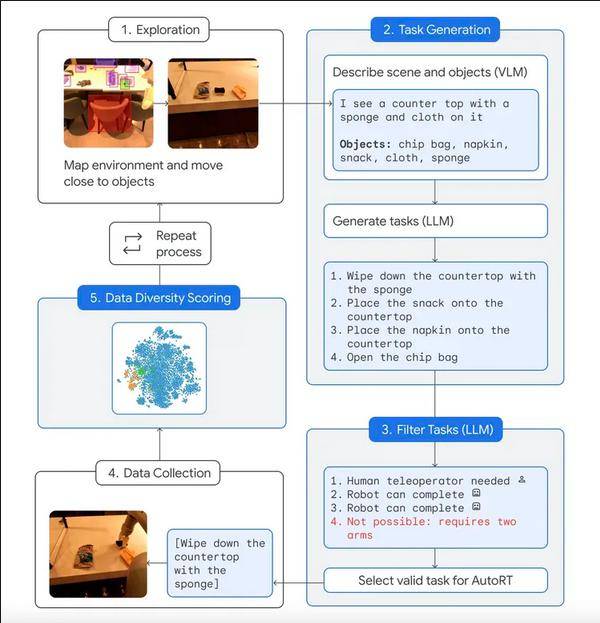

Google のデータ収集システムである AutoRT は、視覚言語モデル (VLM) と大規模言語モデル (LLM) を連携して利用して、環境を理解し、不慣れな状況に適応し、適切なタスクを決定します。このシステムの設計は、アシモフの「ロボット工学の 3 原則」に触発されています。これは、AI が人間、動物、鋭利な物体、さらには電化製品を含む選択を確実に回避するための、安全性を重視したガイドラインであると説明されています。ロボットの操作タスク。

安全性を向上させるために、DeepMind はロボットの関節に過剰な力がかかると自動的に動作を停止するようにロボットをプログラムしました。さらに、ロボットには物理的なキル スイッチが装備されており、人間のオペレーターがロボットを即座にシャットダウンできるようになります。 Google は 53 台の AutoRT ロボットを 7 か月間にわたって 4 つの異なるオフィスビルに導入し、77,000 件以上のトライアルを実施しました。ロボットの中には、人間のオペレーターによって遠隔制御されるものもあれば、スクリプトまたは Google の Robot Transformer (RT-2) AI 学習モデルに基づいて完全に自律的に動作するものもあります。このような安全対策と実験設計により、ロボットの安全性と制御性が確保されています。

実験に使用されたロボットは主に実用性を重視しており、カメラ、ロボットアーム、移動基地を備えていました。各ロボットは VLM (AI Visual Language Module) を使用して環境を認識し、物体を認識します。次に、LLM (AI Large Language Module) が、「カウンタートップにスナックを置く」などの一連の創造的なタスクの提案を提供し、ロボットが実行する適切なタスクを選択する意思決定者の役割を果たします。このシステム設計により、ロボットの知能レベルが向上し、さまざまなタスク要件によりよく適応できるようになります。

以上がGoogle、SF映画のプロットの現実化を回避するために新たな「ロボット仕様書」を作成の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。