最近、AI 対話アシスタントは言語タスクにおいて大幅な進歩を遂げています。この大幅な改善は、LLM の強力な汎化能力に基づくだけでなく、命令のチューニングにも起因すると考えられます。これには、多様で質の高い指導を通じて、さまざまなタスクに関して LLM を微調整することが含まれます。

命令チューニングでゼロショット パフォーマンスを達成できる潜在的な理由の 1 つは、コンテキストを内部化することです。これは、ユーザー入力が常識的なコンテキストをスキップする場合に特に重要です。命令チューニングを組み込むことで、LLM はユーザーの意図を高度に理解できるようになり、これまで目に見えなかったタスクでも優れたゼロショット機能を発揮します。

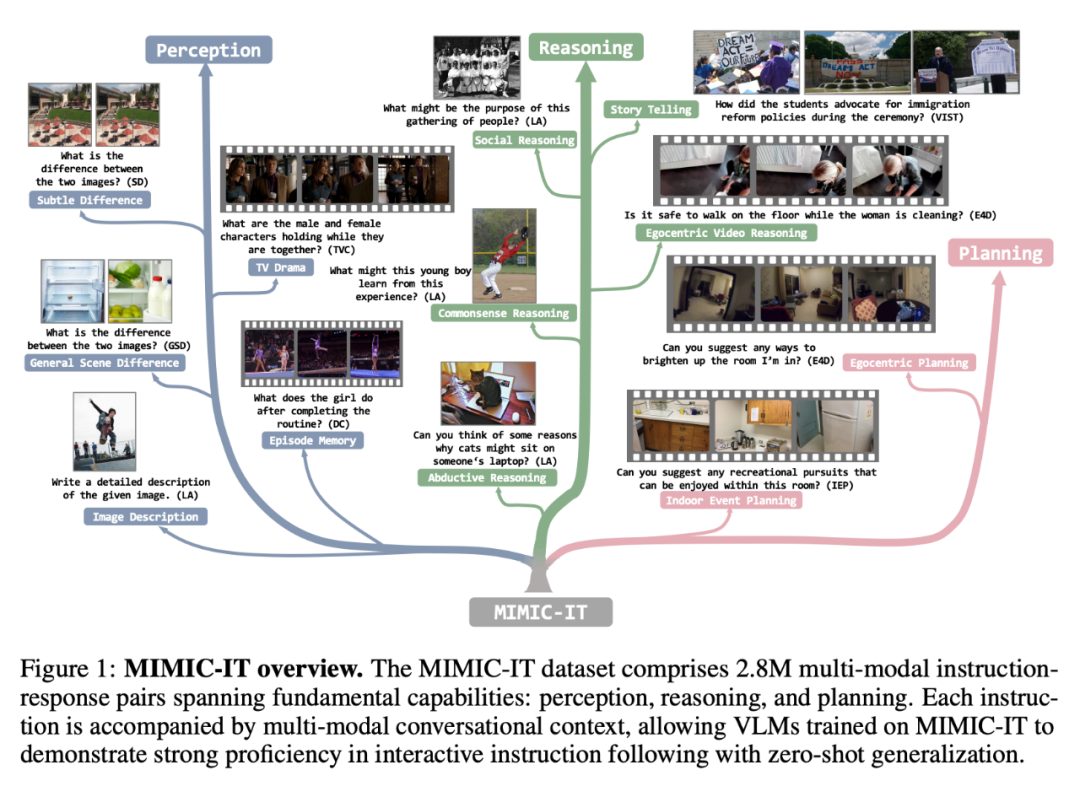

ただし、理想的な AI 会話アシスタントは、複数のモダリティが関係するタスクを解決できる必要があります。これには、データセットに従って多様で高品質なマルチモーダルな命令を取得する必要があります。たとえば、LLaVAInstruct-150K データセット (LLaVA としても知られています) は、一般的に使用される視覚的言語指示に従うデータセットであり、COCO 画像、画像キャプションおよび GPT-4 Constructed から取得したターゲット境界ボックスに基づく指示と応答を使用します。ただし、LLaVA-Instruct-150K には 3 つの制限があります: 視覚的多様性が制限されていること、単一の視覚データとして画像を使用していること、および言語形態のみを含む文脈情報です。

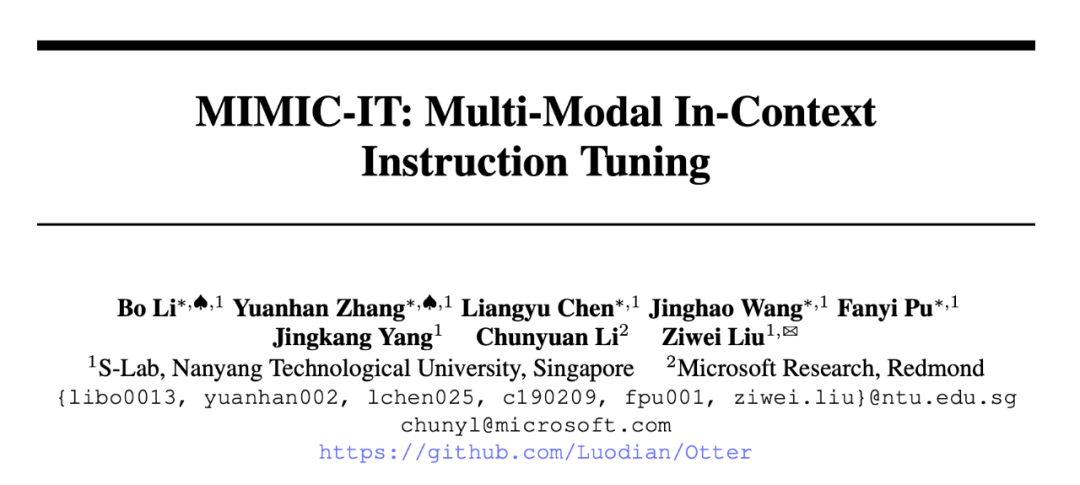

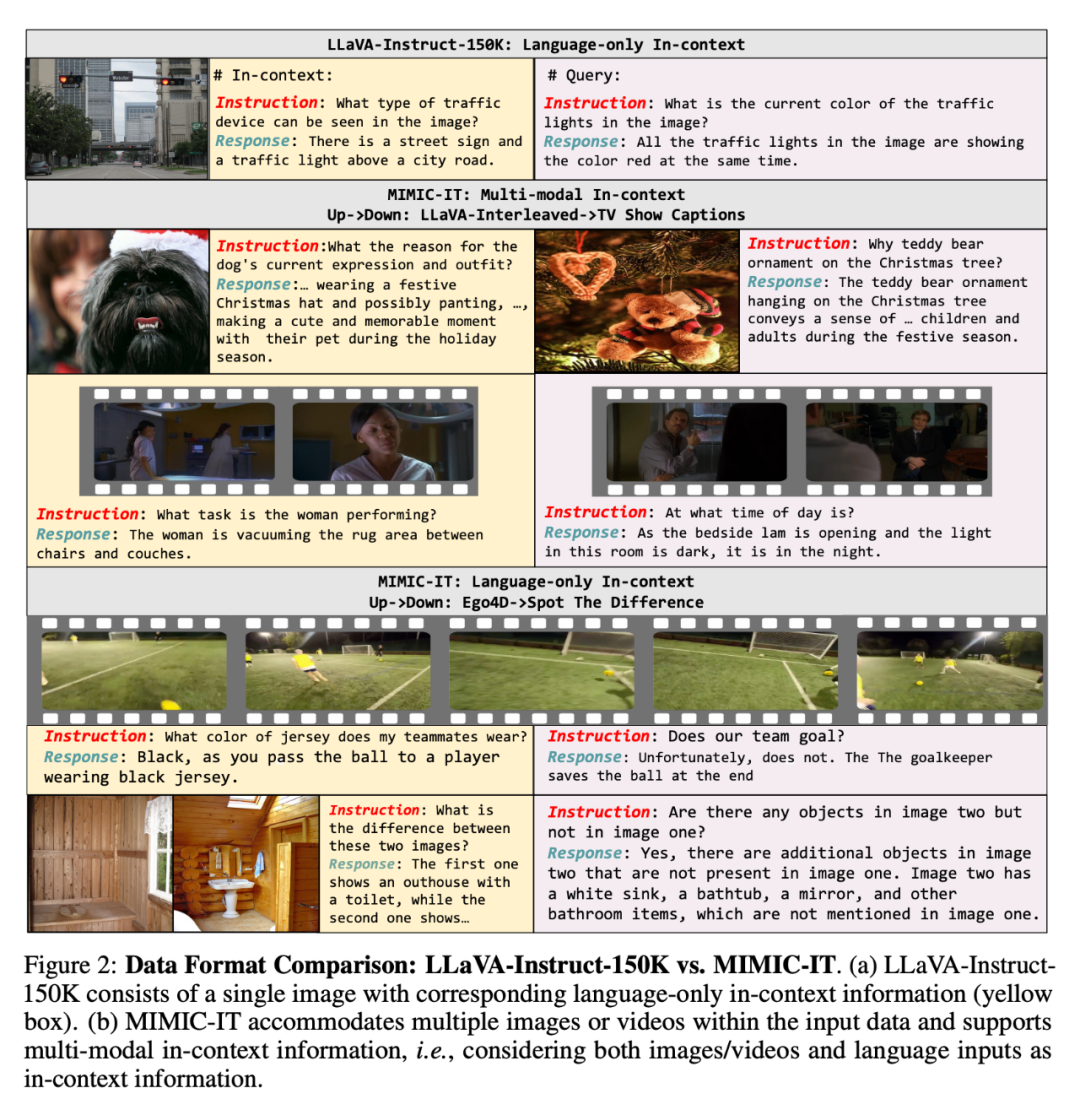

AI 対話アシスタントによるこれらの限界の突破を促進するために、シンガポールの南洋理工大学とレドモンドのマイクロソフト研究所の学者は、マルチモーダル コンテキスト命令チューニング データ セット MIMIC を提案しました。 IT は、さまざまな現実のシナリオをカバーする、280 万のマルチモーダル コンテキストの命令と応答のペアを含むデータセットです。

#論文アドレス: https://arxiv.org/pdf/2306.05425.pdf

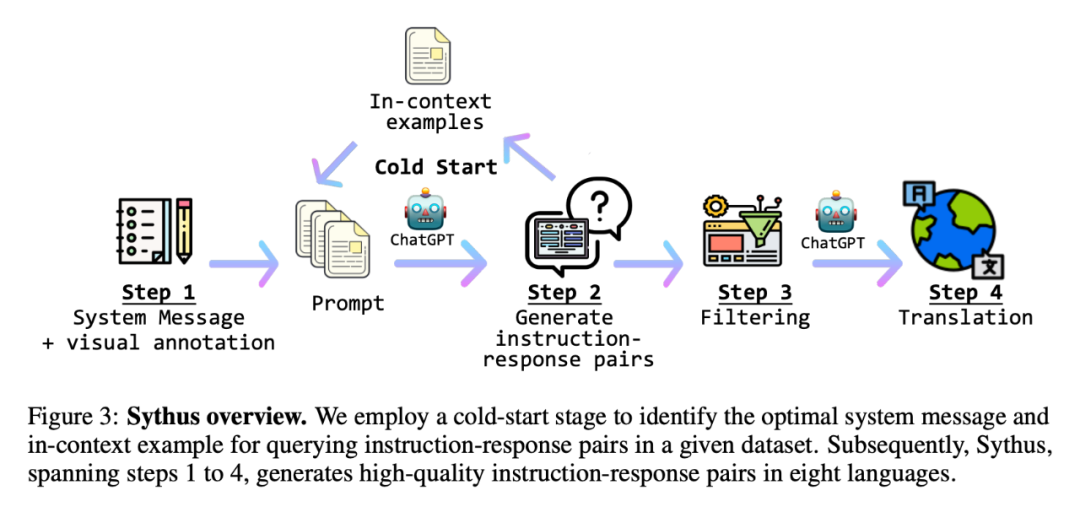

さらに、命令と応答のペアを効率的に生成するために、研究者らは、自己命令メソッドにヒントを得た命令と応答のアノテーションの自動パイプラインである「Sythus」も導入しました。 Sythus は、システム情報、視覚的な注釈、およびコンテキスト内の例を使用して、言語モデル (GPT-4 または ChatGPT) をガイドし、視覚的なコンテキストに基づいてコマンドと応答のペアを生成します。これは、視覚的言語モデルの 3 つの基本的な機能である知覚、推論、および視覚的なコンテキストに基づいて生成されます。計画中。さらに、英語のコマンドと応答は7か国語に翻訳され、多言語での使用をサポートします。

研究者らが OpenFlamingo に基づくマルチモーダル モデル「Otter」を MIMIC-IT 上でトレーニングしたことは特に注目に値します。 ChatGPT と人間の両方で評価された Otter のマルチモーダル機能は、他の最近の視覚言語モデルを上回っています。

研究者らは一連のデモで、Otter のマルチモーダルな質問と回答機能を実証しました。

Q: 次にプレイされるカードはどれですか? ?

#A: チューブは 8 本です。こうすることで、ストレートを待ち続けることができます。

#A: 左下のボタンを 1 回押して左に曲がり、着陸するときに右側のハンドブレーキを引きます。

#Q: 次に何をしますか?

#次に、研究の詳細を見てみましょう。

MIMIC-IT データセットには、認識、推論、計画といった基本的な機能をカバーする、280 万のマルチモーダルな命令と応答のペアが含まれています。各命令にはマルチモーダルな会話コンテキストが伴うため、MIMIC-IT でトレーニングされた VLM が対話型命令で優れた習熟度を示し、ゼロショット汎化を実行できるようになります。

LLaVA と比較した場合、MIMIC-IT の特徴は次のとおりです。

# (1) 一般的なシーン、自己中心的な視点シーン、屋内 RGB-D 画像など、さまざまなデータ セットからの画像やビデオを含む多様なビジュアル シーン;(2) 詳細画像 (またはビデオ)を視覚データとして;

(3) 複数のコマンドと応答のペアおよび複数の画像またはビデオを含むマルチモーダル コンテキスト情報;

(4) 英語、中国語、スペイン語、日本語、フランス語、ドイツ語、韓国語、アラビア語を含む 8 つの言語をサポートします。

#次の図は、この 2 つのコマンドと応答の比較を示しています (黄色のボックスは LLaVA)。

コア セットの品質はその後のデータ収集プロセスに影響を与えるため、研究者らはコールド スタート戦略を採用し、大規模なクエリを実行する前にコンテキスト内のサンプルを強化しました。コールド スタート フェーズでは、ヒューリスティックなアプローチが採用され、ChatGPT がシステム情報と視覚的な注釈を通じてのみコンテキスト内でサンプルを収集するように指示されます。このフェーズは、満足のいくコンテキスト内のサンプルが特定された後にのみ終了します。 4 番目のステップでは、コマンドと応答のペアが取得されると、パイプラインはそれらを中国語 (zh)、日本語 (ja)、スペイン語 (es)、ドイツ語 (de)、フランス語 (fr)、韓国語 (ko)、およびアラビア語に展開します。 (ar)。詳細については付録 C を、特定のタスク プロンプトについては付録 D を参照してください。

実験的評価

実験的評価

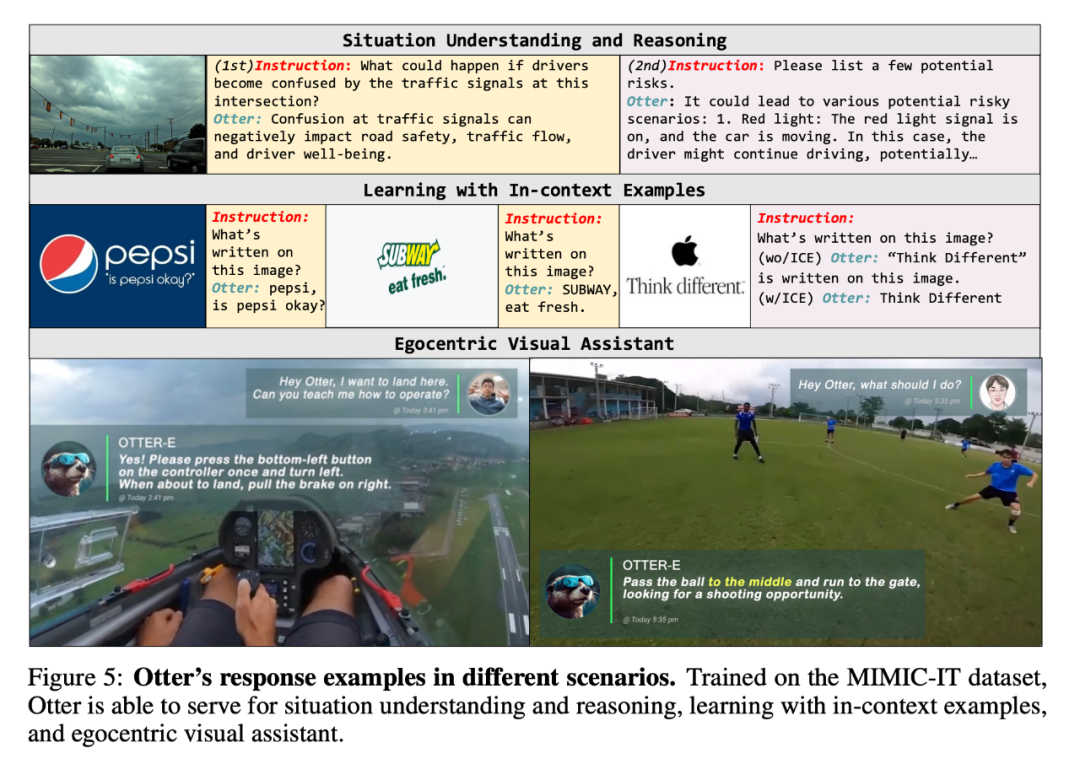

図 5 は、さまざまなシナリオにおける Otter の応答の例です。 MIMIC-IT データセットでのトレーニングのおかげで、Otter は状況の理解と推論、状況に応じたサンプル学習、自己中心的な視覚アシスタントを提供できます。

最後に、研究者らは一連のベンチマーク テストで Otter と他の VLM のパフォーマンスの比較分析を実施しました。

ChatGPT の評価

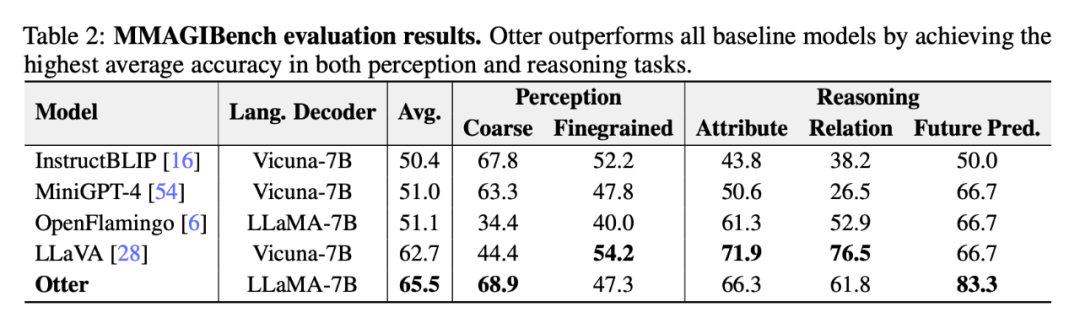

以下の表 2 は、MMAGIBench フレームワークを使用した視覚言語モデルの研究者による評価を示しています [43] 】 知覚力と推論力が幅広く評価されます。

##人間評価

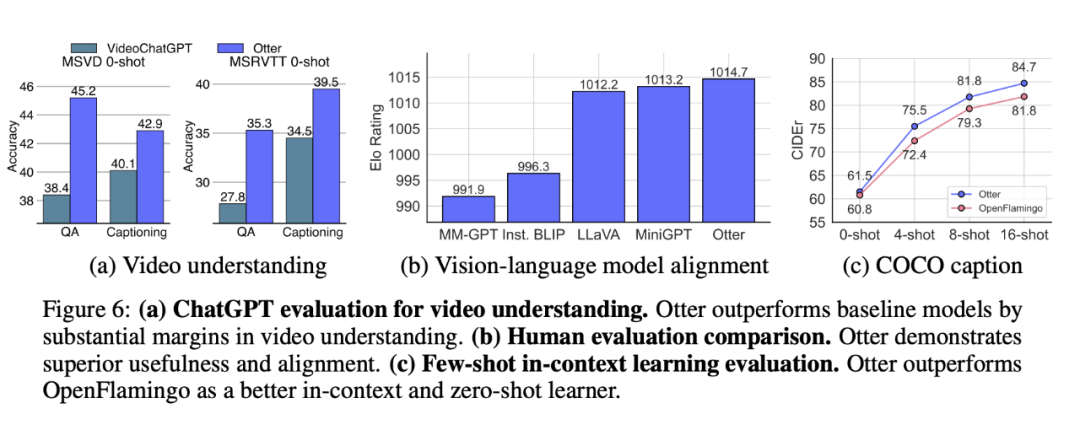

マルチモダリティアリーナ[32] は、Elo 評価システムを使用して、VLM 応答の有用性と一貫性を評価しています。図 6(b) は、Otter が優れた実用性と一貫性を示し、最近の VLM で最高の Elo 評価を達成していることを示しています。

少数ショットの文脈学習ベンチマーク評価

Otter は、マルチモデルである OpenFlamingo に基づいて微調整されています動的なコンテキスト学習のために設計されたアーキテクチャ。 MIMIC-IT データセットを使用して微調整した後、Otter は COCO Captioning (CIDEr) [27] の数ショット評価で OpenFlamingo を大幅に上回りました (図 6 (c) を参照)。予想どおり、微調整により、ゼロサンプル評価のパフォーマンスもわずかに向上します。

# 図 6: ChatGPT ビデオ理解の評価。 欠陥について話し合う。研究者たちはシステム メッセージとコマンド応答の例を繰り返し改善してきましたが、ChatGPT は言語幻覚を起こしやすいため、誤った応答を生成する可能性があります。多くの場合、より信頼性の高い言語モデルには自己指示データ生成が必要です。

将来の仕事。将来的には、研究者らは、LanguageTable や SayCan など、より具体的な AI データセットをサポートする予定です。研究者らは、命令セットを改善するために、より信頼できる言語モデルや生成技術を使用することも検討しています。

以上が8 つの言語で共通の 280 万のマルチモーダル コマンドと応答のペア、ビデオ コンテンツをカバーする初のコマンド データ セット MIMIC-IT が登場の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。