人工知能と未成年者保護の発展

強力な生成人工知能の急速な発展に応えて、ユネスコは今年 5 月 25 日にこのテーマに関する初の世界教育大臣会議を開催しました。生成人工知能の前例のない開発の機会とリスクと課題を包括的かつ客観的に分析することは、未成年者の健全な成長を確保するための時代の緊急の課題であり、未成年者の保護と育成を実施する上で重要な部分でもあります。

原文: 「生成型人工知能の到来、未成年者を守る方法」

著者 | 北京師範大学ジャーナリズム・コミュニケーション学部 Fang Zengquan/研究員 Yuan Ying/講師 Qi Xuejing/研究助手

写真 |ネットワーク

生成人工知能 (AIGC) は、2022 年の科学的進歩のトップ 10 にランクされます。この結果は「サイエンス」誌に掲載されました。生成人工知能は強力な論理的推論と再学習能力を示し、人間のニーズをよりよく理解し、自然言語処理のボトルネックを突破し、社会的知識生産システム、人材育成システム、ビジネスモデル、社会的分業システムを再構築します。などは、社会のあらゆる分野に大きな発展の機会をもたらしましたが、同時に深刻なリスクにも直面しています。現在、未成年者はさまざまな方法で人工知能テクノロジーと交流しており、これらのテクノロジーはおもちゃ、アプリケーション、ビデオゲームに組み込まれていることが多く、知らず知らずのうちに未成年者の健全な成長に影響を与えています。未成年者の心と認知能力はまだ成熟していないため、知的環境の影響を受けやすいです。したがって、生成人工知能の前例のない開発の機会とリスクと課題を包括的かつ客観的に分析することは、未成年者の健全な成長を確保するための時代の緊急の課題であり、未成年者の保護と育成を実施する上で重要な部分でもあります。

生成人工知能によってもたらされる機会と課題

開発の機会の観点から見ると、人工知能テクノロジーは未成年者を教育の学習に導くためのツールであり、生成人工知能テクノロジーに依存することで、教育はより的を絞った効果的なものになります。生成型人工知能は、教育における個人差や地域格差を埋め、教育資源における普遍的な公平性を促進し、個人と地域の間のデジタル格差をある程度まで縮小することができます。生成人工知能は、未成年者の革新的かつ創造的な能力の向上も促進します。大規模モデルの登場により、ローコード開発ツールやノーコード開発ツールの利用の敷居がさらに下がり、新たなインテリジェント開発技術の誕生を引き起こす可能性があります。

未成年者は、生成型人工知能の影響を受けるため、認知能力、思考能力、行動能力において課題に直面することになります。 1つ目は、誤った情報の蔓延です。事実の精度を継続的に向上させるには、緊急の技術的進歩が必要です。 2つ目は情報漏えいの問題です。現在、データ漏洩により、一部のユーザーの会話データと関連情報が失われています。特に、生成型人工知能アプリケーションには現在、ユーザーの年齢を体系的に検証する設計が欠けており、未成年者が「年齢や意識にまったく不釣り合いな」コンテンツにさらされ、身体的および精神的に悪影響を及ぼす可能性があることに注意することが重要です。健康。 3 つ目は、埋め込まれたアルゴリズムによる差別の問題です。生成人工知能によって与えられる回答の中には性差別的で人種差別的なものもあり、ユーザーが差別的な回答を「正解」と誤解し、誤った判断をしてしまう可能性があり、社会的認知や倫理に悪影響を与える可能性があります。特にアルゴリズムの包括性の問題を扱う場合、中国文化と西洋文化の起源と進化の経路が異なるため、伝統文化と現実観察の間の解釈、評価、普及の問題も含まれ、これらはすべて人工生成において役割を果たす可能性があります。テクノロジーにおいて無視されるか、意図的に増幅される知能。 4つ目は、知的財産侵害の問題です。画像であっても大きなテキストモデルであっても、実際には多くの著作権関連のリスクや潜在的な危険性が存在しており、学習データは報道機関やフォトギャラリー販売者の権利利益など、他者の著作権を侵害する可能性があります。 AI が生成した楽曲、記事、その他の作品に作品が使用されているコンテンツ作成者にどのように報酬を与えるかについて、特に適切な解決策は現時点ではありません。オリジナル作成者の著作権を確保することが困難な場合、人工知能コンテンツ エコシステムの持続的かつ健全な発展が損なわれます。第五に、デジタルデバイドの問題です。英語と中国語では大規模な言語モデルのパフォーマンスに大きな違いがあり、ライティング、表現、理解能力は一般的に英語のコンテキストの方が優れていることは明らかです。中国語と英語の違いとデータのマシュー効果が相まって、その差はさらに広がる可能性があります。 6番目に、ネットワークセキュリティのリスクです。これには、自傷行為を示唆または奨励するグラフィック素材、ポルノまたは暴力的なコンテンツ、嫌がらせ、軽蔑的、憎悪に満ちたコンテンツが含まれますが、これらに限定されません。

生成型人工知能のための CI-STEP システム

2020年9月、ユニセフは「子どものための人工知能 - 政策ガイドライン」の草案を発表し、子どもに優しい人工知能が従うべき3大原則を提案した:保護、つまり「危害を加えない」、エンパワーメントとは「」良いことをしている」; 参加は「包含」を意味します。 2021 年 11 月、ユニセフは「子どもの権利を守るための AI 政策とシステムの確立に関する勧告 2.0」を発表し、子どもの権利を守るための AI の 3 つの基盤を提案しました: 人工知能の政策とシステムは子どもを守るように設計されるべきである; 子どものニーズと権利は子どもたちは AI の開発と使用に貢献する権限を与えられるべきです。世界中で議論されている注目のテーマは、AI テクノロジーを使用して、現在および将来の未成年者の成長に有益な環境を作り出す方法です。その直後、中国、米国、欧州連合、英国も、未成年者向けの人工知能技術の管理をさらに標準化し、改善するために関連する法律や規制を相次いで導入した。

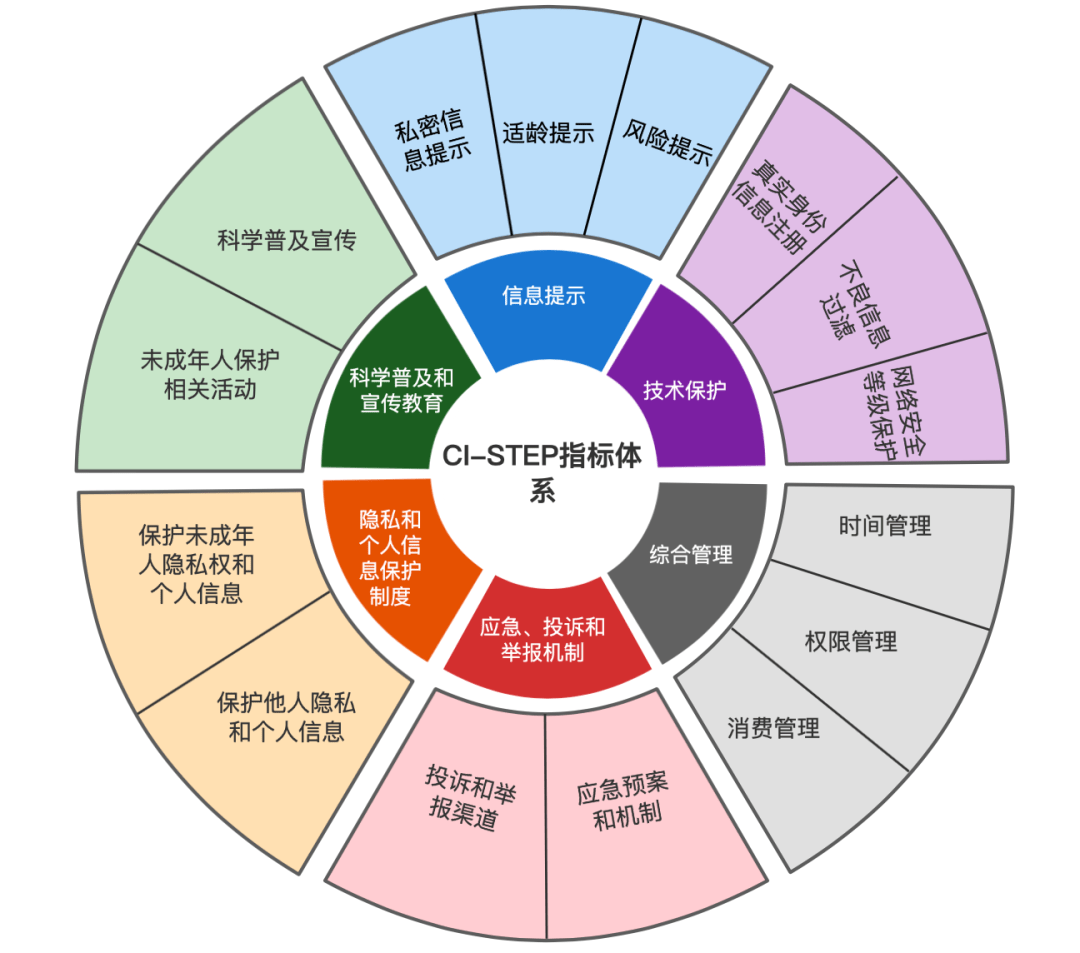

児童の知的発達に関するピアジェの段階理論と道徳的発達に関するコールバーグの段階理論に基づき、我が国の関連法および政策 - 「中華人民共和国の個人情報保護法」および「中華人民共和国のネットワークセキュリティ法」を組み合わせたもの「中国のデータセキュリティ法」などのほか、米国、欧州連合、英国などの国や地域の関連政策文書を、未成年者インターネットリテラシー研究センターが公開しています。北京師範大学ジャーナリズム・コミュニケーション学院は、国内初の未成年者向け生成人工知能を発表 保護開発評価(CI-STEP)指標システムは、生成人工知能における未成年者保護のための重要な参考指標と評価指標を提供する(下図を参照) )。

生成的人工知能による未成年者の保護と開発の評価 (CI-STEP) 指標システム

この指標モデルには、具体的には、総合管理、情報キュー、科学普及・広報教育、技術的保護、緊急苦情メカニズムおよび報告メカニズム)、プライバシーおよび個人情報保護システム(プライバシーおよび個人情報保護システム)の各次元が含まれます。未成年者の権利と利益を保護するための科学的情報、包括的な評価概念および実践的なガイダンスを提供するために、2 ~ 3 つの具体的な指標、合計 15 の評価指標が含まれています。

1 つ目は、時間管理、権限管理、消費管理などの総合的な管理です。時間管理とは、未成年者の社会的交流、シナリオ、用途などに基づいて合理的かつ適切なオンライン時間を決定し、依存症対策要件を実装することです。権限管理とは、年齢を確認するための検証メカニズムを設定し、システムによって設定されたセキュリティ ルールまたはセキュリティ ポリシーに従って、未成年者がアクセスできる、または許可されたリソースのみにアクセスできるようにすることです。消費管理は、不当で欺瞞的な商行為を禁止し、偏見と欺瞞を制限するために必要な保護措置を講じ、企業、消費者、公共の安全に対する重大なリスクを回避する生成型人工知能製品またはサービスです。

2 番目は、個人情報のプロンプト、年齢に応じたプロンプト、リスクのプロンプトなどの情報プロンプトです。未成年者がインターネットを通じて個人情報を公開した場合は、速やかに警告を発し、必要な保護措置を講じる必要があります。年齢に応じたリマインダーとは、生成人工知能製品またはサービスのプロバイダーが、関連する国の規制や基準に従って人工知能製品を分類し、年齢に応じたリマインダーを作成し、未成年者が不適切な製品やサービスにさらされるのを防ぐための技術的措置を講じる必要があることを意味します。一部の生成人工知能プロバイダーは、AI ツールを使用する前にユーザーが 18 歳以上、または保護者の同意を得て 13 歳以上であることを要求していますが、現在の検証オプションと実装メカニズムは改善する必要があります。リスク警告とは、生成人工知能製品またはサービスが法律や規制の要件を遵守し、社会倫理、公序良俗を尊重し、詐欺、テロ、いじめ、暴力、ポルノ、偏見などの違法なコンテンツの可能性について警告を提供する必要があることを意味します。 、差別、誘導情報。

3つ目は、科学の普及と広報と教育です。生成型人工知能製品またはサービスのプロバイダーはテクノロジーにおいて主導的な立場にあり、未成年者に関連するテーマ教育、社会慣行、職業経験、インターンシップ検査などをサポートし、業界の特性に基づいて未成年者への科学的普及を組織する必要があります。そして革新的な実践活動。

4 番目のポイントは、実際の身元情報の登録、不正な情報のフィルタリング、ネットワークのセキュリティ レベルの保護などの技術的保証に関するものです。 「中華人民共和国サイバーセキュリティ法」およびその他の関連規制に従って、ユーザーはシステムに本当の身元情報を提供する必要があります。生成型人工知能製品やサービスの提供者は、利用者が未成年者の心身の健康に害を及ぼす内容を含む情報を公開または流布したことを発見した場合、直ちに当該情報の流布を停止し、削除などの処分措置を講じなければなりません。 、ブロック、リンクの切断。生成型人工知能製品またはサービスのプロバイダーは、ネットワーク セキュリティ レベル保護システムの要件に従ってセキュリティ保護義務を実行し、ネットワークを干渉、破壊、不正アクセスから保護し、ネットワーク データの漏洩、盗難、改ざんを防止する必要があります。

5 番目は、緊急苦情および報告メカニズムです。生成型人工知能製品またはサービスの提供者は、ユーザーからの苦情を受け付けて処理する仕組みを確立し、苦情や報告方法などの情報を開示し、個人情報の修正、削除、ブロックの要求に迅速に対応し、緊急時対応計画を策定する必要があります。システムの脆弱性、コンピュータ ウイルス、ネットワーク攻撃、ネットワーク侵入、データ ポイズニング、プロンプト ワード インジェクション攻撃、その他のセキュリティ リスク、ネットワーク セキュリティを脅かすインシデントが発生した場合、ただちに緊急計画を発動し、対応する是正措置を講じます。

6つ目はプライバシー・個人情報保護体制です。生成型人工知能製品またはサービスのプロバイダーは、個人情報の収集と使用、個人情報と個人の権利の保護方法、未成年者の個人情報の取り扱い方法、個人情報の世界的な転送方法、および更新方法に関するルールを明確にする必要があります。プライバシーポリシー。生成 AI 製品またはサービスのプロバイダーは、サービスの販売、ユーザー プロファイルの宣伝や構築、可能な場合はトレーニング データ セットから個人情報の削除、個人情報の要求を拒否するためにモデルを微調整すること、およびパブリシティ権や評判への損害を防ぐためにデータを使用してはなりません。個人情報およびプライバシーの不正な取得、開示、使用は禁止されています。

私たちは将来、保護と開発にも同様の注意を払わなければなりません

生成型人工知能と未成年者の保護という重要な問題について、私たちは「子ども中心」、「子どもの権利の保護」、「責任を取る」という概念に基づいて、保護と発達に同等の注意を払うことを主張しなければなりません。現状では、生成型人工知能は未成年者の発展の新たな原動力となり、人工知能時代における未成年者の包括的かつ健全な成長の実現に貢献します。善のためのテクノロジーの概念の指導の下、生成型人工知能テクノロジーの開発は、未成年者にとって最も有益であるという原則を遵守し、ネットワークセキュリティと未成年者のデジタル開発を考慮し、AIテクノロジーの応用に焦点を当てる必要があります。科学的および技術的倫理に沿って、インターネット企業が業界の共同統治に積極的に参加することを奨励します。

将来の生成人工知能の応用では、4 つの主要な問題に焦点を当てる必要があります。まず、技術基準を導入します。将来的には、生成人工知能における未成年者の保護と開発は、企業の研究開発活動の監督、生成人工知能の監督と介入、人工知能モデルの開発とリリースのための承認とテストの要件の提示に焦点を当てる必要があります。第二に、評価義務を明確にすること。生成型人工知能製品の適用における研究開発機関とネットワークプラットフォーム事業者のセキュリティリスク評価義務を明確にし、研究開発機関とネットワークプラットフォーム事業者がそのような製品を市場に出す前にセキュリティリスク評価を実施することを保証する必要があります。リスクはコントロール可能です。第三に、コンテンツのリスクに焦点を当てます。規制当局とネットワークプラットフォーム運営者は、規制技術をさらに改善し、複数の関係者が関連する生成人工知能製品の開発と宣伝に参加することを奨励し、それによって生成人工知能技術によって生成されるコンテンツを標準化する必要があります。 4番目に、AIリテラシー育成エコシステムを構築します。未成年者の認知・感情・行動能力の発達の段階的特性に応じて、初等中等基礎教育を柱とする義務教育段階における「情報技術」等の授業内容及び指導方法の革新を強化する。主な立場は、政府主導、学術、企業の形成です。共同構築された人工知能公共サービスプラットフォームは、人工知能リテラシー教育と革新的な実践活動を促進し、質の高い教育リソースのバランスの取れた共有を促進し、デジタル格差と不平等の悪化を回避します。 、より包括的で公平かつオープンな教育環境を作り出します。

この記事は、ソーシャル サイエンス ジャーナルの「イデオロギー ワークショップ」フュージョン メディアのオリジナル製品です。元々はソーシャル サイエンス ジャーナルの 1857 号の 2 ページに掲載されました。許可なく転載することは禁止されています。記事の内容は著者の見解のみを表しています。は意見であり、本紙の立場を代表するものではありません。

この号の担当編集者: 王立耀

多読読書

タレントパワー | 人工知能時代: 「学習者中心の精密教育」

信頼できる人工知能開発メカニズムの確立 | 社会科学ジャーナル

以上が生成型人工知能の到来、未成年者をどう守るか? | 社会科学ジャーナルの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。