今日、Google が「私たちには堀はなく、OpenAI にもありません。」という文書をリークしたという記事を目にしました。この文書には、オープンソース AI に関する特定の Google 従業員 (Google 以外の企業) の見解が記載されています。その見解は次のとおりです。非常に興味深いです、大まかに言うと、これが意味するのは次のとおりです:

ChatGPT が普及した後、すべての大手メーカーが LLM に群がり、狂ったように投資を行っています。

Googleも復活を目指して懸命に取り組んでいるが、サードパーティがこの大きなケーキを黙って食べているため、この軍拡競争には誰も勝てない。

このサードパーティは大規模なオープンソース モデルです。

オープンソースの大規模モデルではこれがすでに行われています:

1. 基本モデルを Pixel 6 上で 1 秒あたり 5 トークンの速度で実行します。

2. PC 上でパーソナライズされた AI を一晩で微調整できます:

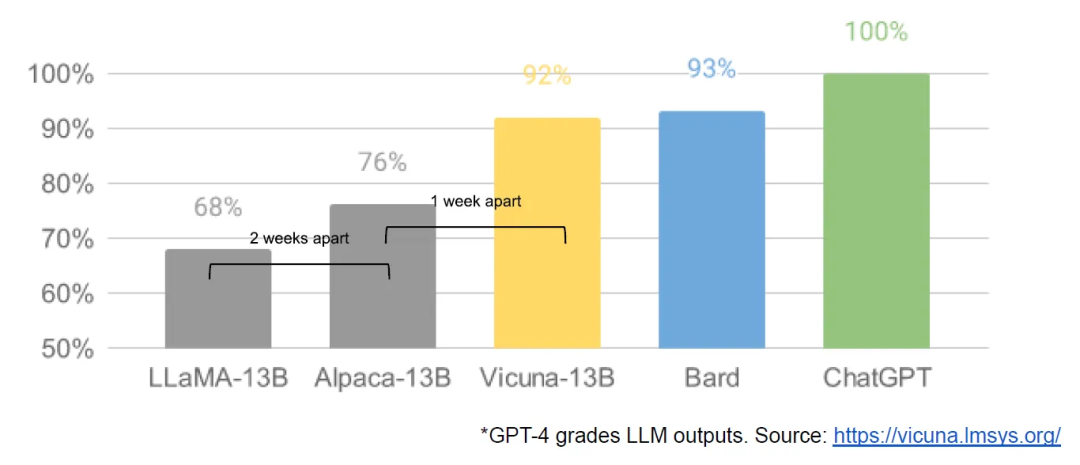

OpenAI と Google のモデルには品質の点で利点がありますが、ギャップは次のとおりです。驚くべき速度で閉鎖されています:

オープン ソース モデルは、より高速で、カスタマイズ可能で、よりプライベートで、より強力です。

オープンソースの大規模モデルは、処理に 100 ドルと 130 億のパラメータを使用し、数週間以内に完了しますが、Google は数か月以内に 1000 万ドルと 5,400 億のパラメータに苦労しています。

無料で制限のない代替手段がクローズド モデルと同じくらい優れている場合、人々は間違いなくクローズド モデルを放棄するでしょう。

すべては、Facebook が LLaMA をオープンソース化したときに始まりました。3 月初旬、オープンソース コミュニティは、この本当に有能な基本モデルを入手しました。説明、会話のチューニング、RLHF はありませんでしたが、コミュニティはすぐにこの重要性を認識しましたもの。 。

その後のイノベーションは、数日で測っても驚異的です:

2-24: Facebook が LLaMA を立ち上げますが、現時点では研究機関にのみライセンスが供与され、政府機関によって使用されています

3-03: LLaMA がインターネット上に流出し、商用利用は禁止されていましたが、突然誰でもプレイできるようになりました。

3-12: Raspberry Pi で LLaMA を実行するのは非常に遅く、非現実的です

3-13: スタンフォード大学が Alpaca をリリースし、LLaMA 用の命令チューニングを追加しました。これはさらに「恐ろしい」ものです はい、エリックスタンフォード大学の J. Wang 氏は、RTX 4090 グラフィックス カードを使用して、Alpaca と同等のモデルをわずか 5 時間でトレーニングし、そのようなモデルの計算能力要件を消費者レベルまで削減しました。

3-18: 5 日後、Georgi Gerganov は 4 ビット量子化テクノロジーを使用して、初の「GPU レス」ソリューションである LLaMA を MacBook CPU 上で実行しました。

3-19: わずか 1 日後、カリフォルニア大学バークレー校、CMU、スタンフォード大学、カリフォルニア大学サンディエゴ校の研究者が共同で Vicuna を立ち上げ、90% 以上の達成率を達成したと主張しています。 OpenAI ChatGPT と Google Bard の品質は高く、90% 以上のケースで LLaMA や Stanford Alpaca などの他のモデルよりも優れています。

3-25: Nomic は、モデルでありエコシステムでもある GPT4all を作成しました。複数のモデルが 1 か所に集まっているのは初めてです

…

In just 1 か月で、命令チューニング、量子化、品質向上、ヒューマン評価、マルチモダリティ、RLHF などがすべて登場しました。

さらに重要なのは、オープンソース コミュニティによってスケーラビリティの問題が解決され、トレーニングの敷居が大企業から 1 人、一晩、強力なパーソナル コンピューターに引き下げられたことです。

つまり、著者は最後にこう言いました。OpenAI も私たちと同じ間違いを犯したので、オープンソースの影響に耐えることはできません。オープンソースを Google で機能させるにはエコシステムを構築する必要があります。

Google はこのパラダイムを Android と Chrome に適用し、大きな成功を収めました。大規模モデルのオープンソースのリーダーとしての地位を確立し、思想的リーダーおよびリーダーとしての地位を確固たるものにし続ける必要があります。

正直に言うと、ここ 1 か月ほどの大規模な言語モデルの開発は本当に目まぐるしく圧倒され、毎日衝撃を受けています。

これを聞くと、インターネットが始まったばかりの初期の頃を思い出します。今日、あるエキサイティングな Web サイトが現れ、明日にはまた別の Web サイトが現れます。そして、モバイル インターネットが勃発すると、今日あるアプリが人気になり、明日には別のアプリが人気になる...

個人的には、これらの大きな言語モデルが巨人によって制御されることは望ましくありません。私たちができるのは、これらの巨大なモデルに「寄生」し、その API を呼び出し、いくつかのアプリケーションを開発することだけです。これは非常に不快です。百の花を咲かせ、大衆がアクセスできるようにして、誰もが自分のプライベートモデルを構築できるようにするのが最善です。

現在、中小企業でも研修費用は手頃な価格になっているはずですが、プログラマーに研修能力があれば、特定の業界や分野と組み合わせる良い機会になるかもしれません。

プログラマーが大規模な民営化モデルに習熟したい場合は、原則に加えて、やはり自分で練習する必要があります。また、地球上にはチームで練習している人が何十人もいます。コミュニティのコストは大幅に下がったが、それでも必要なモデルをトレーニングしたいが、ハードウェア環境要件が高すぎる グラフィックカードが非常に高価である RTX4090 は数万かかるのが痛い GPU のレンタル料金クラウドでのトレーニングはさらに制御不能です。トレーニングが失敗するとお金が失われます。無駄に捨ててください。言語やフレームワークを学習していくつかのインストール パッケージをダウンロードするのとは異なります。費用はほぼゼロです。

もっと敷居が下がってくれると嬉しいです!

以上がGoogle の内部文書が流出: オープンソースの大規模モデルは怖すぎて、OpenAI も耐えられない!の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。