最近、スタンフォード HAI 研究所とスタンフォード規制・評価・ガバナンス研究所は共同で、米国の進歩を体系的に評価した白書「米国人工知能戦略の 3 本柱の実装課題」を発表しました。人工知能の状態。

ホワイト ペーパーは主に、AI イノベーションと信頼できる AI の 3 つの柱に焦点を当てています:

1. 2020 年政府法における人工知能》;

2.「人工知能のリーダーシップ」に関する大統領令;

3.「政府における人工知能」に関する大統領令。

まとめると、これらの大統領令と政府における人工知能法は、米国の人工知能に関する国家戦略を確実にするために重要です。次の 10 年に向けて、世界の他の国々の競争上の優位性を実現します。」

著者は、200 以上の連邦機関における各要件の実施状況を包括的に調査した結果、米国は人工知能のイノベーションにおいて多くの進歩を遂げてきたものの、同時に課題にも直面していることを発見しました。特定の問題があります:

人工知能 (AI) の変革の可能性は、議論の余地のない事実です。

「第 4 次産業革命」または「デジタル革命の第 3 波」を活用するために、各国は官民部門の再構築と研究開発 (R&D) への資金提供の取り組みを優先しています。 ). )、AI イノベーションを解き放つ構造とポリシーを作成します。

米国では、ホワイトハウスと議会が研究開発への投資を増やし、国家AIを通じてAI関連リソースへの公平なアクセスを増やす方法を模索することで、AIのイノベーションとその信頼できる展開を推進しています。全国の国立人工知能研究所に資金を提供し、CHIPSと科学法を通じて国内の半導体製造と「将来の産業」に2,800億ドルを振り向け、ホワイトハウスの国家人工知能イニシアチブ事務局でAI政策を調整するメカニズム。 。

人工知能リーダーシップ命令は、米国のすべての部門にわたる技術的ブレークスルーの推進を目指していますが、他の 2 つの取り組みは、連邦政府による人工知能の使用に焦点を当てます。

大統領令 13859

人工知能リーダーシップ命令は、「連邦政府の情報を一元化する」ためにアメリカ人工知能イニシアチブを立ち上げました。 「アメリカの繁栄を増大させ、アメリカの国家と経済の安全を強化し、アメリカ国民の生活の質を向上させるために、人工知能を開発するためのリソースを提供する。」

具体的には、連邦政府のAIの研究開発、AI関連のデータとリソース、規制上の指針と技術基準、AI労働力、AIに対する国民の信頼、国際的な関与を重視する多角的なアプローチを通じて、AIにおける米国のリーダーシップを構築する取り組み。政策基盤と地位に必要な人材。

さらに、「調整された連邦政府の戦略」が必要であり、AIは「ほぼすべての行政部門および政府機関の使命に影響を与えるだろう」と述べ、AIの指導命令により、政府機関が追求する権限がさらに強化されました。 「米国の人工知能の進歩を促進し保護する」ための 6 つの関連戦略目標。

#大統領令 13960

政府における人工知能に関する命令は、連邦政府機関に対し、「政府業務を改善するための人工知能の可能性」を活用するよう指示しています。 「AI の継続的な採用と受け入れは国民の信頼に大きく依存する」ことを認識し、AI 政府命令では連邦政府機関が AI の設計、開発、取得、使用の際に実装すべき 9 つの原則を明記しています。

これらの原則は、人工知能が (a) 合法的であること、(b) パフォーマンス主導型であること、(c) 正確で信頼性があり効果的であること、(d) 安全で信頼性があり回復力があること、 (e) 理解可能、(f) 説明責任があり追跡可能、(g) 定期的に監視され、(h) 透明性があり、(i) 説明責任があります。

##2020 年政府法における人工知能

この法律は「」を試みています。 「連邦政府機関にリソースとガイダンスを提供することで、連邦政府全体での人工知能の使用が効果的、倫理的、責任あるものになるようにする。」これには、政府機関の使用、調達、人工知能のインテリジェント バイアス評価、緩和は正式なガイダンスを提供し、一般調達局 (GSA) 内に政府による人工知能の導入をサポートする卓越したセンターを創設します。

著者は 2 つの大統領令と政府における人工知能法をそれぞれ研究しました。各部局の規定によります。

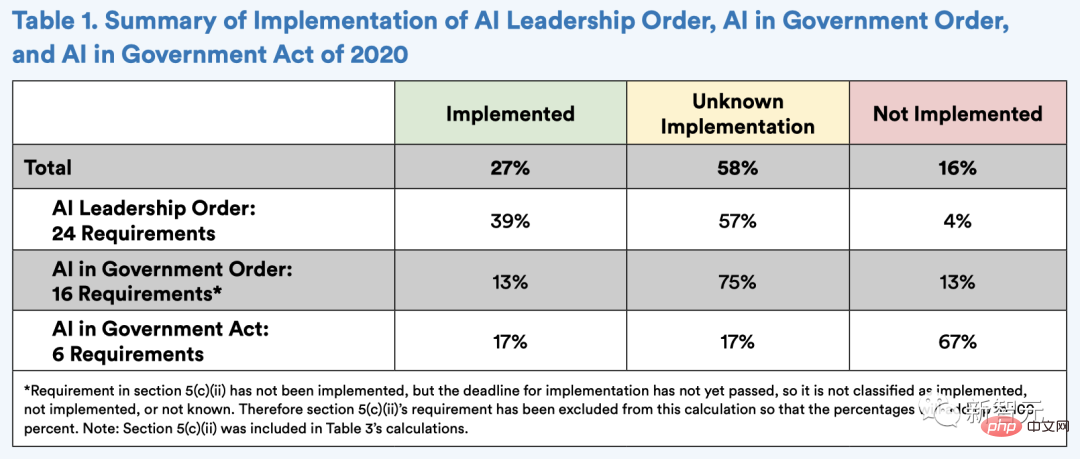

上記 2 つの大統領令と 2020 年政府における人工知能法において、著者らは 45 要件のうち 11 要件 (約 27%) が実装されていることを発見しました。

しかし、45 件の要件のうち 7 件 (16%) は期限までに実装されず、残りの 26 件の要件 (58%) は完全に実装されているかどうか確認できませんでした。実装されました。

同様に、すでに実装されている要件のうち、具体的な実装状況も不明です。これには、AI 研究開発のためにデータとソース コードをよりアクセスしやすくする取り組み、新しい AI 関連の教育および労働力開発プログラムをより効果的に活用して作成する取り組み、信頼できる AI をさらに実装するために政府機関の全面的な関与を確保する取り組みが含まれます。

政府法の 4 つの期限要件のいずれも実装されていません:

これまでに実施された対策のうち、多くは予定より遅れています。たとえば、国家科学技術会議 (NSTC) の人工知能に関する特別委員会は、クラウド コンピューティング テクノロジのより有効な活用に関する報告書を期限から 16 か月後に大統領に提出しました。

3. 政府機関の AI 計画上で述べたように、これらの大統領令と法案の重要な焦点は、「人工知能技術の利用を促進するための障壁を減らす」ことです。市民の自由、プライバシー、アメリカの価値観、アメリカの経済と国家安全保障を守りながら、その革新的な応用」を目指しています。

したがって、これらの法令は、人工知能を規制する適切な役割の見直しを強調し、「人工知能の革新と成長を不必要に妨げる規制的または非規制的な行為を回避する」ことを望んでいます。この目標を達成するには、次の 2 つの要求が重要です:

#1. 政府機関が人工知能をどのように規制すべきかに関するガイダンスを提供する覚書を政府機関の長に発行するよう OMB に要求します。

2. 「規制権限」を持つ政府機関に対し、OMB が提供するガイダンスとの「一貫性を達成する」ための計画 (「政府機関の人工知能計画」) を作成し、公表することを要求します。

2020 年 11 月 17 日、OMB は、人工知能アプリケーションの規制ガイダンスに関する行政部門および政府機関の長への覚書 (OMB M-21-06) を発行し、政府機関に「」を採用するよう求めました。アメリカの中核的価値観を守りながら、イノベーションと成長を促進し、信頼を生み出す規制アプローチ。」

この覚書では、人工知能に対するさまざまな機関の規制および非規制アプローチの指針となる、人工知能アプリケーションの管理に関する 10 の原則を概説しています。規制が不適切な場合の非規制アプローチと、AI の導入と使用に対する障壁を軽減するために政府機関がとるべき措置を推奨します。

政府機関は、2021 年 5 月 (人工知能リーダーシップ命令遵守の期限) までに計画を提出し、その計画を政府機関の Web サイトに公開する必要があります。

現在、評価対象となった 41 機関のうち、OMB AI 規制覚書が提供するテンプレートを使用して AI 計画を公開している機関は 5 機関 (13%) のみです。これらの機関には、エネルギー省 (DOE)、保健福祉省 (HHS)、退役軍人省 (VA)、さらに環境保護庁 (EPA) および米国国際開発庁 (USAID) があります。

残りの 36 機関は人工知能計画を発表していません。

政府における人工知能の義務は、連邦政府内での信頼できる人工知能の開発、導入、取得の促進に焦点を当てています。 。

そのために、政府機関は「人工知能の機密扱いではないユースケースのリストを作成」し、連邦最高情報責任者評議会 (CIO 評議会) と協力することが求められています。 ) および他の機関と公共の共有。

しかし、AI ユースケースのリストの公開には問題がありました。

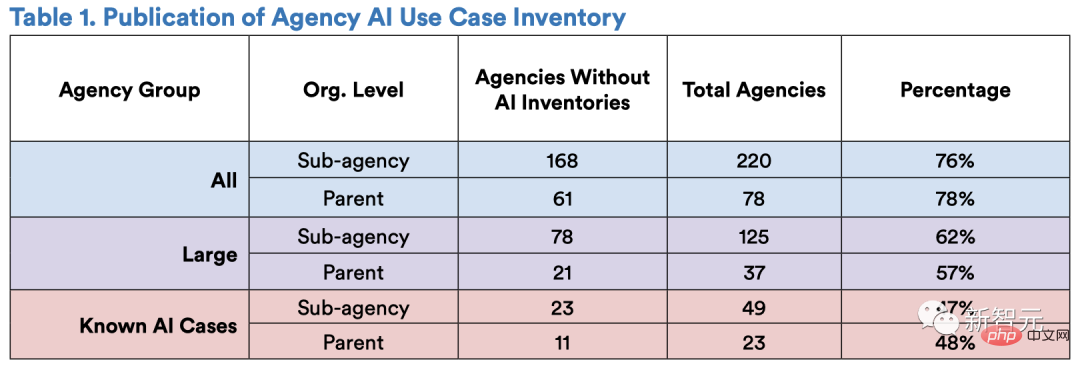

この要件の対象となる可能性があると特定された 220 の政府機関のうち、168 機関は AI ユースケースの独立した目録を持たず、リスト内の親機関の AI ユースケースに AI ユースケースを組み込んでいません。調査した 78 の親機関のうち、AI ユースケースのリストを公開しているのは 17 機関のみでした。

つまり、全 220 の上位および下位レベルの機関のうち、76% の機関がリストを公表しておらず、78% の機関がリストを公表していません。上位評価のリストに記載されています。

さらに、人工知能の使用例があることが知られている 49 の上位および下位レベルの機関のうち、47% の機関は人工知能の使用例のリストを公開していません。事例(上位および下位機関 23 件)。最も狭い組織グループである、親会社レベルで AI ユースケースが知られている 23 の大規模組織のうち、AI インベントリを公開しているのは 11 組織のみです。

#リスト自体は、実装中に直面する課題を反映しています。

第一に、AI の使用例は公に文書化されているにもかかわらず、政府機関は公開していません。

第 2 に、AI ユースケース チェックリストの実装における各機関の一貫性のなさは、まだ明確になっていない 3 つの重要な点を示しています。

リストを公開していない政府機関については、人工的な物質を使用していないと主張しているかどうかは不明です。インテリジェンスまたは単にこの要件が満たされていませんでした。

NIST リストを除き、公開されているすべてのリストは親機関レベル (商務省や商務省など) で公開されています。 NOAA や電力局が発行したリストではなく、エネルギー省が発行したリストです)。しかし、リストに載っていないサブエンティティが関連するユースケースを持っていないのか、それとも親機関とされる機関の報告要件に応じていないのかは不明である。

2019 年度の NDAA で規定され、人工知能に関する政府の指令に組み込まれた人工知能の定義は、非常に広範である可能性があります。そのため、政府機関が在庫管理の目的で特定のテクノロジーを「人工知能」として分類する際に準拠することがさらに困難になる可能性があります。

第三に、代理店リストには既存の透明性への取り組みが含まれることがよくありますが、内容は多岐にわたります。

全体として、著者は、米国の人工知能戦略の 3 つの柱は、人工知能指導命令、政府人工知能命令、および人工知能命令であると考えています。政府の人工知能法は、実際の運用においては十分に理想的ではありません。

現在の要件は、多くの組織によって「資金のないタスク」と見なされています。これに応じて、議会は政府機関に戦略的な AI 計画を策定するための人員配置と技術的専門知識の開発にリソースを提供する必要がある。

適切なリソースを提供し、上級職員にこれらの責任を遂行する権限を与えることができなければ、人工知能における米国のリーダーシップが損なわれる可能性があります。

著者について

クリスティ ローレンスは、スタンフォード ロー スクールとハーバード ケネディ スクールの法務博士/MPP 候補者であり、次のメンバーです。スタンフォード規制・評価・ガバナンス研究所(RegLab)。彼女は、人工知能に関する国家安全保障会議 (NSCAI) で研究分析の責任者を務め、スタンフォード大学人間中心人工知能研究所、ハーバード大学ベルファーセンターのサイバープログラム、国務省、および国家安全保障会議で働いてきました。経営コンサルタント。彼女はデューク大学で公共政策の学士号を取得しています。

Isaac Cui は、スタンフォード ロー スクールの法務博士課程 1 年生であり、RegLab のメンバーであり、スタンフォード大学のナイト ヘネシー奨学生です。 。ポモナ大学で物理学と政治学の学士号を取得し、マーシャル奨学生としてロンドン経済政治大学院で応用社会データサイエンスの修士号と規制の修士号を取得しました。

ダニエル・E・ホーは、ウィリアム・ベンジャミン・スコットとルナ・M・スコットの法学教授、政治学教授、スタンフォード大学経済政策部長です。スタンフォード大学研究所上級研究員。彼は、国家人工知能諮問評議会 (NAIAC) の指定メンバーであり、スタンフォード大学人間中心人工知能研究所 (HAI) の副所長、行動科学高等研究センターの教員フェロー、および所長を務めています。監督研究所の。彼はイェール大学ロースクールで法務博士号を取得し、ハーバード大学で博士号を取得しました。

以上がスタンフォード HAI が最新の白書を発表: 米国は AI 国家戦略を 2 年間ゆっくりと進歩させているの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。