ロボットに日常の物体を 3D で理解させることは、ロボット工学アプリケーションにおける大きな課題です。

未知の環境を探索する場合、オブジェクトの形状が多様であるため、既存のオブジェクトの姿勢推定方法では依然として満足のいくものではありません。

最近、浙江大学、バイトダンス人工知能研究所、香港中文大学の研究者が共同で、カテゴリレベルのオブジェクト形状の新しいフレームワークを提案しました。単一の RGB-D 画像からの姿勢推定。

文書アドレス: https://arxiv.org/abs/2210.01112

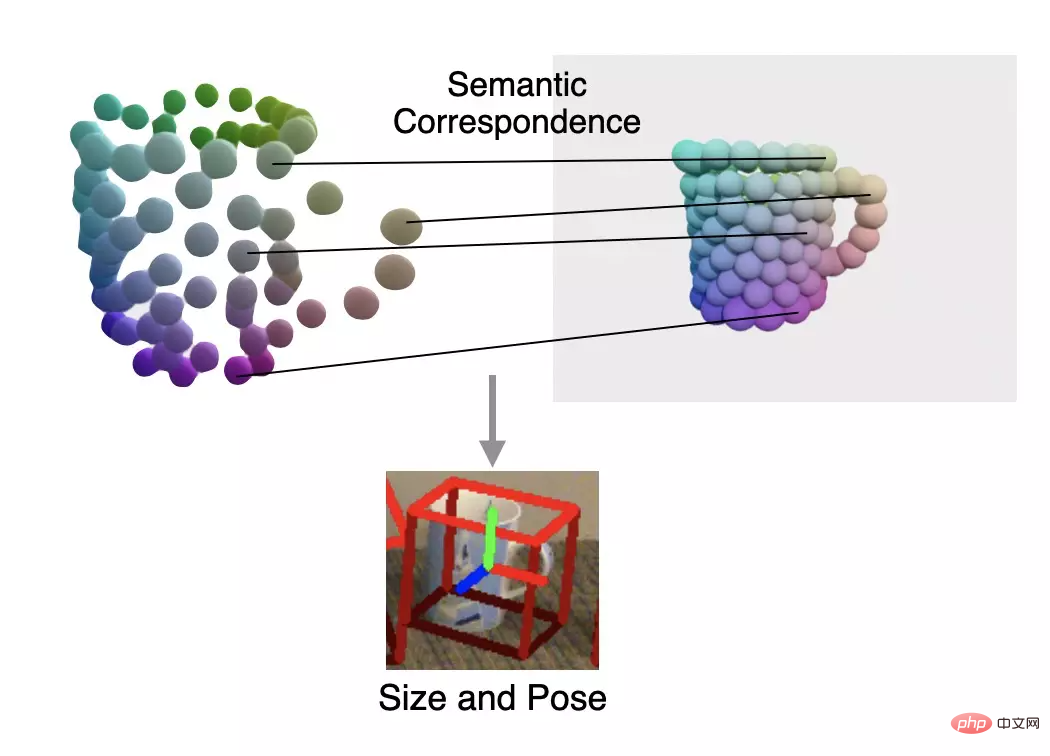

##プロジェクトリンク: https://zju3dv.github.io/gCasp#カテゴリ内のオブジェクトの形状変化を処理するには、研究者 意味論的なプリミティブ表現を採用して、さまざまな形状を統一された潜在空間にエンコードするこの表現は、観察された点群と推定された形状

の間に信頼できる対応関係を確立する鍵となります。次に、剛体相似変換に対して不変である

形状記述子を設計することにより、オブジェクトの形状と姿勢の推定が切り離され、それによってあらゆる姿勢がサポートされます。ターゲットオブジェクトの形状の最適化。実験により、提案された方法が公開データセットで最高の姿勢推定パフォーマンス を達成することが示されています。 研究背景

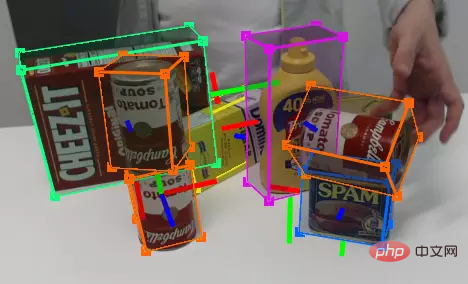

ロボットの認知・操作分野において、日常物体の形状や姿勢を推定することは基本的な機能であり、3Dを含むさまざまな応用が可能です。現場の理解、ロボット操作、自律倉庫保管。このタスクの初期の作業は、インスタンス レベルの姿勢推定に主に焦点を当てていました。これは主に、観察されたオブジェクトを特定の CAD モデルと位置合わせすることによってオブジェクトの姿勢を取得します。

ただし、特定のオブジェクトの正確なモデルを事前に取得するのは難しいため、このようなセットアップは現実のシナリオでは限定されます。

目に見えないが意味的によく知られたオブジェクトを一般化するために、カテゴリレベルのオブジェクト姿勢推定は、シーン内の同じカテゴリの実際のさまざまなインスタンスを潜在的に処理できるため、研究の注目が高まっています。

#既存のクラスレベルの姿勢推定方法は、通常、クラス内のインスタンスのピクセルレベルで正規化された座標を予測しようとするか、変形された座標を使用します。オブジェクトの姿勢を推定するための以前のモデル。

これらの研究は大きく進歩しましたが、同じカテゴリ内に大きな形状の違いがある場合、これらのワンショット予測方法は依然として困難に直面しています。

同じカテゴリ内のオブジェクトの多様性を処理するために、一部の作品では、ニューラル暗黙的表現を利用して、暗黙的表現でポーズと形状を繰り返し最適化することで、ターゲット オブジェクトの形状に適応します。スペースが広くなり、より良いパフォーマンスが得られました。

カテゴリ レベルのオブジェクトの姿勢推定には 2 つの主な課題があります。1 つはクラス内の大きな形状の違いであり、もう 1 つは形状と姿勢を結合する既存の手法です。より複雑な最適化問題を簡単に引き起こす可能性があります。

この論文では、研究者は、剛体相似変換に対して不変である形状記述子を設計することにより、オブジェクトの形状と姿勢の推定を分離し、それによって任意の姿勢をサポートしますターゲット オブジェクトの暗黙的な形状最適化。最後に、推定された形状と観測値の間の意味的な関連に基づいて、オブジェクトのスケールと姿勢が解決されます。

アルゴリズムの紹介

アルゴリズムは、生成形状推定、およびの 3 つのモジュールで構成されます。オブジェクトの姿勢推定。

アルゴリズムの入力は単一の RGB-D 画像です。アルゴリズムは、事前トレーニングされたマスク R-CNN を使用して、RGB 画像のセマンティック セグメンテーションの結果を取得し、その点群を逆投影します。各オブジェクトはカメラの内部パラメータに基づいています。この手法は主に点群を処理し、最終的に各オブジェクトのスケールと 6DoF 姿勢を取得します。

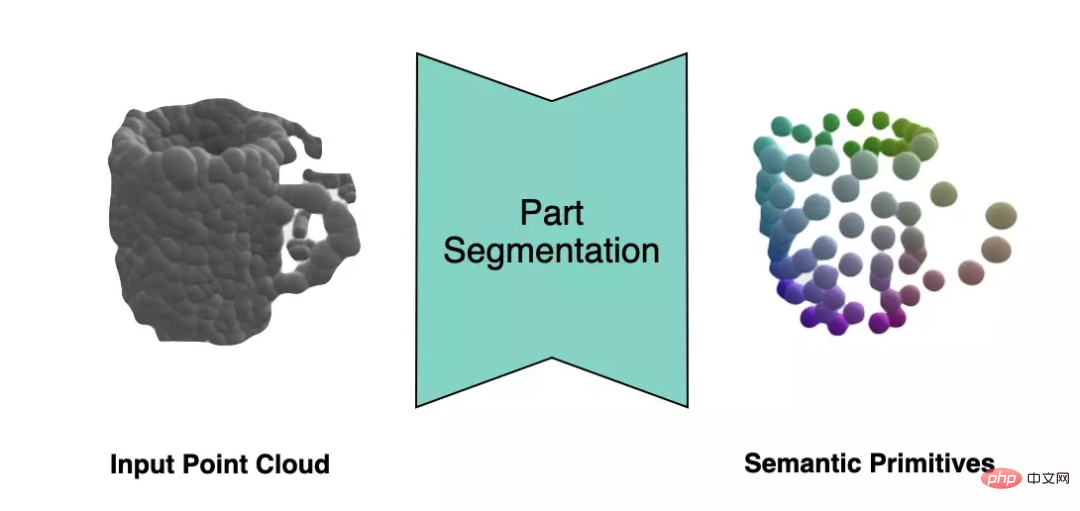

DualSDF[1] は、類似オブジェクトのセマンティックプリミティブの表現方法を提案しています。以下の図の左側に示すように、同じ種類のオブジェクトでは、各インスタンスは特定の数のセマンティック プリミティブに分割され、各プリミティブのラベルは特定の種類のオブジェクトの特定の部分に対応します。

観測点群からオブジェクトのセマンティック プリミティブを抽出するために、著者は点群セグメンテーション ネットワークを利用して、観測点群をラベル付きのセマンティック プリミティブにセグメント化します。

3D 生成モデル (DeepSDF など)ほとんどの場合、正規化された座標系で動作します。

ただし、現実世界の観察におけるオブジェクトと正規化された座標系の間には、同様の姿勢変換 (回転、平行移動、スケール) が発生します。

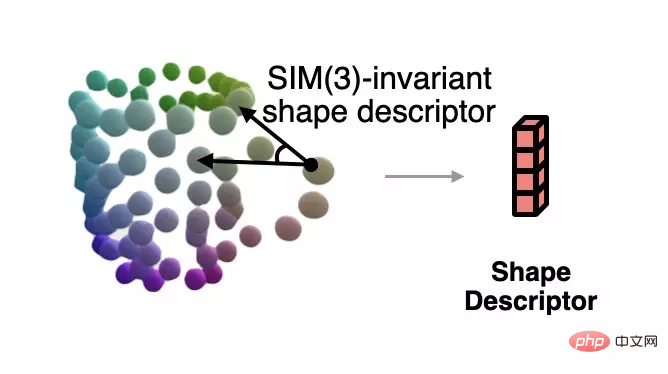

姿勢が不明な場合に現在の観察に対応する正規化された形状を解決するために、著者は意味論的なプリミティブ表現に基づいた同様の変換に対して不変な形状記述子を提案します。

#この記述子は次の図に示されており、さまざまなプリミティブで構成されるベクトル間の角度を記述します。

##著者は、この記述子を使用して現在の観測値と推定形状の間の誤差を測定し、勾配降下法を使用して推定形状と観測値の一貫性を高めます。そのプロセスを次の図に示します。

著者は、さらに形状最適化の例も示しています。

最後に、点群を観察し、形状間の意味論的な起源を解決します。著者は、言語対応関係に基づいて、梅山アルゴリズムを使用して、観察された形状の姿勢を解決します。

#実験結果

#実験結果

同時に、著者は、NOCS が提供するトレーニング セットでトレーニングする必要があるパラメータの量も比較しました。著者は、目標に到達するには、少なくとも 230 万のパラメータが必要です。最先端レベル。

以上がSOTA を超えるために必要なパラメーターはわずか 10% です。浙江大学、Byte、Hong Kong Chinese が共同で「カテゴリレベルの姿勢推定」タスクの新しいフレームワークを提案の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。