業界メディアの報道によると、OpenAI は、強力なチャットボットである ChatGPT が犯罪行為に使用される可能性があるという懸念から、一部の国および地域での適用を制限しました。しかし、この調査では、ロシアの一部のサイバー犯罪者が ChatGPT を採用するために既存の制限を回避する新しい方法を見つけようとしており、IP、支払いカード、電話番号の制限を回避するなどの事例が見つかったことが判明しました。

研究者らは、ロシアのハッカーが制限を回避して ChatGPT にアクセスしようとしていた証拠をハッカー フォーラムで発見しました。

2022 年 11 月以降 開始以来, ChatGPT は開発者、ライター、学生にとって重要なワークフロー ツールとなっていますが、ハッカーが悪意のあるコードを作成したり、フィッシングメールを改善するために使用しているという証拠があり、サイバー犯罪者が悪用できる強力な武器にもなっています。

ChatGPT は悪意のある目的に使用される可能性があります。ChatGPT を使用するハッカーはより迅速に悪意のある攻撃を実行できるため、OpenAI はツールの展開方法を制限する必要があります。 OpenAI は地理的ブロック措置を使用して、ロシアのユーザーがシステムにアクセスできないようにします。

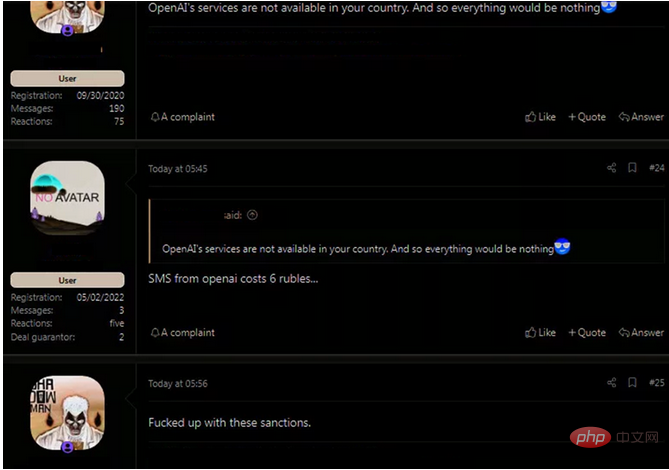

しかし、Check Point Software の研究者は、ロシアのハッカーがこれらの制限を回避する方法について地下ハッキング フォーラムで話し合っている例を複数発見しました。たとえば、ロシアのハッカー グループはフォーラムで質問を提起しました。ChatGPT に正常にアクセスできない場合、盗んだ支払いカードを使用して OpenAI アカウントの支払いを行い、API を使用してシステムにアクセスするにはどうすればよいでしょうか?このシステムは現在無料で使用できるプレビュー段階にありますが、API にはセッション中の支払い用のトークンを使用したテキストとコードの生成が含まれています。

チェック・ポイントの脅威インテリジェンス部門マネージャー、セルゲイ・シケビッチ氏は、OpenAIの制限を回避することは特に難しいことではないと述べ、「現在、ロシアのハッカー数名がジオフェンスを回避してChatGPTを使用する方法をすでに議論し、検討しているのを目にしている」と語った。 「彼らの悪意のある目的のために。私たちは、これらのハッカーがサイバー犯罪活動に ChatGPT をテストし、導入しようとしている可能性が高いと考えています。ChatGPT の背後にある人工知能テクノロジーによりサイバー攻撃をより効率的にできるため、サイバー犯罪者は ChatGPT への関心を高めています。」

これらの地下ハッキング フォーラムでは、半合法的なオンライン テキスト メッセージング サービスと、それを使用して ChatGPT に登録する方法についてロシア語でチュートリアルも提供しているため、ChatGPT がブロックされていない他の国でも使用されているように見えます。

ハッカーは、これらのフォーラムから、仮想番号に 2 セントを支払うだけで済むことを学び、その番号を使用して OpenAI からコードを取得します。これらの一時的な電話番号は世界中のどこからでも取得でき、必要に応じて新しい番号を生成できます。

Infostealer と ChatGPT の悪意のある使用

これまでの調査では、サイバー犯罪者が違法行為に ChatGPT を使用する方法をこれらのハッキング フォーラムに投稿した例が見つかりました。これには、非常に単純な Infostealer の作成が含まれます。人工知能ツールがより広く使用されるようになるにつれて、これらの Infostealer はより高度なものになるでしょう。

Infostealer は、これらの「シンプルなツール」の採用例であり、ハッカー フォーラムの「ChatGPT - マルウェアの利点」というタイトルの投稿に掲載されました。この投稿の著者は、ハッカーが ChatGPT を使用して説明とレポートを人工知能ツールに入力することでマルウェアを再作成し、一般的なファイル タイプを検索してランダムなファイルにコピーする Python ベースの盗用コードを共有できると指摘しています。それらをハードコードされた FTP サーバーに送信します。

シケビッチは言いました。 「サイバー犯罪者は、ChatGPT が魅力的であると感じています。ここ数週間、ハッカーが ChatGPT を使用して悪意のあるコードを作成し始めているという証拠を発見しました。ChatGPT は、ハッカーにとって良い出発点を提供し、サイバー攻撃の進行を加速する可能性を秘めています。ChatGPT ができるように、開発者がコードを書くのに役立つのと同じように、悪意のある目的にも使用される可能性があります。」

OpenAI は、実行できるリクエストの種類を制限するなど、ChatGPT の使用を制限する措置を講じたと述べました。ただし、一部のリクエストは無視される場合があります。また、そのヒントが ChatGPT の「なりすまし」に使用され、研究を装って、または架空の例として有害な可能性のあるコード例を提供しているという証拠もあります。

ChatGPT と潜在的な誤情報

一方、OpenAI は、ジョージタウン大学のセキュリティおよび新興技術センターおよびスタンフォード インターネット観測所と協力して、大規模な言語モデルを研究しています (たとえば、 ChatGPT の基礎である GPT-3) は、誤った情報を拡散するために使用される可能性があります。

このモデルを使用すると、以前は大規模な攻撃者のみがそのようなコンテンツにアクセスできましたが、影響力作戦の運営コストを削減し、新しいタイプのサイバー犯罪者の制御下に置くことができます。同様に、テキスト作成を自動化できる採用担当者は、新たな競争上の優位性を獲得できる可能性があります。

ハッカーによる ChatGPT の使用は、異なる動作を引き起こし、サイバー攻撃の規模を拡大し、手動で作成する場合と比較して、よりパーソナライズされた対象を絞ったコンテンツの作成を可能にする可能性もあります。最終的に、ハッカーがターゲットの言語や文化について必要な知識を欠いている可能性がある人間が作成したほとんどのプロパガンダ文書と比較して、テキスト生成ツールはより影響力と説得力のあるメッセージを生成できることがわかりました。

OpenAI 研究者は次のように宣言します:「言語モデルはブランド エバンジェリストにとって有用であり、オンライン影響力の運用を変える可能性があるというのが私たちの基本的な判断です。最も高度なモデルでさえ暗号化されているか、アプリケーション プログラミング インターフェイス (API) を通じてアクセスが制御されており、また、支持者はオープンソースの代替案を採用する傾向があるかもしれません。」

以上がAI ツールはサイバー犯罪者にとって人気の商品になっていますか?研究により、ロシアのハッカーがOpenAIの制限を回避してChatGPTにアクセスしていることが判明の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。