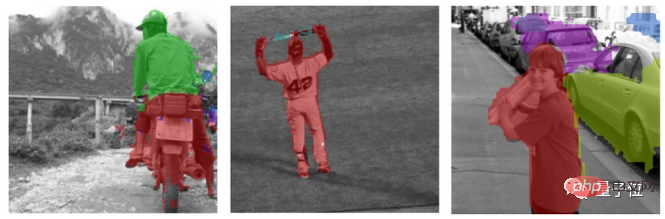

これまでに見たことのない新しいオブジェクトをセグメント化することもできます。

これは DeepMind によって開発された新しい学習フレームワークです: オブジェクト発見および表現ネットワーク (略して Odin)

前へ 自己教師あり学習 (SSL)この方法では、大きなシーン全体をうまく表現できますが、個々のオブジェクトを区別することは困難です。

Odin メソッドはそれを実行し、監視なしで実行します。

画像内の単一のオブジェクトを区別するのは簡単ではありません。それはどのように行われるのでしょうか?

主に Odin 学習フレームワークの「自己循環」により、画像内のさまざまなオブジェクトを適切に区別できます。

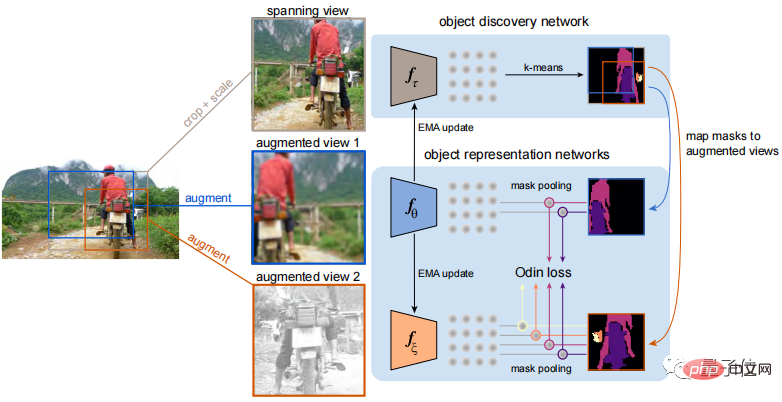

Odin は、連携して動作する 2 つのネットワーク セット、つまりターゲット検出ネットワークとターゲット表現ネットワークを学習しました。

Target Discovery Networkは、画像のトリミングされた部分を入力として受け取ります。トリミングされた部分には画像領域の大部分が含まれている必要があり、画像のこの部分は他の側面では強化されていません。

次に、入力画像から生成された特徴マップに対してクラスター分析を実行し、さまざまな特徴に従って画像内の各オブジェクトをセグメント化します。

ターゲット表現ネットワークの入力ビューは、ターゲット検出ネットワークで生成されたセグメント化された画像です。

ビューが入力された後、反転、ぼかし、ポイントレベルのカラー変換など、個別にランダムに前処理されます。

このようにして 2 組のマスクが得られますが、トリミングの違いを除けば、その他の情報は元の画像内容と同じです。

その後、2 つのマスクは、コントラスト損失を通じて画像内のオブジェクトをより適切に表現できる特徴を学習します。

具体的には、コントラスト検出を通じて、ネットワークはさまざまなターゲット オブジェクトの特性を識別するようにトレーニングされますが、他の無関係なオブジェクトからの多くの「ネガティブな」特性も存在します。

次に、異なるマスクにおける同じターゲット オブジェクトの類似性を最大化し、異なるターゲット オブジェクト間の類似性を最小化してから、より適切なセグメンテーションを実行して、異なるターゲット オブジェクトを区別します。

#同時に、ターゲット検出ネットワークは、ターゲット表現ネットワークのパラメーターに基づいて定期的に更新されます。

最終的な目標は、これらのオブジェクト レベルの特性が異なるビューでもほぼ変わらないことを保証すること、言い換えれば、画像内のオブジェクトを分離することです。

それでは、Odin 学習フレームワークの効果は何でしょうか?

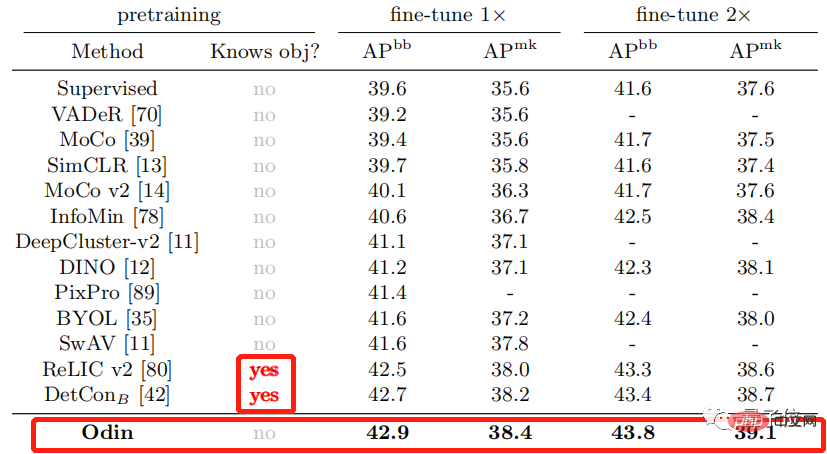

事前知識がなくてもシーン分割における Odin メソッドの転移学習のパフォーマンスも非常に強力です。

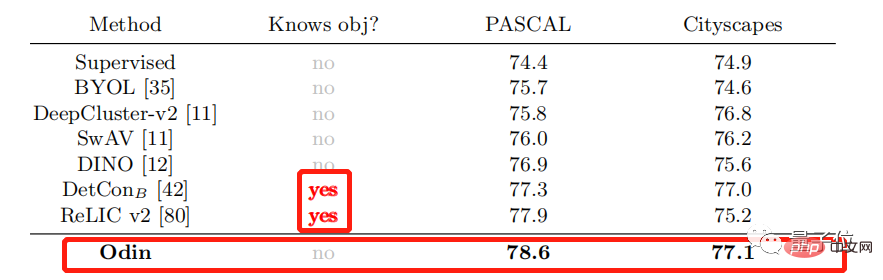

まず、Odin メソッドを使用して ImageNet データセットで事前トレーニングし、COCO データセットおよび PASCAL および Cityscapes セマンティック セグメンテーションに対するその効果を評価します。

対象オブジェクトをすでに知っている、つまり事前知識を取得する方法は、シーン分割を実行するときに事前知識を取得しない他の方法よりも大幅に優れています。

Odin 法は事前知識を取得しなくても、事前知識を取得する DetCon や ReLICv2 よりも効果が高くなります。

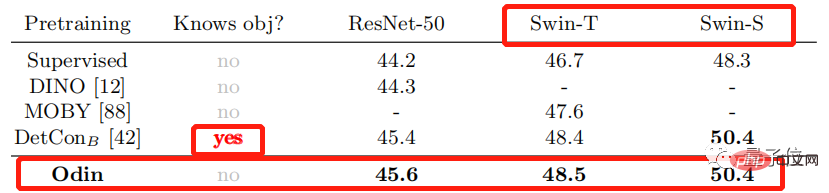

さらに、Odin メソッドは ResNet モデルだけでなく、Swim Transformer などのより複雑なモデルにも適用できます。 。

データの観点から見ると、Odin フレームワーク学習の利点は明らかですが、Odin の利点は視覚的なイメージのどこに反映されているのでしょうか?

Odin を使用して生成されたセグメント化された画像を、ランダムに初期化されたネットワーク (列 3)、ImageNet 監視ネットワーク (列 4) から取得した画像と比較します。

列 3 と列 4 はオブジェクトの境界を明確に描写できていないか、現実世界のオブジェクトの一貫性や局所性が欠けており、Odin によって生成された画像効果は明らかに優れています。

参考リンク:

[1] https://twitter.com/DeepMind/status/1554467389290561541

[2] https://arxiv.org/abs/2203.08777

以上が未知のオブジェクトも簡単に識別してセグメント化でき、その効果を伝達できます。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。