この記事では主に TensorFlow がランダム トレーニングとバッチ トレーニングを実装する方法を紹介し、参考として提供します。ぜひ一緒に見てみましょう

TensorFlow はモデル変数を更新します。一度に 1 つのデータ ポイントを操作することも、一度に大量のデータを操作することもできます。単一のトレーニング サンプルを操作すると、「奇妙な」学習プロセスが発生する可能性がありますが、大規模なバッチを使用したトレーニングでは計算コストが高くなる可能性があります。どのタイプのトレーニングを選択するかは、機械学習アルゴリズムの収束にとって非常に重要です。

TensorFlow がバックプロパゲーションを機能させるための変数勾配を計算するには、1 つ以上のサンプルで損失を測定する必要があります。

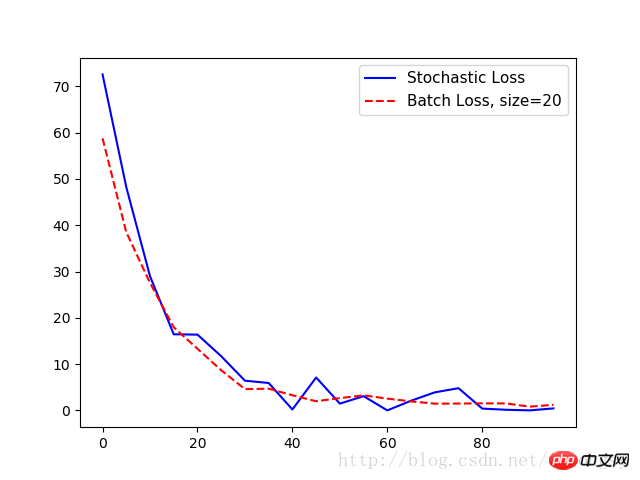

ランダム トレーニングでは、トレーニング データとターゲット データのペアをランダムにサンプリングしてトレーニングを完了します。別のオプションは、大規模なバッチ トレーニングでの勾配計算の損失を平均することであり、バッチ トレーニングのサイズを一度にデータ セット全体に拡張できます。ここでは、ランダム トレーニングとバッチ トレーニングを使用して、回帰アルゴリズムの前述の例を拡張する方法を示します。

バッチトレーニングとランダムトレーニングの違いは、オプティマイザーメソッドと収束です。

# 随机训练和批量训练

#----------------------------------

#

# This python function illustrates two different training methods:

# batch and stochastic training. For each model, we will use

# a regression model that predicts one model variable.

import matplotlib.pyplot as plt

import numpy as np

import tensorflow as tf

from tensorflow.python.framework import ops

ops.reset_default_graph()

# 随机训练:

# Create graph

sess = tf.Session()

# 声明数据

x_vals = np.random.normal(1, 0.1, 100)

y_vals = np.repeat(10., 100)

x_data = tf.placeholder(shape=[1], dtype=tf.float32)

y_target = tf.placeholder(shape=[1], dtype=tf.float32)

# 声明变量 (one model parameter = A)

A = tf.Variable(tf.random_normal(shape=[1]))

# 增加操作到图

my_output = tf.multiply(x_data, A)

# 增加L2损失函数

loss = tf.square(my_output - y_target)

# 初始化变量

init = tf.global_variables_initializer()

sess.run(init)

# 声明优化器

my_opt = tf.train.GradientDescentOptimizer(0.02)

train_step = my_opt.minimize(loss)

loss_stochastic = []

# 运行迭代

for i in range(100):

rand_index = np.random.choice(100)

rand_x = [x_vals[rand_index]]

rand_y = [y_vals[rand_index]]

sess.run(train_step, feed_dict={x_data: rand_x, y_target: rand_y})

if (i+1)%5==0:

print('Step #' + str(i+1) + ' A = ' + str(sess.run(A)))

temp_loss = sess.run(loss, feed_dict={x_data: rand_x, y_target: rand_y})

print('Loss = ' + str(temp_loss))

loss_stochastic.append(temp_loss)

# 批量训练:

# 重置计算图

ops.reset_default_graph()

sess = tf.Session()

# 声明批量大小

# 批量大小是指通过计算图一次传入多少训练数据

batch_size = 20

# 声明模型的数据、占位符

x_vals = np.random.normal(1, 0.1, 100)

y_vals = np.repeat(10., 100)

x_data = tf.placeholder(shape=[None, 1], dtype=tf.float32)

y_target = tf.placeholder(shape=[None, 1], dtype=tf.float32)

# 声明变量 (one model parameter = A)

A = tf.Variable(tf.random_normal(shape=[1,1]))

# 增加矩阵乘法操作(矩阵乘法不满足交换律)

my_output = tf.matmul(x_data, A)

# 增加损失函数

# 批量训练时损失函数是每个数据点L2损失的平均值

loss = tf.reduce_mean(tf.square(my_output - y_target))

# 初始化变量

init = tf.global_variables_initializer()

sess.run(init)

# 声明优化器

my_opt = tf.train.GradientDescentOptimizer(0.02)

train_step = my_opt.minimize(loss)

loss_batch = []

# 运行迭代

for i in range(100):

rand_index = np.random.choice(100, size=batch_size)

rand_x = np.transpose([x_vals[rand_index]])

rand_y = np.transpose([y_vals[rand_index]])

sess.run(train_step, feed_dict={x_data: rand_x, y_target: rand_y})

if (i+1)%5==0:

print('Step #' + str(i+1) + ' A = ' + str(sess.run(A)))

temp_loss = sess.run(loss, feed_dict={x_data: rand_x, y_target: rand_y})

print('Loss = ' + str(temp_loss))

loss_batch.append(temp_loss)

plt.plot(range(0, 100, 5), loss_stochastic, 'b-', label='Stochastic Loss')

plt.plot(range(0, 100, 5), loss_batch, 'r--', label='Batch Loss, size=20')

plt.legend(loc='upper right', prop={'size': 11})

plt.show()出力:

ステップ #5 A = [ 1.47604525]

損失 = [ 72.55678558]

ステップ #10 A = [ 3.01128507]

損失 = [ 48.22986 221]

ステップ #15 A = [4.27042341 ]

損失 = [ 28.97912598]

ステップ #20 A = [ 5.2984333]

損失 = [ 16.44779968]

ステップ #25 A = [ 6.17473984]

損失 = [ 16.373312]

ステップ #30 A = [ 6 .89866304]

損失= [ 11.71054649 ]

ステップ #35 A = [ 7.39849901]

損失 = [ 6.42773056]

ステップ #40 A = [ 7.84618378]

ステップ #45 A = [ 8.1570978 2]

損失 = [ 0 .2142024 ]

ステップ #50 A = [ 8.54818344]

損失 = [ 7.11651039]

ステップ #55 A = [ 8.82354641]

損失 = [ 1.47823763]

ステップ #60 A = [ 9.07896614]

損失 = [ 8244276 ]

ステップ #65 A = [ 9.24868107]

損失 = [ 0.01143846]

ステップ #70 A = [ 9.36772251]

損失 = [ 2.10078788]

ステップ #75 A = [ 9.49171734]

損失 = [ 3.90913701]

ステップ #80 A = [ 9 . 6622715]

損失 = [ 4.80727625 ]

ステップ #85 A = [ 9.73786926]

損失 = [ 0.39915398]

ステップ #90 A = [ 9.81853104]

損失 = [ 0.14876099]

ステップ #9 5 A = [ 9.90371323]

損失 = [ 0 .01657014]

ステップ #100 A = [9.86669159]

損失 = [ 0.444787]

ステップ #5 A = [[ 2.34371352]]

損失 = 58.766

ステップ #10 A = [[ 3.74766445]]

損失 = 38.4875

ステップ #15 A = [[ 4.88928795 ]]

損失 = 27.5632

ステップ #20 A = [[ 5.82038736]]

損失 = 17.9523

ステップ #25 A = [[ 6.58999157]]

損失 = 13.3245

ステップ #30 A = [[ 7.20851326 ]]

損失 = 8.68099

ステップ #35 A = [[ 7.71694899]]

損失 = 4.60659

ステップ #40 A = [[ 8.1296711]]

損失 = 4.70107

ステップ #45 A = [[ 8.47107315] ]

損失 = 3.28318

ステップ #50 A = [[ 8.74283409]]

損失 = 1.99057

ステップ #55 A = [[ 8.98811722]]

損失 = 2.66906

ステップ #60 A = [[ 9.18062305]]

損失 = 3.26207

ステップ #65 A = [[ 9.31655025 ]]

損失 = 2.55459

ステップ #70 A = [[ 9.43130589]]

損失 = 1.95839

ステップ #75 A = [[ 9.55670166]]

損失 = 1.46504

ステップ #80 A = [[ 9.6354847] ]

損失 = 1.49021

ステップ #85 A = [[ 9.73470974]]

損失 = 1.53289

ステップ #90 A = [[ 9.77956581]]

損失 = 1.52173

ステップ #95 A = [[ 9.83666706] ]

損失 = 0.819207

ステップ #100 A = [[ 9.85569191]]

損失 = 1.2197

| 利点 | 欠点 | |

|---|---|---|

| 極小値から外れています | 一般に更新が必要です 収束するまでに複数回の反復が必要です | |

| 最小限の損失を迅速に取得します | より多くのコンピューティングリソースを消費します |

A tensorflow1.0 プーリング層 (プーリング) と完全な接続層 (密) についての簡単な説明

Tensorflow モデルの保存と復元についての簡単な説明

以上がTensorFlow がランダム トレーニングとバッチ トレーニングを実装する方法の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。