テクノロジー周辺機器

テクノロジー周辺機器

AI

AI

ICML 2024 | グラデーションチェックポイント設定が遅すぎますか? LowMemoryBP は、ビデオ メモリの速度を低下させたり節約したりすることなく、バック プロパゲーション ビデオ メモリの効率を大幅に向上させます。

ICML 2024 | グラデーションチェックポイント設定が遅すぎますか? LowMemoryBP は、ビデオ メモリの速度を低下させたり節約したりすることなく、バック プロパゲーション ビデオ メモリの効率を大幅に向上させます。

ICML 2024 | グラデーションチェックポイント設定が遅すぎますか? LowMemoryBP は、ビデオ メモリの速度を低下させたり節約したりすることなく、バック プロパゲーション ビデオ メモリの効率を大幅に向上させます。

AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com

この論文の筆頭著者は、南開大学統計データサイエンス学部修士課程2年生のYang Yuchen氏とその指導教員です。南開大学統計データサイエンス学部の徐軍准教授です。 Xu Jun 教授のチームの研究の焦点は、コンピューター ビジョン、生成 AI、効率的な機械学習であり、主要な会議や雑誌に多くの論文を発表しており、Google Scholar で 4,700 件以上引用されています。

大規模な Transformer モデルがさまざまな分野で徐々に統一されたアーキテクチャになってきたため、微調整は、事前トレーニングされた大規模なモデルを下流のタスクに適用するための重要な手段となっています。しかし、モデルのサイズは日々増大するため、微調整に必要なビデオメモリも徐々に増加し、微調整用のビデオメモリをいかに効率的に削減するかが重要な課題となっています。以前は、Transformer モデルを微調整する場合、グラフィックス メモリのオーバーヘッドを節約するために、勾配チェックポイント (アクティベーション再計算とも呼ばれます) を使用して、トレーニング速度を犠牲にしてバックプロパゲーション (BP) プロセスに必要な時間を短縮するのが一般的なアプローチでした。ビデオメモリの使用を有効にします。

最近、南開大学統計・データサイエンス学部のシュー・ジュン教師のチームがICML 2024で発表した論文「近似およびメモリ共有バックプロパゲーションによるメモリオーバーヘッドの微調整の削減」では、バックプロパゲーションを変更することで次のことを提案しました( BP) プロセスでは、計算量を増やすことなく、ピーク時のアクティベーション メモリ使用量が大幅に削減されます。

論文: 近似およびメモリ共有バックプロパゲーションによる微調整メモリオーバーヘッドの削減

論文リンク: https://arxiv.org/abs/2406.16282

プロジェクトリンク: https:/ / /github.com/yyyyychen/LowMemoryBP

この記事では、近似逆伝播 (About-BP) とメモリ共有逆伝播 (MS-BP) という 2 つの逆伝播改善戦略を提案しています。おおよその BP と MS-BP はそれぞれ、バックプロパゲーションにおけるメモリ効率を向上させる 2 つのソリューションを表しており、総称して LowMemoryBP と呼ぶことができます。理論的な意味でも実践的な意味でも、この記事はより効率的なバックプロパゲーション トレーニングのための画期的なガイダンスを提供します。

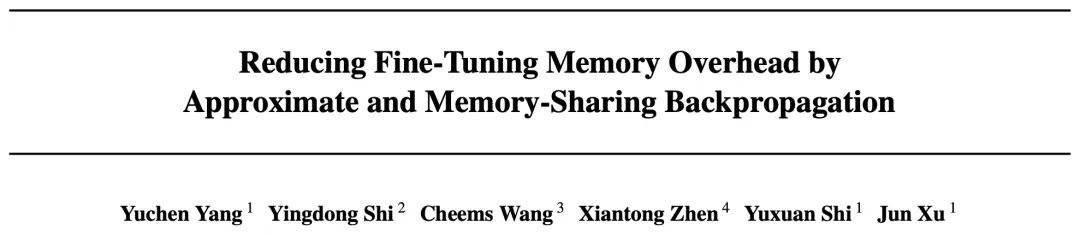

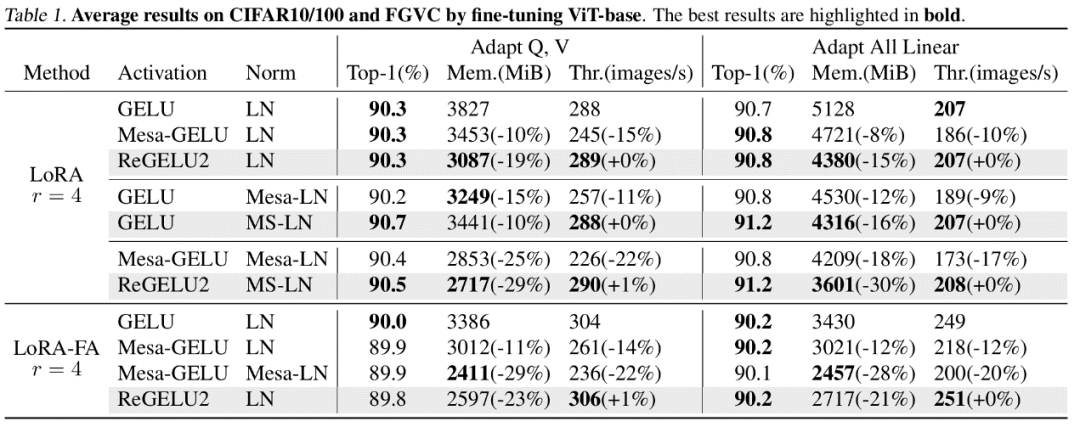

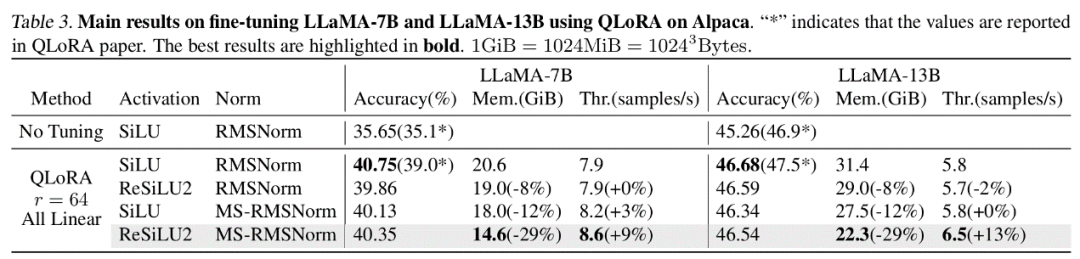

理論的なメモリ分析では、LowMemoryBP は活性化関数と正規化層からの活性化メモリの使用量を大幅に削減できます。ViT と LLaMA を例に挙げると、ViT を微調整すると活性化メモリを 39.47% 削減でき、LLaMA を微調整すると活性化を次のように削減できます。ビデオメモリは29.19%。

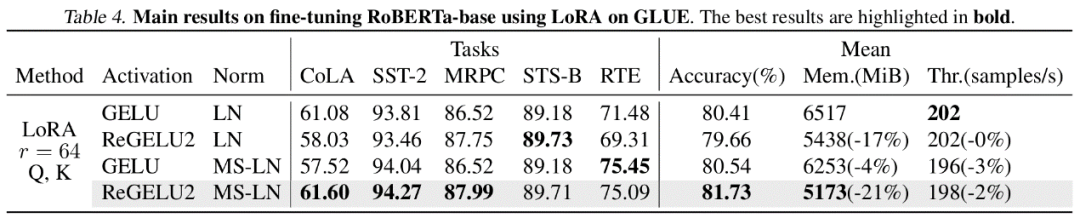

実際の実験では、LowMemoryBP は、ViT、LLaMA、RoBERTa、BERT、Swin を含む Transformer モデル微調整のピーク メモリ使用量を効果的に 20%~30% 削減でき、トレーニング スループットと損失は増加しません。テストの精度。

About-BP

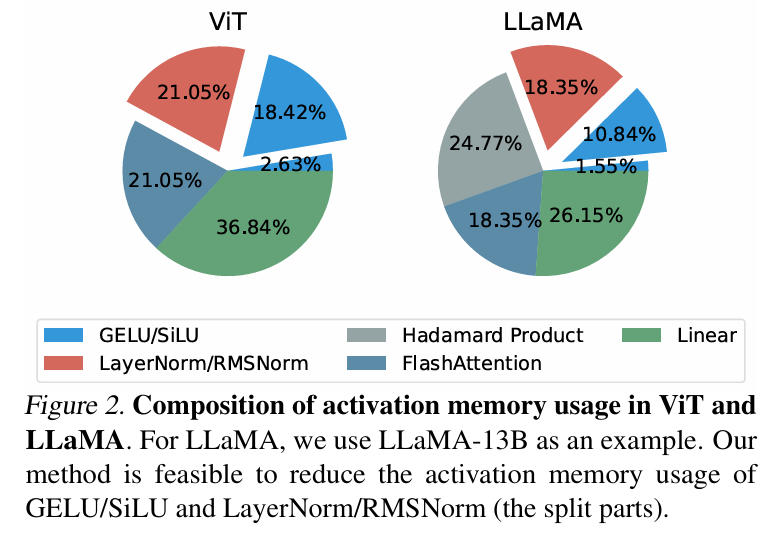

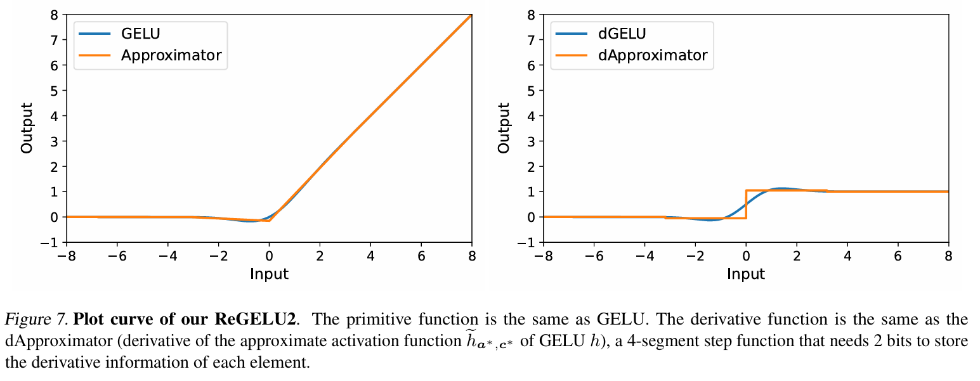

従来の逆伝播トレーニングでは、活性化関数の勾配の逆伝播は、Transformer モデルで一般的に使用される GELU 関数と SiLU 関数の導関数に厳密に対応します。これは、入力が必要であることを意味します。 be 特徴テンソルはアクティブ ビデオ メモリに完全に保存されます。この記事の著者は、一連のバックプロパゲーション近似理論、つまり近似 BP 理論を提案しました。この理論に基づいて、著者は区分線形関数を使用して活性化関数を近似し、GELU/SiLU 勾配の逆伝播を区分線形関数の導関数 (ステップ関数) に置き換えます。このアプローチにより、ReGELU2 と ReSiLU2 という 2 つの非対称メモリ効率の高い活性化関数が得られます。このタイプのアクティベーション関数は、リバース パスバックに 4 段階のステップ関数を使用するため、アクティベーション ストレージでは 2 ビット データ型のみを使用する必要があります。

MS-BP

BP ネットワークの各層は通常、バックプロパゲーション計算のために入力テンソルを活性化メモリに保存します。著者は、特定の層のバックプロパゲーションを出力依存形式に書き換えることができれば、この層と後続の層が同じ活性化テンソルを共有できるため、活性化ストレージの冗長性が削減されると指摘しています。

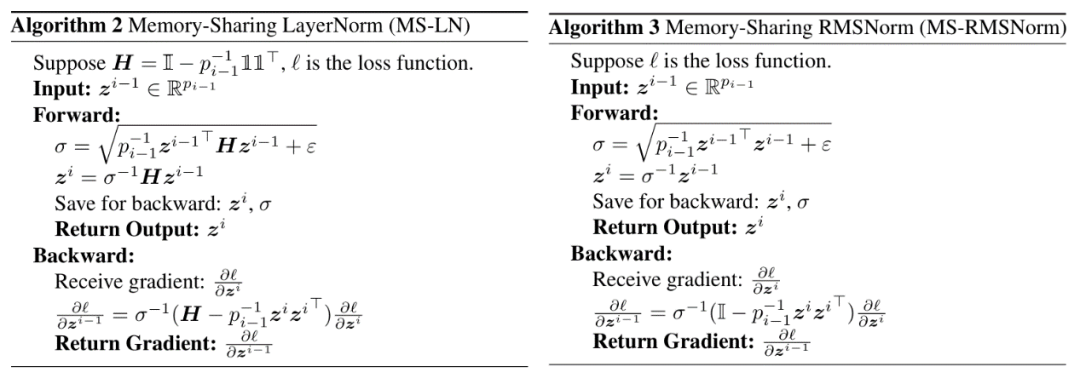

この記事では、Transformer モデルで一般的に使用される LayerNorm と RMSNorm は、アフィン パラメーターを後者の線形層にマージした後、MS-BP 戦略の要件を十分に満たすことができると指摘しています。再設計された MS-LayerNorm および MS-RMSNorm は、独立したアクティブ グラフィックス メモリを生成しなくなりました。

実験結果

著者は、コンピュータービジョンと自然言語処理の分野におけるいくつかの代表的なモデルに対して微調整実験を実施しました。このうち、ViT、LLaMA、RoBERTa の微調整実験では、論文で提案された方法により、トレーニング効果とトレーニング速度を損なうことなく、ピーク時のメモリ使用量がそれぞれ 27%、29%、21% 削減されました。比較の Mesa (8 ビット アクティベーション圧縮トレーニング法) ではトレーニング速度が約 20% 低下しますが、この記事で提案されている LowMemoryBP 法ではトレーニング速度が完全に維持されることに注意してください。

結論と意義

この記事で提案されている2つの血圧改善戦略、おおよその血圧とMS-BPは、どちらもトレーニング効果とトレーニングを維持しながらビデオメモリの活性化を達成します。大幅な節約。これは、BP 原則に基づいた最適化が非常に有望なメモリ節約ソリューションであることを意味します。さらに、この記事で提案されている近似 BP 理論は、従来のニューラル ネットワークの最適化フレームワークを打ち破り、不対導関数を使用するための理論的な実現可能性を提供します。その派生した ReGELU2 および ReSiLU2 は、このアプローチの重要な実用的価値を示しています。

アルゴリズムの詳細を理解するには、論文またはコードを読んでください。関連モジュールは LowMemoryBP プロジェクトの github リポジトリでオープンソース化されています。

以上がICML 2024 | グラデーションチェックポイント設定が遅すぎますか? LowMemoryBP は、ビデオ メモリの速度を低下させたり節約したりすることなく、バック プロパゲーション ビデオ メモリの効率を大幅に向上させます。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

AI Hentai Generator

AIヘンタイを無料で生成します。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

7364

7364

15

15

1628

1628

14

14

1353

1353

52

52

1265

1265

25

25

1214

1214

29

29

RLHF から DPO、TDPO に至るまで、大規模なモデル アライメント アルゴリズムはすでに「トークンレベル」になっています

Jun 24, 2024 pm 03:04 PM

RLHF から DPO、TDPO に至るまで、大規模なモデル アライメント アルゴリズムはすでに「トークンレベル」になっています

Jun 24, 2024 pm 03:04 PM

AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com 人工知能の開発プロセスにおいて、大規模言語モデル (LLM) の制御とガイダンスは常に中心的な課題の 1 つであり、これらのモデルが両方とも確実に機能することを目指しています。強力かつ安全に人類社会に貢献します。初期の取り組みは人間のフィードバックによる強化学習手法に焦点を当てていました (RL

ControlNet の作者がまたヒット作を出しました!写真から絵画を生成し、2 日間で 1.4,000 個のスターを獲得する全プロセス

Jul 17, 2024 am 01:56 AM

ControlNet の作者がまたヒット作を出しました!写真から絵画を生成し、2 日間で 1.4,000 個のスターを獲得する全プロセス

Jul 17, 2024 am 01:56 AM

これも Tusheng のビデオですが、PaintsUndo は別の道を歩んでいます。 ControlNet 作者 LvminZhang が再び生き始めました!今回は絵画の分野を目指します。新しいプロジェクト PaintsUndo は、開始されて間もなく 1.4kstar を獲得しました (まだ異常なほど上昇しています)。プロジェクトアドレス: https://github.com/lllyasviel/Paints-UNDO このプロジェクトを通じて、ユーザーが静止画像を入力すると、PaintsUndo が線画から完成品までのペイントプロセス全体のビデオを自動的に生成するのに役立ちます。 。描画プロセス中の線の変化は驚くべきもので、最終的なビデオ結果は元の画像と非常によく似ています。完成した描画を見てみましょう。

OpenAI Super Alignment チームの遺作: 2 つの大きなモデルがゲームをプレイし、出力がより理解しやすくなる

Jul 19, 2024 am 01:29 AM

OpenAI Super Alignment チームの遺作: 2 つの大きなモデルがゲームをプレイし、出力がより理解しやすくなる

Jul 19, 2024 am 01:29 AM

AIモデルによって与えられた答えがまったく理解できない場合、あなたはそれをあえて使用しますか?機械学習システムがより重要な分野で使用されるにつれて、なぜその出力を信頼できるのか、またどのような場合に信頼してはいけないのかを実証することがますます重要になっています。複雑なシステムの出力に対する信頼を得る方法の 1 つは、人間または他の信頼できるシステムが読み取れる、つまり、考えられるエラーが発生する可能性がある点まで完全に理解できる、その出力の解釈を生成することをシステムに要求することです。見つかった。たとえば、司法制度に対する信頼を築くために、裁判所に対し、決定を説明し裏付ける明確で読みやすい書面による意見を提供することを求めています。大規模な言語モデルの場合も、同様のアプローチを採用できます。ただし、このアプローチを採用する場合は、言語モデルが

オープンソース AI ソフトウェア エンジニアのリストのトップに立つ UIUC のエージェントレス ソリューションは、SWE ベンチの実際のプログラミングの問題を簡単に解決します

Jul 17, 2024 pm 10:02 PM

オープンソース AI ソフトウェア エンジニアのリストのトップに立つ UIUC のエージェントレス ソリューションは、SWE ベンチの実際のプログラミングの問題を簡単に解決します

Jul 17, 2024 pm 10:02 PM

AIxivコラムは、当サイトが学術的・技術的な内容を掲載するコラムです。過去数年間で、このサイトの AIxiv コラムには 2,000 件を超えるレポートが寄せられ、世界中の主要な大学や企業のトップ研究室がカバーされ、学術交流と普及を効果的に促進しています。共有したい優れた作品がある場合は、お気軽に寄稿するか、報告のために当社までご連絡ください。提出電子メール: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com この論文の著者は全員、イリノイ大学アーバナ シャンペーン校 (UIUC) の Zhang Lingming 教師のチームのメンバーです。博士課程4年、研究者

リーマン予想の大きな進歩!陶哲軒氏はMITとオックスフォードの新しい論文を強く推薦し、37歳のフィールズ賞受賞者も参加した

Aug 05, 2024 pm 03:32 PM

リーマン予想の大きな進歩!陶哲軒氏はMITとオックスフォードの新しい論文を強く推薦し、37歳のフィールズ賞受賞者も参加した

Aug 05, 2024 pm 03:32 PM

最近、2000年代の7大問題の一つとして知られるリーマン予想が新たなブレークスルーを達成した。リーマン予想は、数学における非常に重要な未解決の問題であり、素数の分布の正確な性質に関連しています (素数とは、1 とそれ自身でのみ割り切れる数であり、整数論において基本的な役割を果たします)。今日の数学文献には、リーマン予想 (またはその一般化された形式) の確立に基づいた 1,000 を超える数学的命題があります。言い換えれば、リーマン予想とその一般化された形式が証明されれば、これらの 1,000 を超える命題が定理として確立され、数学の分野に重大な影響を与えることになります。これらの命題の一部も有効性を失います。 MIT数学教授ラリー・ガスとオックスフォード大学から新たな進歩がもたらされる

無制限のビデオ生成、計画と意思決定、次のトークン予測とフルシーケンス拡散の拡散強制統合

Jul 23, 2024 pm 02:05 PM

無制限のビデオ生成、計画と意思決定、次のトークン予測とフルシーケンス拡散の拡散強制統合

Jul 23, 2024 pm 02:05 PM

現在、次のトークン予測パラダイムを使用した自己回帰大規模言語モデルが世界中で普及していると同時に、インターネット上の多数の合成画像やビデオがすでに拡散モデルの威力を示しています。最近、MITCSAIL の研究チーム (そのうちの 1 人は MIT の博士課程学生、Chen Boyuan です) は、全系列拡散モデルとネクスト トークン モデルの強力な機能を統合することに成功し、トレーニングおよびサンプリング パラダイムである拡散強制 (DF) を提案しました。 )。論文タイトル:DiffusionForcing:Next-tokenPredictionMeetsFull-SequenceDiffusion 論文アドレス:https:/

arXiv 論文は「弾幕」として投稿可能、スタンフォード alphaXiv ディスカッション プラットフォームはオンライン、LeCun は気に入っています

Aug 01, 2024 pm 05:18 PM

arXiv 論文は「弾幕」として投稿可能、スタンフォード alphaXiv ディスカッション プラットフォームはオンライン、LeCun は気に入っています

Aug 01, 2024 pm 05:18 PM

乾杯!紙面でのディスカッションが言葉だけになると、どんな感じになるでしょうか?最近、スタンフォード大学の学生が、arXiv 論文のオープン ディスカッション フォーラムである alphaXiv を作成しました。このフォーラムでは、arXiv 論文に直接質問やコメントを投稿できます。 Web サイトのリンク: https://alphaxiv.org/ 実際、URL の arXiv を alphaXiv に変更するだけで、alphaXiv フォーラムの対応する論文を直接開くことができます。この Web サイトにアクセスする必要はありません。その中の段落を正確に見つけることができます。論文、文: 右側のディスカッション エリアでは、ユーザーは論文のアイデアや詳細について著者に尋ねる質問を投稿できます。たとえば、次のような論文の内容についてコメントすることもできます。

公理的トレーニングにより、LLM は因果推論を学習できます。6,700 万個のパラメータ モデルは、1 兆個のパラメータ レベル GPT-4 に匹敵します。

Jul 17, 2024 am 10:14 AM

公理的トレーニングにより、LLM は因果推論を学習できます。6,700 万個のパラメータ モデルは、1 兆個のパラメータ レベル GPT-4 に匹敵します。

Jul 17, 2024 am 10:14 AM

LLM に因果連鎖を示すと、LLM は公理を学習します。 AI はすでに数学者や科学者の研究を支援しています。たとえば、有名な数学者のテレンス タオは、GPT などの AI ツールを活用した研究や探索の経験を繰り返し共有しています。 AI がこれらの分野で競争するには、強力で信頼性の高い因果推論能力が不可欠です。この記事で紹介する研究では、小さなグラフでの因果的推移性公理の実証でトレーニングされた Transformer モデルが、大きなグラフでの推移性公理に一般化できることがわかりました。言い換えれば、Transformer が単純な因果推論の実行を学習すると、より複雑な因果推論に使用できる可能性があります。チームが提案した公理的トレーニング フレームワークは、デモンストレーションのみで受動的データに基づいて因果推論を学習するための新しいパラダイムです。