Le contenu qui doit être réécrit est le suivant : Auteur Richard MacManus

Planning | Yan Zheng

Web3 n'a pas réussi à renverser le Web2, mais la pile de développement de grands modèles émergente permet aux développeurs de passer de l'ère du « cloud natif » à la nouvelle IA. pile technologique.

Les ingénieurs rapides ne sont peut-être pas en mesure de toucher les nerfs des développeurs pour se précipiter vers de grands modèles, mais les mots du chef de produit ou du leader : un "agent" peut-il être développé, une "chaîne" peut-elle être implémentée et "Quelle base de données vectorielle devrait être utilisé?" sont devenus À l'heure actuelle, les principales sociétés d'applications de grands modèles grand public ont poussé les étudiants en technologie à surmonter les difficultés liées au développement de l'IA.

Quelles sont les couches de la pile technologique émergente ? Où est la partie la plus difficile ? Cet article vous amènera à le découvrir

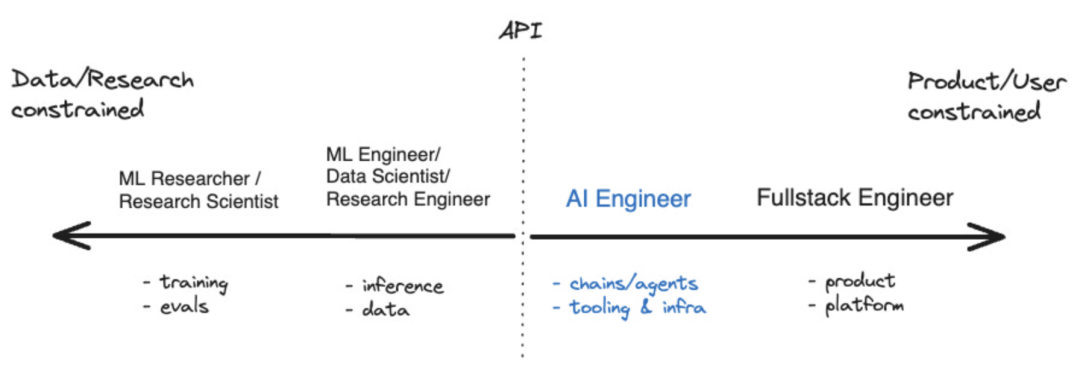

Au cours de la dernière année, certains outils ont émergé, tels que LangChain et LlamaIndex, qui ont permis. développeurs d'applications d'IA pour L'écosystème commence à mûrir. Il existe même un terme désormais utilisé pour décrire ceux qui se concentrent sur le développement de l’intelligence artificielle, à savoir « ingénieur IA ». Selon Shawn @swyx Wang, il s'agit de la prochaine étape pour les « ingénieurs rapides ». Il a également créé un diagramme de coordonnées qui démontre visuellement la position des ingénieurs en IA dans l'écosystème plus large de l'intelligence artificielle

Source : swyx

Source : swyx

Les grands modèles de langage (LLM) sont la technologie de base des ingénieurs en IA. Ce n'est pas un hasard si LangChain et LlamaIndex sont des outils qui étendent et complètent le LLM. Mais quels autres outils sont disponibles pour cette nouvelle génération de développeurs ?

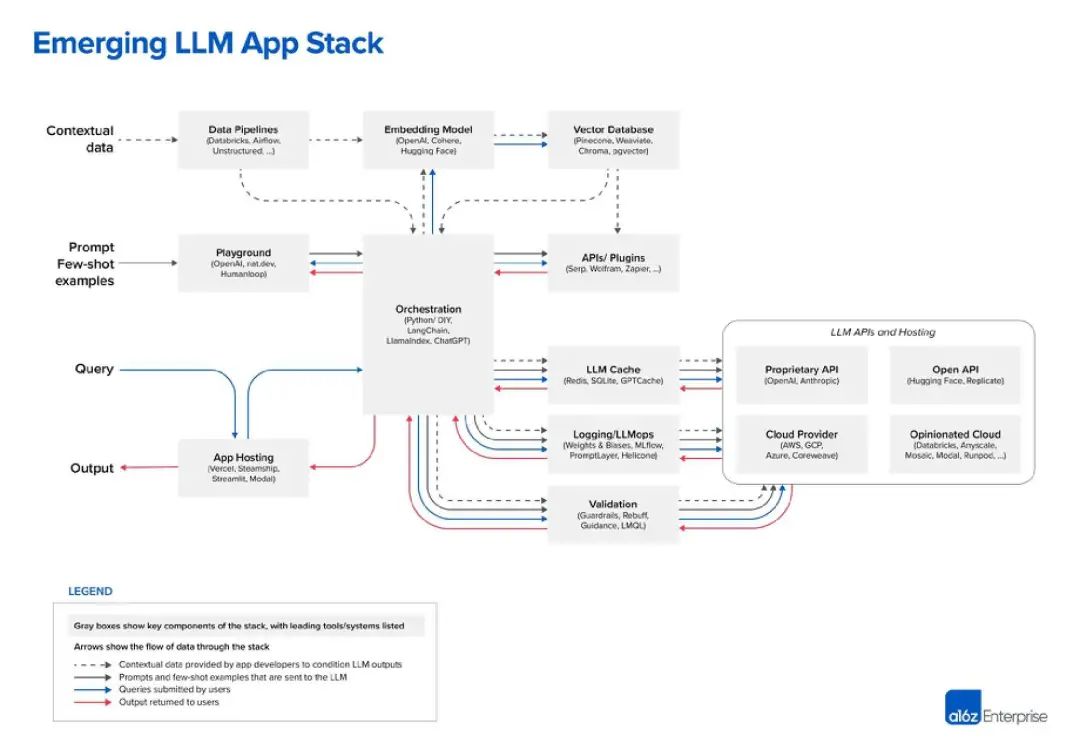

Jusqu'à présent, le meilleur diagramme que j'ai vu de la pile LLM vient de la société de capital-risque Andreessen Horowitz (a16z). Voici son point de vue sur la « pile d'applications LLM » :

Source de l'image : a16z

Source de l'image : a16z

Dans la pile technologique LLM, les données sont le composant le plus important, c'est très évident. Selon le graphique de a16z, les données sont en haut. En LLM, le "modèle embarqué" est un domaine très critique, vous pouvez choisir parmi OpenAI, Cohere, Hugging Face ou des dizaines d'autres options LLM, y compris le LLM open source de plus en plus populaire

Avant d'utiliser LLM, un "pipeline de données" a également besoin à établir. Par exemple, considérons Databricks et Airflow comme deux exemples, ou les données peuvent être traitées « non structurées ». Cela s'applique également à la périodicité des données et peut aider les entreprises à « nettoyer » ou simplement à organiser les données avant de les saisir dans un LLM personnalisé. Les sociétés de « data intelligence » comme Alation proposent ce type de service, qui ressemble un peu à des outils de type « business intelligence » plus connus dans la pile technologique informatique

La dernière partie de la couche de données est la base de données vectorielle qui est devenue très populaire ces derniers temps, pour le stockage et le traitement des données LLM. Selon la définition de Microsoft, il s'agit d'une base de données qui stocke les données sous forme de vecteurs de grande dimension, qui sont des représentations mathématiques de caractéristiques ou d'attributs. Les données sont stockées sous forme de vecteurs à l'aide de la technologie d'intégration

Dans une discussion médiatique, Pinecone, principal fournisseur de bases de données vectorielles, a noté que ses outils sont souvent utilisés avec des outils de pipeline de données tels que Databricks. Dans ce cas, les données sont généralement stockées ailleurs (comme dans un lac de données) puis transformées en données intégrées via un modèle d'apprentissage automatique. Après traitement et segmentation, les vecteurs résultants sont envoyés à Pinecone

Les deux niveaux suivants peuvent être résumés comme des astuces et des requêtes - Il s'agit de l'application d'IA avec LLM et (facultatif) d'un point d'interaction pour d'autres interfaces d’outils de données. A16z positionne LangChain et LlamaIndex comme des « frameworks d'orchestration », ce qui signifie qu'une fois que les développeurs comprennent quel LLM ils utilisent, ils peuvent exploiter ces outils

Selon a16z, les frameworks d'orchestration comme LangChain et LlamaIndex « font abstraction de beaucoup d'indices qui entrent dans les détails de « linking », c'est-à-dire interroger et gérer des données entre l'application et le LLM. Ce processus d'orchestration comprend l'interaction avec les interfaces API externes, la récupération des données contextuelles de la base de données vectorielles et la gestion de la mémoire sur plusieurs appels LLM. La case la plus intéressante du diagramme d'a16z est « Playground », qui comprend OpenAI, nat.dev et Humanloop

A16z n'est pas exactement défini dans le billet de blog, mais nous pouvons en déduire que les outils « Playground » peuvent aider les développeurs à lancer A16z. signalez le jiu-jitsu". Dans ces endroits, les développeurs peuvent expérimenter diverses techniques d'invite.

Humanloop est une entreprise britannique et une fonctionnalité de sa plateforme est le « Collaborative Prompt Workspace ». Il se décrit en outre comme une « boîte à outils de développement complète pour les fonctionnalités LLM de production ». Donc, fondamentalement, cela vous permet d'essayer des trucs LLM puis de les déployer dans votre application si cela fonctionne

À l'heure actuelle, la configuration des lignes de production à grande échelle devient progressivement claire. Sur le côté droit de la zone d'orchestration se trouvent de nombreuses zones d'opération, notamment la mise en cache et la vérification LLM. En outre, il existe une gamme de services cloud et de services API liés au LLM, notamment des référentiels d'API ouverts tels que Hugging Face et des fournisseurs d'API propriétaires tels que OpenAI

C'est peut-être le développement auquel nous sommes habitués dans le "cloud natif". ère La chose la plus similaire dans la pile technologique des personnes est que de nombreuses entreprises DevOps ont ajouté l'intelligence artificielle à leur liste de produits, ce qui n'est pas une coïncidence. En mai, j'ai parlé avec le PDG de Harness, Jyoti Bansal. Harness exploite une « plate-forme de livraison de logiciels » qui se concentre sur la partie « CD » du processus CI/CD.

Bansai m'a dit que l'IA peut alléger les tâches fastidieuses et répétitives impliquées dans le cycle de vie de la livraison de logiciels, depuis la génération de spécifications basées sur les fonctionnalités existantes jusqu'à l'écriture de code. De plus, il a déclaré que l'IA peut automatiser les révisions de code, les tests de vulnérabilité, les corrections de bugs et même créer des pipelines CI/CD pour les builds et les déploiements. Selon une autre conversation que j'ai eue en mai, l'IA modifie également la productivité des développeurs. Trisha Gee de l'outil d'automatisation de construction Gradle m'a dit que l'IA peut accélérer le développement en réduisant le temps consacré aux tâches répétitives, comme l'écriture de code passe-partout, et en permettant aux développeurs de se concentrer sur la situation dans son ensemble, comme s'assurer que le code répond aux besoins de l'entreprise.

Dans la pile technologique de développement LLM émergente, nous pouvons observer une série de nouveaux types de produits, tels que des frameworks d'orchestration (tels que LangChain et LlamaIndex), des bases de données vectorielles et Humanloop. En attendant la plateforme "aire de jeux". Tous ces produits étendent et/ou complètent la technologie de base de l'ère actuelle : les grands modèles de langage

Tout comme la montée en puissance des outils de l'ère cloud-native tels que Spring Cloud et Kubernetes au cours des années précédentes. Cependant, à l'heure actuelle, presque toutes les grandes, petites et grandes entreprises de l'ère du cloud natif font de leur mieux pour adapter leurs outils à l'ingénierie de l'IA, ce qui sera très bénéfique pour le développement futur de la pile technologique LLM.

Oui, cette fois, le grand modèle ressemble à "se tenir sur les épaules de géants". Les meilleures innovations en matière de technologie informatique reposent toujours sur les fondations précédentes. C'est peut-être pour cela que la révolution « Web3 » a échoué : il ne s'agissait pas tant de s'appuyer sur la génération précédente que de tenter de l'usurper.

La pile technologique LLM semble l'avoir fait, elle est devenue un pont entre l'ère du développement cloud et un nouvel écosystème de développeurs basé sur l'intelligence artificielle

Lien de référence ://m.sbmmt.com/link/ c589c3a8f99401b24b9380e86d939842

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Introduction au framework utilisé par vscode

Introduction au framework utilisé par vscode Comment entrer les privilèges root sous Linux

Comment entrer les privilèges root sous Linux Numéro de séquence de remplissage des cellules fusionnées

Numéro de séquence de remplissage des cellules fusionnées commande telnet

commande telnet Quelles sont les solutions de stockage Big Data ?

Quelles sont les solutions de stockage Big Data ? Quels sont les outils de robots d'exploration gratuits ?

Quels sont les outils de robots d'exploration gratuits ? Comment obtenir Douyin Xiaohuoren

Comment obtenir Douyin Xiaohuoren Introduction au code d'effets spéciaux javascript

Introduction au code d'effets spéciaux javascript