développement back-end

développement back-end

Tutoriel Python

Tutoriel Python

Application pratique de Scrapy dans l'exploration et l'analyse des données Twitter

Application pratique de Scrapy dans l'exploration et l'analyse des données Twitter

Application pratique de Scrapy dans l'exploration et l'analyse des données Twitter

Scrapy est un framework de robot d'exploration Web basé sur Python qui peut analyser rapidement les données d'Internet et fournit des API et des outils simples et faciles à utiliser pour le traitement et l'analyse des données. Dans cet article, nous discuterons des cas d'application pratiques de Scrapy dans l'exploration et l'analyse des données Twitter.

Twitter est une plateforme de médias sociaux avec d'énormes utilisateurs et ressources de données. Les chercheurs, les analystes des médias sociaux et les data scientists peuvent accéder à de grandes quantités de données et découvrir des idées et des informations intéressantes grâce à l'exploration et à l'analyse de données. Cependant, il existe certaines limites à l'obtention de données via l'API Twitter, et Scrapy peut contourner ces limitations en simulant l'accès humain pour obtenir de plus grandes quantités de données Twitter.

Tout d'abord, nous devons créer un compte de développeur Twitter et demander une clé API et un jeton d'accès. Ensuite, nous devons définir les paramètres d'accès à l'API Twitter dans le fichier settings.py de Scrapy, ce qui permettra à Scrapy de simuler un accès manuel à l'API Twitter pour obtenir des données. Par exemple :

TWITTER_CONSUMER_KEY = 'your_consumer_key' TWITTER_CONSUMER_SECRET = 'your_consumer_secret' TWITTER_ACCESS_TOKEN = 'your_access_token' TWITTER_ACCESS_TOKEN_SECRET = 'your_access_token_secret'

Ensuite, nous devons définir un robot Scrapy pour explorer les données Twitter. Nous pouvons utiliser la définition d'élément de Scrapy pour spécifier le type de données à explorer, par exemple :

class TweetItem(scrapy.Item):

text = scrapy.Field()

created_at = scrapy.Field()

user_screen_name = scrapy.Field()Dans la configuration du robot, nous pouvons définir les mots-clés et la plage de temps à interroger, par exemple :

class TwitterSpider(scrapy.Spider):

name = 'twitter'

allowed_domains = ['twitter.com']

start_urls = ['https://twitter.com/search?f=tweets&q=keyword%20since%3A2021-01-01%20until%3A2021-12-31&src=typd']

def parse(self, response):

tweets = response.css('.tweet')

for tweet in tweets:

item = TweetItem()

item['text'] = tweet.css('.tweet-text::text').extract_first().strip()

item['created_at'] = tweet.css('._timestamp::text').extract_first()

item['user_screen_name'] = tweet.css('.username b::text').extract_first().strip()

yield itemDans cet exemple de robot, Nous avons utilisé un sélecteur CSS pour extraire tous les tweets concernant les « mots-clés » sur Twitter du 1er janvier 2021 au 31 décembre 2021. Nous stockons les données dans l'objet TweetItem défini ci-dessus et les transmettons au moteur Scrapy via une instruction rendement.

Lorsque nous exécutons le robot d'exploration Scrapy, il simule automatiquement l'accès humain à l'API Twitter, obtient les données Twitter et les stocke dans l'objet TweetItem de type de données défini. Nous pouvons utiliser divers outils et bibliothèques d'analyse de données fournis par Scrapy pour analyser et exploiter les données explorées, telles que :

class TwitterAnalyzer():

def __init__(self, data=[]):

self.data = data

self.texts = [d['text'] for d in data]

self.dates = [dt.strptime(d['created_at'], '%a %b %d %H:%M:%S %z %Y').date() for d in data]

def get_top_hashtags(self, n=5):

hashtags = Counter([re.findall(r'(?i)#w+', t) for t in self.texts])

return hashtags.most_common(n)

def get_top_users(self, n=5):

users = Counter([d['user_screen_name'] for d in self.data])

return users.most_common(n)

def get_dates_histogram(self, step='day'):

if step == 'day':

return Counter(self.dates)

elif step == 'week':

return Counter([date.fromisoformat(str(dt).split()[0]) for dt in pd.date_range(min(self.dates), max(self.dates), freq='W')])

analyzer = TwitterAnalyzer(data)

print(analyzer.get_top_hashtags())

print(analyzer.get_top_users())

print(analyzer.get_dates_histogram('day'))Dans cet exemple de code, nous définissons une classe TwitterAnalyzer qui utilise les données de l'objet TweetItem pour nous aider à obtenir diverses informations. et des informations tirées des données Twitter. Nous pouvons utiliser des méthodes de cette classe pour obtenir les balises de hachage les plus fréquemment utilisées dans les tweets, révéler les changements d'heure des utilisateurs actifs et des données d'impression, et bien plus encore.

En bref, Scrapy est un outil très efficace qui peut nous aider à obtenir des données à partir de sites Web tels que Twitter, puis à utiliser des techniques d'exploration et d'analyse de données pour découvrir des informations et des idées intéressantes. Que vous soyez un chercheur universitaire, un analyste des médias sociaux ou un passionné de science des données, Scrapy est un outil qui mérite d'être essayé et utilisé.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Quels sont les outils d'analyse des données de la blockchain?

Feb 21, 2025 pm 10:24 PM

Quels sont les outils d'analyse des données de la blockchain?

Feb 21, 2025 pm 10:24 PM

Le développement rapide de la technologie blockchain a entraîné la nécessité d'outils analytiques fiables et efficaces. Ces outils sont essentiels pour extraire des informations précieuses des transactions de blockchain afin de mieux comprendre et capitaliser sur leur potentiel. Cet article explorera certains des principaux outils d'analyse des données de la blockchain sur le marché, y compris leurs capacités, avantages et limitations. En comprenant ces outils, les utilisateurs peuvent obtenir les informations nécessaires pour maximiser les possibilités de la technologie de la blockchain.

Quels sont les sites Web d'analyse de données recommandés ?

Mar 13, 2024 pm 05:44 PM

Quels sont les sites Web d'analyse de données recommandés ?

Mar 13, 2024 pm 05:44 PM

Recommandé : 1. Forum d'analyse des données commerciales ; 2. Forum économique de l'Assemblée populaire nationale – Domaine de l'économétrie et des statistiques ; 4. Forum d'apprentissage et d'échange sur l'exploration de données ; . Analyse des données ; 8. Institut de recherche sur l'exploration de données ; 9. S-PLUS, R Statistics Forum.

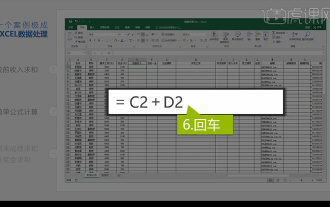

Analyse de données Excel intégrée

Mar 21, 2024 am 08:21 AM

Analyse de données Excel intégrée

Mar 21, 2024 am 08:21 AM

1. Dans cette leçon, nous expliquerons l'analyse intégrée des données Excel. Nous la compléterons à travers un cas. Ouvrez le support de cours et cliquez sur la cellule E2 pour saisir la formule. 2. Nous sélectionnons ensuite la cellule E53 pour calculer toutes les données suivantes. 3. Ensuite, nous cliquons sur la cellule F2, puis nous entrons la formule pour la calculer. De même, en faisant glisser vers le bas, nous pouvons calculer la valeur souhaitée. 4. Nous sélectionnons la cellule G2, cliquons sur l'onglet Données, cliquez sur Validation des données, sélectionnons et confirmons. 5. Utilisons la même méthode pour remplir automatiquement les cellules ci-dessous qui doivent être calculées. 6. Ensuite, nous calculons le salaire réel et sélectionnons la cellule H2 pour saisir la formule. 7. Ensuite, nous cliquons sur le menu déroulant des valeurs pour cliquer sur d'autres nombres.

Où est l'entrée officielle de Deepseek? Dernier guide de visite en 2025

Feb 19, 2025 pm 05:03 PM

Où est l'entrée officielle de Deepseek? Dernier guide de visite en 2025

Feb 19, 2025 pm 05:03 PM

Deepseek, un moteur de recherche complet qui fournit un large éventail de résultats des bases de données académiques, des sites Web d'information et des médias sociaux. Visitez le site officiel de Deepseek https://www.deepseek.com/, enregistrez un compte et connectez-vous, puis vous pouvez commencer à rechercher. Utilisez des mots clés spécifiques, des phrases précises ou des options de recherche avancées pour réduire votre recherche et obtenir les résultats les plus pertinents.

Bitget Exchange Official Site Web Login Dernière entrée

Feb 18, 2025 pm 02:54 PM

Bitget Exchange Official Site Web Login Dernière entrée

Feb 18, 2025 pm 02:54 PM

Le Bitget Exchange propose une variété de méthodes de connexion, y compris le courrier électronique, le numéro de téléphone mobile et les comptes de médias sociaux. Cet article détaille les dernières entrées et étapes pour chaque méthode de connexion, y compris l'accès au site officiel, la sélection de la méthode de connexion, la saisie des informations d'identification de connexion et la fin de la connexion. Les utilisateurs doivent prêter attention à l'utilisation du site officiel lors de la connexion et à conserver correctement les informations d'identification de connexion.

Quel est le prix des pièces IRM? La dernière tendance des prix de la pièce IRM

Mar 03, 2025 pm 11:48 PM

Quel est le prix des pièces IRM? La dernière tendance des prix de la pièce IRM

Mar 03, 2025 pm 11:48 PM

Cette crypto-monnaie n'a pas vraiment de valeur monétaire et sa valeur dépend entièrement du soutien communautaire. Les investisseurs doivent enquêter attentivement avant d'investir, car il manque des utilisations pratiques et des modèles économiques de jetons attrayants. Depuis que le jeton a été émis le mois dernier, les investisseurs ne peuvent actuellement acheter que par des bourses décentralisées. Le prix en temps réel de la pièce IRM est de 0,000045 $ ¥ 0,00033MRI Prix historique à 13:51 le 24 février 2025, le prix de la pièce IRM est de 0,000045 $. Le chiffre suivant montre la tendance des prix du jeton de février 2022 à juin 2024. Évaluation des risques d'investissement en IRM Actuellement, IRM Coin n'a été répertoriée sur aucune bourse et son prix a été réinitialisé à zéro et ne peut être acheté à nouveau. Même si le projet

La piste est froide, l'agent AI du champ vertical peut-il briser l'impasse?

Mar 05, 2025 am 07:57 AM

La piste est froide, l'agent AI du champ vertical peut-il briser l'impasse?

Mar 05, 2025 am 07:57 AM

Web3 vertical AIAGENT: renverser la tradition et remodeler le paysage de l'industrie? Cet article traite des différences d'application de AIAGENT dans Web2 et web3 et le potentiel futur de web3Agent. Web2 a été largement utilisé pour améliorer l'efficacité, couvrant les ventes, le marketing et d'autres domaines, et a réalisé des avantages économiques importants. Web3Agent combine la technologie blockchain pour ouvrir de nouveaux scénarios d'application, en particulier dans le champ Defi. Il démontre un potentiel au-delà de Web2agent grâce à des incitations à jetons, à des plateformes décentralisées et à l'analyse des données sur chaîne. Bien que Web3Agent est actuellement confronté à des défis, ses avantages uniques le font s'attendre à rivaliser avec Web2 à moyen et à long terme, et même à remodeler le paysage de l'industrie. Web2ai

Analyse et traitement des données via Golang

Mar 06, 2024 am 08:33 AM

Analyse et traitement des données via Golang

Mar 06, 2024 am 08:33 AM

Titre : Utilisation pratique de Golang pour l'analyse et le traitement des données L'analyse et le traitement des données deviennent de plus en plus importants à l'ère de l'information d'aujourd'hui, et Golang, en tant que langage de programmation rapide et efficace, est également largement utilisé dans le domaine du traitement et de l'analyse des données. En tirant parti des fonctionnalités puissantes et des bibliothèques riches de Golang, nous pouvons facilement mettre en œuvre diverses tâches de traitement de données complexes. Cet article expliquera comment utiliser Golang pour l'analyse et le traitement des données, et fournira des exemples de code spécifiques. 1. Importation et traitement des données Tout d’abord, nous devons