Récemment, Yoshua Bengio, l'un des Turing Big Three, a été interviewé par la BBC.

Bengio a révélé un fort sentiment de "mélancolie" lors de l'entretien, affirmant qu'il se sentait quelque peu perdu dans la carrière qu'il a poursuivie tout au long de sa vie.

Pour être plus précis, il estime que s’il pouvait prendre conscience plus tôt de la vitesse de développement possible de l’IA, il pourrait alors être enclin à donner la priorité à la sécurité de l’IA plutôt qu’à son aspect pratique.

Vous le savez, Bengio vient de signer la lettre ouverte "L'IA peut exterminer l'humanité" publiée il y a quelques jours.

La signature de la lettre ouverte montre clairement l’attitude de Bengio.

Cette lettre ouverte de 22 mots compare le risque que l'IA puisse exterminer l'humanité avec des crises sociales telles que la guerre nucléaire et les maladies infectieuses.

Dans l'interview de la BBC, Bengio a développé son point de vue.

Il nous a appelé à réglementer l’IA plus strictement. Par exemple, l’armée ne devrait jamais avoir le pouvoir d’utiliser l’IA.

Bien entendu, les institutions politiques ne ferment pas les yeux sur le développement de l’IA.

L'Union européenne pourrait être la première organisation à légiférer sur l'IA. Récemment également, l’Union européenne a déclaré qu’un code de conduite lié à l’IA pourrait être créé dans les semaines à venir.

Ce genre d'inquiétude n'est pas déraisonnable. Après tout, les hautes performances de l’IA peuvent être utilisées à des fins nuisibles à l’homme, comme le développement de nouvelles armes chimiques.

Bengio s'est dit très inquiet du fait que ceux qui ont des "intentions malveillantes" maîtrisent l'IA, surtout quand l'IA se développe si rapidement.

"Il peut s'agir de militaires, de terroristes ou de personnes mentalement instables. Bref, si ces personnes maîtrisent l'IA et la laissent accomplir des choses extrêmement dangereuses, les conséquences seront imprévisibles"

De plus, il a déclaré que si l'IA continue de se développer, nous ne pourrons peut-être pas l'interrompre dans le processus.

Ensuite, Bengio a encore parlé de lui.

Ces soucis ont sans aucun doute augmenté ses frictions internes et ont eu un impact sur sa vie personnelle et professionnelle.

Dans le passé, Bengio était un fier expert en IA (et bien sûr il l'est maintenant, il était prêt à se battre toute sa vie pour la carrière qu'il aimait et pour laquelle il était bon).

La carrière en IA lui a apporté un sentiment d'identité, de reconnaissance et d'orientation dans la vie. Mais maintenant, à cause de ces inquiétudes, ces choses ne lui sont plus claires.

"Pour ceux qui travaillent dans l'industrie de l'IA, c'est un défi émotionnel."

Cependant, derrière la morosité se cache toujours une attitude positive.

"Vous pouvez dire que je me sens perdu. Mais vous devez persévérer, vous devez participer aux discussions et encourager les autres à réfléchir avec vous

Musk a également exprimé des préoccupations similaires. "

Bien qu'il ne croit pas que l'IA exterminera définitivement les humains, il pense que l'IA peut limiter et contrôler les humains.

Bengio estime que toutes les entreprises géantes de la technologie liées aux produits d'IA doivent être contrôlées et enregistrées.

"Les gouvernements doivent suivre ce qu'ils font, ils doivent être capables de les auditer. Et c'est juste la chose la plus fondamentale que nous faisons avec toute autre industrie comme la construction d'avions, de voitures ou de produits pharmaceutiques." Il faut également introduire une sorte de formation éthique, qui n'est généralement pas reçue par l'informatique ", a déclaré le Dr Sasha Luccioni, scientifique chez Huggingface, que la société devrait prêter attention à des problèmes tels que les préjugés et la désinformation de l'IA. Elle voit ces problèmes. comme du béton.

Sa philosophie est que des questions spécifiques devraient recevoir davantage notre attention. Exterminer la race humaine, c’est un peu imaginaire, et on ne peut même pas en parler.

En fait, il existe de nombreux exemples montrant les nombreux avantages que l’IA apporte à la société.

La semaine dernière, grâce au pouvoir de l'IA, une personne paralysée a pu essayer de marcher à nouveau simplement en contrôlant ses pensées, grâce à une puce électronique développée grâce à l'IA.

Outre l'impact de la technologie, l'impact profond de l'IA sur l'économie nationale ne peut être ignoré.

De nombreuses entreprises ont commencé à utiliser des outils d'IA pour remplacer le travail humain, ce qui est également une raison importante pour laquelle les scénaristes hollywoodiens ont lancé une grève.

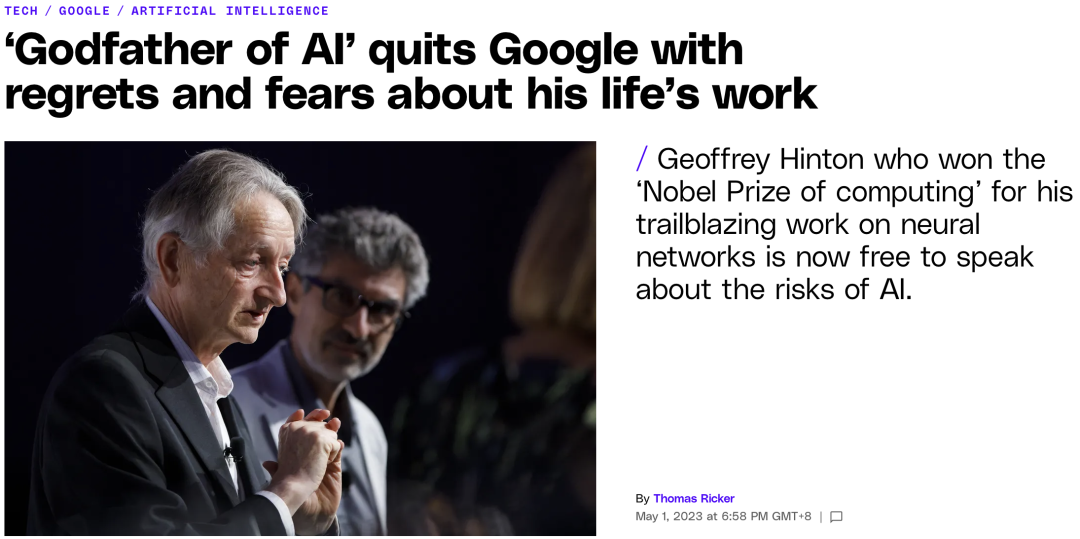

Hinton a résolument démissionné

Par coïncidence, il y a quelque temps, Hinton, qui fait également partie des Turing Big Three, était en recherche brûlante pour la même raison.A cette époque, les grands médias faisaient le plein de ce titre : Geoffrey Hinton, le doyen du deep learning et le père des réseaux de neurones, annonçait soudain sa démission de Google.

Pour pouvoir parler librement des risques de l'IA sans considérer l'impact sur Google.

Et c'est pourquoi il s'inquiète profondément des risques de l'intelligence artificielle. Hinton a dit sans détour : « Je regrette profondément le travail de ma vie. »

Du pionnier de l'intelligence artificielle au prophète apocalyptique, la transformation de Hinton marque également l'industrie technologique au milieu des décennies. tournant.

Cela met également de nombreux acteurs de l'industrie mal à l'aise. Ils craignent que les recherches qu'ils effectuent ne génèrent une sorte de danger pour le monde extérieur.

Cela met également de nombreux acteurs de l'industrie mal à l'aise. Ils craignent que les recherches qu'ils effectuent ne génèrent une sorte de danger pour le monde extérieur.

Parce que l’IA générative est peut-être déjà un outil de génération de désinformation. Et à un moment donné dans le futur, cela pourrait constituer une menace pour les humains.

De l’avis de Hinton, nous n’avons pas encore trouvé de moyen d’empêcher les mauvaises personnes de l’utiliser pour faire de mauvaises choses.

Après la démission de Hinton, au milieu d'une vague d'opposition bruyante, Hinton, le parrain de l'intelligence artificielle, n'a pas signé les deux lettres ouvertes restreignant le développement de l'IA.

Il a déclaré qu'avant de démissionner de son poste, il ne voulait pas critiquer publiquement Google ou d'autres entreprises.

Ce n'est que le mois dernier que Hinton a finalement pris sa décision et a informé Google qu'il démissionnait.

Après avoir choisi de quitter Google, Hinton peut enfin s'exprimer librement sur les risques de l'IA.

Je regrette profondément le travail de ma vie.

Je ne peux que me réconforter ainsi : Même s'il n'y a pas de moi, il y en aura d'autres.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Comment implémenter des polices de couleur en CSS

Comment implémenter des polices de couleur en CSS

Comment débloquer un téléphone Oppo si j'ai oublié le mot de passe

Comment débloquer un téléphone Oppo si j'ai oublié le mot de passe

Migrer les données d'un téléphone Android vers un téléphone Apple

Migrer les données d'un téléphone Android vers un téléphone Apple

Raisons de l'exception DNS

Raisons de l'exception DNS

Utilisation de la fonction MySQL dateiff

Utilisation de la fonction MySQL dateiff

La différence entre PowerShell et cmd

La différence entre PowerShell et cmd

fonction système()

fonction système()

Introduction aux commandes CLI

Introduction aux commandes CLI